bpycv:为Blender提供的计算机视觉和深度学习工具

bpycv是一个强大的Python库,为3D建模软件Blender提供了丰富的计算机视觉和深度学习功能。它可以让研究人员和开发者轻松地使用Blender生成高质量的合成数据集,用于训练和测试计算机视觉算法。

主要功能

bpycv具有以下核心功能:

- 渲染实例分割、语义分割和全景分割标注

- 生成6自由度(6DoF)姿态的真实标注数据

- 渲染深度图真实标注数据

- 预定义的域随机化功能:

- 自动从HDRI Haven下载光照和背景

- 从ShapeNet数据集添加干扰物体

- 使用Texture Haven的纹理

- 简单的安装和运行演示

- 支持Docker容器

- 提供构建合成数据集的Python代码库

- 支持转换为Cityscapes数据集格式

安装

bpycv支持Blender 2.9、3.0和3.1+版本。安装步骤如下:

-

从Blender官网下载并安装Blender。

-

在终端中打开Blender目录,运行以下安装脚本:

# 确保pip已安装

./blender -b --python-expr "from subprocess import sys,call;call([sys.executable,'-m','ensurepip'])"

# 更新pip工具链

./blender -b --python-expr "from subprocess import sys,call;call([sys.executable]+'-m pip install -U pip setuptools wheel'.split())"

# 安装bpycv

./blender -b --python-expr "from subprocess import sys,call;call([sys.executable]+'-m pip install -U bpycv'.split())"

# 检查bpycv是否安装成功

./blender -b -E CYCLES --python-expr "import bpycv,cv2;d=bpycv.render_data();bpycv.tree(d);cv2.imwrite('/tmp/try_bpycv_vis(inst-rgb-depth).jpg', d.vis()[...,::-1])"

使用示例

以下是一个快速的实例分割和深度图生成示例:

import cv2

import bpy

import bpycv

import random

import numpy as np

# 移除所有MESH对象

[bpy.data.objects.remove(obj) for obj in bpy.data.objects if obj.type == "MESH"]

for index in range(1, 20):

# 在随机位置创建立方体和球体作为实例

location = [random.uniform(-2, 2) for _ in range(3)]

if index % 2:

bpy.ops.mesh.primitive_cube_add(size=0.5, location=location)

categories_id = 1

else:

bpy.ops.mesh.primitive_uv_sphere_add(radius=0.5, location=location)

categories_id = 2

obj = bpy.context.active_object

# 为每个实例设置唯一的inst_id,用于生成实例标注

obj["inst_id"] = categories_id * 1000 + index

# 一行代码渲染图像、实例标注和深度图

result = bpycv.render_data()

# 保存结果

cv2.imwrite("demo-rgb.jpg", result["image"][..., ::-1]) # 转换RGB图像为OpenCV的BGR格式

cv2.imwrite("demo-inst.png", np.uint16(result["inst"])) # 保存实例图为16位PNG

depth_in_mm = result["depth"] * 1000 # 将深度单位从米转换为毫米

cv2.imwrite("demo-depth.png", np.uint16(depth_in_mm)) # 保存为16位PNG

# 为人类可视化实例掩码、RGB图像和深度图

cv2.imwrite("demo-vis(inst_rgb_depth).jpg", result.vis()[..., ::-1])

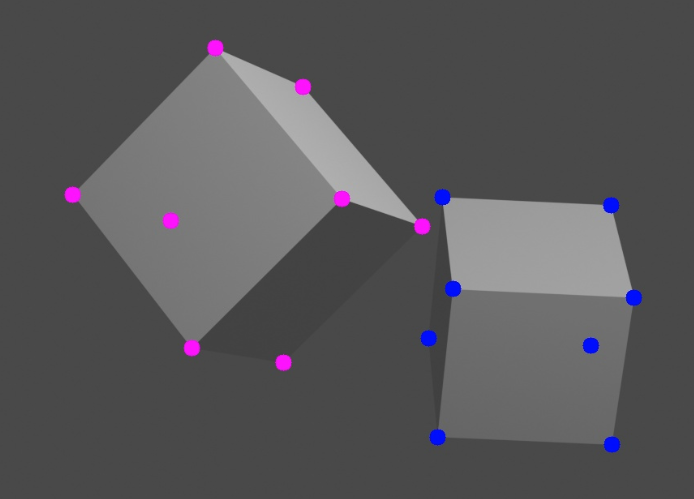

运行上述代码后,打开demo-vis(inst_rgb_depth).jpg文件,可以看到生成的实例分割、RGB图像和深度图的可视化结果。

YCB数据集演示

bpycv还提供了基于YCB数据集的更复杂演示。以下是运行步骤:

mkdir ycb_demo

cd ycb_demo/

# 准备代码和示例数据

git clone https://github.com/DIYer22/bpycv

git clone https://github.com/DIYer22/bpycv_example_data

cd bpycv/example/

blender -b -P ycb_demo.py

cd dataset/vis/

ls . # 查看可视化结果

打开ycb_demo/bpycv/example/dataset/vis/0.jpg可以看到生成的结果:

这个YCB演示包括:

- 背景、光照和干扰物体(来自ShapeNet)的域随机化

- 基于YCB数据集构建合成数据集的代码库

6DoF姿态演示

bpycv还提供了生成和可视化6自由度姿态真实标注数据的演示。详细代码可以查看example/6d_pose_demo.py。

使用技巧

Blender可能无法直接加载YCB和ShapeNet数据集中的.obj或.dae文件。建议使用meshlabserver进行转换和格式化,命令如下:

meshlabserver -i raw.obj -o for_blender.obj -m wt

bpycv项目欢迎任何建议和贡献。如果你在使用过程中遇到问题或有改进意见,可以在GitHub Issues中提出。

总的来说,bpycv为计算机视觉研究人员和开发者提供了一个强大而灵活的工具,可以轻松地使用Blender生成高质量的合成数据集。无论是实例分割、语义分割、深度估计还是6D姿态估计,bpycv都能满足各种计算机视觉任务的数据需求。它的简单安装过程和丰富的示例代码,使得即使是Blender新手也能快速上手并开始生成自己的数据集。