CDial-GPT:开启中文对话AI新纪元

在人工智能快速发展的今天,对话系统作为人机交互的重要方式,受到了学术界和工业界的广泛关注。然而,相比英文对话系统的蓬勃发展,中文对话系统的研究仍面临着数据和模型资源不足的挑战。为了推动中文对话系统的发展,清华大学智能技术与系统国家重点实验室推出了CDial-GPT项目,提供了大规模中文对话数据集LCCC和基于此数据集预训练的中文对话模型,为中文对话系统研究提供了重要资源。

LCCC:高质量大规模中文对话数据集

CDial-GPT项目的核心之一是LCCC(Large-scale Cleaned Chinese Conversation)数据集。这是一个经过严格清洗的大规模中文对话数据集,包含LCCC-base和LCCC-large两个版本。

LCCC-base数据集包含约670万个对话,共计约2000万个语句。LCCC-large数据集规模更大,包含约1200万个对话,共计约3300万个语句。这两个数据集都经过了严格的数据清洗流程,包括规则过滤和基于机器学习的分类器过滤,去除了大量噪声数据,如包含攻击性或敏感词汇的语句、特殊符号、表情符号、语法不正确的句子以及上下文不连贯的对话等。

LCCC数据集的原始对话来源广泛,包括微博对话、PTT八卦语料、电影字幕语料、小黄鸡语料、贴吧语料等多个公开数据集。这种多样化的数据来源使得LCCC数据集具有更好的覆盖面和代表性。

CDial-GPT:中文对话预训练模型

基于LCCC数据集,CDial-GPT项目还提供了一系列预训练的中文对话模型。这些模型采用了两阶段预训练的方法:首先在中文小说数据上进行预训练,然后在LCCC数据集上进行进一步的预训练。

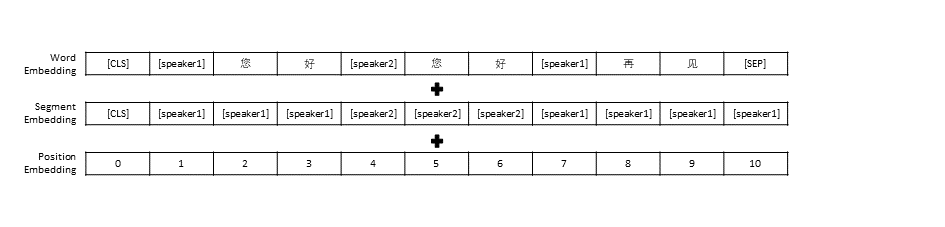

CDial-GPT模型的输入包括词向量、说话人向量和位置向量。模型采用了类似TransferTransfo的方法,将对话历史拼接为一个句子作为输入,预测对话回复。项目提供了多个版本的预训练模型:

- GPTNovel:在中文小说数据(约13亿字)上预训练的GPT模型

- CDial-GPTLCCC-base:在GPTNovel基础上,使用LCCC-base数据集进一步预训练的GPT模型

- CDial-GPT2LCCC-base:在GPTNovel基础上,使用LCCC-base数据集进一步预训练的GPT2模型

- CDial-GPTLCCC-large:在GPTNovel基础上,使用LCCC-large数据集进一步预训练的GPT模型

这些模型都采用了95.5M参数量的配置,可以在Hugging Face模型库中找到并直接使用。

模型评测:性能优异

为了验证CDial-GPT模型的性能,研究团队在STC数据集上对模型进行了微调和评测。评测采用了自动评价指标和人工评价指标相结合的方式。

在自动评价指标方面,CDial-GPT模型在困惑度(PPL)、BLEU、Distinct等指标上都取得了优异的表现。特别是GPTLCCC-large模型,在多个指标上都优于基线模型。

在人工评价方面,研究团队邀请了标注员对模型生成的回复进行评分,评价维度包括对话流畅性、上下文相关性和回复多样性。结果显示,GPTLCCC-large模型的表现最为出色,有48.6%的回复获得了最高分。

此外,研究团队还对模型生成的回复进行了不良内容统计。在1000个随机采样的回复中,仅有34个回复存在问题,其中23个包含重复语句,9个包含脏字,2个属于其他不良回复。这表明CDial-GPT模型在生成高质量、健康的对话内容方面表现良好。

快速上手:便捷的使用方式

CDial-GPT项目不仅提供了数据集和预训练模型,还提供了便捷的使用方式。用户可以通过以下步骤快速开始使用CDial-GPT:

- 克隆项目仓库并安装依赖:

git clone https://github.com/thu-coai/CDial-GPT.git

cd CDial-GPT

pip install -r requirements.txt

- 准备数据集和预训练模型:

git lfs install

git clone https://huggingface.co/thu-coai/CDial-GPT_LCCC-large

- 训练模型:

python train.py --pretrained --model_checkpoint thu-coai/CDial-GPT_LCCC-large --data_path data/STC.json --scheduler linear

- 生成对话:

python infer.py --model_checkpoint YOUR_MODEL_PATH --datapath data/STC_test.json --out_path STC_result.txt

python interact.py --model_checkpoint YOUR_MODEL_PATH

项目还提供了多个可调节的参数,如训练轮数、批次大小、学习率等,用户可以根据自己的需求进行调整。

结语:开启中文对话AI新篇章

CDial-GPT项目的推出,为中文对话系统研究提供了宝贵的资源。高质量的LCCC数据集和性能优异的预训练模型,为研究人员和开发者提供了坚实的基础。这不仅有助于推动中文对话系统的技术进步,也为未来更智能、更自然的人机交互铺平了道路。

值得注意的是,CDial-GPT项目仅限于科研用途。尽管项目采用了严格的数据清洗流程,但仍不能保证所有不当内容均已被过滤。使用者应当遵守相关法律法规,并对生成的内容负责。

随着CDial-GPT项目的不断发展和完善,我们有理由相信,中文对话AI将迎来更加广阔的应用前景。无论是在客户服务、教育辅导,还是在智能家居、虚拟助手等领域,CDial-GPT都有望发挥重要作用,为用户带来更加智能、自然的对话体验。

让我们共同期待CDial-GPT项目的未来发展,见证中文对话AI的新纪元! 🚀🤖💬