ChatSim:基于LLM-Agent协作的自动驾驶可编辑场景仿真

ChatSim:开创自动驾驶场景仿真新范式

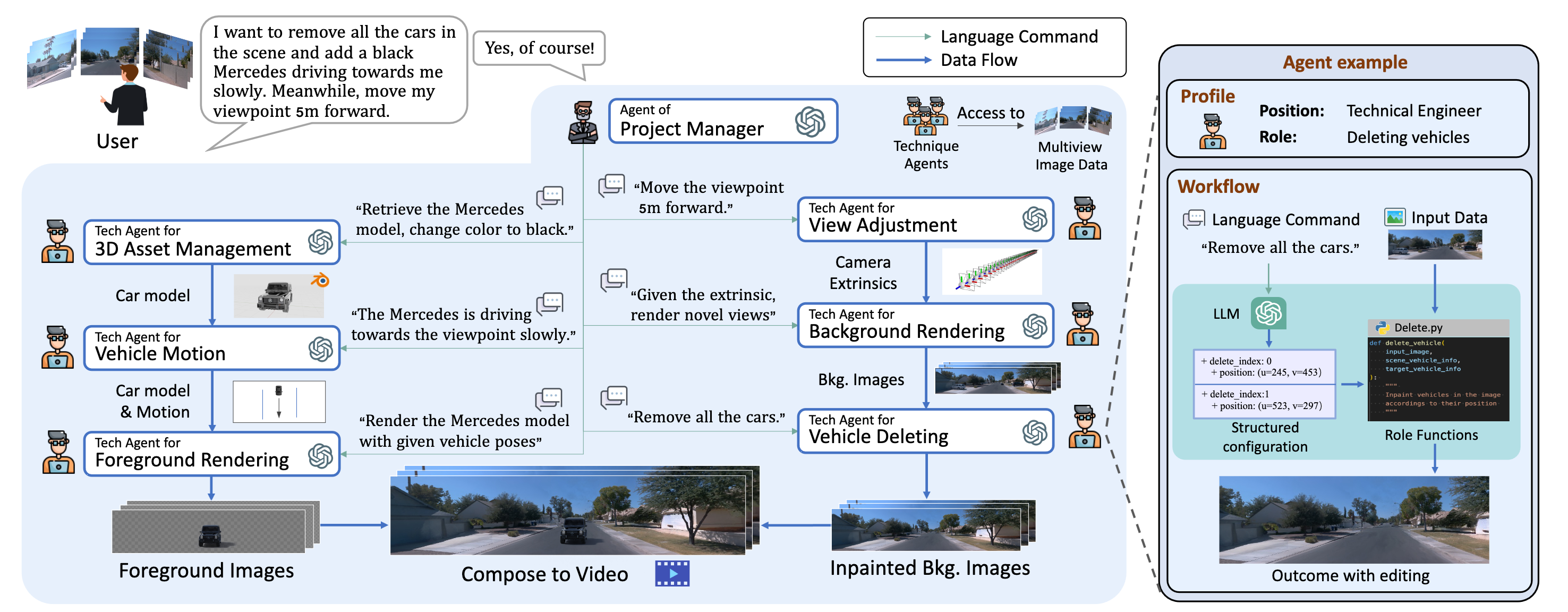

自动驾驶技术的快速发展为交通出行带来了革命性的变革,但如何高效地测试和验证自动驾驶系统的性能和安全性仍然是一个巨大的挑战。传统的道路测试方法成本高昂、耗时长久,且难以覆盖所有可能的场景。因此,场景仿真技术应运而生,成为了自动驾驶研发中不可或缺的环节。然而,现有的可编辑场景仿真方法在用户交互效率、多摄像头照片级渲染以及外部数字资产集成等方面仍存在诸多限制。为了解决这些问题,来自上海交通大学、上海人工智能实验室、卡内基梅隆大学和清华大学的研究团队提出了一种全新的自动驾驶场景仿真系统——ChatSim。

ChatSim的创新之处

ChatSim是第一个能够通过自然语言命令实现可编辑的照片级真实3D驾驶场景仿真的系统,它具有以下几个突出特点:

-

高度灵活的编辑能力:ChatSim采用了大语言模型(LLM)代理协作框架,使用户能够通过自然语言命令轻松地编辑复杂的驾驶场景。

-

照片级真实渲染:系统采用了创新的多摄像头神经辐射场方法,能够生成高度逼真的场景视频。

-

外部资产无缝集成:ChatSim引入了新颖的多摄像头光照估计方法,实现了外部3D模型与场景的一致性渲染。

系统架构与工作流程

ChatSim的核心是一个基于LLM的多代理协作框架。这个框架模拟了人类团队的工作方式,将复杂的仿真需求分解为具体的编辑任务。主要包括以下几个关键代理:

-

指挥代理(Commander Agent):负责理解用户的自然语言命令,并将其转化为具体的任务指令。

-

场景代理(Scene Agent):负责维护和更新场景状态,确��保所有编辑操作的一致性。

-

运动代理(Motion Agent):生成物体的运动轨迹,确保运动的合理性和真实性。

-

渲染代理(Rendering Agent):负责生成最终的照片级真实场景视频。

这种多代理协作的方式不仅提高了仿真的效率,还大大增强了系统处理复杂场景和抽象命令的能力。

核心技术亮点

- 背景渲染技术

ChatSim引入了一种创新的多摄像头辐射场方法,以解决自动驾驶车辆周围摄像头存在的姿态不准确和曝光不一致问题。这种方法能够渲染出亮度一致的超广角图像,为场景仿真提供了高质量的背景。

- 前景渲染技术

系统采用了新颖的多摄像头光照估计方法。通过预测环境光照,ChatSim能够使用Blender渲染出与场景一致的前景物体,实现了外部3D模型与真实场景的无缝融合。

- 轨迹生成与优化

为了生成更加平滑和真实的物体轨迹,ChatSim集成了一个可选的轨迹跟踪模块。这个模块基于深度强化学习,能够对初始轨迹进行优化,使得物体的运动更加自然流畅。

实验结果与应用前景

研究团队在Waymo开放数据集上进行了大量实验,结果表明ChatSim能够处理复杂的语言命令,并生成相应的照片级真实场景视频。以下是几个典型的应用案例:

-

抽象命令处理:用户只需输入"制造一个交通堵塞"这样简单的命令,ChatSim就能理解意图并生成相应的复杂场景。

-

复杂场景编辑:"移除场景中的所有汽车,添加一辆保时捷向我快速驶来,同时添加一辆警车在后方追赶。视角向前移动5米,向上提升0.5米。"ChatSim能够精确执行这样复杂的多步骤编辑命令。

-

多轮交互编辑:系统支持用户通过多轮对话逐步完善场景。例如,用户可以先添加一辆车,然后修改其行驶方向,再添加其他车辆,ChatSim能够在保持场景一致性的同时,逐步实现用户的需求。

技术细节与实现

- 环境配置

ChatSim的运行环境要求如下:

- Ubuntu版本 >= 20.04(用于运行Blender 3.+)

- Python >= 3.8

- Pytorch >= 1.13

- CUDA >= 11.6

- COLMAP或Metashape软件(用于相机姿态校准,非必需)

- OpenAI API密钥(也可使用NVIDIA AI提供的免费API)

- 系统安装

ChatSim的安装过程包括以下几个主要步骤:

- 环境设置

- 背景渲染引擎安装(McNeRF或3D Gaussian Splatting)

- 图像修复工具安装

- Blender软件及相关工具安装

- 轨迹跟踪模块安装(可选)

- 光照估计模块安装(可选)

- 数据准备

ChatSim使用Waymo开放数据集进行训练和测试。主要的数据准备步骤包括:

- 下载并提取Waymo数据

- 重新校准Waymo数据(提供了预校准的文件,也可自行校准)

- 下载Blender 3D资产

- 下载天空球HDRI数据

- 训练与仿真

用户可以选择训练McNeRF或3D Gaussian Splatting作为背景渲染引擎。训练完成后,可以通过简单的命令行指令启动仿真过程:

python main.py -y ${CONFIG YAML} -p "${PROMPT}" [-s ${SIMULATION NAME}]

其中,${CONFIG YAML}指定场景信息,${PROMPT}是用户的输入提示,${SIMULATION NAME}决定保存结果的文件夹名称。

未来展望

ChatSim的出现为自动驾驶场景仿真领域带来了新的可能性。它不仅提高了仿真的效率和灵活性,还为自动驾驶系统的测试和验证提供了更加丰富和真实的场景。未来,研究团队计划进一步完善系统功能,包括:

- 发布arXiv论文,公开代码和模型。

- 集成运动跟踪模块,进一步提升轨迹的平滑度和真实性。

- 开发多轮对话的包装代码��,提升用户交互体验。

随着这些改进的实现,ChatSim有望成为自动驾驶研发中不可或缺的工具,加速自动驾驶技术的发展和落地。

结语

ChatSim的诞生标志着自动驾驶场景仿真技术迈入了一个新的阶段。通过结合大语言模型、计算机视觉和3D渲染技术,ChatSim为自动驾驶研究人员和工程师提供了一个强大而灵活的工具,使他们能够更加高效地设计、测试和优化自动驾驶系统。随着技术的不断完善和应用范围的扩大,ChatSim将为推动自动驾驶技术的进步做出重要贡献,为未来更安全、更智能的交通系统铺平道路。

编辑推荐精选

openai-agents-python

OpenAI Agents SDK,助力开发者便捷使用 OpenAI 相关功能。

openai-agents-python 是 OpenAI 推出的一款强大 Python SDK,它为开发者提供了与 OpenAI 模型交互的高效工具,支持工具调用、结果处理、追踪等功能,涵盖多种应用场景,如研究助手、财务研究等,能显著提升开发效率,让开发者更轻松地利用 OpenAI 的技术优势。

Hunyuan3D-2

高分辨率纹理 3D 资产生成

Hunyuan3D-2 是腾讯开发的用于 3D 资产生成的强大工具,支持从文本描述、单张图片或多视角图片生成 3D 模型,具备快速形状生成能力,可生成带纹理的高质量 3D 模型,适用于多个领域,为 3D 创作提供了高效解决方案。

3FS

一个具备存储、管理和客户端操作等多种功能的分布式文件系统相关项目。

3FS 是一个功能强大的分布式文件系统项目,涵盖了存储引擎、元数据管理、客户端工具等多个模块。它支持多种文件操作,如创建文件和目录、设置布局等,同时具备高效的事件循环、节点选择和协程池管理等特性。适用于需要大规模数据存储和管理的场景,能够提高系统的性能和可靠性,是分布式存储领域的优质解决方案。

TRELLIS

用于可扩展和多功能 3D 生成的结构化 3D 潜在表示

TRELLIS 是一个专注于 3D 生成的项目,它利用结构化 3D 潜在表示技术,实现了可扩展且多功能的 3D 生成。项目提供了多种 3D 生成的方法和工具,包括文本到 3D、图像到 3D 等,并且支持多种输出格式,如 3D 高斯、辐射场和网格等。通过 TRELLIS,用户可以根据文本描述或图像输入快速生成高质量的 3D 资产,适用于游戏开发、动画制作、虚拟现实等多个领域。

ai-agents-for-beginners

10 节课教你开启构建 AI 代理所需的一切知识

AI Agents for Beginners 是一个专为初学者打造的课程项目,提供 10 节课程,涵盖构建 AI 代理的必备知识,支持多种语言,包含规划设计、工具使用、多代理等丰富内容,助您快速入门 AI 代理领域。

AEE

AI Excel全自动制表工具

AEE 在线 AI 全自动 Excel 编辑器,提供智能录入、自动公式、数据整理、图表生成等功能,高效处理 Excel 任务,提升办公效率。支持自动高亮数据、批量计算、不规则数据录入,适用于企业、教育、金融等多场景。

UI-TARS-desktop

基于 UI-TARS 视觉语言模型的桌面应用,可通过自然语言控制计算机进行多模态操作。

UI-TARS-desktop 是一款功能强大的桌面应用,基于 UI-TARS(视觉语言模型)构建。它具备自然语言控制、截图与视觉识别、精确的鼠标键盘控制等功能,支持跨平台使用(Windows/MacOS),能提供实时反馈和状态显示,且数据完全本地处理,保障隐私安全。该应用集成了多种大语言模型和搜索方式,还可进行文件系统操作。适用于需要智能交互和自动化任务的场景,如信息检索、文件管理等。其提供了详细的文档,包括快速启动、部署、贡献指南和 SDK 使用说明等,方便开发者使用和扩展。

Wan2.1

开源且先进的大规模视频生成模型项目

Wan2.1 是一个开源且先进的大规模视频生成模型项目,支持文本到图像、文本到视频、图像到视频等多种生成任务。它具备丰富的配置选项,可调整分辨率、扩散步数等参数,还能对提示词进行增强。使用了多种先进技术和工具,在视频和图像生成领域具有广泛应用前景,适合研究人员和开发者使用。

爱图表

全流程 AI 驱动的数据可视化工具,助力用户轻松创作高颜值图表

爱图表(aitubiao.com)就是AI图表,是由镝数科技推出的一款创新型智能数据可视化平台,专注于为用户提供便捷的图表生成、数据分析和报告撰写服务。爱图表是中国首个在图表场景接入DeepSeek的产品。通过接入前沿的DeepSeek系列AI模型,爱图表结合强大的数据处理能力与智能化功能,致力于帮助职场人士高效处理和表达数据,提升工作效率和报告质量。

Qwen2.5-VL

一款强大的视觉语言模型,支持图像和视频输入

Qwen2.5-VL 是一款强大的视觉语言模型,支持图像和视频输入,可用于多种场景,如商品特点总结、图像文字识别等。项目提供了 OpenAI API 服务、Web UI 示例等部署方式,还包含了视觉处理工具,有助于开发者快速集成和使用,提升工作效率。

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号