ComfyUI-LivePortrait: 高效的人像动画生成工具

ComfyUI-LivePortrait: 让静态人像栩栩如生

在数字内容创作领域,将静态图像转化为动态视频一直是一个充满挑战的任务。然而,随着人工智能技术的不断进步,这个过程变得越来越简单和高效。ComfyUI-LivePortrait就是这样一款革命性的工具,它为创作者提供了一种简单而强大的方法,可以将静态人像照片转换成生动的动画视频。

LivePortrait技术简介

LivePortrait是由快手科技开发的一种高效的人像动画框架。与传统的基于扩散模型的方法不同,LivePortrait采用了一种基于隐式关键点的框架,巧妙地平衡了计算效率和可控性。这使得它能够在保持高质量生成效果的同时,大大提高了处理速度。在RTX 4090 GPU上使用PyTorch,LivePortrait每帧仅需约12.8毫秒,展现了惊人的效率。

ComfyUI-LivePortrait的特色功能

ComfyUI-LivePortrait是LivePortrait技术在ComfyUI框架下的实现,它继承了LivePortrait的高效性,同时提供了更加灵活和用户友好的接口。以下是其主要特点:

-

多人脸支持:ComfyUI-LivePortrait能够同时处理一张图片中的多个人脸,为群体照片的动画化提供了可能。

-

差异化动画:对于同一张图片中的不同人脸,用户可以指定不同的动画效果,实现个性化的动画生成。

-

表情编辑器:内置的表情编辑器允许用户精细调整生成的动画表情,提供了更高级的创作控制。

-

视频到视频模式:除了支持图片到视频的转换,ComfyUI-LivePortrait还支持视频到视频的模式,为创作者提供了更多可能性。

-

高度集成:作为ComfyUI的插件,它能够无缝集成到现有的ComfyUI工作流中,与其他节点和功能协同工作。

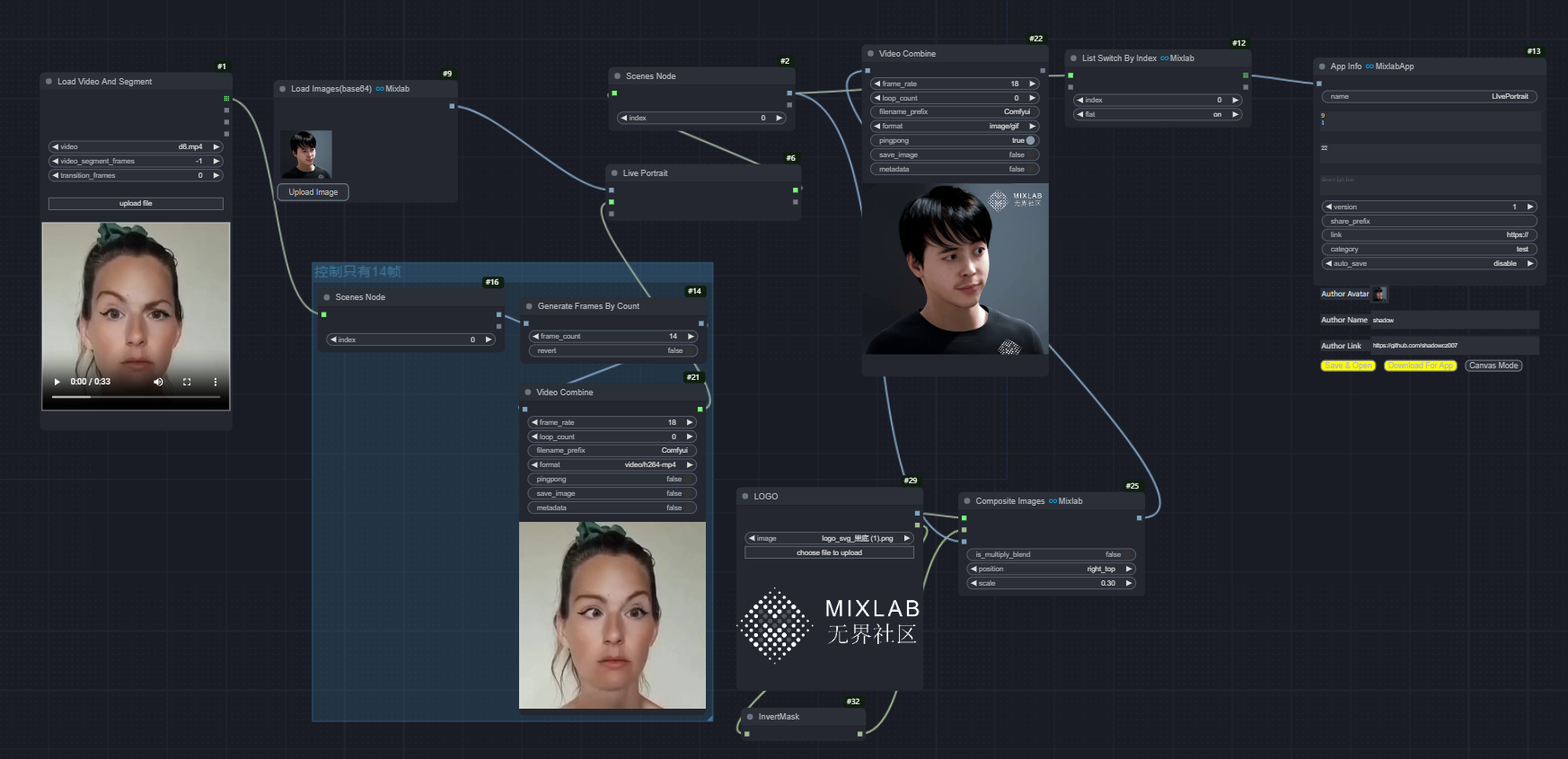

工作流程��与核心组件

ComfyUI-LivePortrait的工作流程主要包括以下几个步骤:

-

模型加载:首先需要加载LivePortrait所需的模型,包括外观特征提取器、动作提取器、SPADE生成器和扭曲模块等。

-

人脸检测与裁剪:使用Face Crop Info节点来检测和裁剪输入图像中的人脸。这一步骤支持多种人脸排序方式,如从左到右或从大到小。

-

动画生成:Live Portrait节点是核心组件,它接收源图像、驱动视频和裁剪信息作为输入,生成动态的人像视频。

-

重定向控制:Retargeting节点允许用户控制眼睛和嘴唇的动画效果,提供更精细的动画调整。

-

视频合成:最后,生成的动画可以与原始图像或视频进行合成,创造出最终的动画效果。

使用指南

要开始使用ComfyUI-LivePortrait,用户需要按照以下步骤操作:

-

安装:通过ComfyUI的管理器搜索并安装ComfyUI-LivePortraitKJ插件。

-

模型下载:将所需的模型文件下载并放置在正确的目录中(

Comfyui/models/liveportrait和Comfyui/models/insightface)。 -

环境配置:确保安装了必要的Python依赖,尤其是insightface库。

-

工作流构建:在ComfyUI中构建包含LivePortrait相关节点的工作流。

-

参数调整:根据需要调整各个节点的参数,如人脸裁剪的比例、动画强度等。

-

生成与导出:运行工作流生成动画,并导出最终的视频文件。

应用场景与潜力

ComfyUI-LivePortrait的应用场景非常广泛,包括但不限于:

- 社交媒体内容创作:为静态头像或照片添加动画效果,增加互动性。

- 教育培训:创建动态讲解视频,提高学习材料的吸引力。

- 数字营销:制作吸引眼球的广告内容,提高用户参与度。

- 娱乐产业:快速生成动画角色,降低动画制作成本。

- 虚拟现实与增强现实:为VR/AR应用创建生动的虚拟角色。

未来展望

随着AI技术的不断发展,我们可以期待ComfyUI-LivePortrait在以下方面有更多突破:

- 实时渲染:进一步优化性能,实现实时的动画生成和调整。

- 更细致的控制:提供更多参数和工具,允许创作者对动画效果进行更精细的控制。

- 跨平台支持:开发移动端和Web版本,使技术更易于普及。

- 与其他AI技术的融合:例如,结合语音合成技术,实现完整的虚拟人物创建。

ComfyUI-LivePortrait代表了人像动画技术的一个重要里程碑。它不仅为创作者提供了强大的工具,也为数字内容的未来发展指明了方向。随着技术的不断完善和应用场景的拓展,我们有理由相信,ComfyUI-LivePortrait将在数字创意领域发挥越来越重要的作用,为创作者们带来更多可能性和灵感。

编辑推荐精选

讯飞智文

一键生成PPT和Word,让学习生活更轻松

讯飞智文是一个利用 AI 技术的项目,能够帮助用户生成 PPT 以及各类文档。无论是商业领域的市场分析报告、年度目标制定,还是学生群体的职业生涯规划、实习避坑指南,亦或是活动策划、旅游攻略等内容,它都能提供支持,帮助用户精准表达,轻松呈现各种信息。

讯飞星火

深度推理能力全新升级,全面对标OpenAI o1

科大讯飞的星火大模型,支持语言理解、知识问答和文本创作等多功能,适用于多种文件和业务场景,提升办公和日常生活的效率。讯飞星火是一个提供丰富智能服务的平台,涵盖科技资讯、图像创作、写作辅助、编程解答、科研文献解读等功能,能为不同需求的用户提供便捷高效的帮助,助力用户轻松获取信息、解决问题,满足多样化使用场景。

Spark-TTS

一种基于大语言模型的高效单流解耦语音令牌文本到语音合成模型

Spark-TTS 是一个基��于 PyTorch 的开源文本到语音合成项目,由多个知名机构联合参与。该项目提供了高效的 LLM(大语言模型)驱动的语音合成方案,支持语音克隆和语音创建功能,可通过命令行界面(CLI)和 Web UI 两种方式使用。用户可以根据需求调整语音的性别、音高、速度等参数,生成高质量的语音。该项目适用于多种场景,如有声读物制作、智能语音助手开发等。

Trae

字节跳动发布的AI编程神器IDE

Trae是一种自适应的集成开发环境(IDE),通过自动化和多元协作改变开发流程。利用Trae,团队能够更快速、精确地编写和部署代码,从而提高编程效率和项目交付速度。Trae具备上下文感知和代码自动完成功能,是提升开发效率的理想工具。

咔片PPT

AI助力,做PPT更简单!

咔片是一款轻量化在线演示设计工具,借助 AI 技术,实现从内容生成到智能设计的一站式 PPT 制作��服务。支持多种文档格式导入生成 PPT,提供海量模板、智能美化、素材替换等功能,适用于销售、教师、学生等各类人群,能高效制作出高品质 PPT,满足不同场景演示需求。

讯飞绘文

选题、配图、成文,一站式创作,让内容运营更高效

讯飞绘文,一个AI集成平台,支持写作、选题、配图、排版和发布。高效生成适用于各类媒体的定制内容,加速品牌传播,提升内容营销效果。

材料星

专业的AI公文写作平台,公文写作神器

AI 材料星,专业的 AI 公文写作辅助平台,为体制内工作人员提供高效的公文写作解决方案。拥有海量公文文库、9 大核心 AI 功能,支持 30 + 文稿类型生成,助力快速完成领导讲话、工作总结、述职报告等材料,提升办公效率,是体制打工人的得力写作神器。

openai-agents-python

OpenAI Agents SDK,助力开发者便捷使用 OpenAI 相关功能。

openai-agents-python 是 OpenAI 推出的一款强大 Python SDK,它为开发者提供了与 OpenAI 模型交互的高效工具,支持工具调用、结果处理、追踪等功能,涵盖多种应用场景,如研究助手、财务研究等,能显著提升开发效率,让开发者更轻松地利用 OpenAI 的技术优势。

Hunyuan3D-2

高分辨率纹理 3D 资产生成

Hunyuan3D-2 是腾讯开发的用于 3D 资产生成的强大工具,支持从文本描述、单张图片或多视角图片生成 3D 模型,具备快速形状生成能力,可生成带纹理的高质量 3D 模型,适用于多个领域,为 3D 创作提供了高效解决方案。

3FS

一个具备存储、管理和客户端操作等多种功能的分布式文件系�统相关项目。

3FS 是一个功能强大的分布式文件系统项目,涵盖了存储引擎、元数据管理、客户端工具等多个模块。它支持多种文件操作,如创建文件和目录、设置布局等,同时具备高效的事件循环、节点选择和协程池管理等特性。适用于需要大规模数据存储和管理的场景,能够提高系统的性能和可靠性,是分布式存储领域的优质解决方案。

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号