Custom Diffusion: 多概念定制化的文本到图像扩散模型

近年来,文本到图像生成技术取得了突破性进展,如Stable Diffusion等大型模型能够根据文本描述生成高质量图像。然而,这些预训练模型往往难以准确表达用户特定的概念,如用户的宠物、艺术风格等。为解决这一问题,研究人员提出了Custom Diffusion方法,实现了高效的模型定制化。

Custom Diffusion简介

Custom Diffusion是由Adobe Research和CMU的研究人员提出的一种文本到图像扩散模型定制化方法。它具有以下主要特点:

- 只需4-20张目标概念的图片即可进行微调

- 微调速度快,在2张A100 GPU上仅需约6分钟

- 只优化模型中少量参数,每个新概念额外存储需求仅75MB

- 支持多个新概念的组合使用,如新物体+新艺术风格

Custom Diffusion的核心思想是只优化扩散模型中交叉注意力层的key和value投影矩阵,从而在保持模型整体性能的同时,实现对新概念的快速学习。

Custom Diffusion的工作原理

Custom Diffusion的工作流程如下:

- 用户提供少量目标概念的图片(如4-20张)

- 系统自动检索或生成200张正则化图片,防止过拟合

- 仅优化预训练扩散模型中交叉注意力层的key和value映射

- 对于个人化类别,在类别名前添加新的修饰符标记,如V* dog

- 对于多概念,联合训练两个概念的数据集

- 也支持通过优化方法合并两个微调后的模型

通过这种方式,Custom Diffusion能够快速学习新概念,并保持模型在其他方面的生成能力。

Custom Diffusion的使用方法

使用Custom Diffusion进行模型定制化的基本步骤如下:

- 克隆Custom Diffusion代码库:

git clone https://github.com/adobe-research/custom-diffusion.git

cd custom-diffusion

- 安装依赖:

pip install accelerate>=0.24.1 modelcards transformers>=4.31.0 deepspeed diffusers==0.21.4

-

准备训练数据,将目标概念的图片放入相应文件夹

-

运行单概念微调脚本:

accelerate launch src/diffusers_training.py \

--pretrained_model_name_or_path="CompVis/stable-diffusion-v1-4" \

--instance_data_dir=./data/cat \

--class_data_dir=./real_reg/samples_cat/ \

--output_dir=./logs/cat \

--instance_prompt="photo of a <new1> cat" \

--class_prompt="cat" \

--resolution=512 \

--train_batch_size=2 \

--learning_rate=1e-5 \

--max_train_steps=250 \

--modifier_token "<new1>"

- 使用微调后的模型生成图像:

python src/diffusers_sample.py --delta_ckpt logs/cat/delta.bin \

--ckpt "CompVis/stable-diffusion-v1-4" \

--prompt "<new1> cat playing with a ball"

对于多概念微调,需要准备一个JSON文件描述多个概念,然后使用类似的命令进行训练。

Custom Diffusion的最新进展

最近,Custom Diffusion取得了一些新的进展:

- 已支持在diffusers库中使用,便于集成到现有项目

- 发布了CustomConcept101数据集,包含101个概念及评估提示

- 支持与SDXL(Stable Diffusion XL)模型一起使用

- 提供了模型压缩功能,可将每个概念的存储需求进一步降低到5-15MB

这些进展使得Custom Diffusion更加易用和实用。研究人员还在持续改进该方法,如探索更多概念的组合、提高生成质量等。

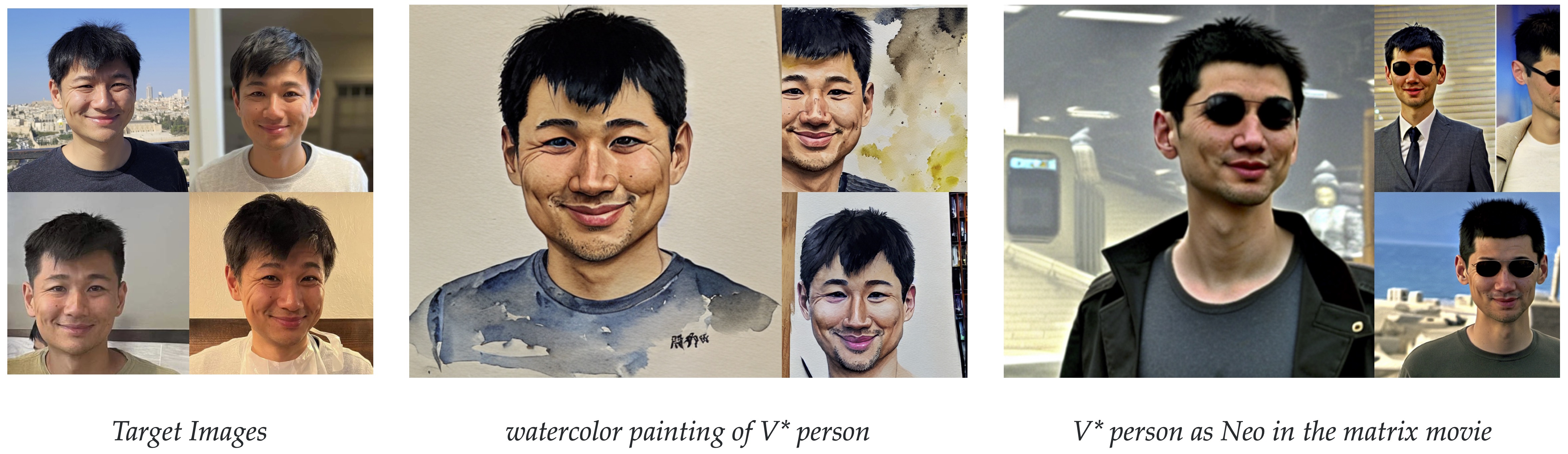

Custom Diffusion的应用示例

Custom Diffusion可以应用于多种场景,以下是一些典型的应用示例:

-

个人化宠物生成:用几张宠物照片训练模型,然后生成各种场景下的宠物图像

-

艺术风格转换:学习特定艺术家的风格,将其应用到不同的内容上

-

产品设计:快速生成产品在不同场景和样式下的效果图

-

多概念组合:如"猫坐在木制花盆里",组合学习到的"猫"和"木制花盆"概念

-

人脸定制:使用少量照片学习特定人物的面部特征,生成不同表情和场景下的肖像

通过这些应用,Custom Diffusion为个性化内容创作提供了强大而灵活的工具。

Custom Diffusion的局限性

尽管Custom Diffusion取得了显著成果,但它仍存在一些局限性:

- 对于复杂的组合(如宠物狗和宠物猫)仍具有挑战性

- 同时组合三个或更多概念的效果不佳

- 在某些情况下,可能会继承预训练模型的一些局限性

研究人员正在努力克服这些限制,以进一步提升Custom Diffusion的性能和适用范围。

结语

Custom Diffusion为文本到图像生成模型的个性化定制提供了一种高效、灵活的解决方案。通过只优化模型中的少量参数,它实现了快速学习新概念和概念组合的能力,为创意工作者和开发者提供了强大的工具。随着技术的不断发展和完善,我们可以期待看到更多基于Custom Diffusion的创新应用,推动个性化AI创作的发展。