DeepCache: 加速扩散模型的革新技术

在人工智能和计算机视觉领域,扩散模型因其卓越的生成能力而备受关注。然而,这些模型通常需要大量计算资源,主要源于顺序去噪过程和庞大的模型规模。传统压缩扩散模型的方法往往涉及大量的再训练,这不仅成本高昂,而且在实际应用中存在诸多挑战。为了解决这一问题,来自新加坡国立大学学习与视觉实验室的研究团队提出了一种名为DeepCache的创新方法。

DeepCache的核心理念

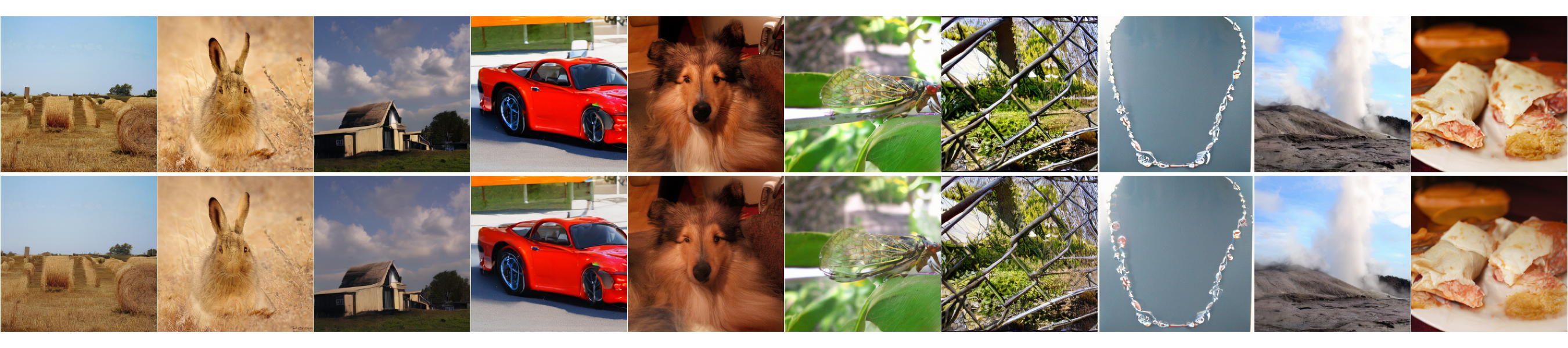

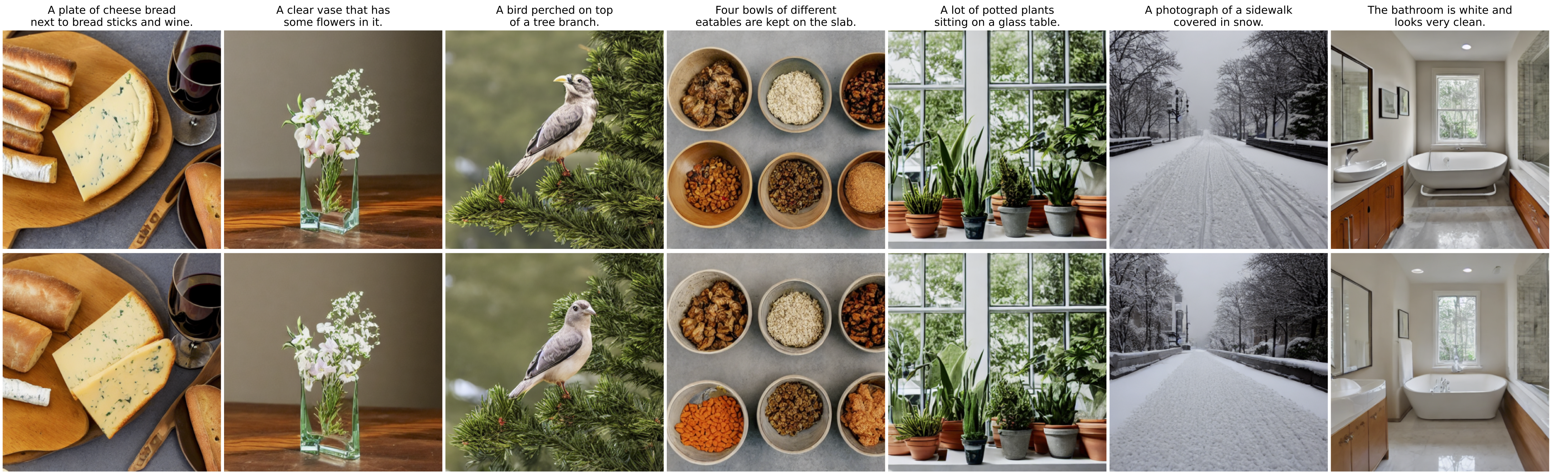

DeepCache是一种无需训练、几乎无损的新型范式,它从模型架构的角度加速扩散模型。这种方法巧妙地利用了扩散模型顺序去噪步骤中固有的时间冗余性,通过在相邻的去噪阶段缓存和检索特征,从而大幭减少冗余计算。

研究团队利用U-Net的特性,重用高层特征,同时以非常低的成本更新低层特征。这种创新策略使得Stable Diffusion v1.5的速度提高了2.3倍,同时CLIP Score仅下降0.05。对于ImageNet上的LDM-4-G模型,速度提升了4.1倍,FID仅略微增加0.22。

DeepCache的主要优势

-

无需训练: 与传统方法不同,DeepCache无需对模型进行再训练,这大大降低了实施成本和复杂度。

-

几乎无损: DeepCache在显著提高推理速度的同时,几乎不影响生成结果的质量。

-

广泛适用性: DeepCache支持多种扩散模型,包括Stable Diffusion、Stable Diffusion XL、Stable Video Diffusion等,还兼容DDIM和PLMS等采样算法。

-

即插即用: 最新版本的DeepCache实现了即插即用,无需修改diffuser的代码,大大提高了其实用性。

技术实现与性能评估

DeepCache的实现相对简单,主要涉及以下几个步骤:

- 加载原始pipeline

- 导入DeepCacheSDHelper

- 设置缓存参数

- 启用DeepCache

- 生成图像

- 禁用DeepCache

以Stable Diffusion为例,具体代码如下:

import torch

from diffusers import StableDiffusionPipeline

from DeepCache import DeepCacheSDHelper

# 加载原始pipeline

pipe = StableDiffusionPipeline.from_pretrained('runwayml/stable-diffusion-v1-5', torch_dtype=torch.float16).to("cuda:0")

# 导入DeepCacheSDHelper

helper = DeepCacheSDHelper(pipe=pipe)

helper.set_params(

cache_interval=3,

cache_branch_id=0,

)

helper.enable()

# 生成图像

deepcache_image = pipe(

prompt,

output_type='pt'

).images[0]

helper.disable()

在性能评估方面,DeepCache在多个模型和数据集上都取得了显著的加速效果:

- 对于Stable Diffusion v1.5,实现了2.15倍的加速。

- 在ImageNet上的LDM-4-G模型,达到了6.96倍的加速。

- 对于LSUN Church & Bedroom数据集的DDPM模型,实现了1.48倍的加速。

DeepCache的广泛应用

DeepCache的优秀性能和易用性使其迅速受到社区的欢迎和采用。目前,已有多个知名项目和平台集成了DeepCache:

- Hugging Face的Diffusers库官方支持DeepCache

- OneDiff项目集成了DeepCache,并扩展到SVD(Stable Video Diffusion)

- Comfyui、Colab & Gradio等多个平台提供了DeepCache的实现

- AUTOMATIC1111的Stable Diffusion WebUI和SD.Next也加入了DeepCache支持

- 甚至有开发者为M1 Mac上运行SD提供了MLX_deepcache实现

这些广泛的应用和集成充分证明了DeepCache的实用价值和影响力。

未来展望

DeepCache的成功为扩散模型的加速开辟了一条新的道路。未来,我们可以期待在以下几个方面看到更多进展:

-

更广泛的模型支持: 随着扩散模型在更多领域的应用,DeepCache有望扩展到更多类型的模型。

-

硬件优化: 结合特定硬件架构的优化,可能会带来更显著的性能提升。

-

与其他加速技术的结合: 将DeepCache与量化、剪枝等其他加速技术结合,可能会产生更强大的加速效果。

-

在线学习与自适应: 未来可能会出现能够根据输入动态调整缓存策略的版本,进一步提高效率。

-

更多下游任务的应用: 除了图像生成,DeepCache在视频生成、3D建模等领域也有潜力带来重大突破。

结语

DeepCache作为一种创新的扩散模型加速技术,展现了令人瞩目的性能和广泛的应用前景。它不仅大幅提高了模型的推理速度,还保持了生成结果的高质量,为AI创作工具的实际应用铺平了道路。随着技术的不断发展和完善,我们有理由相信,DeepCache将在推动扩散模型更广泛、更高效的应用方面发挥越来越重要的作用。

对于研究人员和开发者而言,DeepCache提供了一个极具价值的工具,使他们能够更快速、更经济地探索和应用扩散模型。对于普通用户来说,这项技术的进步意味着他们可以在个人设备上更流畅地使用各种基于扩散模型的创意工具。

总的来说,DeepCache不仅是一项技术创新,更是推动AI生成技术民主化和普及化的重要一步。它的出现和发展,无疑将为人工智能和创意产业带来新的机遇和可能性。