Denoising Vision Transformers: 消除ViT特征图中的伪影

引言

Vision Transformer (ViT)自问世以来在计算机视觉领域取得了巨大成功,在多个任务上超越了卷积神经网络(CNN)的表现。然而,研究人员发现ViT的特征图中存在一些不可忽视的问题 - 网格状的伪影,这些伪影严重影响了ViT在一些下游密集预测任务(如语义分割、深度估计等)中的性能。为了解决这一问题,来自南加州大学、康奈尔大学等机构的研究人员提出了Denoising Vision Transformers (DVT)方法。

DVT:消除ViT特征图中的伪影

DVT的核心思想是通过一个两阶段的去噪过程,有效地消除ViT特征图中的网格状伪影。这种方法不需要重新训练已有的预训练ViT模型,可以直接应用于任何ViT架构。

第一阶段:单图像去噪

在第一阶段,DVT采用了一种基于神经场(neural field)的单图像优化方法。其核心思想是将ViT的输出特征分解为三个部分:

- F(x): 表示去噪后的语义特征

- G(position): 表示跨视图共享的伪影

- h(x, position): 建模位置和语义内容之间的相互依赖关系

通过最小化重建误差和跨视图一致性损失,DVT可以有效地分离出干净的语义特征F(x)。这种单图像优化过程为离线应用提供了无伪影的特征估计。

第二阶段:训练通用去噪器

在第二阶段,研究人员利用第一阶段得到的大量去噪前后的特征对{y, F},训练了一个轻量级的Transformer块作为去噪器网络D。该网络可以直接从原始ViT输出y预测无噪声特征F,即F = D(y)。这个通用去噪器具有良好的泛化能力,可以应用于未见过的图像。

DVT的优势和应用

DVT方法具有以下几个显著优势:

-

无需重新训练:DVT可以直接应用于现有的预训练ViT模型,无需昂贵的重新训练过程。

-

通用性强:DVT可以应用于各种ViT架构,包括DINO、DeiT-III、EVA02、CLIP、DINOv2等。

-

性能提升显著:在多个下游任务中,DVT consistently提升了ViT的性能。

研究人员在多个具有代表性的数据集上评估了DVT的效果,包括:

- PASCAL VOC 2012 (语义分割)

- ADE20K (语义分割)

- NYU Depth V2 (深度估计)

- PASCAL VOC 2007+2012 (目标检测)

实验结果表明,DVT在所有这些任务上都取得了显著的性能提升。以DINOv2为例:

- 在PASCAL VOC 2012语义分割任务上,mIoU从83.60%提升到84.84%

- 在ADE20K语义分割任务上,mIoU从47.29%提升到48.66%

- 在NYU Depth V2深度估计任务上,相对误差从0.1238降低到0.1200

- 在PASCAL VOC目标检测任务上,mAP从81.4%提升到81.9%

这些结果充分证明了DVT在消除ViT特征图伪影方面的有效性,以及它在提升ViT下游任务性能方面的巨大潜力。

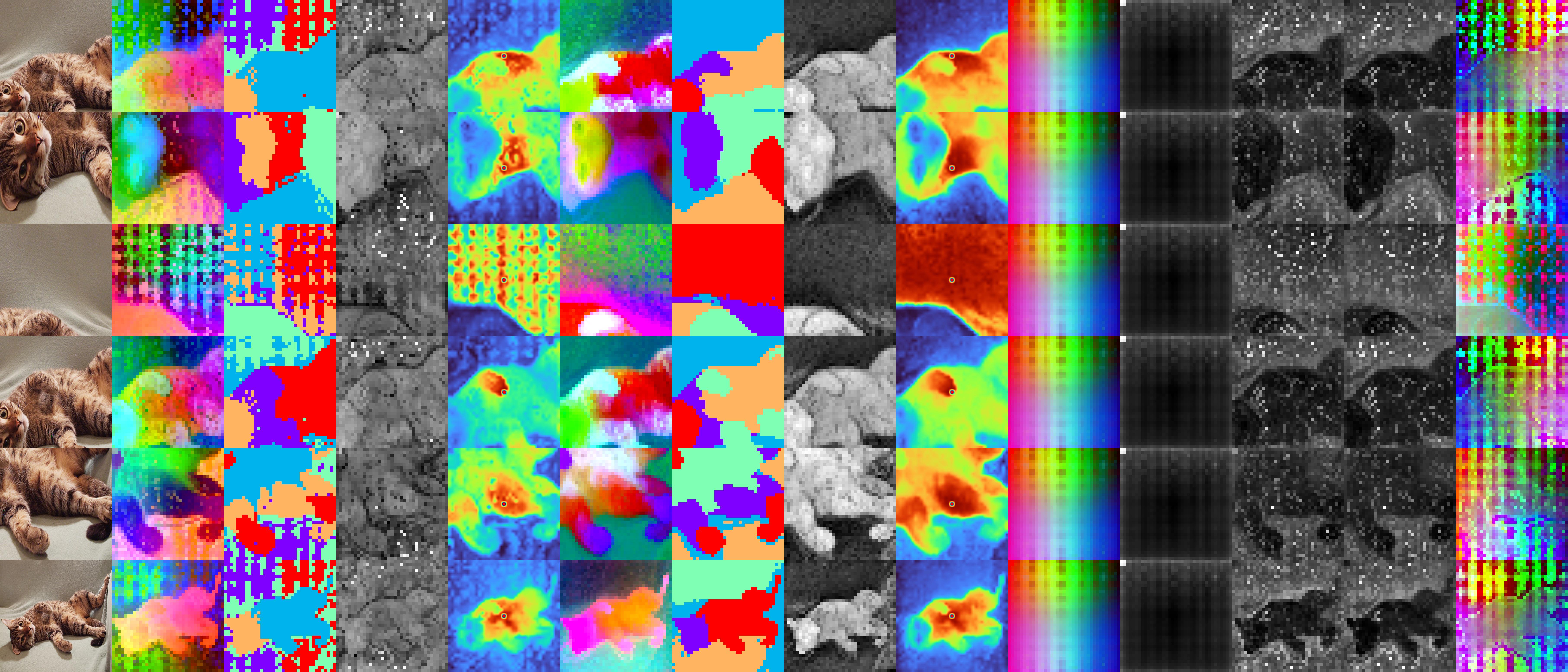

DVT的工作原理可视化

为了更直观地理解DVT的工作原理,研究人员提供了一系列可视化结果。以DINOv2 ViT-Base模型为例:

从左到右,各列分别表示:

- 输入裁剪图像

- 原始DINOv2输出

- 原始输出的KMeans聚类结果

- 原始输出的L2特征范数

- 原始输出中中心patch与其他patch的相似度

- DVT去噪后的输出

- 去噪输出的KMeans聚类结果

- 去噪输出的L2特征范数

- 去噪输出中中心patch与其他patch的相似度

- 分解出的共享伪影

- 共享伪影的L2范数

- 真实残差误差

- 预测的残差项

- 共享伪影和预测残差项的组合

从这些可视化结果中,我们可以清晰地看到DVT如何有效地消除了特征图中的网格状伪影,使得特征表示更加清晰和语义一致。

DVT的潜在应用

DVT�的成功不仅仅局限于提升ViT在特定任务上的性能,它还揭示了ViT特征中潜在的一些有趣属性:

-

对象突出性:通过对去噪后特征进行PCA分析,研究人员发现第二主成分能很好地捕捉图像中主要对象的突出性。这一发现可能对无监督目标检测和分割任务有重要启示。

-

特征范数作为对象指示器:去噪后特征的L2范数被发现可以作为一个有效的对象指示器,这在原始ViT特征中并不明显。

-

改进的特征聚类:去噪后的特征在KMeans聚类时表现出更好的语义一致性,这对于无监督语义分割等任务可能有重要价值。

这些发现为ViT在更广泛的计算机视觉任务中的应用开辟了新的可能性。

结论与展望

Denoising Vision Transformers (DVT)为解决ViT特征图中的伪影问题提供了一个简单而有效的解决方案。通过消除这些伪影,DVT不仅显著提升了ViT在多个下游任务中的性能,还揭示了ViT特征中一些潜在的有趣属性。

这项研究工作提醒我们,尽管ViT在许多任务上取得了令人印象深刻的性能,但其内部表示仍然存在一些问题。DVT的成功也鼓励我们重新评估ViT的设计,特别是在位置编码的使用方面。

未来的研究方向可能包括:

- 探索DVT在更多视觉任务中的应用,如图像生成、视频理解等。

- 研究如何将DVT的思想整合到ViT的训练过程中,从源头上减少伪影的产生。

- 利用DVT揭示的ViT特征属性,开发新的无监督或自监督学习方法。

总的来说,DVT为提升ViT的性能和可解释性开辟了一个新的研究方向,有望推动计算机视觉领域的进一步发展。研究人员已经公开了DVT的代码和模型检查点,这将有助于更多研究者和开发者在此基础上进行进一步的探索和应用。

编辑推荐精选

AEE

AI Excel全自动制表工具

AEE 在线 AI 全自动 Excel 编辑器,提供智能录入、自动公式、数据整理、图表生成等功能,高效处理 Excel 任务,提升办公效率。支持自动高亮数据、批量计算、不规则数据录入,适用于企业、教育、金融等多场景。

UI-TARS-desktop

基于 UI-TARS 视觉语言模型的桌面应用,可通过自然语言控制计算机进行多模态操作。

UI-TARS-desktop 是一款功能强大的桌面应用,基于 UI-TARS(视觉语言模型)构建。它具备自然语言控制、截图与视觉识别、精确的鼠标键盘控制等功能,支持跨平台使用(Windows/MacOS),能提供实时反馈和状态显示,且数据完全本地处理,保障隐私安全。该应用集成了多种大语言模型和搜索方式,还可进行文件系统操作。适用于需要智能交互和自动化任务的场景,如信息检索、文件管理等。其提供了详细的文档,包括快速启动、部署、贡献指南和 SDK 使用说明等,方便开发者使用和扩展。

Wan2.1

开源且先进的大规模视频生成模型项目

Wan2.1 是一个开源且先进的大规模视频生成模型项目,支持文本到图像、文本到视频、图像到视频等多种生成任务。它具备丰富的配置选项,可调整分辨率、扩散步数等参数,还能对提示词进行增强。使用了多种先进技术和工具,在视频和图像生成领域具有广泛应用前景,适合研究人员和开发者使用。

爱图表

全流程 AI 驱动的数据可视化工具,助力用户轻松创作高颜值图表

爱图表(aitubiao.com)就是AI图表,是由镝数科技推出的一款创新型智能数据可视化平台,专注于为用户提供便捷的图表生成、数据分析和报告撰写服务。爱图表是中国首个在图表场景接入DeepSeek的产品。通过接入前沿的DeepSeek系列AI模型,爱图表结合强大的数据处理能力与智能化功能,致力于帮助职场人士高效处理和表达数据,提升工作效率和报告质量。

Qwen2.5-VL

一款强大的视觉语言模型,支持图像和视频输入

Qwen2.5-VL 是一款强大的视觉语言模型,支持图像和视频输入,可用于多种场景,如商品特点总结、图像文字识别等。项目提供了 OpenAI API 服务、Web UI 示例等部署方式,还包含了视觉处理工具,有助于开发者快速集成和使用,提升工作效率。

HunyuanVideo

HunyuanVideo 是一个可基于文本生成高质量图像和视频的项目。

HunyuanVideo 是一个专注于文本到图像及视频生成的项目。它具备强大的视频生成能力,支持多种分辨率和视频长度选择,能根据用户输入的文本生成逼真的图像和视频。使用先进的技术架构和算法,可灵活调整生成参数,满足不同场景的需求,是文本生成图像视频领域的优质工具。

WebUI for Browser Use

一个基于 Gradio 构建的 WebUI,支持与浏览器智能体进行便捷交互。

WebUI for Browser Use 是一个强大的项目,它集成了多种大型语言模型,支持自定义浏览器使用,具备持久化浏览器会话等功能。用户可以通过简洁友好的界面轻松控制浏览器智能体完成各类任务,无论是数据提取、网页导航还是表单填写等操作都能高效实现,有利于提高工作效率和获取信息的便捷性。该项目适合开发者、研究人员以及需要自动化浏览器操作的人群使用,在 SEO 优化方面,其关键词涵盖浏览器使用、WebUI、大型语言模型集成等,有助于提高网页在搜索引擎中的曝光度。

xiaozhi-esp32

基于 ESP32 的小智 AI 开发项目,支持多种网络连接与协议,实现语音交互等功能。

xiaozhi-esp32 是一个极具创新性的基于 ESP32 的开发项目,专注于人工智能语音交互领域。项目涵盖了丰富的功能,如网络连接、OTA 升级、设备激活等,同时支持多种语言。无论是开发爱好者还是专业开发者,都能借助该项目快速搭建起高效的 AI 语音交互系统,为智能设备开发提供强大助力。

olmocr

一个用于 OCR 的项目,支持多种模型和服务器进行 PDF 到 Markdown 的转换,并提供测试和报告功能。

olmocr 是一个专注于光学字符识别(OCR)的 Python 项目,由 Allen Institute for Artificial Intelligence 开发。它支持多种模型和服务器,如 vllm、sglang、OpenAI 等,可将 PDF 文件的页面转换为 Markdown 格式。项目还提供了测试框架和 HTML 报告生成功能,方便用户对 OCR 结果进行评估和分析。适用于科研、文档处理等领域,有助于提高工作效率和准确性。

飞书多维表格

飞书多维表格 ×DeepSeek R1 满血版

飞书多维表格联合 DeepSeek R1 模型,提供 AI 自动化解决方案,支持批量写作、数据分析、跨模态处理等功能,适用于电商、短视频、影视创作等场景,提升企业生产力与创作效率。关键词:飞书多维表格、DeepSeek R1、AI 自动化、批量处理、企业协同工具。

推荐工具��精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号