大型语言模型微调技术全解析:从理论到实践

在人工智能和自然语言处理领域,大型语言模型(Large Language Models, LLMs)的出现无疑是一场革命。这些模型通过在海量文本数据上进行预训练,展现出了惊人的语言理解和生成能力。然而,为了让这些通用模型更好地适应特定领域或任务,微调(Fine-tuning)技术应运而生。本文将全面介绍LLM微调的概念、方法、工具和最佳实践,帮助读者深入理解这一关键技术。

什么是LLM微调?

LLM微调是指在预训练模型的基础上,使用特定领域或任务的数据集进行额外的训练,以提高模型在目标任务上的表现。微调的核心思想是利用预训练模型已经学到的通用语言知识,通过少量的针对性训练,快速适应新的应用场景。

微调的主要优势包括:

- 提高模型在特定任务上的性能

- 减少训练时间和计算资源需求

- 实现更精确和上下文相关的结果

- 适应新的领域知识和语言风格

LLM微调的主要方法

目前,LLM微调主要有以下几种方法:

-

全参数微调(Full Fine-tuning):

这种方法会更新模型的所有参数。虽然效果最好,但需要大量的计算资源和存储空间。 -

参数高效微调(Parameter-Efficient Fine-tuning, PEFT):

PEFT方法只更新部分参数,大大减少了计算和存储需求。常见的PEFT方法包括:- LoRA (Low-Rank Adaptation): 通过添加低秩矩阵来调整模型权重

- Prefix Tuning: 在输入序列前添加可训练的前缀

- Prompt Tuning: 优化连续的提示向量

-

指令微调(Instruction Fine-tuning):

通过设计特定格式的指令-输出对来训练模型,提高模型对指令的理解和执行能力。 -

量化微调(Quantized Fine-tuning):

在量化后的模型上进行微调,如QLoRA (Quantized LoRA),进一步降低资源需求。

LLM微调的工具和框架

为了简化微调过程,多个开源项目和框架应运而生:

-

Hugging Face Transformers: 提供了丰富的预训练模型和微调工具,支持多种微调方法。

-

OpenAI Fine-tuning API: 允许用户使用自己的数据集对GPT模型进行微调。

-

DeepSpeed: 微软开发的深度学习优化库,支持大规模模型训练和微调。

-

PEFT: Hugging Face开发的参数高效微调库,实现了多种PEFT方法。

-

LangChain: 提供了一套工具链,简化了LLM的应用开发和微调过程。

LLM微调的最佳实践

要成功微调LLM,需要注意以下几点:

-

数据质量至关重要: 确保微调数据集的质量和相关性,数据清洗和预处理是必要的步骤。

-

选择合适的基础模型: 根据任务需求和资源限制选择适当大小和架构的预训练模型。

-

超参数调优: 学习率、批次大小等超参数对微调效果有显著影响,需要仔细调整。

-

避免过拟合: 使用早停、正则化等技术防止模型在小数据集上过拟合。

-

评估和迭代: 持续评估模型性能,并根据反馈进行迭代优化。

-

考虑伦理和偏见: 注意微调过程中可能引入的偏见,确保模型输出符合伦理标准。

实践案例:使用QLoRA微调Phi-2模型

下面,我们将通过一个具体的例子,展示如何使用QLoRA方法微调Microsoft的Phi-2模型。Phi-2是一个相对较小但性能优秀的语言模型,非常适合用于微调实验。

首先,我们需要安装必要的库:

!pip install -q -U bitsandbytes transformers peft accelerate datasets scipy einops evaluate trl rouge_score

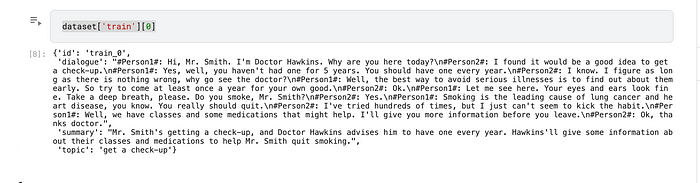

然后,我们加载数据集和预训练模型:

from datasets import load_dataset

from transformers import AutoModelForCausalLM, AutoTokenizer, BitsAndBytesConfig

# 加载数据集

dataset = load_dataset("neil-code/dialogsum-test")

# 配置量化参数

bnb_config = BitsAndBytesConfig(

load_in_4bit=True,

bnb_4bit_quant_type='nf4',

bnb_4bit_compute_dtype=torch.float16,

bnb_4bit_use_double_quant=False,

)

# 加载预训练模型

model_name = 'microsoft/phi-2'

model = AutoModelForCausalLM.from_pretrained(model_name,

device_map='auto',

quantization_config=bnb_config,

trust_remote_code=True,

use_auth_token=True)

tokenizer = AutoTokenizer.from_pretrained(model_name, trust_remote_code=True)

接下来,我们设置LoRA配置并准备模型:

from peft import LoraConfig, get_peft_model, prepare_model_for_kbit_training

config = LoraConfig(

r=32,

lora_alpha=32,

target_modules=[

'q_proj',

'k_proj',

'v_proj',

'dense'

],

bias="none",

lora_dropout=0.05,

task_type="CAUSAL_LM",

)

model = prepare_model_for_kbit_training(model)

peft_model = get_peft_model(model, config)

然后,我们定义训练参数并开始微调:

from transformers import TrainingArguments, Trainer

training_args = TrainingArguments(

output_dir="./peft-phi2-dialogue-summary",

learning_rate=2e-4,

per_device_train_batch_size=4,

gradient_accumulation_steps=4,

max_steps=1000,

warmup_steps=100,

logging_steps=10,

save_steps=100,

evaluation_strategy="steps",

eval_steps=100,

)

trainer = Trainer(

model=peft_model,

args=training_args,

train_dataset=dataset["train"],

eval_dataset=dataset["validation"],

data_collator=transformers.DataCollatorForLanguageModeling(tokenizer, mlm=False),

)

trainer.train()

微调完成后,我们可以保存模型并进行推理:

peft_model.save_pretrained("./peft-phi2-dialogue-summary")

# 加载微调后的模型

from peft import PeftModel

base_model = AutoModelForCausalLM.from_pretrained(model_name,

device_map='auto',

quantization_config=bnb_config,

trust_remote_code=True)

ft_model = PeftModel.from_pretrained(base_model, "./peft-phi2-dialogue-summary")

# 进行推理

prompt = "Summarize the following conversation:\n[conversation text]\nSummary:"

inputs = tokenizer(prompt, return_tensors="pt").to("cuda")

outputs = ft_model.generate(**inputs, max_new_tokens=100)

print(tokenizer.decode(outputs[0], skip_special_tokens=True))

通过这个例子,我们展示了如何使用QLoRA方法对Phi-2模型进行微调,并用于对话摘要任务。这种方法大大降低了资源需求,使得在普通GPU上也能进行LLM微调成为可能。

结语

LLM微调技术为AI应用开发者提供了强大的工具,使得定制化大型语言模型变得更加容易。随着技术的不断发展,我们相信会有更多创新的微调方法和工具出现,进一步降低门槛,提高效率。然而,在享受技术红利的同时,我们也需要警惕可能带来的伦理风险,确保AI的发展始终朝着有益于人类的方向前进。

未来,LLM微调技术可能会朝着以下方向发展:

- 更高效的参数更新方法

- 跨模态微调技术的成熟

- 自动化微调流程

- 更好的知识整合和遗忘防护机制

无论如何,LLM微调技术的发展必将为AI应用带来更多可能性,推动整个行业向前发展。让我们共同期待AI技术的美好未来!