GaussianFlow: 利用高斯动态塑造4D世界的未来

在计算机图形学和计算机视觉领域,4D内容创建一直是一个充满挑战性的研究方向。传统方法往往受限于训练和渲染速度慢、动态场景处理能力弱等问题。近日,来自南加州大学、谷歌等机构的研究人员提出了一种名为GaussianFlow的创新方法,为4D内容创建带来了突破性进展。

GaussianFlow的核心理念

GaussianFlow的核心思想是将3D高斯动态投射到2D平面上,从而创建密集的2D运动流。这种方法巧妙地将3D高斯点的动态与连续帧之间的像素速度联系起来,使得直接对高斯动态进行监督成为可能。

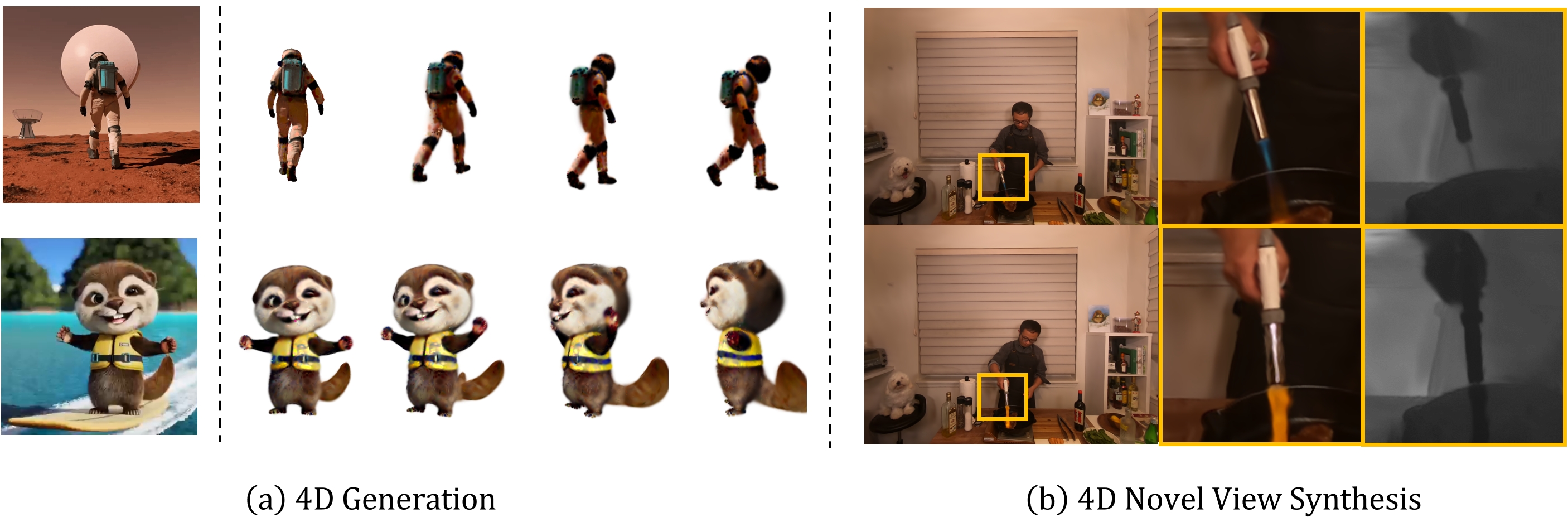

如上图所示,GaussianFlow能够基于单目视频生成高质量的4D高斯散射场,不仅能表现出优秀的外观和几何特征,还能捕捉到自然流畅的运动。即使在高度动态的区域,GaussianFlow也能保持稳定的效果,避免了其他方法常见的不理想伪影。

技术创新与优势

- 高效的动态建模

GaussianFlow采用了一种新颖的可微分过程,通过将高斯动态投影到图像空间,实现了对光流的直接动态监督。这种方法大大提高了4D动态内容生成和4D新视角合成的效果,特别是在处理复杂运动场景时表现出色。

- 解决颜色漂移问题

在4D生成任务中,颜色漂移一直是一个棘手的问题。GaussianFlow通过改进的高斯动态建模成功解决了这一问题,保证了生成内容的颜色稳定性。

- 超快的训练和渲染速度

相比于每帧单独训练3D高斯散射(3DGS)模型的方法,GaussianFlow实现了5倍以上的训练速度提升。同时,其渲染速度也与专为静态3D重建设计的原始3DGS相当。

应用场景与潜力

GaussianFlow的应用前景十分广阔,可以在以下领域发挥重要作用:

- 电影特效与游戏开发

高质量、高效率的4D内容创建对电影特效和游戏开发至关重要。GaussianFlow能够快速生成逼真的动态场景,为创作者提供了强大的工具。

- 虚拟现实(VR)和增强现实(AR)

在VR和AR应用中,实时渲染高质量的动态3D内容是一大挑战。GaussianFlow的高效渲染特性使其非常适合这类应用场景。

- 机器人视觉与自动驾驶

对于需要实时理解和预测动态环境的机器人视觉和自动驾驶系统,GaussianFlow提供的高效4D场景重建能力将大有裨益。

- 医学成像

在医学成像领域,GaussianFlow可用于构建更精确的4D人体器官模型,辅助诊断和手术规划。

技术细节与实现

GaussianFlow的实现涉及多个关键步骤:

- 高斯流计算

研究团队提供了一段示例代码,展示了如何利用CUDA实现高斯流的计算:

# 高斯参数计算(t_1时刻)

proj_2D_t_1 = render_t_1["proj_2D"]

gs_per_pixel = render_t_1["gs_per_pixel"].long()

weight_per_gs_pixel = render_t_1["weight_per_gs_pixel"]

x_mu = render_t_1["x_mu"]

cov2D_inv_t_1 = render_t_1["conic_2D"].detach()

# 高斯参数计算(t_2时刻)

proj_2D_t_2 = render_t_2["proj_2D"]

cov2D_inv_t_2 = render_t_2["conic_2D"]

cov2D_t_2 = render_t_2["conic_2D_inv"]

# 矩阵运算

cov2D_t_2_mtx = torch.zeros([cov2D_t_2.shape[0], 2, 2]).cuda()

cov2D_t_2_mtx[:, 0, 0] = cov2D_t_2[:, 0]

cov2D_t_2_mtx[:, 0, 1] = cov2D_t_2[:, 1]

cov2D_t_2_mtx[:, 1, 0] = cov2D_t_2[:, 1]

cov2D_t_2_mtx[:, 1, 1] = cov2D_t_2[:, 2]

# ... (省略部分代码)

# 高斯流的完整公式

cov_multi = (B_t_2_B_inv_t_1[gs_per_pixel] @ x_mu.permute(0,2,3,1).unsqueeze(-1).detach()).squeeze()

predicted_flow_by_gs = (cov_multi + proj_2D_next[gs_per_pixel] - proj_2D[gs_per_pixel].detach() - x_mu.permute(0,2,3,1).detach()) * weights.detach()

# 流监督损失

large_motion_msk = torch.norm(optical_flow, p=2, dim=-1) >= flow_thresh

Lflow = torch.norm((optical_flow - predicted_flow_by_gs.sum(0))[large_motion_msk], p=2, dim=-1).mean()

loss = loss + flow_weight * Lflow

这段代码展示了GaussianFlow如何通过矩阵运算实现高斯动态的投射,并计算出预测的光流。通过与真实光流的比较,可以得到用于优化模型的损失函数。

- 双域变形模型(DDDM)

GaussianFlow引入了一种新颖的双域变形模型(Dual-Domain Deformation Model, DDDM),用于显式建模每个高斯点的属性变形。DDDM在时间域和频率域分别使用多项式拟合和傅里叶级数拟合来捕捉属性的时变残差。这种方法能够有效地模拟长视频片段中的复杂场景变形。

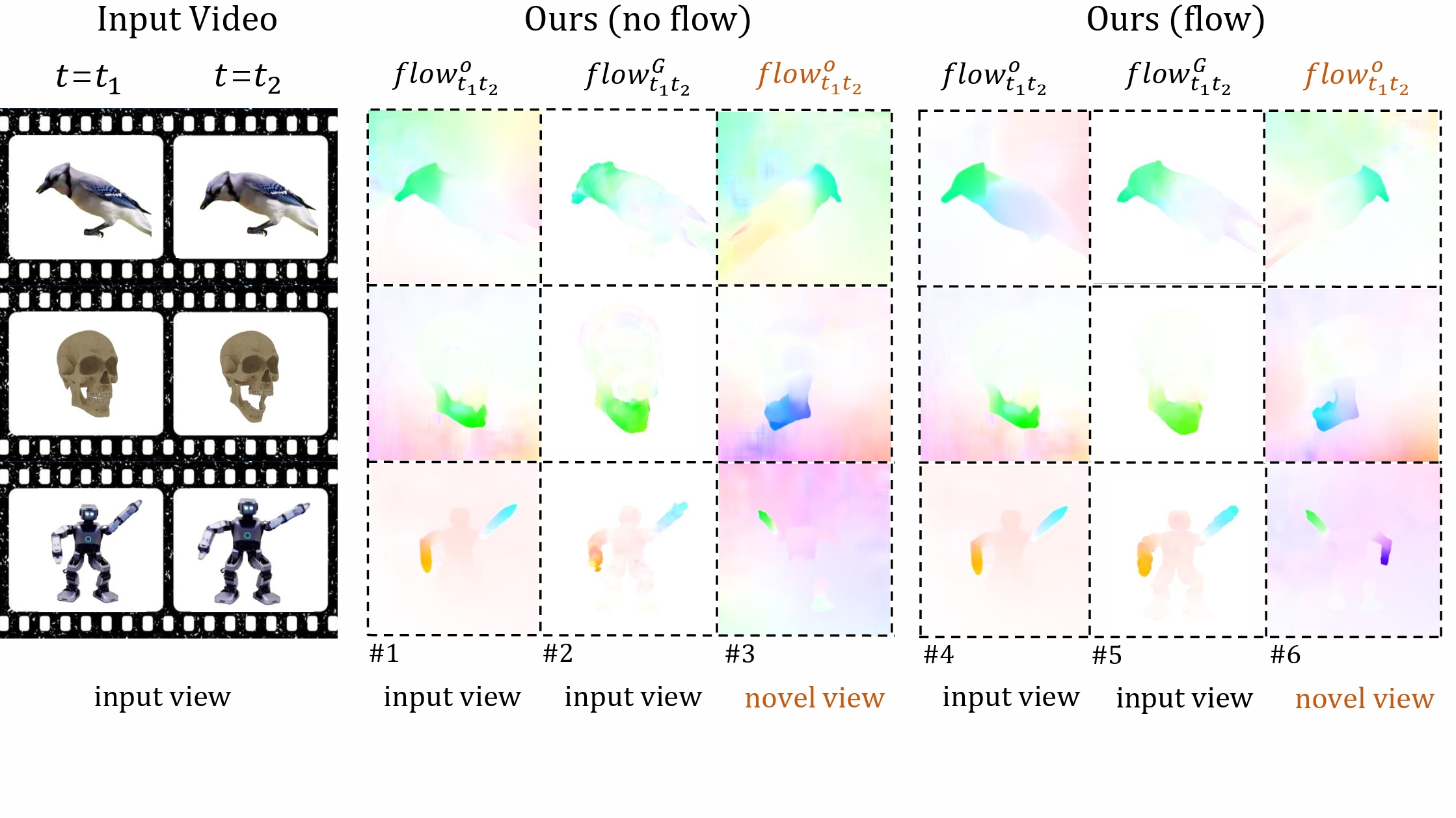

上图展示了GaussianFlow在输入视图和新视角下的光流和高斯流可视化结果。可以看出,与没有流监督的模型相比,GaussianFlow生成的运动更加一致和自然。

实验结果与性能评估

研究团队在多个数据集上进行了广泛的实验,结果表明GaussianFlow在4D生成和4D新视角合成任务上均达到了最先进的水平。

- Consistent4D数据集上的质量评估

在Consistent4D数据集上,GaussianFlow展现出卓越的视觉质量和运动一致性。上图展示了在不同视角和时间点下生成的结果,可以看到无论是静态细节还是动态变化都得到了很好的重建。

- DyNeRF数据集上的性能

在DyNeRF数据集上,GaussianFlow相比其他方法(如RT-4DGS)表现出明显优势。尤其是在处理动态区域和时变高光效果时,GaussianFlow能够产生更加自然和连贯的结果。

未来展望与挑战

尽管GaussianFlow在4D内容创建领域取得了显著进展,但仍然存在一些有待解决的挑战和值得探索的方向:

-

大规模场景适应性:当前的方法在处理超大规模动态场景时可能面临计算资源和内存限制,如何进一步优化算法以适应更复杂的环境是一个重要课题。

-

实时性能提升:虽然GaussianFlow已经实现了快速的训练和渲染,但对于某些要求极高实时性的应用场景(如高帧率VR),还需要进一步的性能优化。

-

多模态融合:结合其他感知模态(如深度信息、热成像等)可能会进一步提升4D重建的质量和鲁棒性。

-

语义理解与编辑:在4D重建的基础上引入语义理解和编辑功能,将使得内容创作者能够更灵活地操控和修改生成的动态场景。

-

与生成式AI的结合:探索GaussianFlow与大型语言模型和扩散模型等生成式AI技术的结合,可能会开启更多创新的内容创作方式。

结语

GaussianFlow的出现无疑为4D内容创建领域注入了新的活力。它不仅在技术上实现了突破,还为众多应用场景提供了新的可能性。随着这项技术的不断发展和完善,我们有理由期待在不久的将来,更加逼真、流畅且富有交互性的4D内容会成为现实,为虚拟现实、增强现实、电影特效等领域带来革命性的变革。

研究团队已经将相关代码开源在GitHub上(https://github.com/Zerg-Overmind/GaussianFlow),这为学术界和工业界的进一步探索和应用提供了宝贵的资源。我们期待看到更多基于GaussianFlow的创新应用和改进方案,共同推动4D内容创建技术的不断进步。