ppl.llm.serving 简介

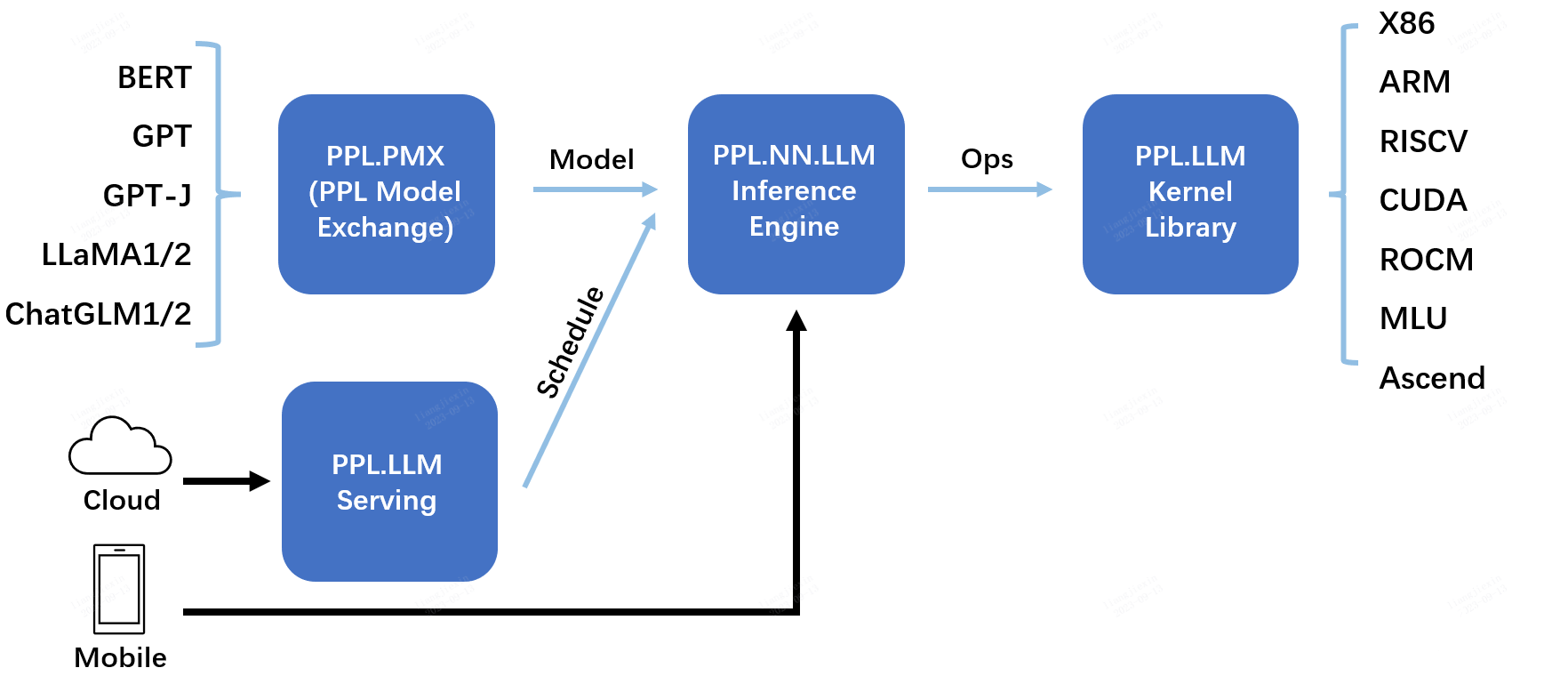

ppl.llm.serving 是 PPL.LLM 系统的重要组成部分,是一个基于 ppl.nn 的大语言模型推理服务框架。它为各种大型语言模型(LLMs)提供高性能的推理和服务能力,目前主要支持 LLaMA 模型。

ppl.llm.serving 的主要特点包括:

- 基于 gRPC 构建高性能服务

- 支持 LLaMA 等多种大语言模型

- 提供异步编码和异步解码,降低服务开销

- KV Cache 分配管理优化

- 调度优化,减少硬件满载时的不必要请求队列查询

系统要求

ppl.llm.serving 可以运行在 x86_64 或 arm64 架构的 Linux 系统上,主要依赖如下:

- GCC >= 9.4.0

- CMake >= 3.18

- Git >= 2.7.0

- CUDA Toolkit >= 11.4 (推荐 11.6,用于 CUDA 支持)

快速开始

以下是使用 ppl.llm.serving 的基本步骤:

- 安装依赖(以 Debian/Ubuntu 为例)

apt-get install build-essential cmake git

- 克隆源代码

git clone https://github.com/openppl-public/ppl.llm.serving.git

- 编译源码

./build.sh -DPPLNN_USE_LLM_CUDA=ON -DPPLNN_CUDA_ENABLE_NCCL=ON -DPPLNN_ENABLE_CUDA_JIT=OFF -DPPLNN_CUDA_ARCHITECTURES="'80;86;87'" -DPPLCOMMON_CUDA_ARCHITECTURES="'80;86;87'"

注意:如果使用多 GPU,需要启用 NCCL。

- 导出模型

请参考 ppl.pmx 的相关说明导出模型。

- 运行服务器

./ppl-build/ppl_llama_server /path/to/server/config.json

服务器配置示例可以在 src/models/llama/conf 目录下找到。运行服务器前,需要正确设置以下配置:

model_dir: ppl.pmx 导出的模型路径model_param_path: 模型参数文件路径,通常为$model_dir/params.jsontokenizer_path: sentencepiece tokenizer 文件路径

- 运行客户端

./ppl-build/client_sample 127.0.0.1:23333

客户端通过 gRPC 向服务器发送请求并获取模型推理结果。更多详细信息可以参考 tools/client_sample.cc。

性能测试

ppl.llm.serving 提供了性能测试工具:

./ppl-build/client_qps_measure --target=127.0.0.1:23333 --tokenizer=/path/to/tokenizer/path --dataset=tools/samples_1024.json --request_rate=inf

--request_rate 参数用于设置每秒请求数,设为 inf 表示以最快速度发送所有请求。更多信息请参考 tools/client_qps_measure.cc。

离线推理

ppl.llm.serving 也支持离线推理:

./ppl-build/offline_inference /path/to/server/config.json

详细信息请参考 tools/offline_inference.cc。

项目贡献

ppl.llm.serving 是一个开源项目,欢迎社区贡献。目前项目有 122 个星标和 13 个分支,主要使用 C++(93.2%)、CMake(6.6%) 和 Shell(0.2%) 开发。

如果您对项目感兴趣,可以通过以下方式参与:

总结

ppl.llm.serving 为大语言模型提供了高性能的推理服务框架。它不仅支持多种模型,还在性能优化方面做了大量工作。无论是构建生产级服务还是进行学术研究,ppl.llm.serving 都是一个值得考虑的选择。我们期待看到更多开发者和研究者加入到项目中来,共同推动大语言模型服务技术的发展。

🚀 如果您对大语言模型感兴趣,不妨尝试使用 ppl.llm.serving 来部署和服务您的模型。同时也欢迎为项目贡献代码,一起让这个强大的框架变得更好!