Huatuo-Llama-Med-Chinese 学习资料汇总 - 基于中文医学知识的大语言模型指令微调项目

Huatuo-Llama-Med-Chinese(本草)是由哈尔滨工业大学社会计算与信息检索研究中心健康智能组开发的基于中文医学知识的大语言模型指令微调项目。本文将为大家汇总该项目的相关学习资源,帮助读者快速了解和使用这个开源的中文医疗大语言模型。

1. 项目简介

Huatuo-Llama-Med-Chinese项目开源了经过中文医学指令精调/指令微调(Instruction-tuning)的大语言模型集,包括LLaMA、Alpaca-Chinese、Bloom、活字模型等。研究团队基于医学知识图谱以及医学文献,结合ChatGPT API构建了中文医学指令微调数据集,并以此对各种基模型进行了指令微调,提高了基模型在医疗领域的问答效果。

2. 代码仓库

项目的GitHub仓库地址为: https://github.com/SCIR-HI/Huatuo-Llama-Med-Chinese

在这里,你可以找到项目的全部源代码、使用说明、模型下载链接等资源。

3. 模型下载

项目提供了多个经过指令微调的LoRA权重文件,可以通过百度网盘或Hugging Face下载:

- 基于活字模型的LoRA权重: 百度网盘

- 基于Bloom模型的LoRA权重: 百度网盘 或 Hugging Face

- 基于Alpaca模型的LoRA权重: 百度网盘 或 Hugging Face

- 基于LLaMA模型的LoRA权重: 百度网盘 或 Hugging Face

4. 使用教程

项目提供了详细的使用教程,包括环境配置、模型推理和微调等步骤:

- 安装依赖:

pip install -r requirements.txt

- 模型推理:

bash ./scripts/infer.sh

- 模型微调:

bash ./scripts/finetune.sh

更多详细信息请参考项目README文件。

5. 相关论文

项目团队发布了多篇相关论文,可以帮助读者深入了解模型原理:

- Huatuo: Tuning LLaMA Model with Chinese Medical Knowledge

- Knowledge-tuning Large Language Models with Structured Medical Knowledge Bases for Reliable Response Generation in Chinese

- The CALLA Dataset: Probing LLMs' Interactive Knowledge Acquisition from Chinese Medical Literature

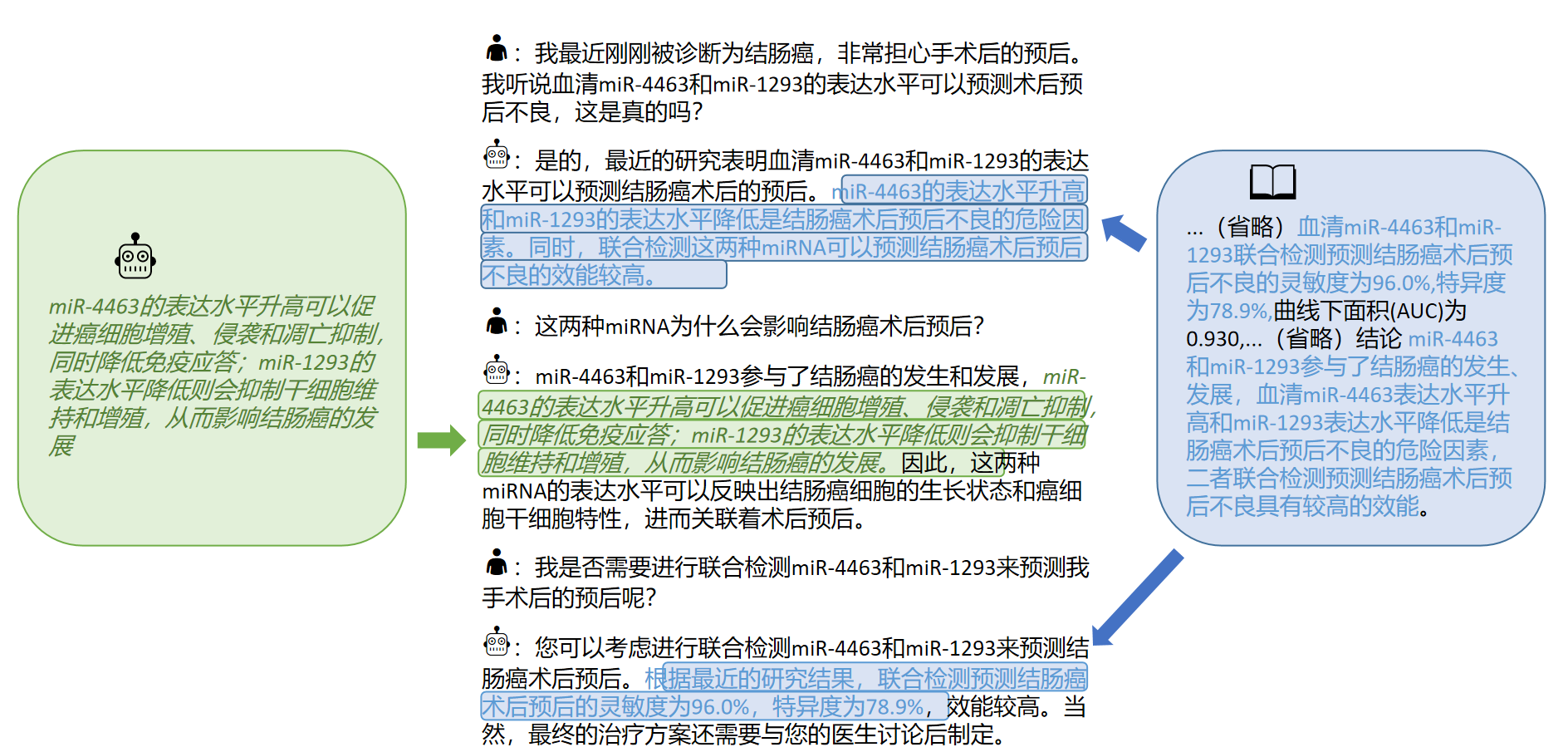

6. 项目展示

以下是模型效果展示:

7. 常见问题

项目README中提供了一个常见问题解答环节,涵盖了模型命名、中医数据使用、运行问题等方面,建议读者仔细阅读。

8. 免责声明

请注意,本项目相关资源仅供学术研究之用,严禁用于商业用途。模型输出不能作为实际医学诊断的依据。使用时请严格遵守相关开源协议。

通过以上资料,相信读者可以快速了解Huatuo-Llama-Med-Chinese项目,并开始使用这个开源的中文医疗大语言模型。如有更多问题,欢迎查阅项目GitHub仓库或联系项目维护者。