interpret学习资料汇总 - 解释机器学习模型的开源工具包

interpret是一个用于解释机器学习模型的开源工具包,由微软研究院开发。它集成了多种最先进的模型解释技术,可以帮助数据科学家更好地理解和解释机器学习模型的行为。无论是解释黑盒模型还是训练可解释的白盒模型,interpret都提供了丰富的功能支持。本文将介绍interpret的相关学习资源,帮助读者快速上手这个强大的工具。

官方资源

- GitHub仓库 - 项目源码和文档

- 官方文档 - 详细的API文档和使用教程

- 示例notebooks - 包含多个使用案例的Jupyter notebooks

入门教程

- InterpretML快速入门 - 介绍基本概念和用法的入门文章

- 使用InterpretML解释模型 - 详细讲解如何使用InterpretML解释不同类型的模型

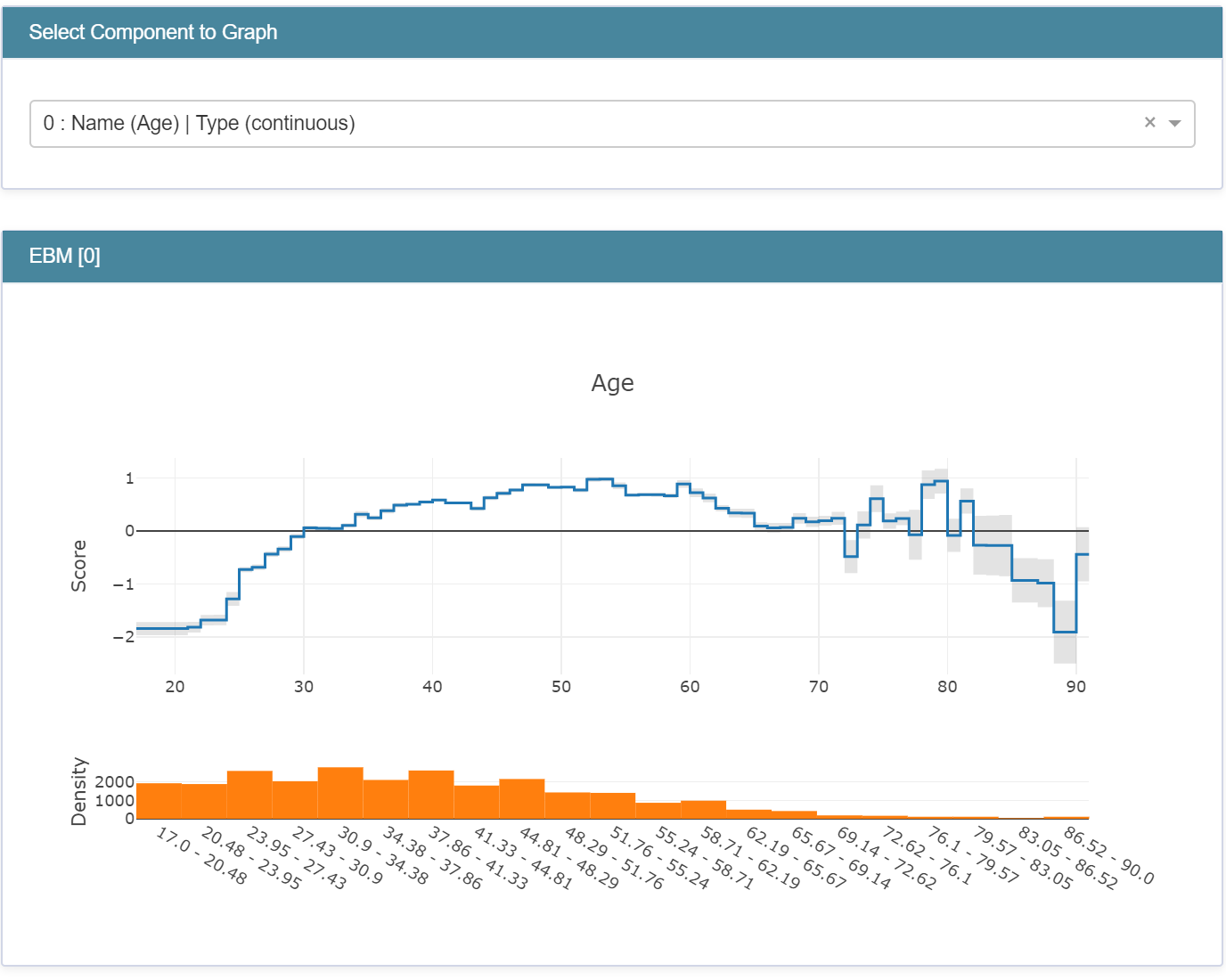

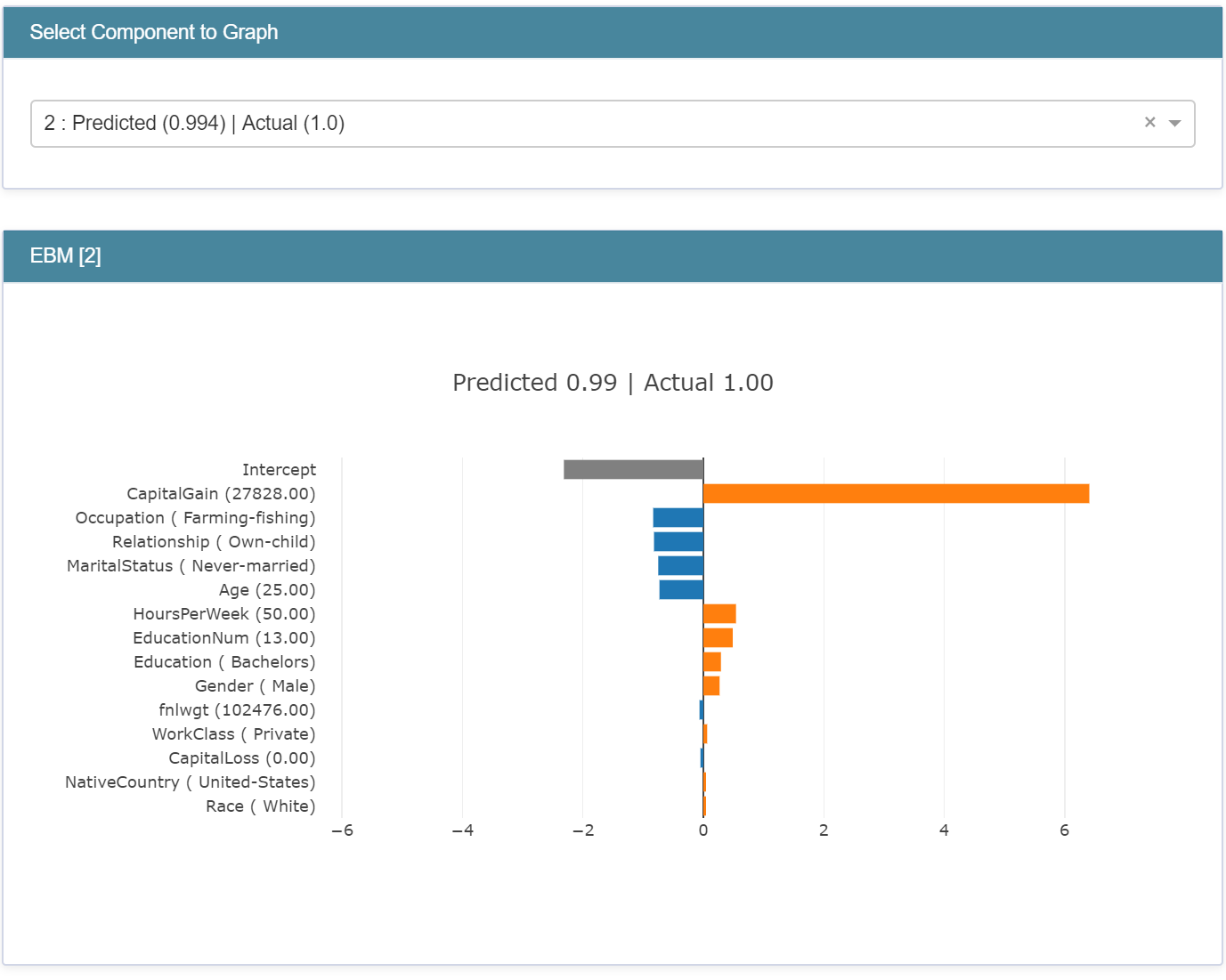

- Explainable Boosting Machine介绍 - 深入介绍EBM模型的原理和优势

视频教程

学术论文

- InterpretML: A Unified Framework for Machine Learning Interpretability - 介绍InterpretML框架的论文

- Intelligible models for healthcare - EBM模型的原始论文

- Accuracy, Interpretability, and Differential Privacy via Explainable Boosting - 介绍差分隐私EBM的论文

应用案例

interpret为模型解释提供了强大而灵活的工具,希望这些学习资源可以帮助读者快速掌握它的使用方法,在实际项目中应用模型解释技术。对于想深入了解背后原理的读者,建议阅读相关的学术论文;对于希望快速上手的读者,可以先跟着教程和示例动手实践。无论是哪种需求,interpret都提供了丰富的资源支持。

通过使用interpret,我们可以更好地理解模型的决策过程,提高模型的可解释性和可信度。在对模型理解至关重要的领域,如医疗、金融等,interpret无疑是一个非常有价值的工具。希望这篇资料汇总能够帮助更多人了解和使用interpret,共同推动可解释机器学习的发展。