Autograd简介:高效自动微分库

Autograd是一个强大而灵活的自动微分库,专为Python和NumPy代码设计。它可以自动计算复杂函数的导数,极大地简化了机器学习和优化算法的实现。本文将详细介绍Autograd的主要特性、使用方法以及在实际应用中的优势。

Autograd的主要特性

-

自动微分 Autograd的核心功能是自动计算函数的导数。它可以处理各种Python语言特性,如循环、条件语句、递归和闭包等,甚至可以计算高阶导数。这使得复杂函数的梯度计算变得简单直观。

-

支持反向模式和前向模式 Autograd同时支持反向模式(反向传播)和前向模式微分。反向模式适用于计算标量值函数对多维数组参数的梯度,而前向模式则适用于计算向量值函数的雅可比矩阵。两种模式可以任意组合使用。

-

NumPy兼容性 Autograd提供了一个与NumPy几乎完全兼容的接口。用户可以直接使用

autograd.numpy模块,其用法与标准NumPy几乎相同,但支持自动微分。 -

高效性能 尽管提供了自动微分功能,Autograd仍然保持了较高的计算效率。它通过动态构建计算图和优化的反向传播算法,实现了高效的梯度计算。

Autograd的基本使用

使用Autograd进行自动微分非常简单。以下是一个基本的示例:

import autograd.numpy as np

from autograd import grad

def tanh(x):

return (1.0 - np.exp(-2 * x)) / (1.0 + np.exp(-2 * x))

grad_tanh = grad(tanh)

print(grad_tanh(1.0))

在这个例子中,我们定义了tanh函数,然后使用grad函数获取其导数。grad_tanh是一个新的函数,它计算tanh在任意点的导数值。

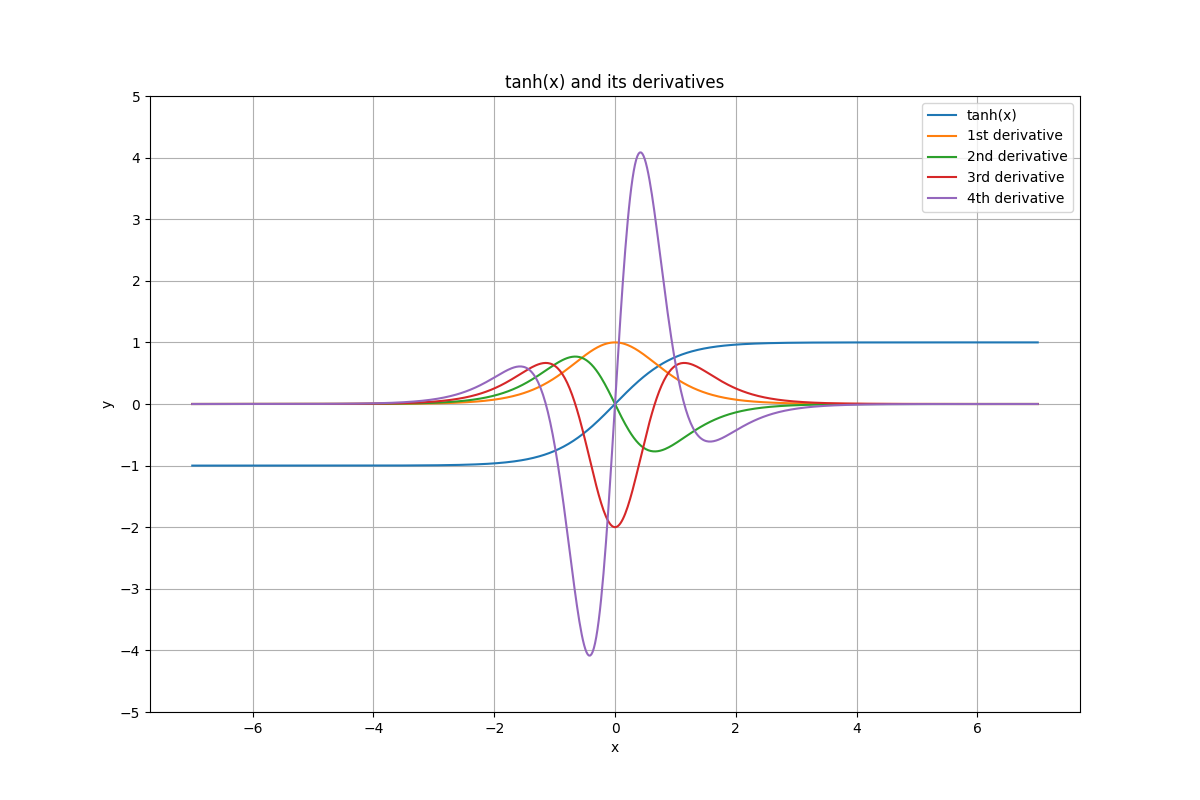

高阶导数和向量化

Autograd支持计算任意阶的导数,并且可以轻松地对向量化函数进行微分:

from autograd import elementwise_grad as egrad

import matplotlib.pyplot as plt

x = np.linspace(-7, 7, 200)

plt.plot(x, tanh(x),

x, egrad(tanh)(x), # 一阶导数

x, egrad(egrad(tanh))(x), # 二阶导数

x, egrad(egrad(egrad(tanh)))(x)) # 三阶导数

plt.show()

这段代码展示了如何计算和可视化tanh函数及其高阶导数。

Autograd在机器学习中的应用

Autograd在机器学习和深度学习领域有广泛的应用:

-

神经网络训练 Autograd可以自动计算复杂神经网络模型的梯度,大大简化了反向传播算法的实现。

-

优化算法 在实现各种优化算法(如梯度下降、Adam等)时,Autograd可以自动处理梯度计算,使得算法实现更加简洁。

-

自定义损失函数 研究人员可以轻松定义和实验各种自定义损失函数,而无需手动推导复杂的梯度表达式。

-

模型调试 Autograd的自动微分功能使得检查模型梯度和调试变得更加容易。

Autograd与其他框架的比较

与TensorFlow或PyTorch等大型深度学习框架相比,Autograd更加轻量级和灵活。它专注于提供高效的自动微分功能,而不包含完整的深度学习生态系统。这使得Autograd特别适合以下场景:

- 教育和学习:Autograd的简洁性使其成为学习自动微分原理的理想工具。

- 研究实验:研究人员可以快速实现和测试新的算法思想。

- 小型项目:对于不需要大型框架全部功能的小型项目,Autograd提供了一个轻量级的选择。

高级功能和优化

Autograd还提供了一些高级功能和优化技巧:

-

矢量-雅可比积(Vector-Jacobian Products) Autograd支持高效计算矢量-雅可比积,这在某些优化问题中非常有用。

-

计算图优化 Autograd会自动优化计算图,以提高梯度计算的效率。

-

自定义梯度 用户可以为特定操作定义自定义梯度,这在实现某些数值稳定性技巧时非常有用。

安装和使用建议

安装Autograd非常简单,可以通过pip直接安装:

pip install autograd

对于需要使用SciPy功能的用户,可以安装带有SciPy支持的版本:

pip install "autograd[scipy]"

在使用Autograd时,建议遵循以下最佳实践:

- 尽量使用

autograd.numpy而不是标准NumPy,以确保所有操作都支持自动微分。 - 对于复杂的模型,考虑使用Autograd的

value_and_grad函数同时计算函数值和梯度,以提高效率。 - 在处理大规模数据时,注意内存使用,可能需要进行分批处理。

结论

Autograd是一个强大而灵活的自动微分库,它极大地简化了梯度计算和优化算法的实现。无论是在教育、研究还是实际项目中,Autograd都提供了一个简洁而高效的解决方案。随着机器学习和优化算法的不断发展,Autograd这样的工具将继续发挥重要作用,推动技术创新和进步。

通过深入了解和掌握Autograd,开发者和研究人员可以更加专注于算法设计和模型创新,而不必被繁琐的导数计算所困扰。无论您是机器学习新手还是经验丰富的专家,Autograd都是一个值得探索和使用的强大工具。