LangServe与Ollama:本地部署和使用开源大语言模型

在人工智能和自然语言处理领域,大语言模型(LLM)的应用日益广泛。然而,使用商业API服务往往成本高昂,且存在数据隐私问题。本文将介绍如何利用LangServe和Ollama在本地部署和使用开源大语言模型,让您能够以更低成本、更灵活的方式构建AI应用。

LangServe与Ollama简介

LangServe是LangChain提供的一个部署工具,可以轻松地将LangChain应用部署为API服务。Ollama则是一个强大的工具,能够在本地运行各种开源大语言模型。两者结合,为开发者提供了一个便捷的本地LLM解决方案。

步骤1: 准备模型文件

首先,我们需要从Hugging Face下载所需的模型文件。以EEVE-Korean-Instruct-10.8B模型为例:

pip install huggingface-hub

huggingface-cli download \

heegyu/EEVE-Korean-Instruct-10.8B-v1.0-GGUF \

ggml-model-Q5_K_M.gguf \

--local-dir 您的下载目录 \

--local-dir-use-symlinks False

步骤2: 配置Ollama

下载完模型文件后,需要为Ollama创建一个Modelfile:

FROM ggml-model-Q5_K_M.gguf

TEMPLATE """{{- if .System }}

<s>{{ .System }}</s>

{{- end }}

<s>Human:

{{ .Prompt }}</s>

<s>Assistant:

"""

SYSTEM """A chat between a curious user and an artificial intelligence assistant. The assistant gives helpful, detailed, and polite answers to the user's questions."""

PARAMETER stop <s>

PARAMETER stop </s>

然后使用以下命令创建Ollama模型:

ollama create EEVE-Korean-10.8B -f EEVE-Korean-Instruct-10.8B-v1.0-GGUF/Modelfile

步骤3: 集成LangServe

接下来,我们使用LangServe创建一个API服务。以下是一个简单的示例代码:

from fastapi import FastAPI

from langchain.llms import Ollama

from langchain.prompts import PromptTemplate

from langserve import add_routes

app = FastAPI(title="LangChain Server")

llm = Ollama(model="EEVE-Korean-10.8B")

prompt = PromptTemplate.from_template("请回答以下问题: {question}")

chain = prompt | llm

add_routes(app, chain, path="/qa")

if __name__ == "__main__":

import uvicorn

uvicorn.run(app, host="localhost", port=8000)

运行这段代码,就可以启动一个本地的LLM API服务。

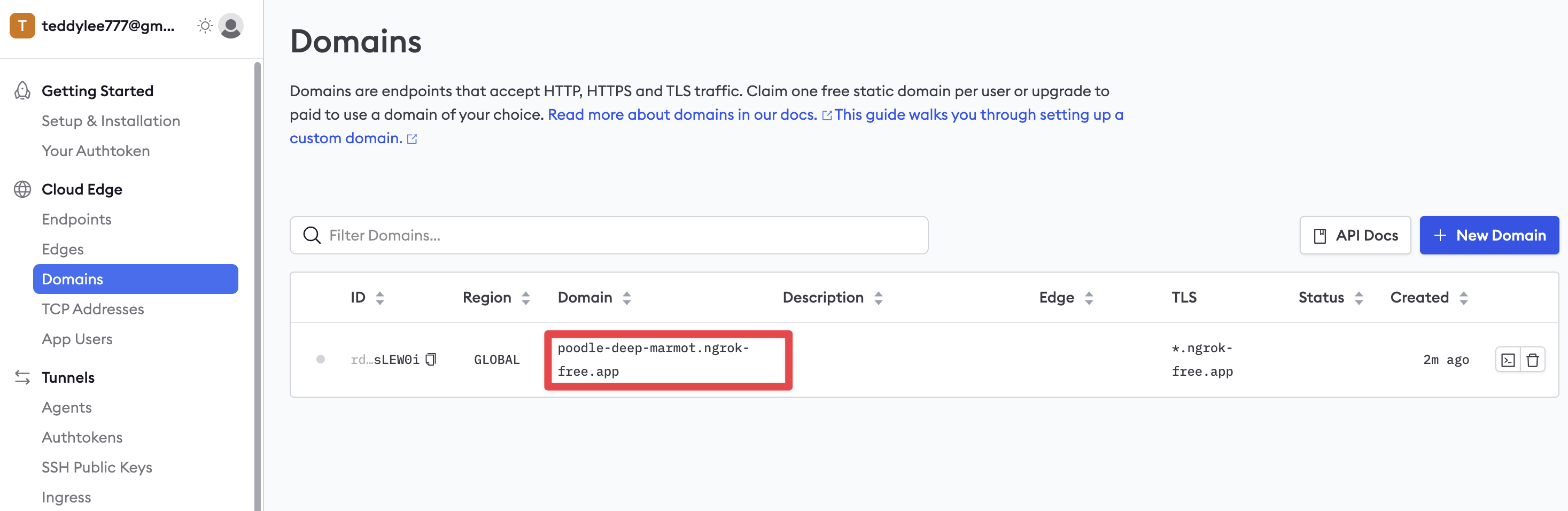

步骤4: 使用ngrok进行端口转发

如果您希望外部能够访问您的API服务,可以使用ngrok进行端口转发:

ngrok http localhost:8000

高级应用: 实现RAG系统

结合LangServe和Ollama,我们还可以轻松实现一个检索增强生成(RAG)系统。以下是一个简单的示例:

from langchain.vectorstores import Chroma

from langchain.embeddings import HuggingFaceEmbeddings

from langchain.text_splitter import CharacterTextSplitter

from langchain.chains import RetrievalQA

# 准备文档

with open("your_document.txt", "r") as f:

raw_text = f.read()

text_splitter = CharacterTextSplitter(chunk_size=1000, chunk_overlap=0)

texts = text_splitter.split_text(raw_text)

# 创建向量存储

embeddings = HuggingFaceEmbeddings()

docsearch = Chroma.from_texts(texts, embeddings)

# 创建RAG链

qa = RetrievalQA.from_chain_type(llm=llm, chain_type="stuff", retriever=docsearch.as_retriever())

# 添加到LangServe路由

add_routes(app, qa, path="/rag")

这个例子展示了如何创建一个基本的RAG系统,它能够根据用户的问题从预先准备的文档中检索相关信息,然后生成回答。

性能监控

在使用本地LLM时,监控系统性能非常重要。您可以使用asitop工具来监控GPU使用情况:

pip install asitop

asitop

结语

通过LangServe和Ollama,我们可以轻松地在本地部署和使用开源大语言模型。这不仅可以降低成本,还能保护数据隐私,同时为开发者提供了更大的灵活性和可控性。随着开源LLM的不断发展,这种本地部署方案将为AI应用开发带来更多可能性。

无论您是开发聊天机器人、问答系统,还是更复杂的AI应用,LangServe和Ollama都能为您提供强大的支持。希望本文能够帮助您开启本地LLM应用的开发之旅。