LibMTL:多任务学习的强大助手

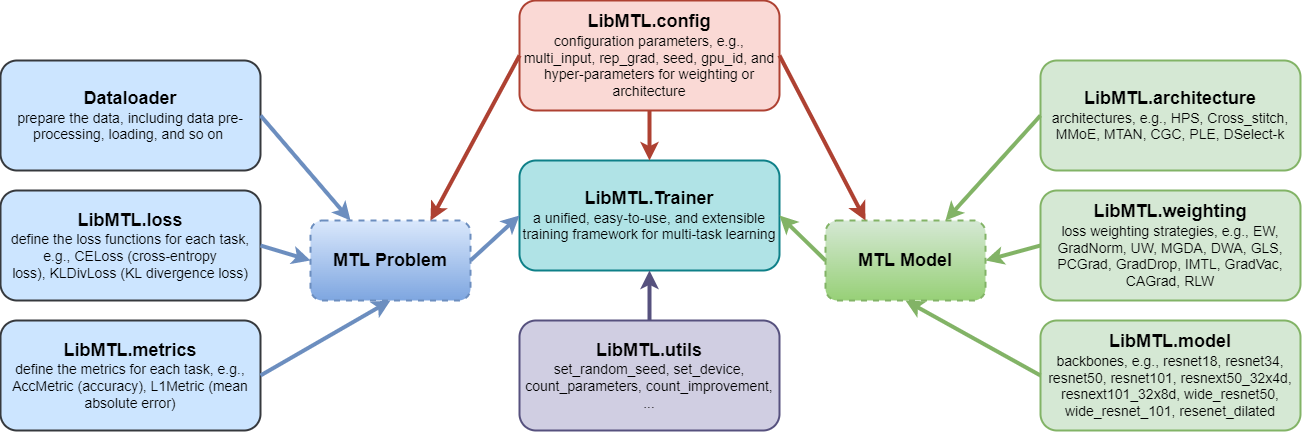

在当今机器学习领域,同时学习多个相关任务已成为一种重要的研究方向。多任务学习(Multi-Task Learning, MTL)通过利用任务间的共享信息,不仅可以提高模型的整体性能,还能节省计算资源。然而,如何有效地实现多任务学习一直是一个具有挑战性的问题。为了解决这一难题,研究人员开发了LibMTL这一强大的Python库,为多任务学习提供了一个统一且全面的实现框架。

LibMTL的特色与优势

LibMTL是一个基于PyTorch构建的开源库,专门用于多任务学习。它具有以下几个突出特点:

-

统一性:LibMTL提供了一个统一的代码库,实现了包括数据处理、评估指标和超参数在内的一致性评估程序。这使得研究人员能够对不同的多任务学习算法进行定量、公平和一致的比较。

-

全面性:该库支持多种最先进的多任务学习方法,包括16种优化策略和8种架构。同时,LibMTL还提供了几个覆盖不同领域的基准数据集,为算法的公平比较提供了基础。

-

可扩展性:LibMTL遵循模块化设计原则,允许用户灵活便捷地添加自定义组件或进行个性化修改。这使得用户可以轻松快速地开发新的优化策略和架构,或将现有的多任务学习算法应用到新的应用场景中。

强大的算法支持

LibMTL目前支持多种优化策略和架构,以下是部分支持的算法:

优化策略:

- Equal Weighting (EW)

- Gradient Normalization (GradNorm)

- Uncertainty Weights (UW)

- Multiple Gradient Descent Algorithm (MGDA)

- Dynamic Weight Average (DWA)

- Geometric Loss Strategy (GLS)

- Projecting Conflicting Gradient (PCGrad)

- Gradient sign Dropout (GradDrop)

- Impartial Multi-Task Learning (IMTL)

- Gradient Vaccine (GradVac)

- Conflict-Averse Gradient descent (CAGrad)

- Nash-MTL

- Random Loss Weighting (RLW)

- MoCo

- Aligned-MTL

- STCH

- ExcessMTL

- DB-MTL

架构:

- Hard Parameter Sharing (HPS)

- Cross-stitch Networks

- Multi-gate Mixture-of-Experts (MMoE)

- Multi-Task Attention Network (MTAN)

- Customized Gate Control (CGC)

- Progressive Layered Extraction (PLE)

- Learning to Branch (LTB)

- DSelect-k

这些算法涵盖了多任务学习研究中的多个重要方向,为研究人员提供了丰富的选择。

支持的基准数据集

LibMTL支持多个广泛使用的基准数据集,包括:

- NYUv2: 场景理解任务,包括语义分割、深度估计和表面法线预测三个子任务。

- Office-31: 图像识别任务,涉及3个分类子任务。

- Office-Home: 图像识别任务,包含4个分类子任务。

- QM9: 分子性质预测任务,默认包含11个回归子任务。

- PAWS-X: 复述识别任务,默认包含4个分类子任务。

这些数据集覆盖了计算机视觉、自然语言处理和分子化学等多个领域,为多任务学习算法的评估提供了全面的测试基础。

快速上手指南

要开始使用LibMTL,您可以按照以下步骤进行:

- 创建虚拟环境并安装依赖:

conda create -n libmtl python=3.8

conda activate libmtl

pip install torch==1.8.1+cu111 torchvision==0.9.1+cu111 -f https://download.pytorch.org/whl/torch_stable.html

- 克隆仓库:

git clone https://github.com/median-research-group/LibMTL.git

- 安装LibMTL:

cd LibMTL

pip install -r requirements.txt

pip install -e .

以NYUv2数据集为例,您可以使用以下命令来训练一个使用Equal Weighting (EW)和Hard Parameter Sharing (HPS)的多任务学习模型:

python main.py --weighting EW --arch HPS --dataset_path /path/to/nyuv2 --gpu_id 0 --scheduler step --mode train --save_path PATH

结语

LibMTL为多任务学习研究提供了一个强大而灵活的工具。无论您是想比较现有算法的性能,还是开发新的多任务学习方法,LibMTL都能为您提供所需的支持。随着多任务学习在各个领域的应用日益广泛,相信LibMTL会在未来的研究中发挥越来越重要的作用。

如果您在使用过程中遇到任何问题或有任何建议,欢迎通过GitHub issues或发送邮件至bj.lin.email@gmail.com与开发团队联系。让我们共同推动多任务学习的发展,为人工智能领域的进步贡献力量!

🔗 项目链接: LibMTL GitHub仓库 📚 详细文档: LibMTL 文档