LLMFarm_core.swift:为iOS和macOS打造的强大语言模型库

在人工智能和自然语言处理快速发展的今天,大型语言模型(LLM)成为了许多应用的核心技术。然而,如何在移动设备和个人电脑上高效地运行这些庞大的模型一直是一个挑战。LLMFarm_core.swift应运而生,为开发者提供了一个强大而灵活的工具,使其能够在iOS和macOS平台上轻松集成和使用各种语言模型。

源自业界顶尖技术

LLMFarm_core.swift并非凭空而来,它深深植根于开源社区的集体智慧。该项目基于Georgi Gerganov开发的ggml和llama.cpp,这两个项目在LLM优化和部署方面都做出了开创性的工作。此外,LLMFarm_core.swift还借鉴了其他优秀项目的经验,如saharNooby的rwkv.cpp和byroneverson的Mia。这种开放和协作的精神确保了LLMFarm_core.swift能够站在巨人的肩膀上,为用户提供最先进的功能和性能。

丰富多样的功能支持

LLMFarm_core.swift的功能列表令人印象深刻:

-

跨平台支持: 适用于macOS 13+和iOS 16+系统,覆盖了Apple生态系统的主要设备。

-

多样化的推理模型: 支持包括LLaMA、GPTNeoX、Replit、GPT2、Starcoder、RWKV、Falcon等在内的多种流行语言模型。这意味着开发者可以根据具体需求选择最适合的模型。

-

丰富的采样方法: 提供温度采样、Tail Free Sampling (TFS)、Locally Typical Sampling、Mirostat等多种采样技术,使生成的文本更加多样和自然。

-

Metal加速: 利用Apple的Metal框架进行GPU加速,显著提升了模型的运行速度。值得注意的是,这项功能在搭载Intel处理器的Mac上可能无法使用。

-

模型设置模板: 简化了模型配置过程,使开发者能够快速开始使用。

-

LoRA支持: 包括LoRA适配器支持、LoRA训练支持以及将LoRA导出为模型的功能,为模型微调和定制提供了强大的工具。

-

上下文状态恢复: 目前支持恢复聊天历史,增强了应用的用户体验。

灵活的推理选项

LLMFarm_core.swift支持的推理模型种类繁多,几乎涵盖了目前主流的开源语言模型:

- LLaMA系列: 包括LLaMA、LLaMA 2等

- GPT系列: 支持GPTNeoX、GPT2等

- 专业领域模型: 如代码生成领域的Replit和Starcoder

- 新兴模型: 如RWKV、Falcon、MPT、Bloom等

- 多语言模型: 如Qwen(通义千问)、Yi、Deepseek等中文大模型

- 混合专家模型: 如Mixtral MoE

这种多样性使得开发者可以根据不同的应用场景和性能需求选择最合适的模型。例如,对于需要在移动设备上运行的应用,可以选择较小的模型如GPT2或StableLM-3b-4e1t;而对于要求高质量输出的桌面应用,则可以使用更大的模型如LLaMA或Mixtral MoE。

高效的采样方法

为了生成高质量和多样化的文本,LLMFarm_core.swift提供了多种先进的采样方法:

-

温度采样: 通过调整温度参数,控制生成文本的随机性和创造性。

-

Tail Free Sampling (TFS): 这种方法可以在保持文本连贯性的同时增加其多样性,特别适合创意写作类的应用。

-

Locally Typical Sampling: 通过考虑局部上下文,生成更符合当前语境的文本。

-

Mirostat: 这是一种自适应采样方法,可以动态调整采样参数以维持一定的困惑度(perplexity)水平。

-

贪婪解码: 适用于需要确定性输出的场景。

-

语法约束生成: 通过定义语法规则来控制生成文本的结构,虽然在某些模型上可能不可用。

-

Classifier-Free Guidance: 这种技术可以在不使用额外分类器的情况下引导文本生成朝着特定方向发展。

这些多样化的采样方法为开发者提供了精细调节文本生成过程的能力,使得生成的内容能够更好地满足特定应用的需求。

简单易用的安装和集成

LLMFarm_core.swift的安装过程非常直接。开发者可以通过以下命令克隆项目仓库:

git clone https://github.com/guinmoon/llmfarm_core.swift

对于使用Swift Package Manager的项目,只需将LLMFarm_core.swift添加为依赖即可:

dependencies: [

.package(url: "https://github.com/guinmoon/llmfarm_core.swift")

]

性能优化和调试

LLMFarm_core.swift不仅注重功能,也十分关注性能。项目提供了详细的构建和调试指南,帮助开发者获得最佳性能:

- 在调试时,建议注释掉

Package.swift中的.unsafeFlags(["-Ofast"])以获得更好的可调试性。 - 对于需要支持QKK_64的构建,可以取消注释

.unsafeFlags(["-DGGML_QKK_64"])。

这些选项让开发者能够根据自己的需求在性能和可调试性之间找到平衡点。

实际应用案例

为了帮助开发者快速上手,LLMFarm_core.swift提供了一个示例项目,展示了如何在实际应用中集成和使用该库。这个示例项目是学习和理解LLMFarm_core.swift功能的绝佳起点。

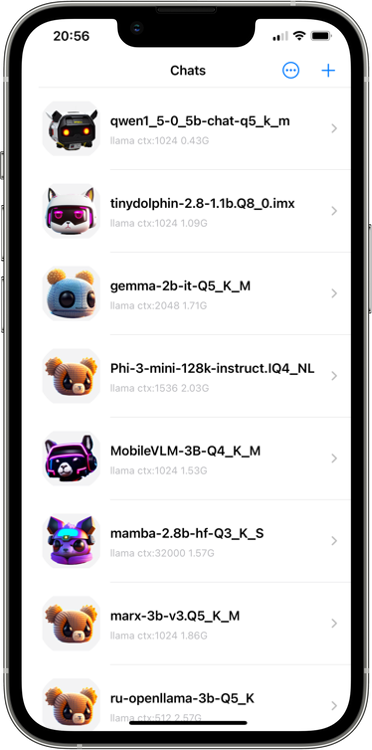

基于LLMFarm_core.swift的项目

LLMFarm_core.swift已经在实际项目中得到了应用。最著名的例子是LLM Farm应用,这是一个允许用户在iOS和macOS设备上本地运行LLaMA和其他大型语言模型的应用程序。这个项目很好地展示了LLMFarm_core.swift的潜力,为开发者提供了如何构建复杂LLM应用的参考。

结语

LLMFarm_core.swift为iOS和macOS平台上的语言模型应用开发开辟了新的可能性。通过提供丰富的功能、灵活的配置选项和优秀的性能,它使得在移动设备和个人电脑上运行复杂的语言模型变得更加简单和高效。无论是对于想要探索LLM技术的个人开发者,还是计划在产品中集成先进语言处理能力的企业,LLMFarm_core.swift都是一个值得考虑的强大工具。

随着人工智能技术的不断发展,我们可以期待LLMFarm_core.swift在未来会支持更多新兴的模型和技术,为Apple生态系统中的AI应用开发持续注入活力。对于有志于在iOS和macOS平台上开发下一代智能应用的开发者来说,LLMFarm_core.swift无疑是一个不可多得的利器。