项目简介

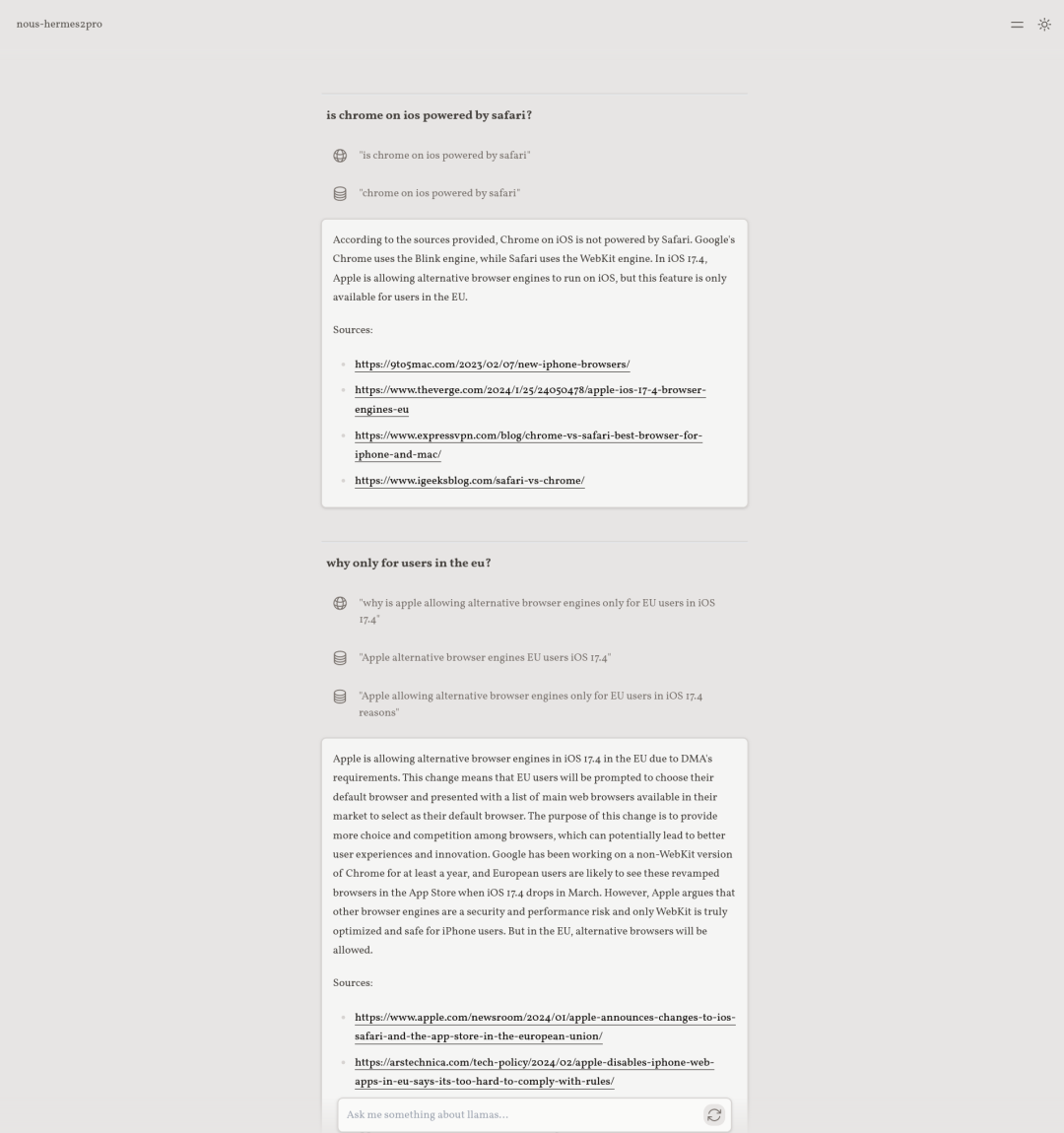

LLocalSearch是一个完全本地化运行的搜索聚合器,采用LLM(大型语言模型)Agent进行工作。用户可以提出问题,系统将通过一系列LLM找到答案,并且用户能够看到A

| col1 | col2 | col3 |

|---|---|---|

gent的进展和最终答案。

该项目的特点是不需要OpenAI或Google的API密钥,保证了搜索过程的隐私性和安全性。此外,LLocalSearch支持跟进问题,具备完全本地化操作的特性,无需通过外部API进行数据处理,为用户提供了一个既方便又安全的本地搜索服务。

特点

- 🕵️ 完全本地化(无需API密钥)

- 💸 可在“低端”大型语言模型硬件上运行(演示视频使用了一个7b模型)

- 🤓 进度日志,让搜索过程的理解更加深入

- 🤔 提出后续问题

- 📱 移动友好界面

- 🚀 通过Docker Compose快速且易于部署

- 🌐 网络界面,允许从任何设备轻松访问

- 💮 手工制作的UI,具有明暗模式

自托管与开发

- 需求

- 一个运行中的Ollama服务器,容器能够访问到GPU不是必需的,但推荐使用

- 确保Ollama不仅仅在localhost上监听,而是在所有接口上监听(或至少是docker网络上)。如果你在docker内使用ollama,那么你不需要更改任何设置。

- Docker Compose

- 运行最新发布版

如果你不打算在这个项目上进行开发,这是推荐的代码

git clone https://github.com/nilsherzig/LLocalSearch.git

cd ./LLocalSearch

# 🔴 check the env vars inside the compose file (and `env-example` file) and change them if needed

docker-compose up

🎉 你现在应该能够在 http://localhost:3000 上打开网络界面。默认情况下,没有其他内容被暴露。

- 运行当前的git版本

具有更新的特性,但可能稳定性较差。

git clone https://github.com/nilsherzig/LLocalsearch.git

# 1. make sure to check the env vars inside the `docker-compose.dev.yaml`.

# 2. Make sure you've really checked the dev compose file not the normal one.

# 3. build the containers and start the services

make dev

# Both front and backend will hot reload on code changes.

如果你没有安装make,你可以手动运行Makefile内的命令。

现在,你应该能够在 http://localhost:3000 访问前端界面。