LongRAG:革新检索增强生成与长上下文LLMs的结合

在人工智能领域,检索增强生成(Retrieval-Augmented Generation, RAG)技术近年来备受关注。它通过外部知识库来增强大型语言模型(LLMs)的能力,成为了提升AI系统性能的重要方法。然而,随着LLMs在处理长上下文方面能力的显著提升,传统RAG系统的设计理念也面临着新的挑战和机遇。为应对这一变化,研究人员提出了创新性的LongRAG框架,旨在充分利用最新LLMs的长上下文处理能力,重新定义RAG系统的架构和工作流程。

传统RAG系统的局限性

传统的RAG系统通常采用短文本单元作为检索基础,这种设计源于早期LLMs在处理长文本时的局限性。典型的做法是将文档切分成约100词左右的段落,这就要求检索器需要在海量的短文本片段中搜索相关信息。这种方法虽然在一定程度上提高了模型的知识获取能力,但也带来了一些问题:

- 检索负担重: 检索器需要在庞大的语料库中进行搜索,计算开销较大。

- 上下文信息损失: 将长文档切分成短段落可能导致上下文信息的丢失,影响理解的完整性。

- 检索器与阅读器不平衡: 检索任务复杂而繁重,而阅读器仅需处理短文本,这种不平衡可能导致系统整体性能受限。

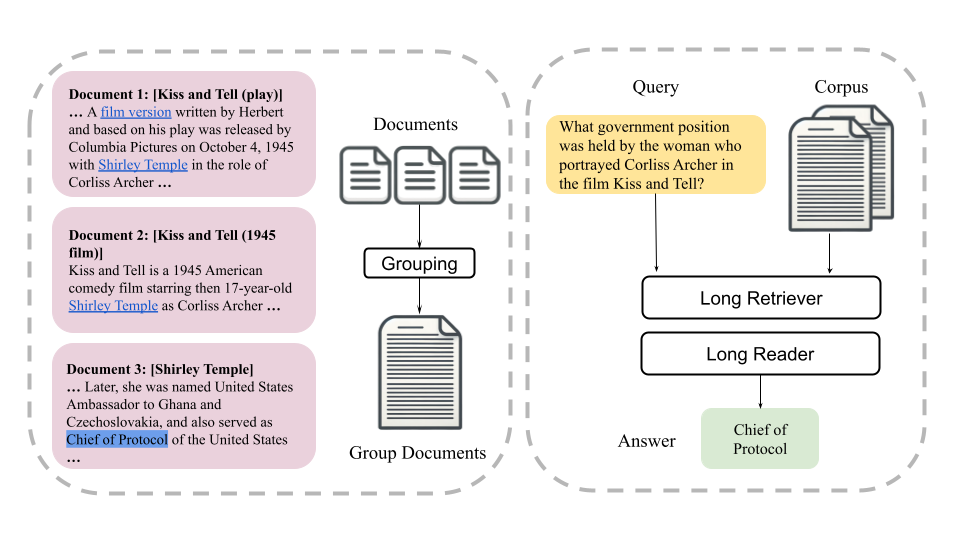

LongRAG: 长上下文RAG的新范式

LongRAG框架的核心理念是充分利用现代LLMs处理长文本的能力,重新设计RAG系统的检索和阅读流程。它主要由两个关键组件构成:

-

长检索器(Long Retriever):

- 将原始文档合并成更长的检索单元,每个单元包含约4000个token。

- 显著减少了检索语料库的规模,从而简化检索任务。

- 保留了更多的上下文信息,提高了检索结果的相关性和完整性。

-

长阅读器(Long Reader):

- 利用如GPT-4或Gemini-1.5-Pro等能处理长文本的先进LLMs。

- 能够一次性处理多个长检索单元,综合分析信息以生成答案。

LongRAG的优势

-

检索效率提升: 通过使用更长的检索单元,LongRAG将Wikipedia语料库的检索单元数量从2200万减少到了60万,大幅降低了检索的复杂度。

-

检索质量提升: 在自然问答(NQ)数据集上,LongRAG的top-1答案召回率达到71%,相比传统方法的52%有显著提升。

-

答案生成性能提升: 在HotpotQA数据集上,LongRAG实现了64.3%的精确匹配率,与当前最先进的全监督模型相当。

-

灵活性与可扩展性: LongRAG框架可以轻松适应不同的数据集和任务,如Qasper和MultiFieldQA-en等非维基百科数据集。

实现细节

LongRAG的实现涉及多个关键步骤:

-

语料库预处理:

- 清洗Wikipedia原始数据。

- 提取页面间的链接关系,构建文档图。

- 根据文档关联性将多个相关文档组合成长检索单元。

-

长检索器:

- 采用开源的密集检索工具包Tevatron。

- 使用bge-large-en-v1.5作为基础嵌入模型。

-

长阅读器:

- 选用Gemini-1.5-Pro和GPT-4等先进的长上下文LLMs。

- 将检索到的多个长单元连接起来作为输入。

-

评估:

- 在NQ和HotpotQA等标准数据集上进行测试。

- 提供了详细的评估脚本和示例输出。

未来展望

LongRAG为RAG系统的发展开辟了新的方向。随着LLMs在处理超长文本方面能力的持续提升,我们可以预见:

- RAG系统将能处理更长、更复杂的文档,提供更全面的知识支持。

- 检索和生成过程将更加紧密集成,实现真正的"端到端"知识增强。

- 跨文档、跨领域的复杂推理能力将得到显著提升。

LongRAG不仅是一个技术创新,更代表了AI系统向更智能、更灵活方向发展的一个重要里程碑。它展示了如何巧妙利用最新LLMs的能力来重塑现有的AI架构,为未来的智能系统设计提供了宝贵的启示。

研究者们正在持续优化LongRAG,探索其在更多领域的应用潜力。相信在不久的将来,基于LongRAG理念的系统将在各类复杂的自然语言处理任务中发挥重要作用,推动AI技术向着更高层次迈进。

结语

LongRAG框架的提出和实现,标志着RAG技术进入了一个新的发展阶段。它不仅解决了传统RAG系统面临的一些关键挑战,更为未来AI系统的设计提供了新的思路。随着长上下文处理能力的不断提升,我们有理由相信,像LongRAG这样的创新将继续推动AI技术向着更智能、更实用的方向发展,为人类社会带来更多价值。

对于研究者和开发者而言,LongRAG项目提供了宝贵的开源资源和详细的实现指南。无论是想要深入研究RAG技术,还是希望在实际应用中提升系统性能,LongRAG都是一个值得关注和学习的优秀框架。

随着AI技术的快速发展,我们期待看到更多像LongRAG这样的创新性工作,不断推动人工智能领域的边界,为解决复杂的实际问题提供更强大的工具和方法.