MagViT2-PyTorch: 视频生成的新纪元

在人工智能和计算机视觉快速发展的今天,视频生成技术一直是研究的热点。近期,一项名为MagViT2的创新技术引起了广泛关注。本文将深入介绍MagViT2-PyTorch项目,探讨其如何推动视频生成和理解技术的发展。

MagViT2: 突破性的视频生成技术

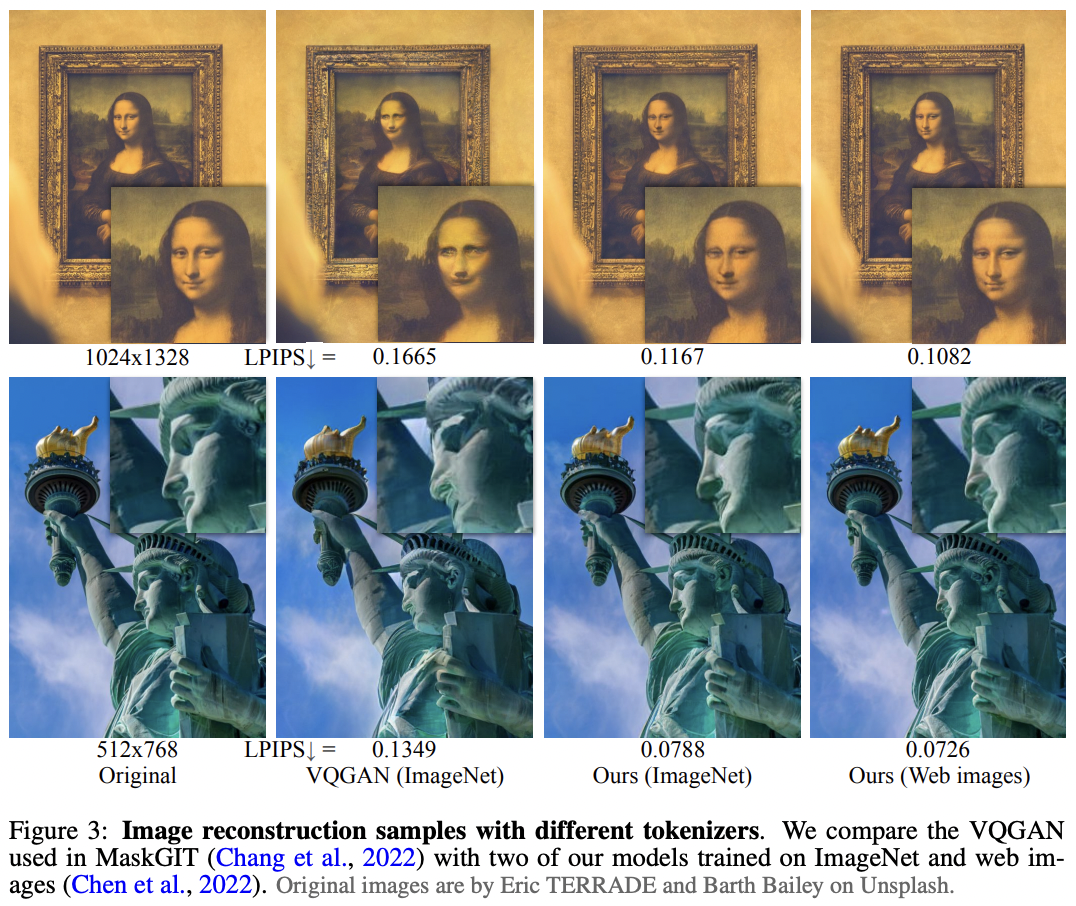

MagViT2源自一篇题为《Language Model Beats Diffusion - Tokenizer is Key to Visual Generation》的论文。该技术在视频生成和理解领域取得了显著的突破,成为当前最先进(SOTA)的解决方案。MagViT2的核心在于其创新的tokenizer设计,这一设计使得语言模型在视觉生成任务中的表现超越了传统的扩散模型。

PyTorch实现:开源精神的体现

为了推动这一技术的发展和应用,研究者Phil Wang(GitHub用户名lucidrains)在GitHub上开源了MagViT2的PyTorch实现。这个名为magvit2-pytorch的项目不仅提供了MagViT2 Tokenizer的完整实现,还包含了丰富的训练和使用示例。

项目特点

-

完整实现: 项目提供了MagViT2 Tokenizer的全面实现,包括编码器、解码器和训练器等核心组件。

-

灵活配置: 用户可以根据需求调整各种参数,如图像大小、维度、codebook大小等。

-

易于使用: 项目提供了简洁的API,使得研究者和开发者可以轻松地将MagViT2集成到自己的项目中。

-

持续更新: 作者不断添加新功能和优化,保持项目的活跃度和先进性。

深入技术细节

MagViT2-PyTorch的核心是其VideoTokenizer类,它实现了将视频转换为离散代码的过程。这个过程包括以下几个关键步骤:

- 空间压缩: 通过一系列卷积层减少视频的空间维度。

- 时间压缩: 使用特殊的层结构处理视频的时间维度。

- 注意力机制: 引入空间和时间注意力,捕捉视频中的长程依赖。

- 量化: 使用Lookup Free Quantizer(LFQ)将特征映射到离散的codebook。

tokenizer = VideoTokenizer(

image_size = 128,

init_dim = 64,

max_dim = 512,

codebook_size = 1024,

layers = (

'residual',

'compress_space',

('consecutive_residual', 2),

'compress_space',

('consecutive_residual', 2),

'linear_attend_space',

'compress_space',

('consecutive_residual', 2),

'attend_space',

'compress_time',

('consecutive_residual', 2),

'compress_time',

('consecutive_residual', 2),

'attend_time',

)

)

这段代码展示了如何配置VideoTokenizer,定义了一系列层来处理视频数据。

训练和使用

MagViT2-PyTorch提供了VideoTokenizerTrainer类,简化了模型的训练过程。用户可以轻松地设置训练参数,如数据集路径、批量大小、学习率等。

trainer = VideoTokenizerTrainer(

tokenizer,

dataset_folder = '/path/to/videos',

dataset_type = 'videos',

batch_size = 4,

grad_accum_every = 8,

learning_rate = 2e-5,

num_train_steps = 1_000_000

)

trainer.train()

训练完成后,用户可以使用训练好的模型进行视频tokenization和重构:

# 使用EMA (Exponential Moving Average) 版本的tokenizer

ema_tokenizer = trainer.ema_tokenizer

# 模拟一个视频输入

video = torch.randn(1, 3, 17, 128, 128)

# 将视频转换为离散代码

codes = ema_tokenizer.tokenize(video)

# 从代码重构视频

decoded_video = ema_tokenizer.decode_from_code_indices(codes)

未来展望

MagViT2-PyTorch项目仍在积极开发中,计划中的功能包括:

- 添加对抗性损失

- 实现多尺度判别器

- 改进注意力机制

- 探索自回归损失

这些计划的功能将进一步提升模型的性能和应用范围。

结语

MagViT2-PyTorch项目为视频生成和理解技术带来了新的可能性。通过开源实现,它不仅推动了技术的发展,也为研究者和开发者提供了宝贵的学习和实验资源。随着项目的不断完善和社区的贡献,我们可以期待在不久的将来,看到更多基于MagViT2的创新应用和突破性研究成果。

无论您是人工智能研究者、计算机视觉专家,还是对视频生成技术感兴趣的开发者,MagViT2-PyTorch都值得您深入探索。让我们共同期待视频生成技术的美好未来!