PyRIT:为生成式AI系统保驾护航的开源自动化框架

在人工智能高速发展的今天,生成式AI系统已经成为各行各业不可或缺的重要工具。然而,随着这些系统的广泛应用,其潜在的安全风险和道德问题也日益凸显。为了帮助开发者和安全专家更好地识别和应对这些风险,微软近日推出了一款名为PyRIT(Python Risk Identification Tool for generative AI)的开源自动化框架。

PyRIT:生成式AI的"安全卫士"

PyRIT是由微软AI红队(AI Red Team)开发的一款专门用于生成式AI系统的风险识别工具。它的主要目标是帮助安全专业人员和机器学习工程师对基础模型及其应用进行"红队测试"(Red Teaming),从而主动发现系统中潜在的安全隐患和道德风险。

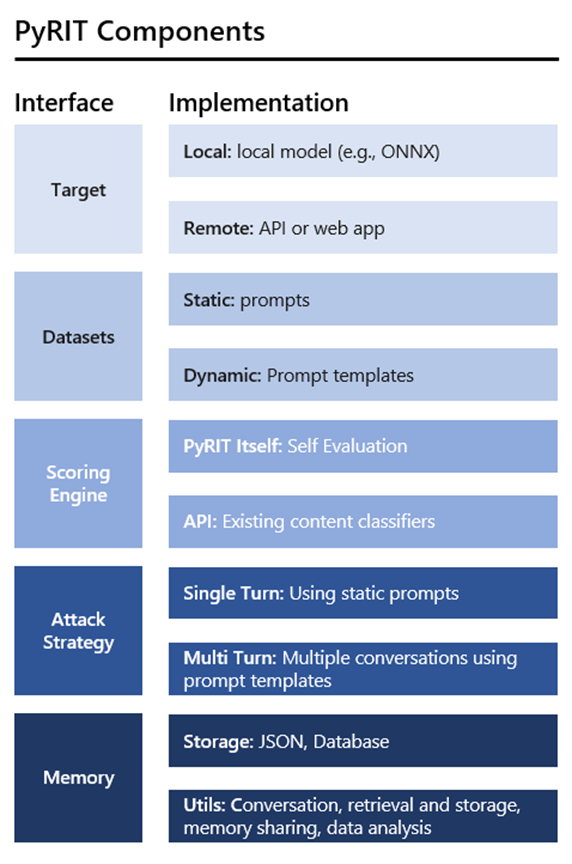

这个框架的核心功能包括:

-

自动化测试:PyRIT能够自动执行各种测试场景,大大提高了风险识别的效率。

-

多类型风险识别:它不仅可以识别传统的安全风险,还能发现生成式AI特有的问题,如内容偏差、幻觉等。

-

灵活的目标支持:PyRIT支持多种生成式AI目标形式,无论是作为Web服务还是嵌入在应用程序中。

-

可扩展的评分引擎:用户可以使用经典的机器学习分类器或利用LLM端点进行自评估。

-

多样化的攻击策略:支持单轮和多轮攻击策略,以模拟更真实的对抗性行为。

PyRIT的工作原理

PyRIT的工作流程大致可以分为以下几个步骤:

-

目标定义:首先,用户需要定义要测试的生成式AI系统。PyRIT支持各种形式的目标,包括Azure OpenAI Service、Hugging Face和Azure Machine Learning Managed Online Endpoint等。

-

数据集准备:用户可以提供静态的恶意提示集或动态的提示模板。PyRIT还内置了一些公开可用的"越狱"(jailbreak)提示,以帮助用户快速开始测试。

-

攻击策略选择:PyRIT支持单轮和多轮攻击策略。单轮策略速度更快,而多轮策略则更接近真实的对抗性行为。

-

执行测试:PyRIT会根据选定的策略自动执行测试,向目标AI系统发送各种提示并收集响应。

-

结果评估:使用内置的评分引擎或外部API(如Azure AI Content Safety)对AI系统的输出进行评分。

-

结果分析:PyRIT会保存中间输入和输出交互,以便用户进行深入分析。

PyRIT的优势

与传统的AI安全测试工具相比,PyRIT具有以下几个显著优势:

-

专注于生成式AI:PyRIT是专门为生成式AI系统设计的,能够更好地应对这类系统的特殊挑战。

-

高度自动化:通过自动化测试过程,PyRIT大大提高了风险识别的效率。例如,在一次对Copilot系统的红队测试中,PyRIT能够在几小时内生成数千个恶意提示并评估系统输出,而这个过程通常需要数周时间。

-

灵活可扩展:PyRIT的设计理念注重抽象和可扩展性,能够适应生成式AI模型的快速发展。

-

开源共享:作为一个开源项目,PyRIT鼓励整个行业共同参与,共同提高AI系统的安全性。

如何开始使用PyRIT

如果你对PyRIT感兴趣,可以按照以下步骤开始使用:

-

访问PyRIT的GitHub仓库,了解项目的详细信息。

-

尝试运行项目中提供的示例和演示,如使用PyRIT自动"越狱"Lakera的Gandalf游戏。

-

参加微软与云安全联盟合作举办的PyRIT网络研讨会,了解如何在实际场景中使用PyRIT进行生成式AI系统的红队测试。

结语

在生成式AI快速发展的今天,确保这些强大系统的安全性和可靠性变得至关重要。PyRIT的推出无疑为整个行业提供了一个强有力的工具,帮助开发者和安全专家更好地识别和应对潜在风险。作为一个开源项目,PyRIT也体现了微软在推动AI安全和责任共担方面的努力。

随着越来越多的开发者和研究人员加入使用和改进PyRIT,我们有理由相信,这个工具将在未来发挥更大的作用,为构建更安全、更可靠的生成式AI系统做出重要贡献。无论你是AI开发者、安全专家还是对AI安全感兴趣的研究者,都不妨尝试使用PyRIT,为AI的安全发展贡献自己的一份力量。