rPPG-Toolbox:深度远程PPG工具箱

rPPG-Toolbox:深度远程PPG工具箱

rPPG-Toolbox是一个开源平台,专为基于相机的生理感知而设计,也称为远程光电容积脉搏波描记法(rPPG)。这个强大的工具箱不仅对现有的最先进的神经和无监督方法进行基准测试,还支持研究人员灵活快速地开发自己的算法。

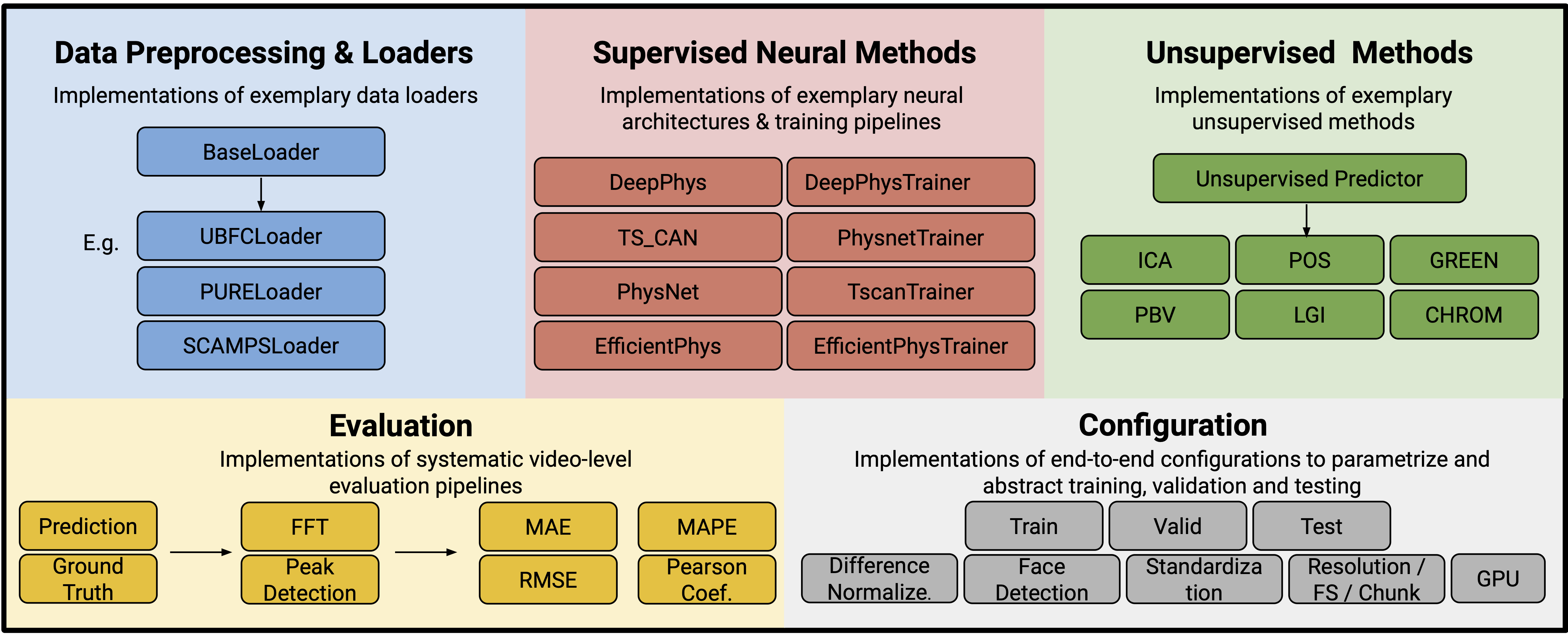

工具箱概述

rPPG-Toolbox具有以下主要特点:

- 支持多种先进的rPPG算法,包括传统的无监督算法和基于深度学习的监督算法

- 集成了多个公开的rPPG基准数据集

- 提供了完整的数据预处理、模型训练和评估流程

- 支持自定义数据集和算法的灵活扩展

- 提供了丰富的可视化工具,用于数据分析和结果展示

支持的算法

rPPG-Toolbox支持多种先进的rPPG算法:

-

传统无监督算法:

- GREEN: 基于环境光的远程光电容积成像

- ICA: 使用网络摄像头的非接触式多参数生理测量的进展

- CHROM: 基于色度的稳健脉搏率rPPG

- LGI: 野外面部视频心率估计的局部群不变性

- PBV: 使用血容积脉冲签名改善远程PPG的运动稳健性

- POS: 远程ppg的算法原理

- OMIT: 一种从面部提取血容积脉冲的无监督管道

-

监督神经网络算法:

- DeepPhys: 使用卷积注意力网络的基于视频的生理测量

- PhysNet: 使用时空网络从人脸视频测量远程光电容积描记信号

- TS-CAN: 用于设备上非接触式生命体征测量的多任务时间偏移注意力网络

- EfficientPhys: 实现简单、快速和准确的基于相机的心脏测量

- BigSmall: 针对不同空间和时间生理测量的高效多任务学习

- PhysFormer: 使用时间差分变换器的基于面部视频的��生理测量

- iBVPNet: 在iBVP数据集论文中引入的3D-CNN架构

支持的数据集

rPPG-Toolbox支持多个公开的rPPG基准数据集:

- SCAMPS: 用于相机生理信号测量的合成数据集

- UBFC-rPPG: 包含面部视频和同步的地面实况PPG信号

- PURE: 用于移动服务机器人上的非接触式脉搏率测量

- BP4D+: 用于人类行为分析的多模态自发情感语料库

- UBFC-Phys: 用于社会压力心理生理研究的多模态数据库

- MMPD: 多领域移动视频生理数据集

- iBVP: RGB-热rPPG数据集,具有高分辨率信号质量标签

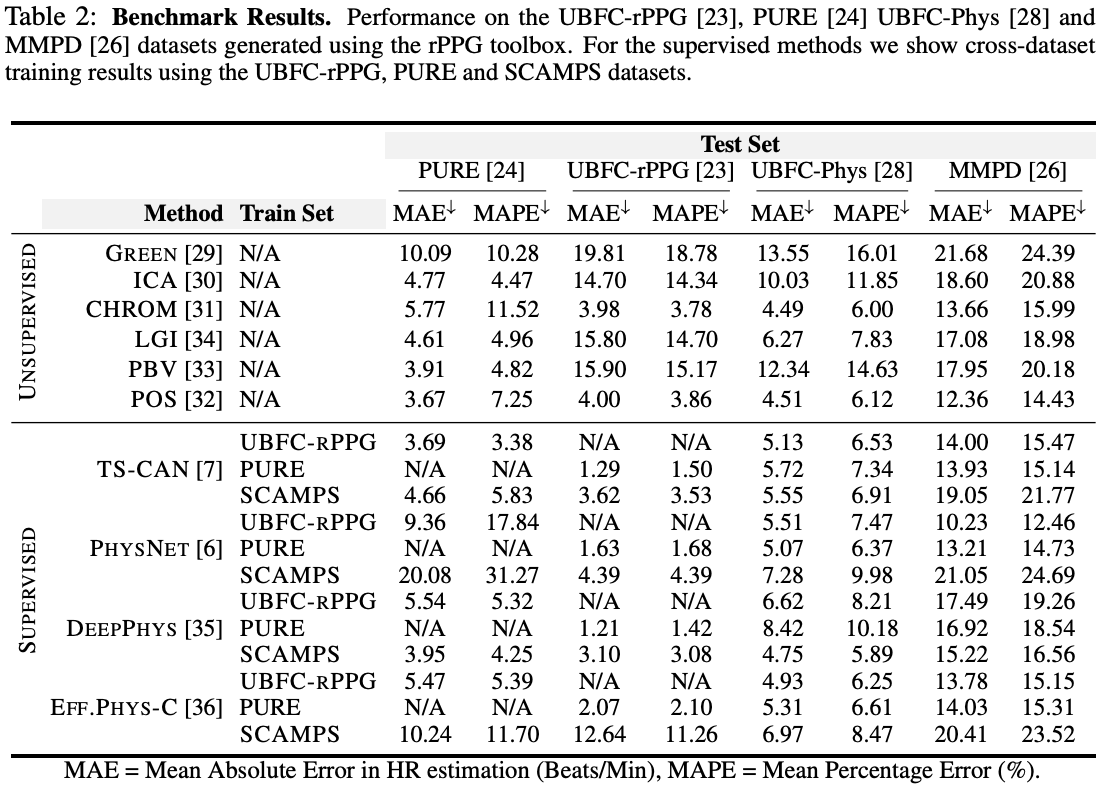

基准测试结果

rPPG-Toolbox对所有支持的算法和数据集进行了全面的基准测试。下图展示了各种算法在不同数据集上的平均绝对误差(MAE)和平均绝对百分比误差(MAPE)性能:

使用指南

设置环境

- 运行

bash setup.sh - 激活conda环境:

conda activate rppg-toolbox - 安装依赖:

pip install -r requirements.txt

使用预训练模型

使用 ./configs/infer_configs 下的配置文件进行推理。例如:

python main.py --config_file ./configs/infer_configs/PURE_UBFC-rPPG_TSCAN_BASIC.yaml

训练神经网络模型

使用 ./configs/train_configs 下的配置文件进行训练。例如,在PURE数据集上训练并在UBFC-rPPG上测试TSCAN模型:

- 下载PURE和UBFC-rPPG数据集

- 修改

./configs/train_configs/PURE_PURE_UBFC-rPPG_TSCAN_BASIC.yaml配置文件 - 运行:

python main.py --config_file ./configs/train_configs/PURE_PURE_UBFC-rPPG_TSCAN_BASIC.yaml

使用无监督方法

- 下载UBFC-rPPG数据集

- 修改

./configs/infer_configs/UBFC_UNSUPERVISED.yaml配置文件 - 运行:

python main.py --config_file ./configs/infer_configs/UBFC_UNSUPERVISED.yaml

数据可视化

rPPG-Toolbox提供了丰富的可视化工具,用于分析预处理后的数据、训练过程和预测结果。

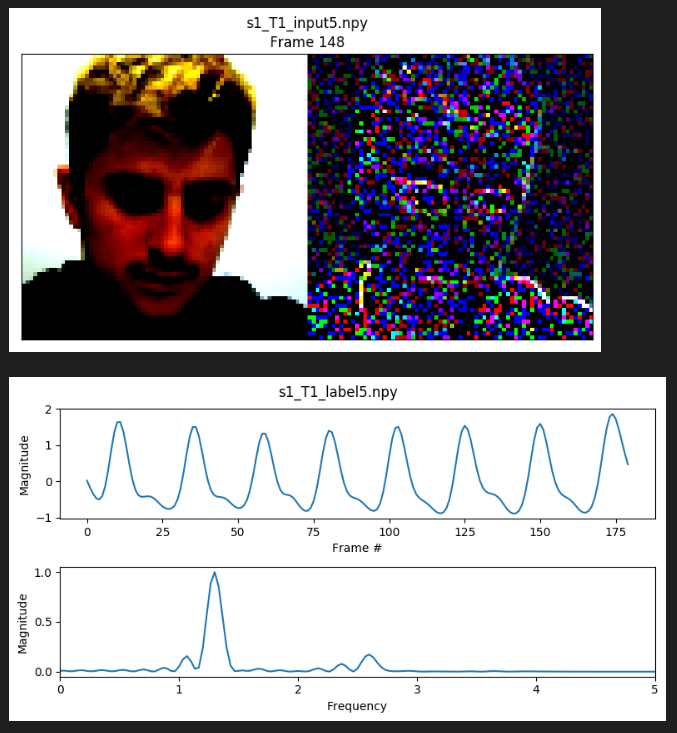

预处理数据可视化

在 tools/preprocessing_viz 目录下提供了用于可视化预处理数据的Python notebook。该notebook可以自动检测预处理后的数据格式,并绘制输入图像示例和波形。

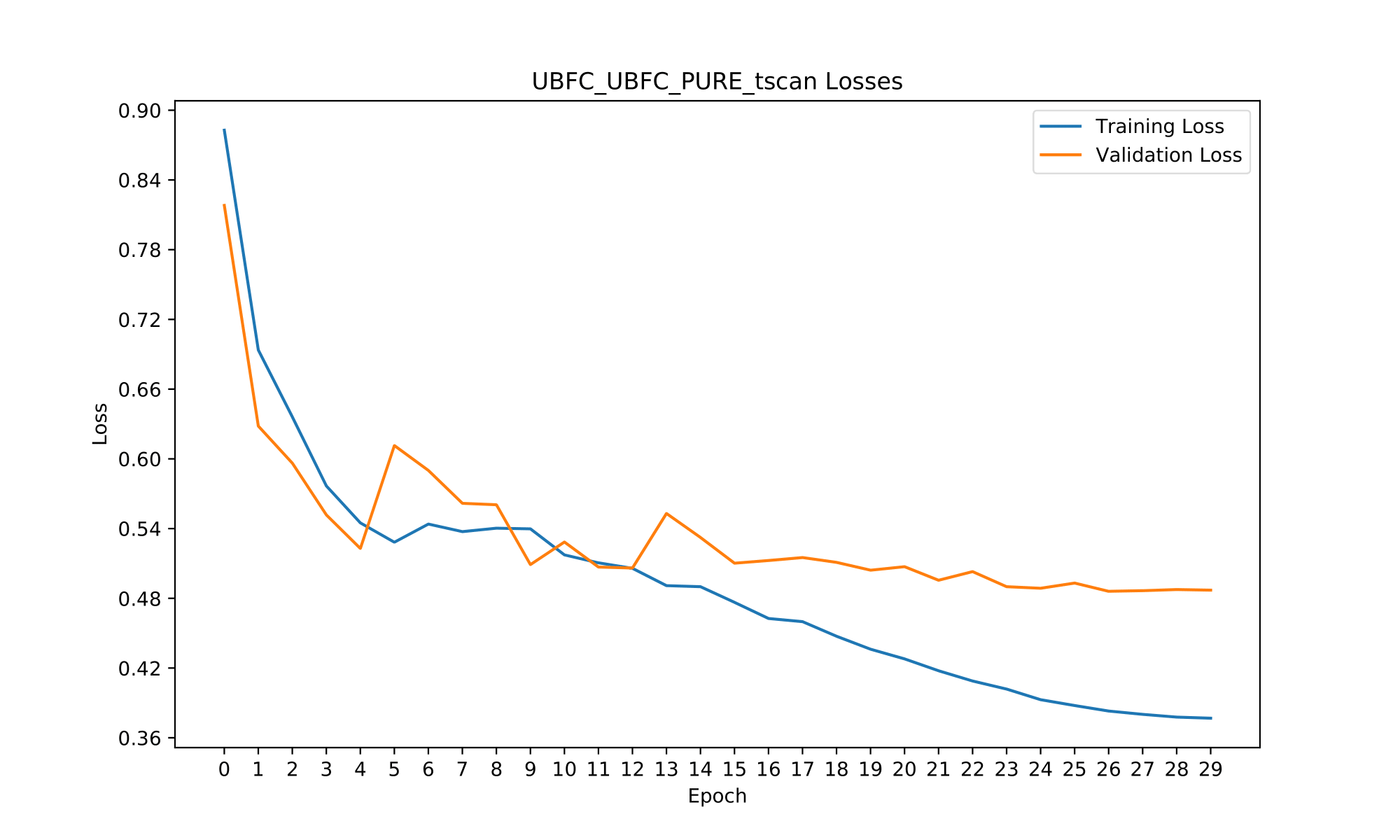

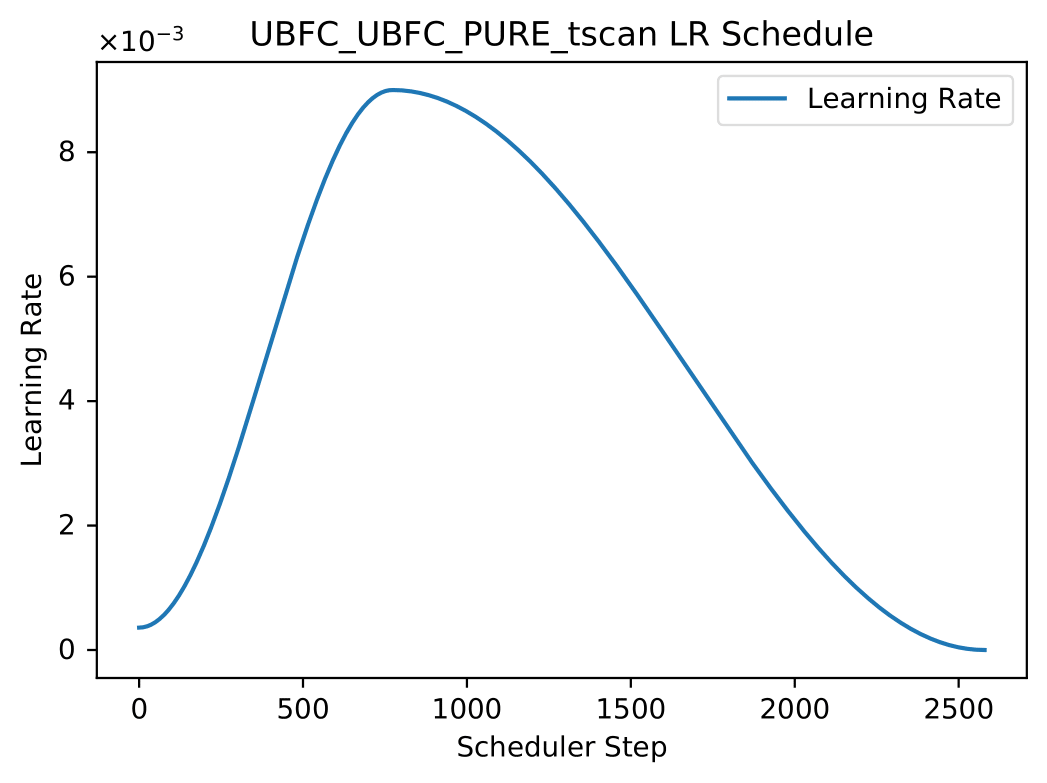

训练损失和学习率可视化

工具箱会自动保存训练和验证损失的图表。这些图表默认保存在 runs/exp 目录下。下图展示了在UBFC-rPPG数据集上训练和验证,并在PURE数据集上测试时的损失和学习率曲线:

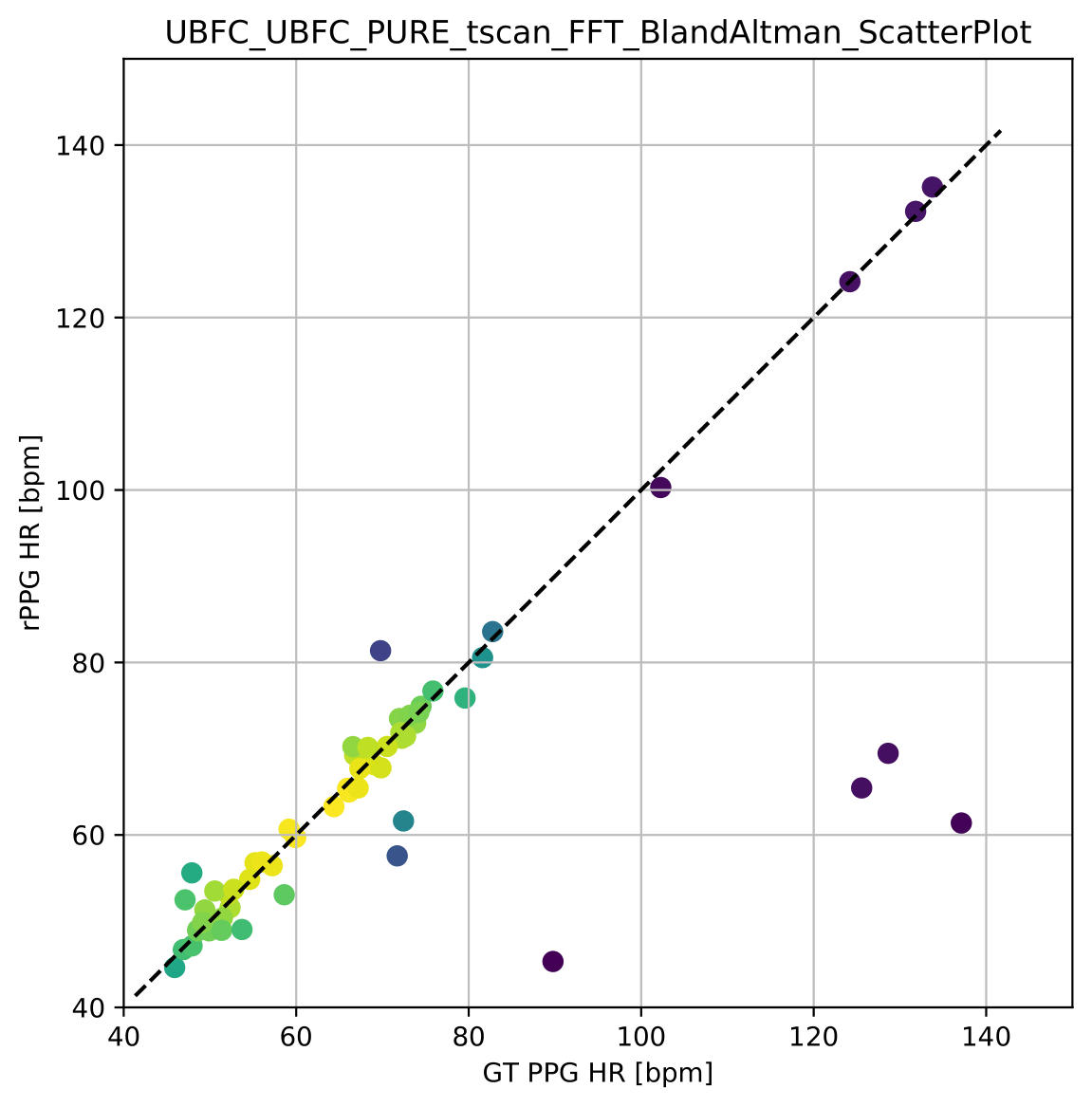

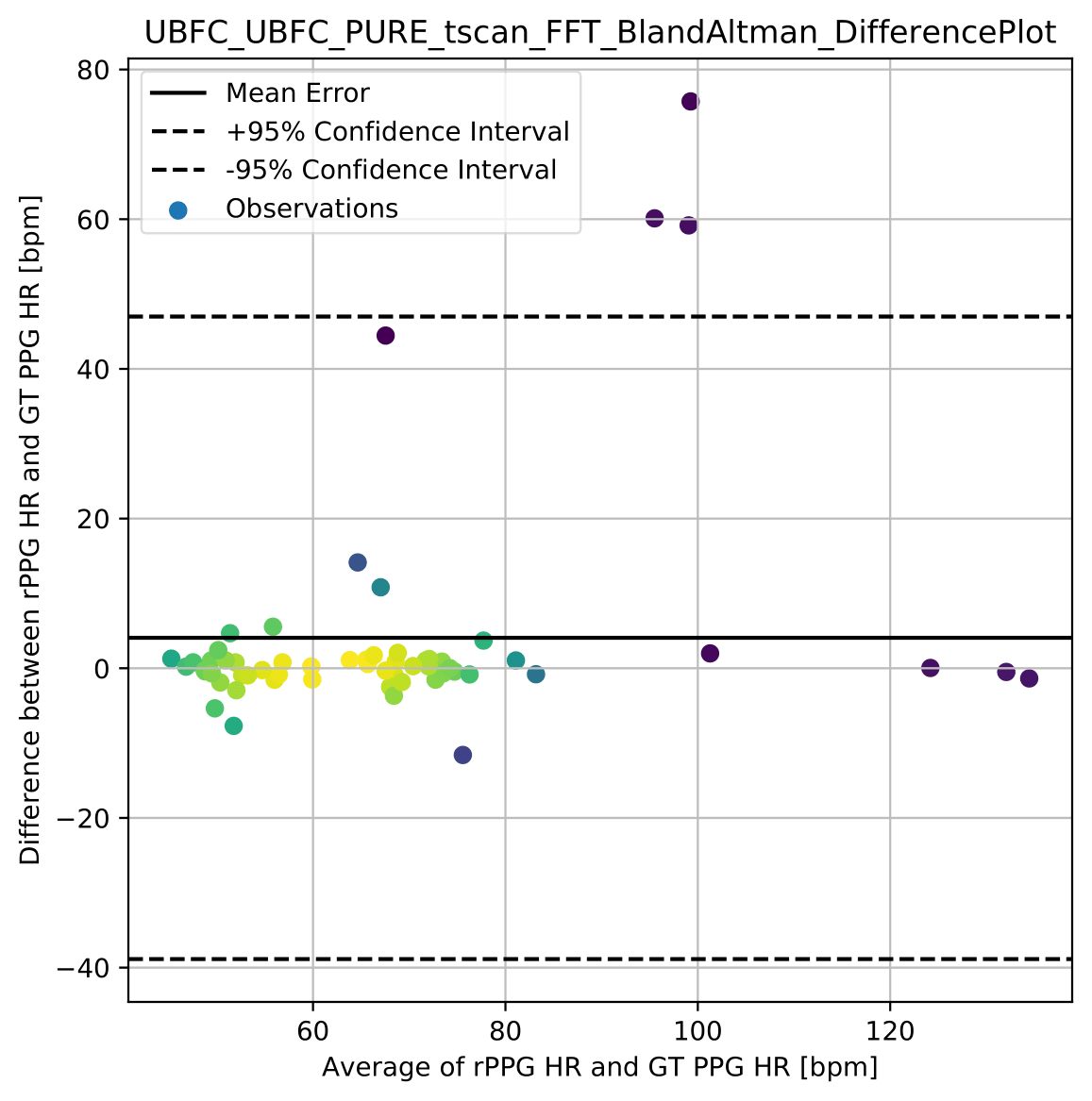

Bland-Altman图

工具箱默认会为监督和无监督方法生成Bland-Altman图,用于图形化比较两种测量技术。这些图表同样保存在 runs/exp 目录下。下图展示了在UBFC-rPPG数据集上训练和验证,并在PURE数据集上测试后生成的Bland-Altman图:

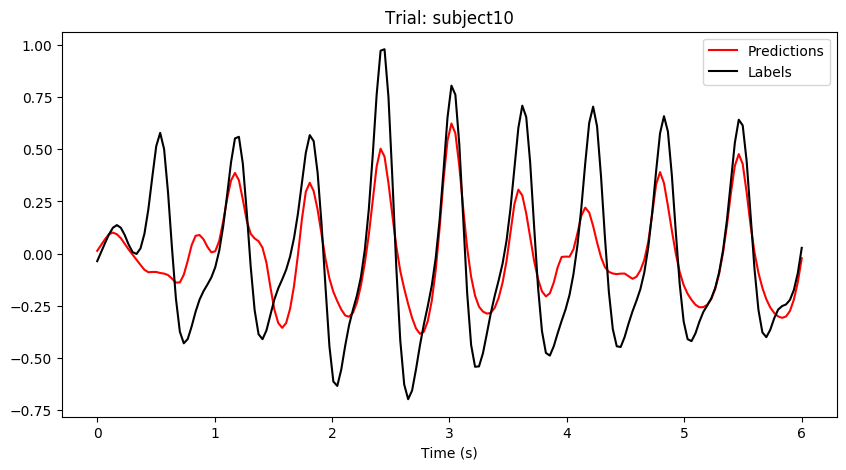

神经网络预测结果可视化

在 tools/output_signal_viz 目录下提供了用于可视化测试集神经网络输出预测和标签的Python notebook。该notebook可以绘制预测的PPG信号与地面实况PPG信号的对比图。

配置文件说明

rPPG-Toolbox使用YAML文件来控制训练和评估的所有参数。您可以修改现有的YAML文件以满足自己的训练和测试需求。以下是一些重要参数的说明:

-

TOOLBOX_MODE:

train_and_test: 在数据集上训练并使用新训练的模型进行测试only_test: 使用预训练模型进行测试,需要设置INFERENCE-MODEL_PATH

-

TRAIN / VALID / TEST / UNSUPERVISED DATA:

- DATA_PATH: 原始数据的输入路径

- CACHED_PATH: 预处理数据的输出路径

- BEGIN & END: 用于训练/验证/测试的数据集部分

- DATA_TYPE: 如何预处理视频数据

- LABEL_TYPE: 如何预处理标签数据

- DO_CHUNK: 是否将原始数据分割成更小的块

- DO_CROP_FACE: 是否执行人脸检测

-

MODEL: 设置使用的模型(支持Deepphys, TSCAN, Physnet, EfficientPhys, BigSmall和PhysFormer及其参数)

-

UNSUPERVISED METHOD: 设置使用的无监督方法,例如: ["ICA", "POS", "CHROM", "GREEN", "LGI", "PBV"]

-

METRICS: 设置使用的评估指标,例如: ['MAE','RMSE','MAPE','Pearson','SNR','BA']

扩展工具箱

rPPG-Toolbox支持灵活的扩展,您可以轻松添加新的数据集、神经网络算法和无监督算法。

添加新数据集

- 在

dataset/data_loader中创建新的Python文件,例如 MyLoader.py - 实现必要的函数,包括

preprocess_dataset,read_video和read_wave - 根据需要重写可选函数

- 在 configs/ 目录下创建新的YAML文件设置参数,并在 config.py 中添加新参数的定义和初始值

添加新的神经网络算法

- 在

neural_methods/model中定义新模型,例如 NewModel.py - 在

neural_methods/trainer中实现相应的训练/测试例程,例如 NewModelTrainer.py - 在 main.py 中添加逻辑以在

train_and_test和test函数中使用新模型 - 在 configs/ 目录下创建对应新算法的YAML文件

添加新的无监督算法

- 在

unsupervised_methods/methods中定义新算法,例如 NewMethod.py - 在 main.py 中添加逻辑以在

unsupervised_method_inference函数中使用新算法 - 在 configs/ 目录下创建对应新算法的YAML文件

高级功能

弱监督训练

对于不含高质量同步PPG波形标签的数据集,rPPG-Toolbox提供了使用"伪"标签进行训练的选项。这些标签是通过对POS生成的PPG波形进行带通滤波和希尔伯特包络归一化得到的。

运动增强训练

rPPG-Toolbox支持使用合成的运动增强数据集进行训练,以增加rPPG视频的运动多样性。这些数据集是使用MA-rPPG Video Toolbox生成的。您可以按照以下步骤使用运动增强数据集:

- 按照MA-rPPG Video Toolbox的说明生成运动增强数据集

- 在配置文件中将

DATA_AUG参数设置为'Motion' - 运行相应的配置文件

多任务学习

rPPG-Toolbox实现了BigSmall作为示例,展示了如何扩展工具

编辑推荐精选

讯飞智文

一键生成PPT和Word,让学习生活更轻松

讯飞智文是一个利用 AI 技术的项目,能够帮助用户生成 PPT 以及各类文档。无论是商业领域的市场分析报告、年度目标制定,还是学生群体的职业生涯规划、实习避坑指南,亦或是活动策划、旅游攻略等内容,它都能提供支持,帮助用户精准表达,轻松呈现各种信息。

讯飞星火

深度推理能力全新升级,全面对标OpenAI o1

科大讯飞的星火大模型,支持语言理解、知识问答和文本创作等多功能,适用于多种文件和业务场景,提升办公和日常生活的效率。讯飞星火是一个提供丰富智能服务的平台,涵盖科技资讯、图像创作、写作辅助、编程解答、科研文献解读等功能,能为不同需求的用户提供便捷高效的帮助,助力用户轻松获取信息、解决问题,满足多样化使用场景。

Spark-TTS

一种基于大语言模型的高效单流解耦语音令牌文本到语音合成模型

Spark-TTS 是一个基于 PyTorch 的开源文本到语音合成项目,由多个知名机构联合参与。该项目提供了高效的 LLM(大语言模型)驱动的语音合成方案,支持语音克隆和语音创建功能,可通过命令行界面(CLI)和 Web UI 两种方式使用。用户可以根据需求调整语音的性别、音高、速度等参数,生成高质量的语音。该项目适用于多种场景,如有声读物制作、智能语音助手开发等。

Trae

字节跳动发布的AI编程神器IDE

Trae是一种自适应的集成开发环境(IDE),通过自动化和多元协作改变开发流程。利用Trae,团队能够更快速、精确地编写和部署代码,从而提高编程效率和项目交付速度。Trae具备上下文感知和代码自动完成功能,是提升开发效率的理想工具。

咔片PPT

AI助力,做PPT更简单!

咔片是一款轻量化在线演示设计工具,借助 AI 技术,实现从内容生成到智能设计的一站式 PPT 制作服务。支持多种文档格式导入生成 PPT,提供海量模板、智能美化、素材替换等功能,适用于销售、教师、学生等各类人群,能高效制作出高品质 PPT,满足不同场景演示需求。

讯飞绘文

选题、配图、成文,一站式创作,让内容运营更高效

讯飞绘文,一个AI集成平台,支持写作、选题、配图、排版和发布。高效生成适用于各类媒体的定制内容,加速品牌传播,提升内容营销效果。

材料星

专业的AI公文写作平台,公文写作神器

AI 材料星,专业的 AI 公文写作辅助平台,为体制内工作人员提供高效的公文写作解决方案。拥有海量公文文库、9 大核心 AI 功能,支持 30 + 文稿类型生成,助力快速完成领导讲话、工作总结、述职报告等材料,提升办公效率,是体制打工人的得力写作神器。

openai-agents-python

OpenAI Agents SDK,助力开发者便捷使用 OpenAI 相关功能。

openai-agents-python 是 OpenAI 推出的一款强大 Python SDK,它为开发者提供了与 OpenAI 模型交互的高效工具,支持工具调用、结果处理、追踪等功能,涵盖多种应用场景,如研究助手、财务研究等,能显著提升开发效率,让开发者更轻松地利用 OpenAI 的技术优势。

Hunyuan3D-2

高分辨率纹理 3D 资产生成

Hunyuan3D-2 是腾讯开发的用于 3D 资产生成的强大工具,支持从文本描述、单张图片或��多视角图片生成 3D 模型,具备快速形状生成能力,可生成带纹理的高质量 3D 模型,适用于多个领域,为 3D 创作提供了高效解决方案。

3FS

一个具备存储、管理和客户端操作等多种功能的分布式文件系统相关项目。

3FS 是一个功能强大的分布式文件系统项目,涵盖了存储引擎、元数据管理、客户端工具等多个模块。它支持多种文件操作,如创建文件和目录、设置布局等,同时具备高效的事件循环、节点选择和协程池管理等特性。适用于需要大规模数据存储和管理的场景,能够提高系统的性能和可靠性,是分布式存储领域的优质解决方案。

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号