Safeguards Shield: 为AI应用保驾护航的安全卫士

在人工智能技术日新月异的今天,如何安全可靠地使用大语言模型(LLM)已成为开发者们面临的一大挑战。Safeguards Shield应运而生,为开发者提供了一套强大的工具包,旨在帮助构建更加安全、可靠的AI应用程序。让我们一起深入了解这个创新的项目,看看它如何为AI应用保驾护航。

什么是Safeguards Shield?

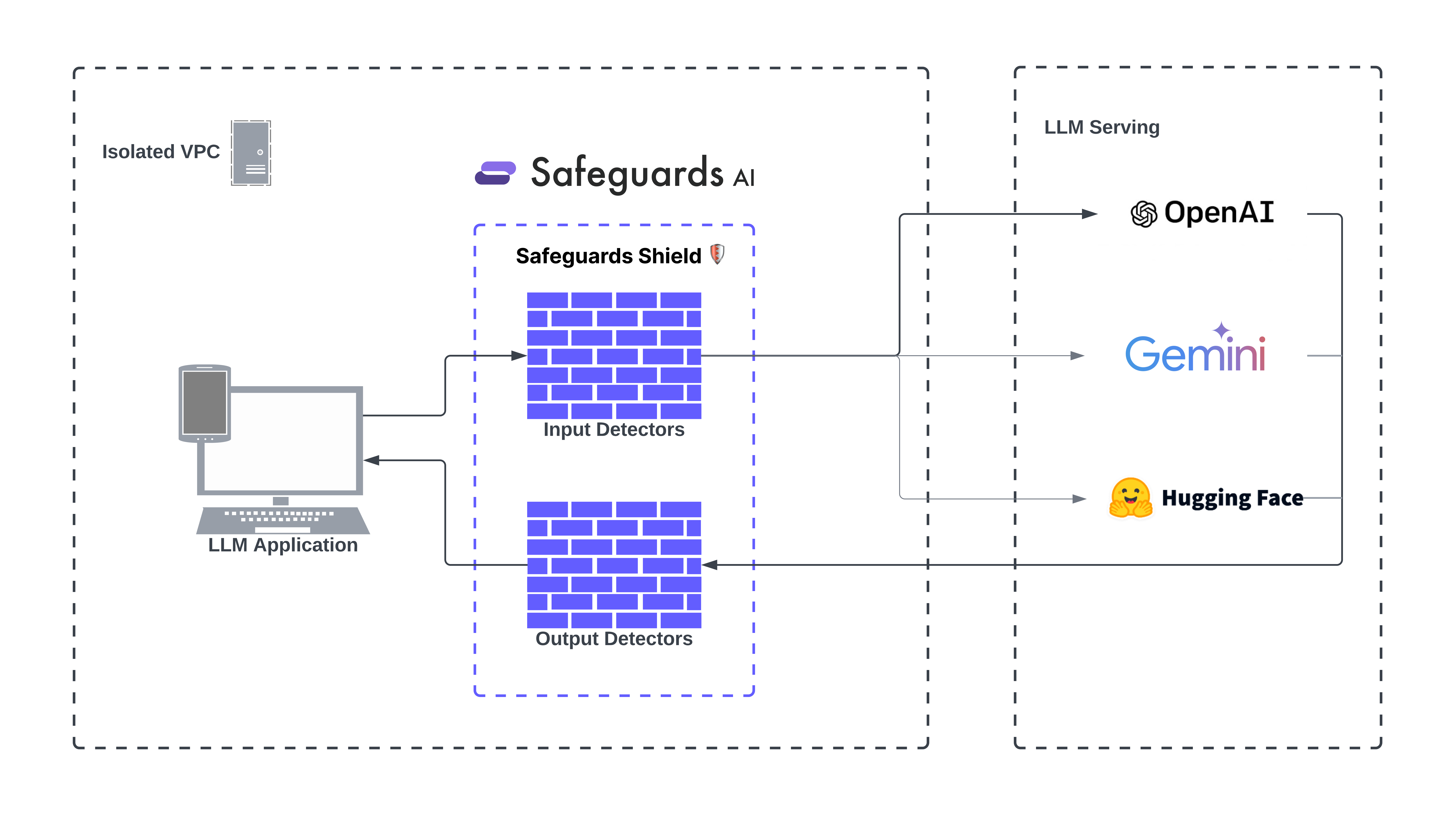

Safeguards Shield是一个专为开发者设计的工具包,其主要目标是帮助开发者安全、可靠地使用大语言模型。它通过为生成式AI应用程序提供一层保护屏障,有效地防范恶意输入,并对模型输出进行过滤。这个综合性的工具包内置了20多个即用型检测器,可以为您的GenAI应用程序在工作流程中提供强大的保护。

Safeguards Shield的主要特性

-

多层防护机制: Safeguards Shield采用了多层防护策略,包括启发式检测器、基于LLM的检测以及向量数据库,为您的AI应用提供全方位的保护。

-

风险防范: 该工具包可以有效防范诸如毒性、偏见、个人信息泄露等昂贵的风险,确保AI应用的安全性和可靠性。

-

幻觉检测与度量: Safeguards Shield提供了专门的工具,用于减少和测量无根据的添加(即所谓的"幻觉"),提高AI输出的准确性。

-

自定义行为: 开发者可以根据需求自定义和确保LLM的行为安全可靠,灵活适应不同应用场景。

-

监控与度量: 该工具包还提供了监控事件、成本和负责任AI指标的功能,帮助开发者全面了解AI应用的运行状况。

Safeguards Shield的优势

-

降低风险: 通过使用Safeguards Shield,开发者可以有效降低LLM在可靠性和安全性方面的风险,为AI应用保驾护航。

-

加速开发: 该工具包可以帮助开发者更快地将AI应用从原型阶段推进到生产阶段,同时保持高度的信心。

-

全面保护: Safeguards Shield为GenAI应用提供了一层全面的保护层,有效防范恶意输入并过滤模型输出,确保应用的安全性。

-

灵活定制: 开发者可以根据具体需求自定义LLM的行为,确保其安全性和可靠性,适应不同的应用场景。

-

性能监控: 通过内置的监控功能,开发者可以实时跟踪事件、成本和负责任AI指标,及时发现和解决潜在问题。

如何使用Safeguards Shield?

要开始使用Safeguards Shield,开发者可以按照以下步骤进行:

- 访问Safeguards Shield的GitHub仓库。

- 按照仓库中的安装说明进行安装。

- 参考文档和示例,将Safeguards Shield集成到您的AI应用中。

- 根据需求配置和自定义保护规则。

- 运行并监控您的AI应用,享受Safeguards Shield带来的安全保障。

Safeguards Shield的应用场景

Safeguards Shield可以在多种AI应用场景中发挥重要作用:

- 客户服务聊天机器人: 确保聊天机器人的回复不含有不当或有害内容。

- 内容生成系统: 防止生成的内容中出现偏见、歧视或不准确信息。

- 代码辅助工具: 检测并防止生成的代码中可能存在的安全漏洞。

- 医疗诊断辅助: 确保AI辅助诊断的准确性和可靠性,防止出现严重错误。

- 金融分析工具: 保护敏感金融信息,防止模型输出中包含机密数据。

未来展望

随着AI技术的不断发展,Safeguards Shield也将持续进化,以应对新出现的挑战和需求。未来,我们可以期待看到:

- 更多类型的检测器和防护机制

- 与更多LLM和AI平台的集成

- 更强大的自定义和可视化工具

- 针对特定行业的专门解决方案

- 更深入的AI安全研究和最佳实践指南

结语

Safeguards Shield为开发者提供了一个强大而灵活的工具包,帮助他们构建更安全、更可靠的AI应用程序。通过多层防护机制、风险防范、自定义行为和全面监控,Safeguards Shield正在为AI应用的安全发展铺平道路。无论您是刚开始探索AI应用开发,还是已经在生产环境中部署了AI系统,Safeguards Shield都能为您提供宝贵的支持和保护。

让我们携手共同努力,构建一个更安全、更可靠的AI未来!

🔗 相关链接:

通过使用Safeguards Shield,开发者可以更加自信地探索AI的无限可能,同时确保应用程序的安全性和可靠性。让我们一起为构建负责任的AI生态系统贡献力量!