引言

在计算机视觉和图形学领域,将真实世界的图像自动转换为高质量的动漫风格场景一直是一个具有挑战性的任务。这项技术不仅可以为动画制作和游戏开发提供便利,还能为普通用户提供有趣的图像处理体验。然而,由于真实场景的复杂性、动漫风格的独特性以及高质量数据集的缺乏,这一任务长期以来都难以实现令人满意的效果。

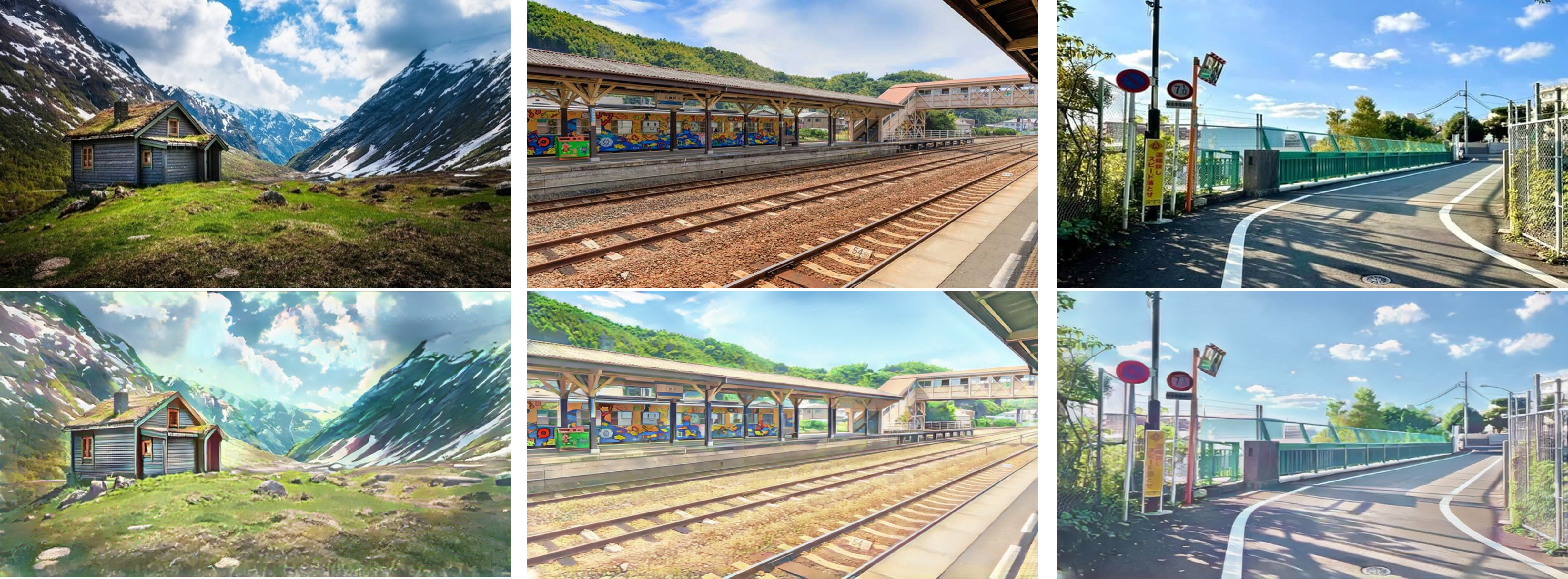

近日,南洋理工大学MMLab实验室的研究人员提出了一种名为Scenimefy的创新方法,为解决这一难题带来了突破性的进展。Scenimefy是一个半监督的图像到图像转换框架,能够有效地将复杂的真实世界图像自动渲染成高质量的动漫场景。该研究成果已被接收到计算机视觉领域顶级会议ICCV 2023,充分体现了其在学术界的重要价值。

Scenimefy的核心技术

Scenimefy框架的核心在于其创新的半监督学习方法。传统的图像风格转换通常依赖于大量配对的训练数据,即每个真实图像都需要对应一个理想的动漫风格图像。然而,获取如此大规模的高质量配对数据集是极其困难且耗时的。Scenimefy巧妙地解决了这一问题,它采用了一种结构一致的伪配对数据来指导学习过程,从而简化了纯无监督设置的复杂性。

伪配对数据生成

研究团队利用语义约束的StyleGAN模型生成了独特的伪配对数据。StyleGAN是一种强大的生成对抗网络,能够生成高质量的图像。通过在StyleGAN中引入语义约束,研究人员可以控制生成图像的内容和风格,从而创建出既保留原始场景结构,又具有动漫风格特征的图像对。

分割引导的数据选择

为了进一步提高伪配对数据的质量,Scenimefy采用了分割引导的数据选择策略。这一步骤可以筛选出那些语义一致性高、结构保留良好的图像对,为后续的学习过程提供更可靠的监督信号。

补丁级对比风格损失

Scenimefy引入了一种新颖的补丁级对比风格损失函数。这种损失函数能够在图像的局部区域内比较真实图像和生成的动漫图像的风格差异,从而更好地捕捉动漫风格的细节特征,提高生成图像的质量和风格一致性。

Scenimefy的实现与应用

Scenimefy的实现过程中,研究团队充分考虑了实用性和可扩展性。他们不仅开发了完整的训练和推理代码,还提供了便捷的安装和使用说明,使得其他研究者和开发者能够轻松地复现和改进这一技术。

安装与环境配置

要使用Scenimefy,用户首先需要克隆项目仓库并安装依赖包:

git clone https://github.com/Yuxinn-J/Scenimefy.git

cd Scenimefy

conda env create -f Semi_translation/environment.yml

这一步骤会创建一个包含所有必要依赖的Conda环境,确保Scenimefy能够在各种系统上顺利运行。

快速推理

Scenimefy提供了两种快速推理的方式:Python脚本和Gradio演示。

对于Python脚本方式,用户需要首先下载预训练模型:

wget https://github.com/Yuxinn-J/Scenimefy/releases/download/v0.1.0/Shinkai_net_G.pth -P Semi_translation/pretrained_models/shinkai-test/

然后运行推理命令:

cd Semi_translation

python test.py --dataroot ./datasets/Sample --name shinkai-test --CUT_mode CUT --model cut --phase test --epoch Shinkai --preprocess none

这将在./Semi_translation/results/shinkai-test/目录下生成转换后的图像。

对于那些喜欢图形界面的用户,Scenimefy还提供了基于Gradio的在线演示。用户可以通过以下步骤启动本地演示:

git clone https://huggingface.co/spaces/YuxinJ/Scenimefy

pip install -r requirements.txt

pip install gradio

python app.py

此外,研究团队还在Hugging Face平台上托管了一个在线演示,让用户无需本地安装即可体验Scenimefy的强大功能。

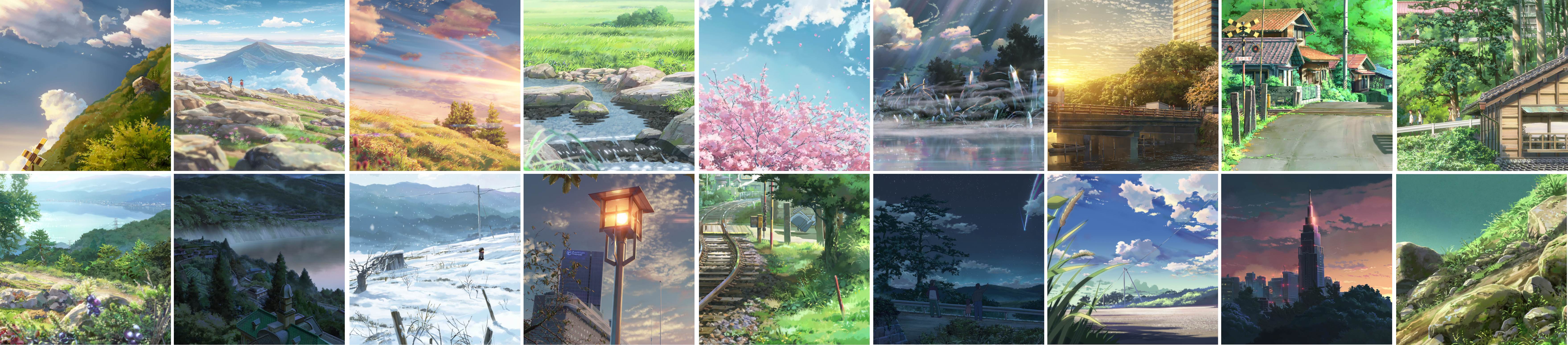

高质量动漫场景数据集

作为Scenimefy项目的一部分,研究团队还构建了一个高质量的动漫场景数据集。这个数据集包含5,958张具有以下特点的图像:

- 高分辨率(1080×1080)

- 新海诚风格(来自9部新海诚电影)

- 纯动漫场景:通过手动筛选,去除了不相关和低质量的图像

虽然由于版权原因,研究团队无法直接发布这些动漫图像,但他们提供了详细的数据集准备指南,让其他研究者能够方便地重现这一宝贵资源。

Scenimefy的优势与创新

Scenimefy在多个方面展现出了显著的优势和创新:

-

半监督学习:通过引入伪配对数据,Scenimefy巧妙地解决了动漫风格转换中数据稀缺的问题,大大降低了对大规模标注数据的依赖。

-

语义一致性:利用语义约束的StyleGAN生成伪配对数据,确保了生成图像在保留动漫风格的同时,能够很好地保持原始场景的语义结构。

-

细节保留:补丁级对比风格损失的引入,使得Scenimefy能够更好地捕捉和重现动漫风格的细微特征,生成的图像更加精致和逼真。

-

高效性:相比于传统方法,Scenimefy在计算效率和资源利用上都有显著提升,使得大规模的动漫风格转换成为可能。

-

可扩展性:Scenimefy的设计考虑了可扩展性,不仅适用于新海诚风格,还可以通过调整和微调适应其他动漫风格。

未来展望

Scenimefy的成功为动漫风格转换领域开辟了新的研究方向。未来,研究团队计划在以下几个方面进行深入:

-

风格多样性:探索如何在一个统一的框架内实现多种动漫风格的转换,增加模型的versatility。

-

实时渲染:优化模型结构和推理过程,争取实现实时的动漫风格转换,为视频处理和实时应用铺平道路。

-

个性化定制:研究如何让用户更灵活地控制转换过程,实现风格强度的调节和局部区域的精细控制。

-

跨模态应用:探索将Scenimefy的技术扩展到其他领域,如文本到图像生成、3D模型风格化等。

结语

Scenimefy作为一种创新的半监督图像到图像转换框架,成功地解决了将复杂真实场景自动渲染为高质量动漫风格图像的挑战。它不仅在学术界引起了广泛关注,也为动画制作、游戏开发等行业提供了有力的技术支持。随着技术的不断完善和应用范围的扩大,我们可以期待Scenimefy在未来为创意产业带来更多令人兴奋的可能性。

对于那些对计算机视觉和图形学感兴趣的研究者和开发者来说,Scenimefy无疑是一个值得深入研究和实践的项目。通过探索其源代码、尝试不同的数据集和参数设置,相信会有更多创新的应用场景被发掘出来。让我们共同期待Scenimefy及其衍生技术在推动动漫艺术与科技融合方面发挥更大的作用。