SiamMOT: 创新的多目标跟踪网络

SiamMOT: 多目标跟踪的新突破

在计算机视觉领域,多目标跟踪(MOT)一直是一个充满挑战性的研究方向。如何在复杂场景中准确、高效地跟踪多个目标,是学术界和工业界共同关注的问题。近日,由亚马逊科学团队开发的SiamMOT(Siamese Multi-Object Tracking)网络在这一领域取得了重大突破,为多目标跟踪任务带来了新的解决方案。

SiamMOT的核心原理

SiamMOT是一种基于区域的孪生多目标跟踪网络,其核心创新在于将目标检测和目标关联这两个关键步骤融合到了一个统一的端到端网络中。传统的跟踪方法通常采用"检测-关联"的两阶段策略,而SiamMOT通过巧妙的网络设计,实现了检测和关联的同步进行,大大提高了算法的效率和性能。

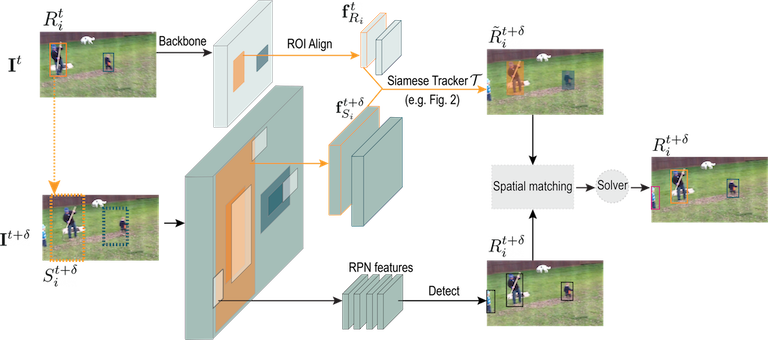

如上图所示,SiamMOT的网络架构主要包括以下几个关键模块:

-

特征提取网络:用于从输入图像中提取丰富的视觉特征。

-

区域提议网络:基于提取的特征生成可能包含目标的候选区域。

-

运动模型:估计目标在相邻帧之间的运动信息。

-

关联模块:将检测到的目标实例与前一帧的轨迹进行关联。

这种设计使得SiamMOT能够充分利用时序信息和空间信息,在准确性和实时性之间取得了很好的平衡。

SiamMOT的主要特点

-

端到端训练:SiamMOT采用端到端的训练方式,避免了传统方法中检测和关联两个阶段相互独立的问题,使网络能够学习到更加优化的特征表示。

-

高效的运动建模:SiamMOT引入了一个专门的运动模型,用于估计目标在相邻帧之间的运动。这一设计大大提高了目标关联的准确性,尤其是在处理快速运动或遮挡场景时表现出色。

-

灵活的架构:SiamMOT支持隐式和显式两种运动建模方式,研究人员可以根据具体应用场景选择合适的模型变体。

-

强大的泛化能力:通过在大规模数据集上进行训练,SiamMOT展现出了优秀的泛化能力,能够适应各种复杂的跟踪场景。

突出的性能表现

SiamMOT在多个权威的MOT数据集上进行了广泛的实验评估,取得了令人瞩目的成绩:

-

MOT17数据集:SiamMOT在这一广泛使用的行人跟踪数据集上显著超越了现有的最先进方法。

-

TAO-person数据集:在这个更具挑战性的长时视频跟踪数据集上,SiamMOT同样展现出了优异的性能。

-

Caltech Roadside Pedestrians数据集:SiamMOT在处理复杂的道路场景时表现出色,为智能交通系统提供了有力支持。

-

HiEve数据集:在ACM MM'20 HiEve Grand Challenge比赛中,SiamMOT击败了其他参赛者,展示了其在处理高度拥挤和复杂场景中的优势。

除了准确性,SiamMOT在计算效率方面也表现突出。在单个现代GPU上,SiamMOT能够以17FPS的速度处理720P视频,这意味着它完全能够满足实时应用的需求。

应用前景与未来发展

SiamMOT的出现为多目标跟踪领域带来了新的机遇,其潜在的应用场景十分广泛:

-

智能安防:SiamMOT可用于大规模视频监控系统,实现对可疑人员或物体的实时跟踪和分析。

-

自动驾驶:在复杂的道路环境中,SiamMOT可以帮助自动驾驶系统准确识别和跟踪周围的车辆、行人和其他交通参与者。

-

体育赛事分析:SiamMOT能够精确跟踪运动员的移动轨迹,为战术分析和比赛回放提供数据支持。

-

零售业客流分析:在商场等公共场所,SiamMOT可用于分析客流patterns,优化空间布局和服务流程。

-

机器人导航:SiamMOT可以帮助移动机器人更好地感知和理解周围环境,实现更智能的导航和交互。

尽管SiamMOT已经展现出了卓越的性能,但研究团队表示,这只是多目标跟踪技术发展的一个新起点。未来,他们计划从以下几个方面进一步改进SiamMOT:

- 提高对小目标和部分遮挡目标的跟踪能力。

- 探索更高效的网络架构,进一步提升实时性能。

- 研究如何更好地利用长时序信息,提高长时间跟踪的稳定性。

- 将SiamMOT与其他计算机视觉任务(如行为识别、异常检测等)进行结合,开发更加智能的视觉分析系统。

开源与社区合作

值得一提的是,SiamMOT项目已在GitHub上开源(https://github.com/amazon-science/siam-mot),这为整个计算机视觉社区带来了巨大价值。研究人员和开发者可以直接访问SiamMOT的源代码、预训练模型和相关文档,这不仅有助于复现研究结果,也为进一步的改进和创新提供了基础。

项目团队还提供了详细的安装指南、演示代码和预训练模型,大大降低了使用门槛。例如,用户可以通过简单的命令来运行SiamMOT的演示:

python3 demos/demo.py --demo-video PATH_TO_DEMO_VIDE --track-class person --dump-video True

这种开放和协作的态度,无疑将加速多目标跟踪技术的发展和应用落地。

结语

SiamMOT的出现,标志着多目标跟踪技术进入了一个新的阶段。它不仅在性能上取得了突破,更重要的是提供了一种新的思路,即如何将深度学习的强大表征能力与传统计算机视觉的先验知识有机结合。随着技术的不断完善和应用范围的扩大,我们有理由相信,SiamMOT将在未来的智能视觉系统中发挥越来越重要的作用,为构建更安全、更高效、更智能的世界贡献力量。

编辑推荐精选

openai-agents-python

OpenAI Agents SDK,助力开发者便捷使用 OpenAI 相关功能。

openai-agents-python 是 OpenAI 推出的一款强大 Python SDK,它为开发者提供了与 OpenAI 模型交互的高效工具,支持工具调用、结果处理、追踪等功能,涵盖多种应用场景,如研究助手、财务研究等,能显著提升开发效率,让开发者更轻松地利用 OpenAI 的技术优势。

Hunyuan3D-2

高分辨率纹理 3D 资产生成

Hunyuan3D-2 是腾讯开发的用于 3D 资产生成的强大工具,支持从文本描述、单张图片或多视角图片生成 3D 模型,具备快速形状生成能力,可生成带纹理的高质量 3D 模型,适用于多个领域,为 3D 创作提供了高效解决方案。

3FS

一个具备存储、管理和客户端操作等多种功能的分布式文件系统相关项目。

3FS 是一个功能强大的分布式文件系统项目,涵盖了存储引擎、元数据管理、客户端工具等多个模块。它支持多种文件操作,如创建文件和目录、设置布局等,同时具备高效的事件循环、节点选择和协程池管理等特性。适用于需要大规模数据存储和管理的场景,能够提高系统的性能和可靠性,是分布式存储领域的优质解决方案。

TRELLIS

用于可扩展和多功能 3D 生成的结构化 3D 潜在表示

TRELLIS 是一个专注于 3D 生成的项目,它利用结构化 3D 潜在表示技术,实现了可扩展且多功能的 3D 生成。项目提供了多种 3D 生成的方法和工具,包括文本到 3D、图像到 3D 等,并且支持多种输出格式,如 3D 高斯、辐射场和网格等。通过 TRELLIS,用户可以根据文本描述或图像输入快速生成高质量的 3D 资产,适用于游戏开发、动画制作、虚拟现实等多个领域。

ai-agents-for-beginners

10 节课教你开启构建 AI 代理所需的一切知识

AI Agents for Beginners 是一个专为初学者打造的课程项目,提供 10 节课程,涵盖构建 AI 代理的必备知识,支持多种语言,包含规划设计、工具使用、多代理等丰富内容,助您快速入门 AI 代理领域。

AEE

AI Excel全自动制表工具

AEE 在线 AI 全自动 Excel 编辑器,提供智能录入、自动公式、数据整理、图表生成等功能,高效处理 Excel 任务,提升办公效率。支持自动高亮数据、批量计算、不规则数据录入,适用于企业、教育、金融等多场景。

UI-TARS-desktop

基于 UI-TARS 视觉语言模型的桌面应用,可通过自然语言控制计算机进行多模态操作。

UI-TARS-desktop 是一款功能强大的桌面应用,基于 UI-TARS(视觉语言模型)构建。它具备自然语言控制、截图与视觉识别、精确的鼠标键盘控制等功能,支持跨平台使用(Windows/MacOS),能提供实时反馈和状态显示,且数据完全本地处理,保障隐私安全。该应用集成了多种大语言模型和搜索方式,还可进行文件系统操作。适用于需要智能交互和自动化任务的场景,如信息检索、文件管理等。其提供了详细的文档,包括快速启动、部署、贡献指南和 SDK 使用说明等,方便开发者使用和扩展。

Wan2.1

开源且先进的大规模视频生成模型项目

Wan2.1 是一个开源且先进的大规模视频生成模型项目,支持文本到图像、文本到视频、图像到视频等多种生成任务。它具备丰富的配置选项,可调整分辨率、扩散步数等参数,还能对提示词进行增强。使用了多种先进技术和工具,在视频和图像生成领域具有广泛应用前景,适合研究人员和开发者使用。

爱图表

全流程 AI 驱动的数据可视化工具,助力用户轻松创作高颜值图表

爱图表(aitubiao.com)就是AI图表,是由镝数科技推出的一款创新型智能数据可视化平台,专注于为用户提供便捷的图表生成、数据分析和报告撰写服务。爱图表是中国首个在图表场景接入DeepSeek的产品。通过接入前沿的DeepSeek系列AI模型,爱图表结合强大的数据处理能力与智能化功能,致力于帮助职场人士高效处理和表达数据,提升工作效率和报告质量。

Qwen2.5-VL

一款强大的视觉语言模型,支持图像和视频输入

Qwen2.5-VL 是一款强大的视觉语言模型,支持图像和视频输入,可用于多种场景,如商品特点总结、图像文字识别等。项目提供了 OpenAI API 服务、Web UI 示例等部署方式,还包含了视觉处理工具,有助于开发者快速集成和使用,提升工作效率。

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号