Stable Diffusion WebUI简介

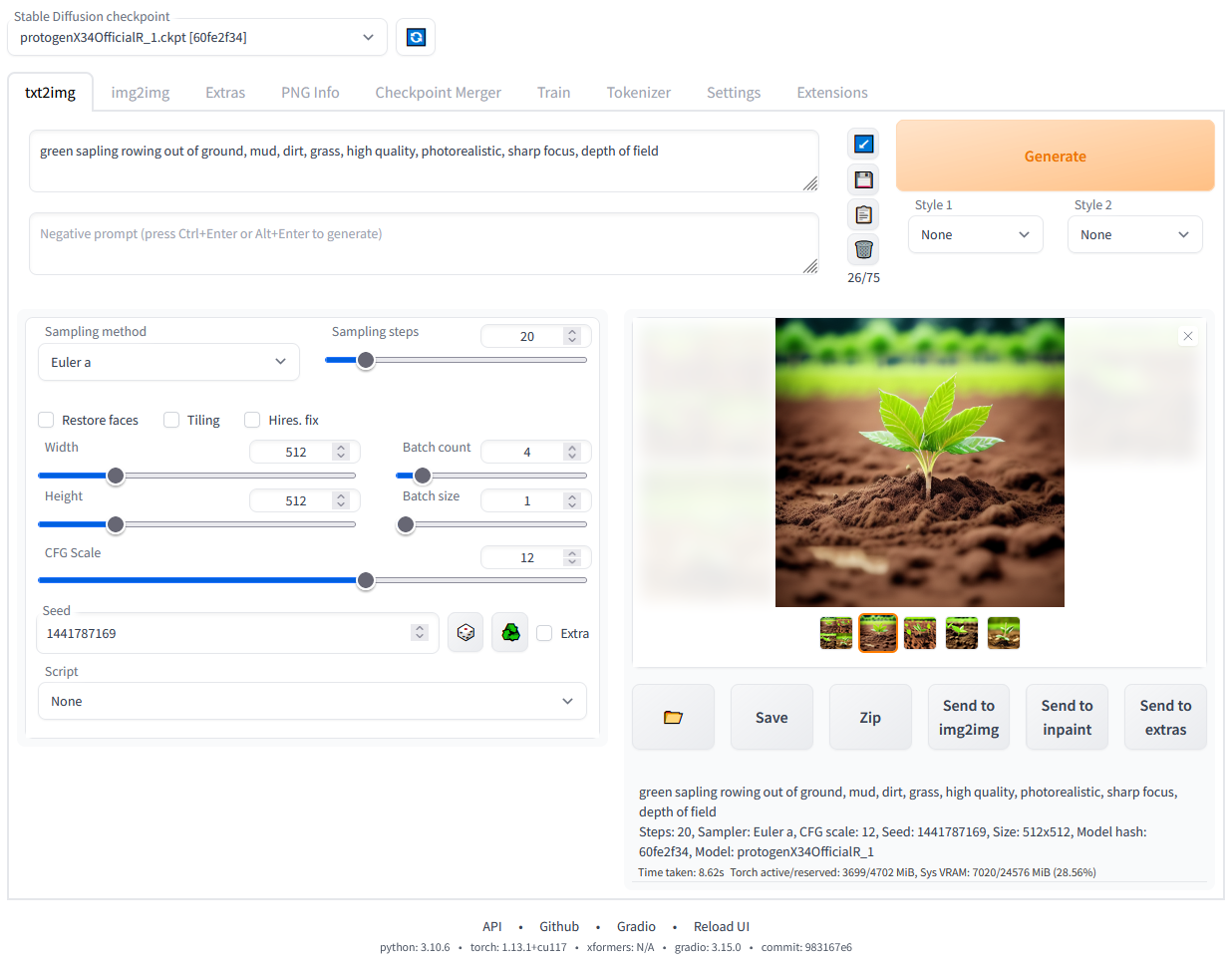

Stable Diffusion WebUI是一个基于Gradio库实现的Stable Diffusion Web界面,为用户提供了一个功能强大且易于使用的AI图像生成工具。它由GitHub用户AUTOMATIC1111开发并开源,受到了广泛的欢迎和使用。

作为一个开源项目,Stable Diffusion WebUI汇集了众多开发者的智慧,不断增加新功能并优化用户体验。它支持多种操作系统和硬件平台,可以在普通家用电脑上运行,也可以利用云服务获得更强大的性能。

主要特性

Stable Diffusion WebUI提供了丰富的功能,以下是一些主要特性:

-

支持文本生成图像(txt2img)和图像到图像(img2img)两种基本模式

-

一键安装脚本,简化了安装过程(但仍需自行安装Python和Git)

-

支持局部重绘(Inpainting)和外部扩展(Outpainting)

-

提供色彩草图功能,可以通过简单的色彩涂抹引导生成

-

支持提示词矩阵,可以批量生成不同提示词组合的图像

-

内置多种上采样算法,可以提高生成图像的分辨率

-

支持注意力控制,可以强调或弱化提示词中的特定部分

-

支持循环处理,可以多次应用img2img来逐步优化结果

-

提供X/Y/Z图表功能,可以可视化不同参数对结果的影响

-

支持文本反转(Textual Inversion),可以学习自定义概念

-

内置多种图像后处理工具,如面部修复、超分辨率等

-

支持负面提示词,可以指定不希望出现在结果中的元素

-

可以保存和加载样式预设,方便重复使用常用提示词

-

支持生成图像变体,可以微调已有结果

-

内置CLIP interrogator,可以分析图像并生成对应的提示词

-

支持在生成过程中编辑提示词,实现中途改变生成目标

-

提供批处理功能,可以批量处理多个文件

-

支持高分辨率修复,一键生成高质量大图

-

可以动态重新加载模型,无需重启程序

-

提供checkpoint合并功能,可以混合多个模型

-

支持自定义脚本,可以通过扩展增加新功能

-

集成了xformers优化,可以显著提升某些显卡的性能

-

提供API接口,方便与其他程序集成

安装和使用

Stable Diffusion WebUI的安装过程相对简单,主要步骤如下:

-

安装Python 3.10.6和Git

-

克隆项目仓库:

git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui.git -

运行webui-user.bat(Windows)或webui.sh(Linux/MacOS)

-

等待自动下载和安装依赖

-

在浏览器中打开http://localhost:7860即可使用

对于不同的操作系统和硬件,可能需要一些额外的配置。详细的安装说明可以参考项目的wiki页面。

使用技巧

要充分发挥Stable Diffusion WebUI的潜力,以下是一些实用技巧:

-

仔细编写提示词,使用详细和具体的描述来引导生成

-

利用负面提示词排除不想要的元素

-

尝试不同的采样器和步数,找到最适合的设置

-

使用img2img模式微调结果,逐步接近理想效果

-

善用局部重绘功能修复不满意的细节

-

尝试不同的模型和VAE,它们会影响生成风格

-

使用ControlNet等扩展增强对生成过程的控制

-

保存常用的设置和提示词作为样式预设

-

使用批处理功能批量生成多个变体

-

关注社区分享的新模型、Lora和扩展

结语

Stable Diffusion WebUI作为一个功能丰富、易于使用的AI图像生成工具,为创作者们提供了强大的创作辅助。它不仅可以用于艺术创作,还可以应用于设计、游戏开发等多个领域。随着AI技术的不断发展和社区的持续贡献,我们可以期待Stable Diffusion WebUI在未来会变得更加强大和易用,为更多人带来AI创作的乐趣。