SwiftInfer:推动AI推理技术的新篇章

在人工智能快速发展的今天,高效的推理技术对于大规模语言模型的实际应用至关重要。SwiftInfer作为一个新兴的AI推理框架,正在为这一领域带来新的可能性。本文将全面介绍SwiftInfer的特点、应用场景以及其在AI推理领域的重要意义。

SwiftInfer的诞生背景

SwiftInfer是由HPCAITech团队开发的一个开源项目,其核心目标是提供高效的AI推理和服务能力。该项目的灵感来源于MIT Han实验室提出的StreamingLLM技术,SwiftInfer通过将这一技术与NVIDIA的TensorRT-LLM相结合,实现了更高效的推理性能。

StreamingLLM是一种支持无限输入长度的LLM推理技术,它利用"注意力沉淀"(Attention Sink)机制来防止模型在注意力窗口移动时崩溃。SwiftInfer将这一创新性技术与TensorRT-LLM的高性能推理能力相结合,为用户提供了一个更加生产级别的解决方案。

SwiftInfer的核心特性

-

高效推理:SwiftInfer基于TensorRT-LLM构建,充分利用了GPU的计算能力,实现了快速、高效的模型推理。

-

支持长文本输入:得益于StreamingLLM技术,SwiftInfer能够处理超长的输入文本,突破了传统LLM在输入长度上的限制。

-

生产级别的实现:SwiftInfer的设计考虑了实际生产环境的需求,提供了更稳定、可靠的推理服务。

-

开源与可定制:作为一个开源项目,SwiftInfer允许开发者根据自身需求进行定制和优化。

SwiftInfer的安装与使用

SwiftInfer的安装过程相对简单,但需要注意一些前提条件。首先,用户需要安装TensorRT-LLM V0.6.0版本。SwiftInfer团队提供了两种安装方式:使用Docker和不使用Docker的本地安装。

使用Docker安装

对于使用Docker的用户,可以按照以下步骤安装SwiftInfer:

-

克隆SwiftInfer仓库:

git clone https://github.com/hpcaitech/SwiftInfer.git -

进入SwiftInfer目录:

cd SwiftInfer -

使用pip安装:

pip install .

本地安装

对于不使用Docker的用户,SwiftInfer提供了一个自动安装TensorRT-LLM的脚本。在运行安装脚本之前,需要确保系统已安装以下软件包:

- Python

- 构建工具(gcc/g++, make, cmake)

- CUDA工具包

- cuDNN

- NCCL

- TensorRT

- PyTorch

安装命令如下:

git clone https://github.com/hpcaitech/SwiftInfer.git

cd SwiftInfer

TRT_ROOT=xxx NCCL_ROOT=xxx CUDNN_ROOT=xxx pip install .

运行Llama示例

SwiftInfer提供了一个基于Llama模型的示例,用户可以通过这个示例快速体验SwiftInfer的功能。运行示例之前,需要先克隆Hugging Face上的Llama-2-7b-chat-hf模型仓库。

运行示例的步骤如下:

-

构建TensorRT引擎:

python build.py --model_dir <model-dir> --dtype float16 --enable_context_fmha --use_gemm_plugin float16 --max_input_len 2048 --max_output_len 1024 --output_dir ./output/7B-streaming-8k-1k-4-2000/trt_engines/fp16/1-gpu/ --max_batch_size 1 -

下载MT-Bench数据:

mkdir mt_bench_data wget -P ./mt_bench_data https://raw.githubusercontent.com/lm-sys/FastChat/main/fastchat/llm_judge/data/mt_bench/question.jsonl -

运行对话示例:

python ../run_conversation.py --max_input_length 2048 --max_output_len 1024 --tokenizer_dir <model-dir> --engine_dir ./output/7B-streaming-8k-1k-4-2000/trt_engines/fp16/1-gpu/ --input_file ./mt_bench_data/question.jsonl --streaming_llm_start_size 4 --only_n_first 5

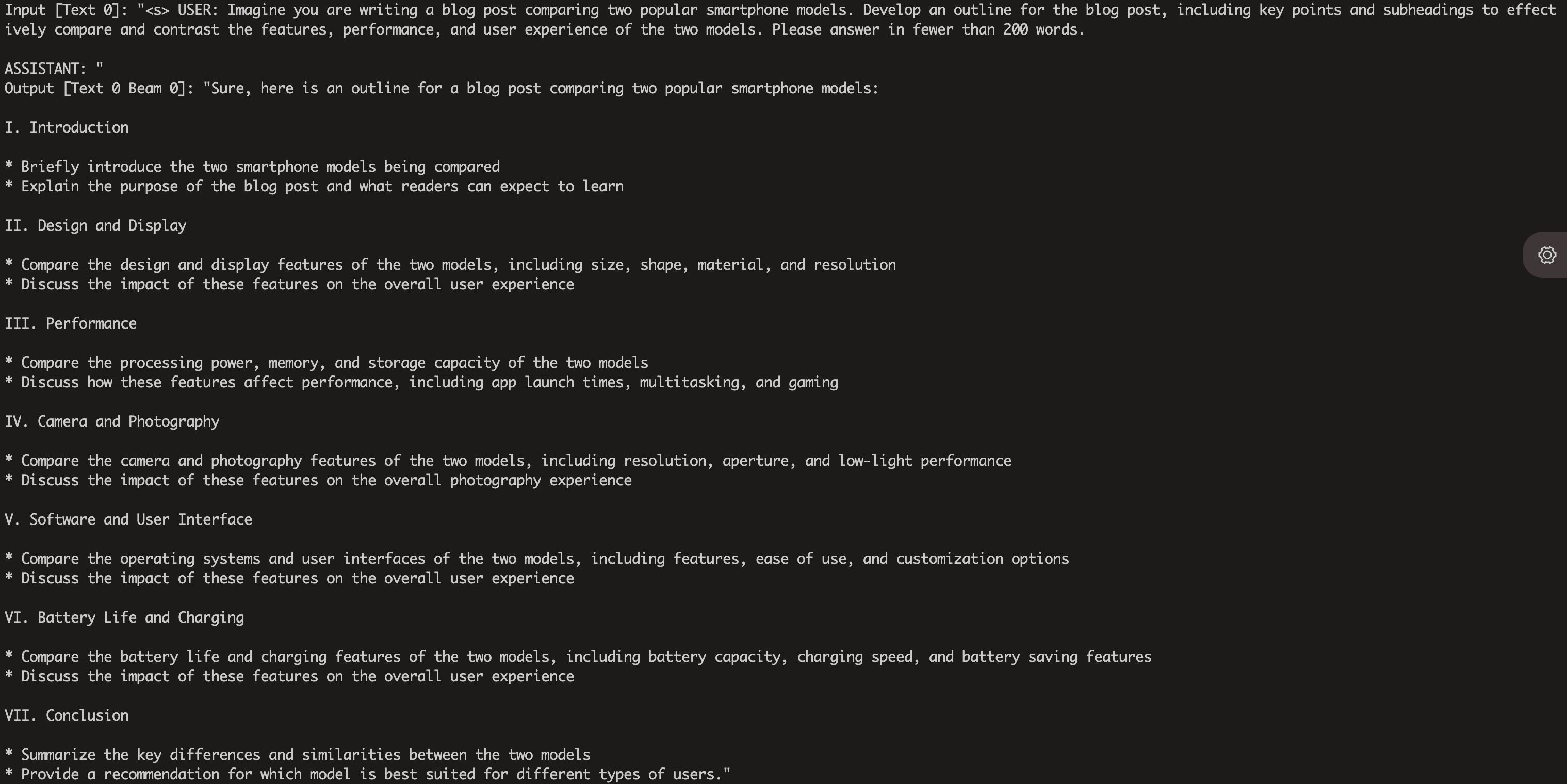

SwiftInfer的性能优势

SwiftInfer团队对比了自己的实现与原始PyTorch版本的StreamingLLM性能。测试环境使用了Nvidia H800 GPU,Intel Xeon Platinum 8468 CPU,以及2TB内存。

测试结果显示,SwiftInfer在处理20轮对话时,相比原始PyTorch实现有显著的性能提升。这一结果充分展示了SwiftInfer在实际应用中的优势。

SwiftInfer的未来发展

SwiftInfer团队已经规划了未来的发展路线,包括:

- 基于TRT-LLM API实现Streaming-LLM注意力机制

- KV缓存适配

- 早停机制适配

- 连续张量修复

- 多轮对话的Llama示例

这些计划显示了SwiftInfer团队对持续优化和扩展功能的承诺,有望为用户带来更多实用的特性和性能提升。

SwiftInfer的开源贡献

SwiftInfer作为一个开源项目,不仅为AI推理技术的发展做出了贡献,也为整个开源社区提供了宝贵的资源。项目团队鼓励开发者参与贡献,包括提交问题、改进代码、扩展功能等。

对于希望引用SwiftInfer的研究者和开发者,项目提供了标准的引用格式:

@misc{streamingllmtrt2023,

title = {SwiftInfer},

year = {2023},

publisher = {GitHub},

journal = {GitHub repository},

howpublished = {\url{https://github.com/hpcaitech/SwiftInfer}},

}

结语

SwiftInfer作为一个新兴的AI推理框架,通过结合StreamingLLM和TensorRT-LLM的优势,为大规模语言模型的高效推理提供了新的解决方案。它不仅支持长文本输入,还实现了显著的性能提升,为AI应用的落地提供了强有力的支持。

随着AI技术的不断发展,高效的推理框架将扮演越来越重要的角色。SwiftInfer的出现无疑为这一领域注入了新的活力。我们期待看到SwiftInfer在未来的持续发展,以及它在各种AI应用场景中的广泛应用。

对于有兴趣深入了解或使用SwiftInfer的开发者,可以访问SwiftInfer的GitHub仓库获取更多信息和最新更新。让我们共同期待SwiftInfer为AI推理技术带来的更多突破和创新!