TheChosenOne:让AI生成的角色更加一致

在人工智能生成图像的领域,如何让生成的角色保持一致性一直是一个挑战。近日,一个名为TheChosenOne的开源项目为解决这个问题提供了新的思路。该项目是对论文《The Chosen One: Consistent Characters in Text-to-Image Diffusion Models》的非官方实现,旨在使用扩散模型生成具有一致性的角色图像。

项目背景与目标

文本到图像的生成模型在近年来取得了巨大的进展,但在生成连续一致的角色方面仍存在困难。比如,当我们要求AI多次生成同一个角色的不同场景图像时,生成的角色往往会有很大的差异,难以保持一致性。TheChosenOne项目正是为了解决这个问题而生。

该项目的核心目标是:

- 实现一种能够生成一致性角色的文本到图像扩散模型

- 提供一个易于使用的框架,让研究人员和开发者可以快速上手

- 探索扩散模型在角色生成方面的潜力

技术实现

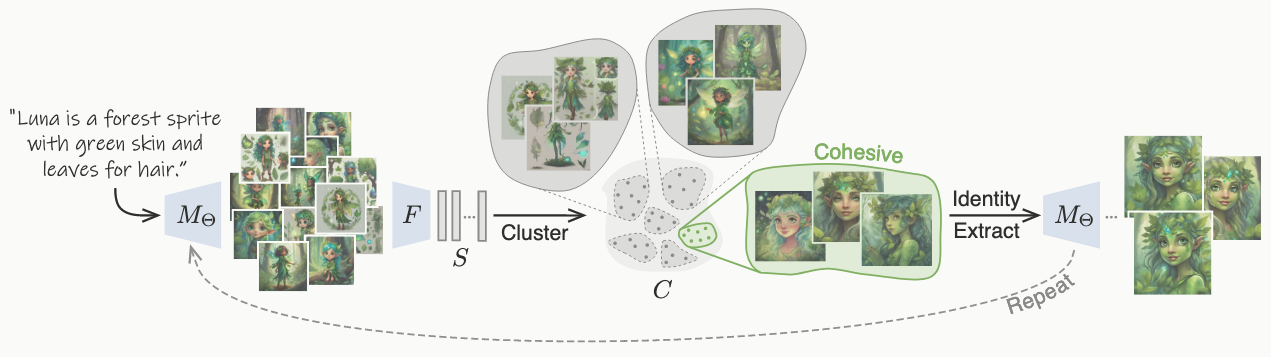

TheChosenOne项目主要基于PyTorch和Diffusers框架实现。其核心思想是通过多次迭代和聚类来"选择"出最具代表性的角色特征,从而在后续生成中保持一致性。

项目的主要流程包括:

- 初始图像生成:根据文本描述生成一批初始角色图像

- 特征提取:使用预训练的视觉模型(如DINOv2)提取图像特征

- 聚类分析:对提取的特征进行K-means聚类,找出最具代表性的簇

- 模型微调:使用聚类结果对扩散模型进行微调

- 一致性生成:使用微调后的模型生成具有一致性的角色图像

使用指南

要使用TheChosenOne项目,首先需要安装相关依赖:

git clone https://github.com/huggingface/diffusers

cd diffusers

pip install .

git clone git@github.com:ZichengDuan/TheChosenOne.git

cd TheChosenOne

pip install -r requirements.txt

接下来,你需要修改config/theChosenOne.yaml配置文件以适应你的本地环境。特别是要设置好数据备份目录:

backup_data_dir_root: Your absolute path to the data folder

训练模型:

python main.py

使用训练好的模型进行推理:

python inference.py

项目成果展示

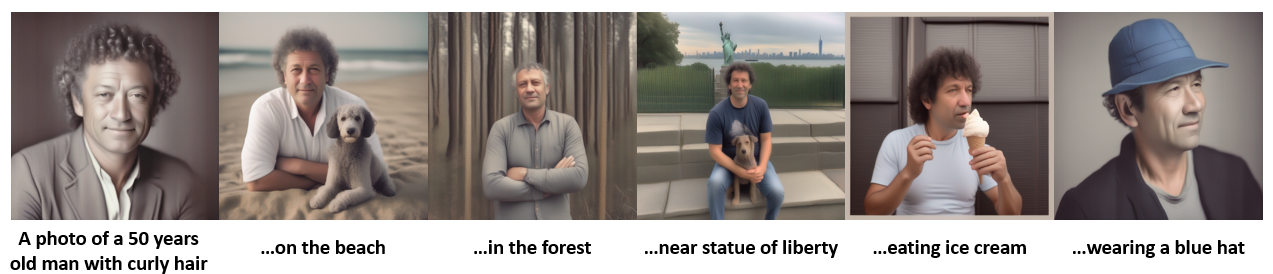

TheChosenOne项目展示了令人印象深刻的结果。下图展示了使用该方法生成的一致性角色图像:

可以看到,生成的角色在不同场景中保持了高度的一致性,同时又有细节上的变化,展现了该方法的有效性。

未来发展

TheChosenOne项目目前还在积极开发中,计划中的功能包括:

- 支持ControlNet,实现更精细的控制

- 本地图像编辑功能

- 更多的可视化结果展示

该项目为AI生成一致性角色开辟了新的可能性,相信随着进一步的发展,它将为游戏开发、动画制作等领域带来更多创新应用。

结语

TheChosenOne项目展示了AI在角色生成方面的最新进展,为解决一致性问题提供了新的思路。无论你是研究人员、开发者还是对AI图像生成感兴趣的爱好者,都值得关注这个项目的发展。我们期待看到更多基于这一技术的创新应用,共同推动AI图像生成技术的进步。

如果你对这个项目感兴趣,不妨访问其GitHub仓库了解更多细节,或者尝试自己动手实践。让我们一起探索AI角色生成的无限可能!