Transformers学习指南:从入门到精通

Transformers简介:革命性的深度学习模型

Transformers模型自2017年问世以来,已经彻底改变了自然语言处理(NLP)领域。这种创新的神经网络架构不仅在各种NLP任务中取得了突破性的成果,还逐渐扩展到计算机视觉和强化学习等其他领域。对于想要在人工智能和机器学习领域有所建树的学习者和从业者来说,深入理解Transformers已经成为一项必不可少的技能。

本文旨在为您提供一份全面而系统的Transformers学习指南,从基础概念入手,逐步深入到技术细节和实际应用。无论您是刚刚接触这一领域的新手,还是希望进一步提升技能的专业人士,这份学习指南都能为您指明方向。

从高层次理解Transformers

要掌握Transformers,首先需要对其有一个整体的认识。以下是一些优质的入门资源:

-

Transformers入门讲座笔记 - 由Elvis Saravia提供,这份讲座笔记为初学者提供了清晰的Transformers概述。

-

从零开始学习Transformers - Brandon Rohrer的这篇教程以通俗易懂的方式解释了Transformers的核心概念。

-

Transformers在深度学习和NLP中的工作原理:直观介绍 - 这篇文章以直观的方式介绍了Transformers的工作原理,特别适合视觉学习者。

-

斯坦福CS25 - Transformers联合课程 - 这个视频课程系列由斯坦福大学提供,全面介绍了Transformers的各个方面。

-

用于语言理解的深度学习 - 这个由DeepMind提供的视频深入探讨了Transformers在语言理解中的应用。

-

Transformer模型:介绍与目录 - Xavier Amatriain的这篇论文为Transformer模型提供了全面的概述和分类。

深入理解Transformer架构

在对Transformers有了基本了解后,接下来可以深入探索其内部结构和工作原理:

-

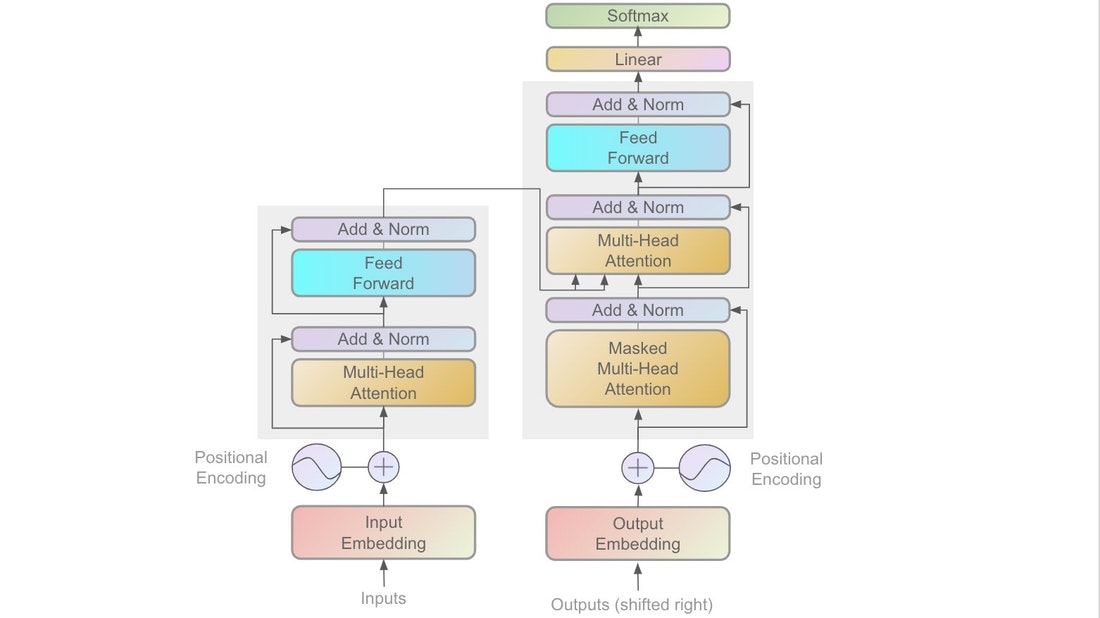

图解Transformer - Jay Alammar的这篇文章以生动的图解方式详细解释了Transformer的各个组成部分,是理解Transformer内部机制的必读之作。

-

拆解Transformer - 这篇文章将Transformer分解为各个组件,并详细解释和图示了每个部分的功能,有助于深入理解Transformer的工作原理。

Transformers的技术总结

对于那些寻求更深入技术理解的读者,以下资源提供了简洁而全面的技术解释:

-

Transformer家族 - Lilian Weng的这篇博文对Transformer及其变体进行了全面的技术总结。

-

Transformer家族2.0版本 - 这是Lilian Weng的更新版本,涵盖了Transformer领域的最新进展。

Transformers的实现

理论学习之后,动手实践是加深理解的最佳方式。以下资源可以帮助您实现自己的Transformer模型:

-

注释版Transformer - 这个教程提供了Transformer的详细实现,并附有丰富的注释,非常适合学习者跟随实现。

-

使用nn.Transformer和TorchText进行语言建模 - PyTorch官方提供的这个教程展示了如何使用Transformer进行实际的NLP任务。

-

Transformers方法集合 - 如果您想了解最新的Transformer实现,Papers with Code网站上的这个集合是很好的参考资源。

深入阅读:Attention Is All You Need

Transformer模型的诞生源于这篇开创性的论文。在对Transformers有了基本了解后,建议仔细阅读这篇论文以获得更深入的洞察:

Attention Is All You Need - 这篇由Vaswani等人撰写的论文首次提出了Transformer架构,是理解Transformer原理的关键文献。

Transformers的应用

在掌握了Transformers的理论和实现后,您可能希望将其应用到实际的NLP项目或研究中。目前,最受欢迎的Transformers库是由HuggingFace开发的:

Transformers库 - 这个库提供了众多预训练的Transformer模型,以及便捷的接口用于微调和部署。

此外,HuggingFace团队还出版了一本关于使用Transformers进行NLP的新书,您可以在这里查看。

大型语言模型(LLMs)阅读清单

作为补充,Sebastian Raschka提供了一份关于大型语言模型的优质阅读清单:

理解大型语言模型 -- 变革性阅读清单 - 这份清单涵盖了LLMs领域的重要文献,是深入了解最新NLP发展的宝贵资源。

结语

Transformers已经成为现代人工智能和机器学习领域的核心技术之一。通过本文提供的学习路径和资源,您可以系统地掌握Transformers的理论基础、技术��细节和实际应用。记住,学习是一个持续的过程,随着技术的不断发展,保持学习和实践的热情至关重要。

我们鼓励读者根据自己的兴趣和需求,选择合适的资源进行深入学习。同时,也欢迎大家在实践中发现新的见解,并与社区分享您的学习经验。

最后,如果您希望及时获取最新的机器学习和NLP资源更新,可以在Twitter上关注作者。让我们一起在这个激动人心的领域中不断探索和进步!

编辑推荐精选

讯飞智文

一键生成PPT和Word,让学习生活更轻松

讯飞智文是一个利用 AI 技术的项目,能够帮助用户生成 PPT 以及各类文档。无论是商业领域的市场分析报告、年度目标制定,还是学生群体的职业生涯规划、实习避坑指南,亦或是活动策划、旅游攻略等内容,它都能提供支持,帮助用户精准表达,轻松呈现各种信息。

讯飞星火

深度推理能力全新升级,全面对标OpenAI o1

科大讯飞的星火大模型,支持语言理解、知识问答和文本创作等多功能,适用于多种文件和业务场景,提升办公和日常生活的效率。讯飞星火是一个提供丰富智能服务的平台,涵盖科技资讯、图像创作、写作辅助、编程解答、科研文献解读等功能,能为不同需求的用户提供便捷高效的帮助,助力用户轻松获取信息、解决问题,满足多样化使用场景。

Spark-TTS

一种基于大语言模型的高效单流解耦语音令牌文本到语音合成模型

Spark-TTS 是一个基于 PyTorch 的开源文本到语音合成项目,由多个知名机构联合参与。该项目提供了高效的 LLM(大语言模型)驱动的语音合成方案,支持语音克隆和语音创建功能,可通过命令行界面(CLI)和 Web UI 两种方式使用。用户可以根据需求调整语音的性别、音高、速度等参数,生成高质量的语音。该项目适用于多种场景,如有声读物制作、智能语音助手开发等。

Trae

字节跳动发布的AI编程神器IDE

Trae是一种自适应的集成开发环境(IDE),通过自动化和多元协作改变开发流程。利用Trae,团队能够更快速、精确地编写和部署代码,从而提高编程效率和项目交付速度。Trae具备上下文感知和代码自动完成功能,是提升开发效率的理想工具。

咔片PPT

AI助力,做PPT更简单!

咔片是一款轻量化在线演示设计工具,借助 AI 技术,实现从内容生成到智能设计的一站式 PPT 制作服务。支持多种文档格式导入生成 PPT,提供海量模板、智能美化、素材替换等功能,适用于销售、教师、学生等各类人群,能高效制作出高品质 PPT,满足不同场景演示需求。

讯飞绘文

选题、配图、成文,一站式创作,让内容运营更高效

讯飞绘文,一个AI集成平台,支持写作、选题、配图、排版和发布。高效生成适用于各类媒体的定制内容,加速品牌传播,提升内容营销效果。

材料星

专业的AI公文写作平台,公文写作神器

AI 材料星,专业的 AI 公文写作辅助平台,为体制内工作人员提供高效的公文写作解决方案。拥有海量公文文库、9 大核心 AI 功能,支持 30 + 文稿类型生成,助力快速完成领导讲话、工作总结、述职报告等材料,提升办公效率,是体制打工人的得力写作神器。

openai-agents-python

OpenAI Agents SDK,助力开发者便捷使用 OpenAI 相关功能。

openai-agents-python 是 OpenAI 推出的一款强大 Python SDK,它为开发者提供了与 OpenAI 模型交互的高效工具,支持工具调用、结果处理、追踪等功能,涵盖多种应用场景,如研究助手、财务研究等,能显著提升开发效率,让开发者更轻松地利用 OpenAI 的技术优势。

Hunyuan3D-2

高分辨率纹理 3D 资产生成

Hunyuan3D-2 是腾讯开发的用于 3D 资产生成的强大工具,支持从文本描述、单张图片或多视角图片生成 3D 模型,具备快速形状生成能力,可生成带纹理的高质量 3D 模型,适用于多个领域,为 3D 创作提供了高效解决方案。

3FS

一个具备存储、管理和客户端操作等多种功能的分布式文件系统相关项目。

3FS 是一个功能强大的分布式文件系统项目,涵盖了存储引擎、元数据管理、客户端工具等多个模块。它支持多种文件操作,如创建文件和目录、设置布局等,同时具备高效的事件循环、节点选择和协程池管理等特性。适用于需要大规模数据存储和管理的场景,能够提高系统的性能和可靠性,是分布式存储领域的优质解决方案。

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号