Tree-of-Thought-Prompting简介

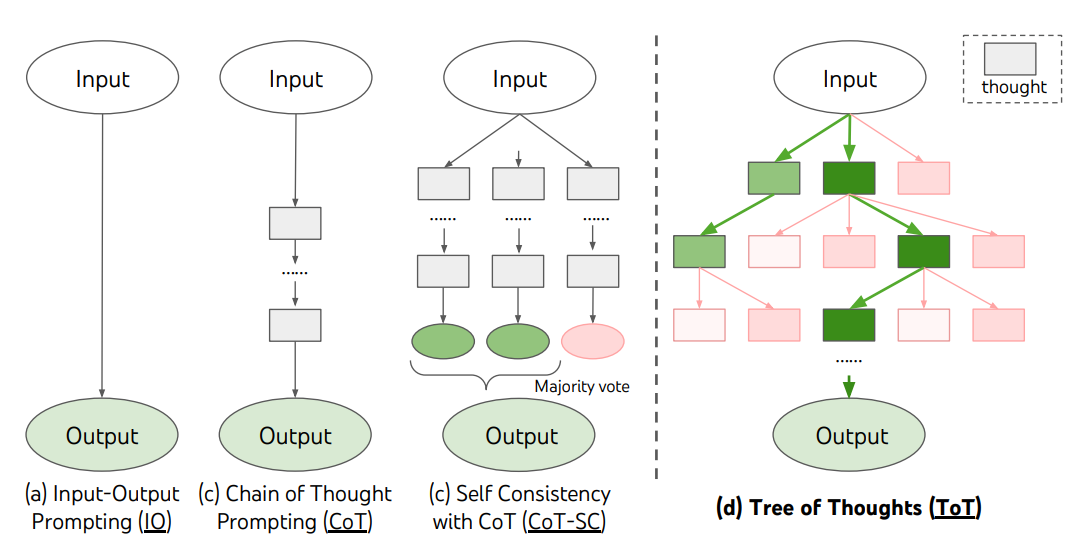

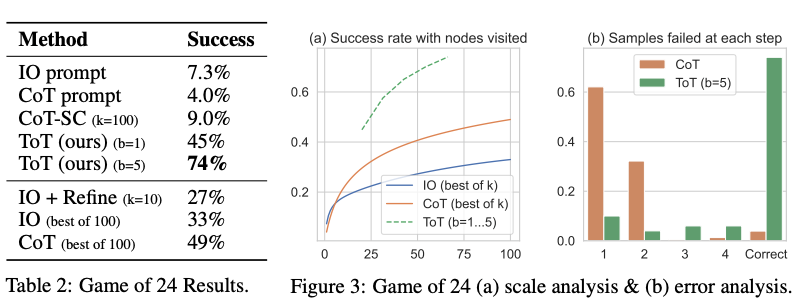

Tree-of-Thought-Prompting (ToT Prompting) 是一种新兴的提示工程技术,旨在提升大型语言模型 (LLMs) 在复杂推理任务中的表现。这种技术借鉴了Tree-of-Thoughts框架的思想,通过模拟人类的思考过程,让模型能够探索多个推理路径,进行自我评估和修正,从而得出更准确的结论。

ToT Prompting的核心原理

ToT Prompting的核心思想是让模型像一组专家一样,分步骤思考问题,互相讨论和修正错误。具体来说,它包含以下几个关键要素:

- 多专家视角:模拟多个"专家"同时思考同一问题。

- 分步推理:每个"专家"逐步写下自己的思考过程。

- 互相交流:"专家们"分享各自的想法,相互启发。

- 错误纠正:如果某个"专家"意识到自己的错误,可以及时退出讨论。

- 达成共识:最终所有"专家"就问题的答案达成一致。

ToT Prompting的示例

以下是一个典型的ToT Prompting模板:

想象三位不同的专家正在回答这个问题。

所有专家都会写下自己思考的一个步骤,然后与小组分享。

然后所有专家继续进行下一个步骤,以此类推。

如果任何专家在某个时候意识到自己错了,他们就会退出。

问题是...

使用这种提示方式,即使是GPT-3.5这样的模型,也能在一些复杂问题上表现出接近GPT-4的推理能力。

ToT Prompting的优势

- 提升推理能力:通过模拟多步思考和自我纠错,显著提高模型在复杂问题上的表现。

- 适用性广:可应用于数学推理、创意写作等多种任务类型。

- 易于实施:相比完整的Tree-of-Thoughts框架,ToT Prompting只需要在提示中稍作修改,无需复杂的代码实现。

相关资源

要深入了解Tree-of-Thought-Prompting,以下资源将会很有帮助:

- GitHub项目主页:包含详细的介绍、示例和使用说明。

- arXiv论文:Tree of Thoughts: Deliberate Problem Solving with Large Language Models:介绍了完整的Tree-of-Thoughts框架。

- Prompt Engineering Guide: Tree of Thoughts (ToT):提供了ToT技术的详细解释和使用指南。

结语

Tree-of-Thought-Prompting作为一种强大而灵活的提示技术,为提升大型语言模型的推理能力开辟了新的道路。无论您是NLP研究者、AI工程师还是对提示工程感兴趣的爱好者,都值得深入探索这一技术。通过实践和创新,相信我们能够进一步释放语言模型的潜力,解决更多复杂的现实世界问题。