Tree of Thoughts: 提升大语言模型推理能力的新方法

近年来,大语言模型(Large Language Models, LLMs)在自然语言处理领域取得了巨大进展,展现出强大的语言理解和生成能力。然而,在面对需要复杂推理和规划的任务时,传统的语言模型推理方法仍存在局限性。为了解决这一问题,普林斯顿大学和Google DeepMind的研究人员提出了一种新的语言模型推理框架 - Tree of Thoughts (ToT)。这种方法通过构建思维树并进行深度搜索,显著提升了大语言模型在复杂问题解决中的表现。

ToT的核心思想

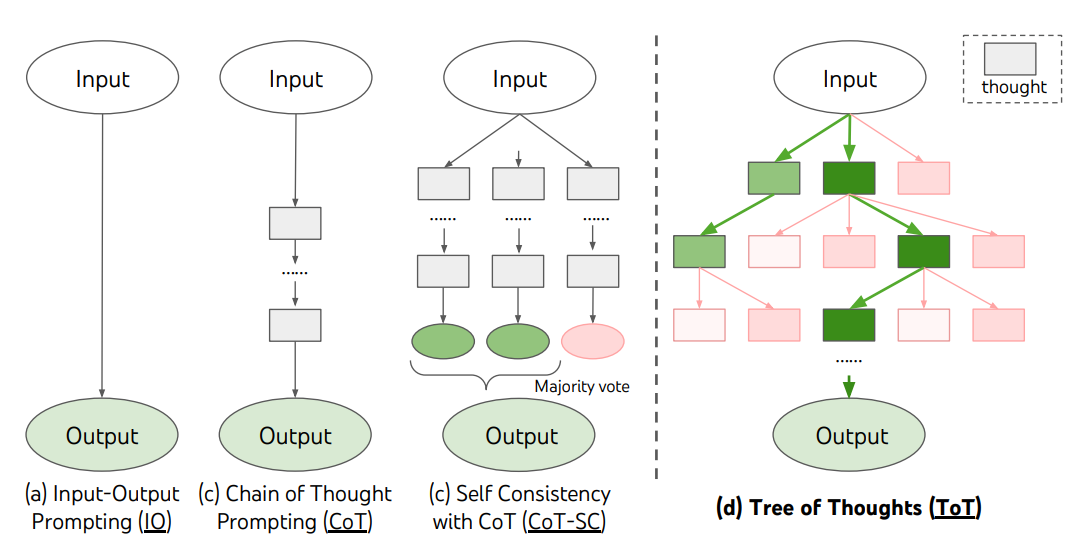

Tree of Thoughts的核心思想是将语言模型的推理过程视为一个树状结构,每个节点代表一个中间思考步骤。与传统的Chain-of-Thought方法不同,ToT允许模型在推理过程中探索多条路径,并根据需要进行回溯和重新评估。这种方法使得语言模型能够进行更加深入和全面的推理,从而提高解决复杂问题的能力。

ToT的工作原理

ToT框架的工作原理主要包括以下几个步骤:

- 思维生成:语言模型根据当前状态生成多个可能的下一步思考。

- 状态评估:对生成的思维进行评估,判断其对解决问题的潜在价值。

- 搜索策略:采用广度优先搜索(BFS)或深度优先搜索(DFS)等算法,在思维树中探索最佳路径。

- 回溯与重新评估:允许模型在需要时回溯到之前的状态,并重新评估其他可能的思维路径。

ToT在实际任务中的应用

研究人员在多个具有挑战性的任务中测试了ToT的效果,包括:

- 24点游戏:给定4个数字,通过基本运算得到24。

- 创意写作:根据给定主题创作短篇故事。

- 迷你填字游戏:解决3x3的迷你填字谜题。

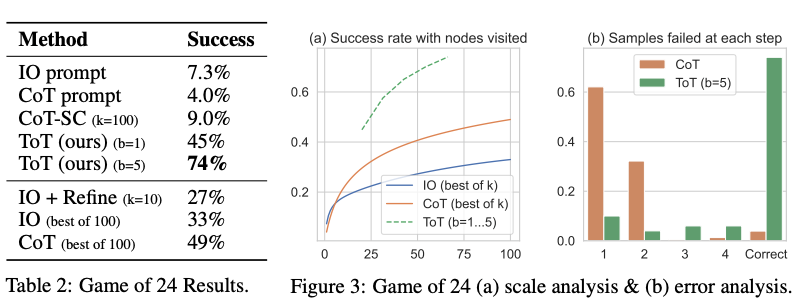

在这些任务中,ToT都展现出了显著的性能提升。以24点游戏为例,使用GPT-4作为基础模型,传统的Chain-of-Thought方法只能解决4%的问题,而采用ToT框架后,成功率提高到了74%。

ToT的实现与使用

为了方便研究人员和开发者使用ToT框架,普林斯顿大学的研究团队已经将相关代码开源。您可以通过以下步骤快速开始使用ToT:

- 安装ToT包:

pip install tree-of-thoughts-llm

- 设置OpenAI API密钥。

- 使用简单的Python脚本即可运行ToT算法:

import argparse

from tot.methods.bfs import solve

from tot.tasks.game24 import Game24Task

args = argparse.Namespace(backend='gpt-4', temperature=0.7, task='game24', naive_run=False, prompt_sample=None, method_generate='propose', method_evaluate='value', method_select='greedy', n_generate_sample=1, n_evaluate_sample=3, n_select_sample=5)

task = Game24Task()

ys, infos = solve(args, task, 900)

print(ys[0])

ToT的优势与潜在应用

ToT框架相比传统方法具有以下优势:

- 更强的推理能力:通过构建思维树和深度搜索,ToT能够处理更复杂的推理任务。

- 灵活性:可以根据任务特点选择不同的搜索策略和评估方法。

- 可解释性:思维树结构使得模型的推理过程更加透明和可解释。

这些优势使得ToT在多个领域都有潜在的应用价值,例如:

- 自动化问题解决

- 创意写作辅助

- 教育领域的智能辅导

- 科学研究中的假设生成与验证

未来展望

尽管ToT已经展现出了强大的性能,但研究人员认为这只是探索语言模型推理能力的开始。未来的研究方向可能包括:

- 优化搜索算法,提高效率和准确性。

- 将ToT与其他AI技术结合,如强化学习和多模态模型。

- 探索ToT在更广泛领域的应用,如自动化科学发现和复杂决策支持。

Tree of Thoughts为提升大语言模型的推理能力开辟了一条新的道路。随着研究的深入和技术的完善,我们有理由期待ToT能够在更多领域发挥重要作用,推动人工智能向着更高层次的智能迈进。

结语

Tree of Thoughts框架的提出和实现,标志着大语言模型在复杂推理任务上迈出了重要一步。通过构建思维树和灵活的搜索策略,ToT显著提升了模型解决复杂问题的能力。随着这一技术的不断发展和完善,我们可以期待看到更多令人兴奋的应用和突破。无论是在科研、教育还是创意领域,ToT都有望为人工智能带来新的可能性。

作为研究人员和开发者,我们应该密切关注ToT的发展,并积极探索将其应用到各自领域的可能性。同时,我们也需要认识到,尽管ToT带来了显著的性能提升,但在实际应用中仍然需要考虑计算资源、模型偏见等因素,以确保技术的负责任使用和持续发展。

随着更多研究者加入到这一领域,我们有理由相信,Tree of Thoughts将继续evolve,为人工智能的未来贡献重要力量。让我们共同期待ToT在推动大语言模型能力边界方面带来的更多惊喜和突破。