深入浅出理解上下文多臂赌博机算法

上下文多臂赌博机(Contextual Bandits)是机器学习和人工智能领域中一个重要的研究方向,它结合了传统多臂赌博机和上下文信息,为复杂的决策问题提供了更加智能和个性化的解决方案。本文将从基本概念出发,深入浅出地介绍上下文多臂赌博机的核心思想、主要算法以及实际应用,帮助读者全面了解这一强大的算法框架。

什么是上下文多臂赌博机?

要理解上下文多臂赌博机,我们首先需要了解传统的多臂赌博机问题。想象一个赌场里有多台老虎机(也称为"单臂赌博机"),每台机器都有不同的中奖概率。玩家的目标是通过反复尝试,找出哪台机器的回报最高,并最大化自己的总收益。这就是经典的多臂赌博机问题。

上下文多臂赌博机则是在此基础上加入了"上下文"这一关键元素。在这个场景中,每次选择前玩家都能获得一些额外的信息(即上下文),这些信息可能会影响不同机器的回报。例如,在推荐系统中,用户的兴趣爱好、浏览历史等就可以作为上下文信息,帮助系统为不同用户推荐最合适的内容。

上下文多臂赌博机的核心思想

上下文多臂赌博机的核心思想可以概括为以下几点:

-

利用上下文信息: 算法会考虑每次决策时的上下文信息,这使得决策更加个性化和精准。

-

探索与利用的平衡: 算法需要在探索新选项和利用已知好选项之间取得平衡,以最大化长期收益。

-

在线学习: 算法能够从每次交互中学习,不断更新和改进决策策略。

-

部分反馈: 每次只能观察到所选动作的回报,而无法知道其他动作的潜在回报。

常用的上下文多臂赌博机算法

1. LinUCB (Linear Upper Confidence Bound)

LinUCB 是一种基于线性模型的算法,它假设奖励与特征之间存在线性关系。该算法的核心思想是:

- 为每个臂维护一个线性模型

- 使用置信上界(UCB)来平衡探索和利用

- 选择具有最高UCB值的臂

LinUCB 的数学表达式如下:

a_t = argmax_a (x_t^T θ_a + α sqrt(x_t^T A_a^-1 x_t))

其中 x_t 是上下文向量,θ_a 是每个臂的参数向量,A_a 是协方差矩阵,α 是控制探索程度的参数。

2. Thompson Sampling

Thompson Sampling 是一种基于贝叶斯思想的算法。它的基本流程是:

- 为每个臂的参数维护一个后验分布

- 每次决策时,从每个臂的后验分布中采样参数

- 选择预期奖励最高的臂

Thompson Sampling 的优势在于它天然地平衡了探索和利用,而且可以很好地适应非平稳环境。

3. ε-greedy

ε-greedy 是一种简单但有效的策略:

- 以 1-ε 的概率选择当前最优的臂

- 以 ε 的概率随机选择一个臂

虽然简单,但 ε-greedy 在实践中往往表现不错,特别是在计算资源有限的场景下。

上下文多臂赌博机的应用场景

上下文多臂赌博机在现实世界有着广泛的应用,以下是一些典型的场景:

-

个性化推荐系统: 根据用户特征和历史行为推荐最可能感兴趣的内容。

-

在线广告投放: 根据用户画像和页面内容选择最合适的广告。

-

临床试验: 根据患者特征选择最有可能有效的治疗方案。

-

智能客服: 根据用户问题和背景信息选择最佳的回答策略。

-

A/B测试优化: 动态调整不同版本的展示比例,加速找到最优方案。

实现上下文多臂赌博机算法

下面我们以 LinUCB 算法为例,展示如何使用 Python 实现一个简单的上下文多臂赌博机算法:

import numpy as np

class LinUCB:

def __init__(self, n_arms, n_features, alpha=1.0):

self.n_arms = n_arms

self.n_features = n_features

self.alpha = alpha

self.A = [np.identity(n_features) for _ in range(n_arms)]

self.b = [np.zeros((n_features, 1)) for _ in range(n_arms)]

self.theta = [np.zeros((n_features, 1)) for _ in range(n_arms)]

def choose_arm(self, context):

ucb_values = []

for arm in range(self.n_arms):

theta = np.linalg.inv(self.A[arm]).dot(self.b[arm])

ucb = theta.T.dot(context) + self.alpha * np.sqrt(

context.T.dot(np.linalg.inv(self.A[arm])).dot(context)

)

ucb_values.append(ucb[0][0])

return np.argmax(ucb_values)

def update(self, arm, context, reward):

self.A[arm] += context.dot(context.T)

self.b[arm] += reward * context

self.theta[arm] = np.linalg.inv(self.A[arm]).dot(self.b[arm])

# 使用示例

n_arms = 3

n_features = 5

linucb = LinUCB(n_arms, n_features)

# 模拟在线学习过程

for t in range(1000):

context = np.random.randn(n_features, 1)

chosen_arm = linucb.choose_arm(context)

reward = np.random.rand() # 模拟获得的奖励

linucb.update(chosen_arm, context, reward)

这个简单的实现展示了 LinUCB 算法的核心思想。在实际应用中,我们还需要考虑更多因素,如模型的初始化、参数调优、处理大规模数据等。

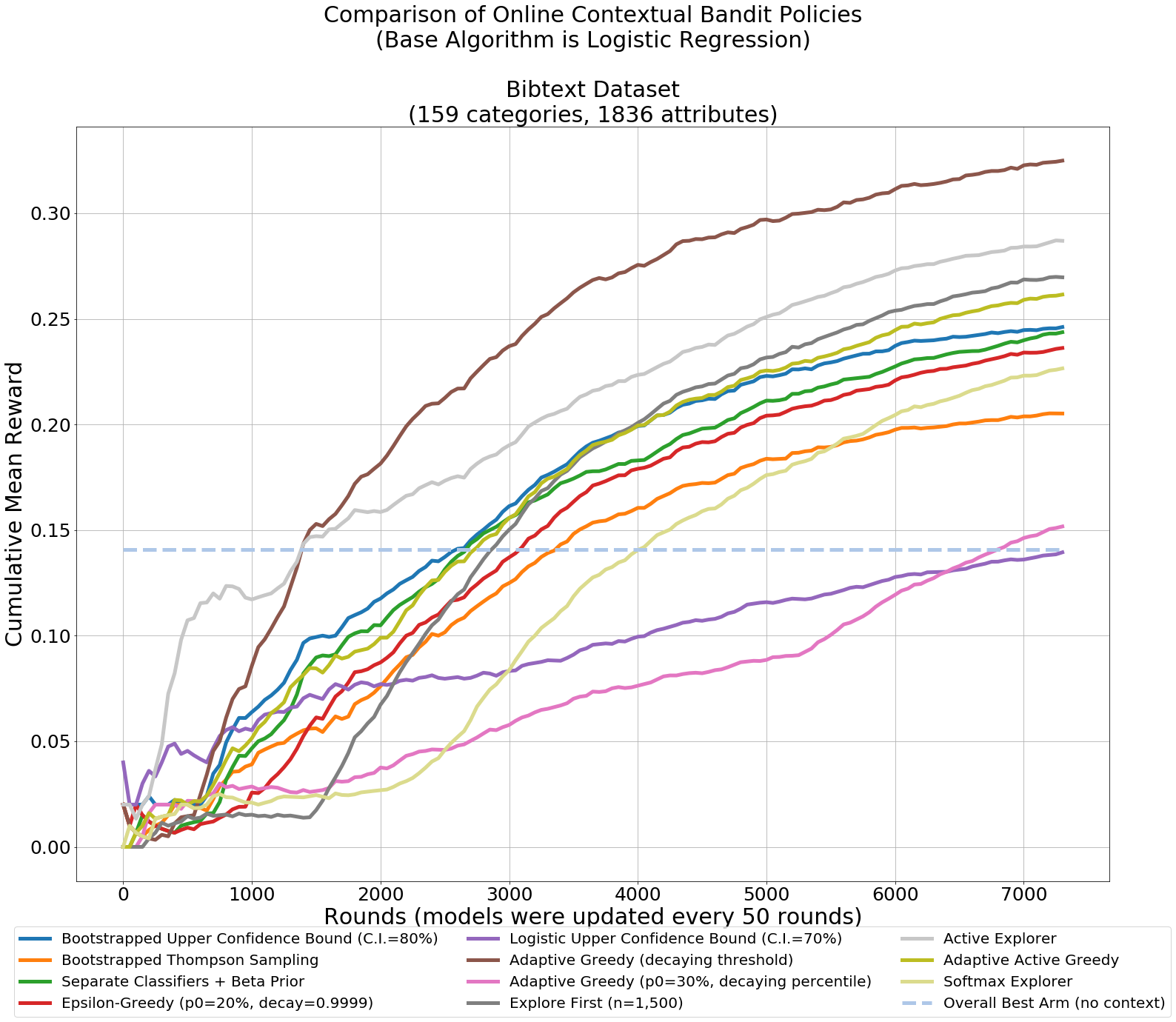

评估上下文多臂赌博机算法

评估上下文多臂赌博机算法的性能是一个具有挑战性的任务,因为我们只能观察到选中动作的回报。常用的评估方法包括:

-

累积遗憾(Cumulative Regret): 衡量算法的选择与最优选择之间的差距累计。

-

离线评估(Offline Evaluation): 使用历史数据评估新策略的性能,常用方法包括反事实估计(Counterfactual Estimation)。

-

A/B测试: 在实际环境中将新算法与基准算法进行对比。

上下文多臂赌博机的挑战与未来发展

尽管上下文多臂赌博机在许多领域取得了成功,但仍然面临一些挑战:

-

高维度上下文: 如何有效处理高维度的上下文信息。

-

非平稳环境: 在动态变化的环境中保持算法的有效性。

-

延迟反馈: 处理奖励延迟到达的情况。

-

安全性和公平性: 确保算法的决策不会产生不良的社会影响。

未来,上下文多臂赌博机可能会朝着以下方向发展:

- 与深度学习的结合,以处理更复杂的上下文信息

- 分布式和联邦学习版本的开发,以应对大规模数据

- 结合因果推断,以更好地理解决策的影响

结论

上下文多臂赌博机作为一种强大的决策算法,已经在众多领域展现出了巨大的潜力。它不仅能够处理复杂的决策问题,还能够实现个性化和动态优化。随着技术的不断发展,我们可以期待看到更多创新的算法和应用场景的出现。

无论是研究人员还是实践者,掌握上下文多臂赌博机的核心概念和实现方法,都将为解决现实世界中的决策问题提供有力的工具。随着人工智能和机器学习的不断发展,上下文多臂赌博机必将在未来的智能决策系统中扮演越来越重要的角色。

参考资源

- Contextual Bandits GitHub 仓库

- Contextual Bandits 文档

- Li, L., Chu, W., Langford, J., & Schapire, R. E. (2010). A contextual-bandit approach to personalized news article recommendation. In Proceedings of the 19th international conference on World wide web (pp. 661-670).

- Agrawal, S., & Goyal, N. (2013). Thompson sampling for contextual bandits with linear payoffs. In International Conference on Machine Learning (pp. 127-135).

通过本文的介绍,相信读者已经对上下文多臂赌博机有了全面的认识。从基本概念到算法实现,再到实际应用和未来展望,我们深入浅出地探讨了这一强大的机器学习工具。希望这些知识能够激发你的兴趣,并在实际工作中找到应用的机会。记住,在人工智能的世界里,学习永无止境,保持好奇心和探索精神,你将发现更多令人惊叹的可能性。