ZMM-TTS: 突破多语言多说话人语音合成的新边界

ZMM-TTS:开创多语言语音合成新纪元

在人工智能和语音技术飞速发展的今天,能够自然流畅地合成多种语言和多个说话人的语音一直是学术界和工业界追求的目标。近日,来自日本国立情报学研究所(NII)的研究团队提出了一种突破性的方法 - ZMM-TTS,为这一目标的实现带来了新的希望。

ZMM-TTS的技术创新

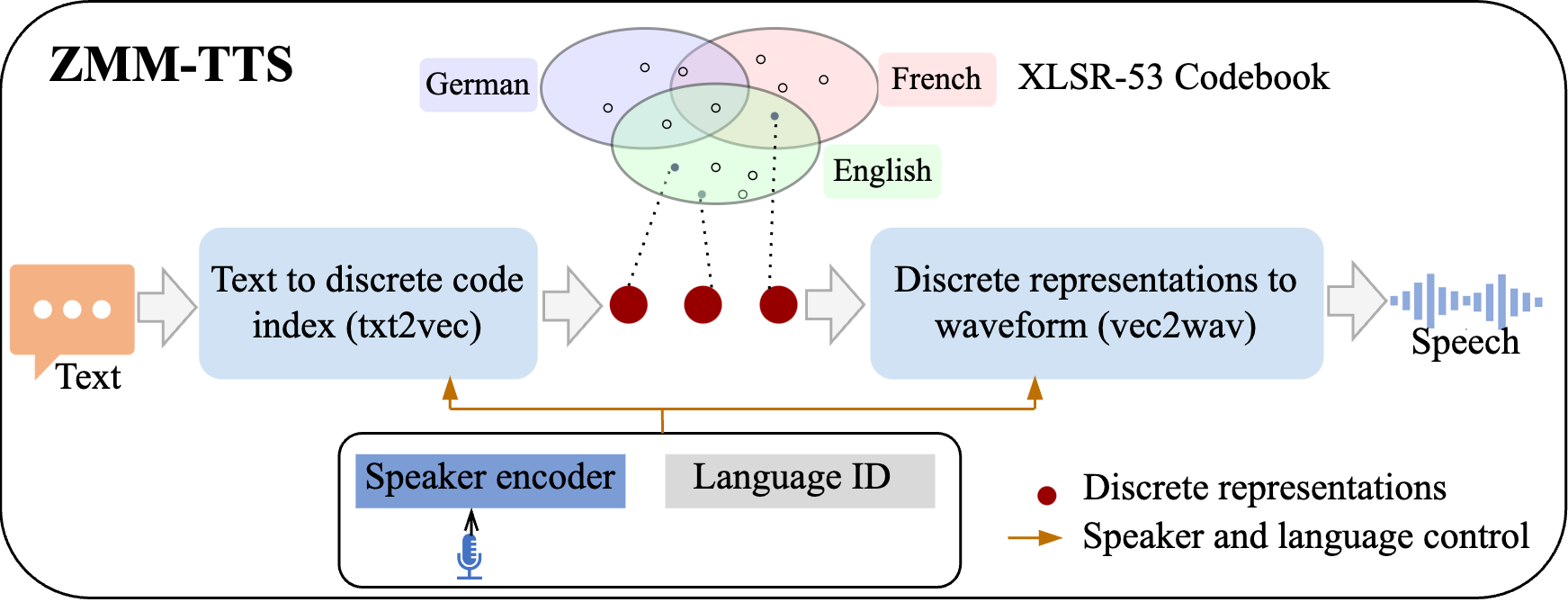

ZMM-TTS(Zero-shot Multilingual and Multispeaker Text-to-Speech)是一个零样本多语言多说话人语音合成框架。它的核心创新在于利用了来自大规模预训练自监督模型的量化潜在语音表示。这种方法首次将基于文本和语音的自监督学习模型的表示整合到多语言语音合成任务中,开创了语音合成技术的新方向。

如上图所示,ZMM-TTS的整体架构包含了多个关键组件:

-

预训练的自监督模型:包括用于音频处理的XLSR-53、用于说话人嵌入的ECAPA-TDNN,以及用于文本处理的XPhoneBERT。

-

txt2vec模块:将输入文本转换为向量表示。

-

vec2mel模块:将文本向量转换为梅尔频谱图。

-

vec2wav模块:将梅尔频谱图转换为波形。

-

HifiGAN声码器:用于生成最终的高质量音频。

这种设计使得ZMM-TTS能够有效地捕捉语音的多个方面,包括语言特征、说话人特征和声学特征,从而实现高质量的多语言多说话人语音合成。

实验验证与性能评估

研究团队通过一系列全面的主观和客观评估实验,证明了ZMM-TTS的有效性。实验涵盖了六种高资源语言(英语、法语、德语、葡萄牙语、西班牙语和瑞典语),对见过和未见过的说话人都进行了测试。

实验结果表明,ZMM-TTS在语音自然度和相似度方面表现出色:

- 对于已见过的说话人,合成语音的质量接近原始录音。

- 对于未见过的说话人,ZMM-TTS仍能生成高度相似的语音。

- 在跨语言语音合成任务中,即使对于模型未见过的语言,也能生成可理解且与目标说话人声音高度相似的音频。

这些结果充分展示了ZMM-TTS在零样本多语言多说话人语音合成方面的强大能力。

ZMM-TTS的实际应用潜力

ZMM-TTS的成功不仅仅是一项学术成果,它在实际应用中也具有巨大的潜力:

-

多语言语音助手:可以轻松扩展到新的语言和说话人,提供更个性化的用户体验。

-

语音翻译:能够保留原始说话人的声音特征,同时用目标语言生成语音。

-

语音内容创作:为创作者提供多语言配音工具,降低内容本地化的成本。

-

语言学习:生成不同口音和说话风格的语音样本,帮助学习者提高听力技能。

-

辅助交流:为失语症患者或语言障碍人士提供个性化的语音合成解决方案。

技术细节与实现

ZMM-TTS的成功离不开其精心设计的技术细节。以下是一些关键的实现要点:

-

数据集构建:研究团队基于MLS(Multilingual LibriSpeech)和NHT Swedish数据集构建了一个平衡的多语言多说话人数据集MM6,包含6种语言、每种语言约40位说话人的语音数据。

-

预处理流程:

- 提取离散编码索引和表示

- 提取说话人嵌入

- 提取文本序列

- 计算梅尔频谱图

- 计算先验对齐概率

-

模型训练:

- txt2vec模型:支持使用XphoneBERT、字符和IPA(国际音标)表示

- vec2mel模型:将文本向量转换为梅尔频谱图

- vec2wav模型:将梅尔频谱图转换为波形

- HifiGAN声码器:生成高质量音频

-

训练配�置:

- 使用批量大小为16

- txt2vec和vec2mel模型训练120万步

- vec2wav和HifiGAN模型训练100万步

- 在单个Tesla A100 GPU上训练约3天

-

推理过程:

- 准备测试元数据文件和参考说话人嵌入

- 使用训练好的模型生成样本

- 结果保存在test_result文件夹中

未来研究方向

尽管ZMM-TTS取得了令人瞩目的成果,但研究团队并未就此止步。他们提出了几个值得进一步探索的方向:

-

少样本训练:开发能够快速适应新语言或新说话人的算法,进一步提高模型的泛化能力。

-

任意语言零样本推理:探索如何在完全未见过的语言上实现高质量的语音合成。

-

情感和风格控制:在保持多语言多说话人能力的基础上,增加对语音情感和说话风格的精确控制。

-

实时合成:优化模型结构和推理过程,实现低延迟的实时语音合成。

-

鲁棒性增强:提高模型在噪声环境、口音变化等复杂场景下的表现。

结语

ZMM-TTS的出现无疑为多语言多说话人语音合成技术带来了一次质的飞跃。它不仅展示了深度学习和自监督学习在语音合成领域的强大潜力,也为未来更加自然、个性化的人机交互铺平了道路。随着这项技术的不断完善和应用,我们可以期待在不久的将来,语言不再成为人与人之间沟通的障碍,每个人都能用自己的声音"说"出世界上的任何语言。

ZMM-TTS项目的源代码和预训练模型已在GitHub上开源(https://github.com/nii-yamagishilab/ZMM-TTS),这为整个语音技术社区提供了宝贵的资源。研究者和开发者可以基于这个框架进行进一步的改进和创新,推动多语言语音合成技术的持续发展。

在人工智能和语音技术日新月异的今天,ZMM-TTS的成功让我们看到了技术创新所能带来的无限可能。它不仅是语音合成领域的一个里程碑,更是跨语言交流和文化理解的有力工具。让我们期待这项技术在未来能够为更多人带来便利,促进全球化时代的沟通与理解。

编辑推荐精选

讯飞智文

一键生成PPT和Word,让学习生活更轻松

讯飞智文是一个利用 AI 技术的项目,能够帮助用户生成 PPT 以及各类文档。无论是商业领域的市场分析报告、年度目标制定,还是学生群体的职业生涯规划、实习避坑指南,亦或是活动策划、旅游攻略等内容,它都能提供支持,帮助用户精准表达,轻松呈现各种信息。

讯飞星火

深度推理能力全新升级,全面对标OpenAI o1

科大讯飞的星火大模型,支持语言理解、知识问答和文本创作等多功能,适用于多种文件和业务场景,提升办公和日常生活的效率。讯飞星火是一个提供丰富智能服务的平台,涵盖科技资讯、图像创作、写作辅助、编程解答、科研文献解读等功能,能为不同需求的用户提供便捷高效的帮助,助力用户轻松获取信息、解决问题,满足多样化使用场景。

Spark-TTS

一种基于大语言模型的高效单流解耦语音令牌文本到语音合成模型

Spark-TTS 是一个基于 PyTorch 的开源文本到语音合成项目,由多个知名机构联合参与。该项目提供了高效的 LLM(大语言模型)驱动的语音合成方案,支持语音克隆和语音创建功能,可通过命令行界面(CLI)和 Web UI 两种方式使用。用户可以根据需求调整语音的性别、音高、速度等参数,生成高质量的语音。该项目适用于多种场景,如有声读物制作、智能语音助手开发等。

Trae

字节跳动发布的AI编程神器IDE

Trae是一种自适应的集成开发环境(IDE),通过自动化和多元协作改变开发流程。利用Trae,团队能够更快速、精确地编写和部署代码,从而提高编程效率和项目交付速度。Trae具备上下文感知和代码自动完成功能,是提升开发效率的理想工具。

咔片PPT

AI助力,做PPT更简单!

咔片是一款轻量化在线演示设计工具,借助 AI 技术,实现从内容生成到智能设计的一站式 PPT 制作服务。支持多种文档格式导入生成 PPT,提供海量模板、智能美化、素材替换等功能,适用于销售、教师、学生等各类人群,能高效制作出高品质 PPT,满足不同场景演示需求。

讯飞绘文

选题、配图、成文,一站式创作,让内容运营更高效

讯飞绘文,一个AI集成平台,支持写作、选题、配图、排版和发布。高效生成适用于各类媒体的定制内容,加速品牌传播,提升内容营销效果。

材料星

专业的AI公文写作平台,公文写作神器

AI 材料星,专业的 AI 公文写作辅助平台,为体制内工作人员提供高效的公文写作解决方案。拥有海量公文文库、9 大核心 AI 功能,支持 30 + 文稿类型生成,助力快速完成领导讲话、工作总结、述职报告等材料,提升办公效率,是体制打工人的得力写作神器。

openai-agents-python

OpenAI Agents SDK,助力开发者便捷使用 OpenAI 相关功能。

openai-agents-python 是 OpenAI 推出的一款强大 Python SDK,它为开发者提供了与 OpenAI 模型交互的高效工具,支持工具调用、结果处理、追踪等功能,涵盖多种应用场景,如研究助手、财务研究等,能显著提升开发效率,让开发者更轻松地利用 OpenAI 的技术优势。

Hunyuan3D-2

高分辨率纹理 3D 资产生成

Hunyuan3D-2 是腾讯开发的用于 3D 资产生成的强大工具,支持从文本描述、单张��图片或多视角图片生成 3D 模型,具备快速形状生成能力,可生成带纹理的高质量 3D 模型,适用于多个领域,为 3D 创作提供了高效解决方案。

3FS

一个具备存储、管理和客户端操作等多种功能的分布式文件系统相关项目。

3FS 是一个功能强大的分布式文件系统项目,涵盖了存储引擎、元数据管理、客户端工具等多个模块。它支持多种文件操作,如创建文件和目录、设置布局等,同时具备高效的事件循环、节点选择和协程池管理等特性。适用于需要大规模数据存储和管理的场景,能够提高系统的性能和可靠性,是分布式存储领域的优质解决方案。

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号