CapsFusion

创新的大规模图像描述生成框架

CapsFusion是一个用于生成高质量图像描述的创新框架。该项目结合大型语言模型,融合真实和合成图像-文本对,解决了大规模多模态模型训练中的可扩展性和知识保留问题。CapsFusion提供120M数据集、模型和分布式推理代码,为多模态预训练研究提供重要资源。

于启莹<sup>1,2*</sup>,孙铨<sup>2*</sup>,张晓松<sup>2</sup>,崔宇峰<sup>2</sup>,张帆<sup>2</sup><br>曹越<sup>3</sup>,王新龙<sup>2</sup>,刘静静<sup>1</sup>

<sup>1</sup> 清华大学AIR实验室,<sup>2</sup> 北京智源人工智能研究院,<sup>3</sup> 独立研究员<br><sup>*</sup> 贡献相同

</div>CapsFusion是一个简单且可扩展的框架,用于为图像-文本对生成高质量的描述。该框架利用大型语言模型(LLMs)有机地结合了真实图像-文本对和由描述模型生成的合成描述的优势,以解决使用合成描述训练的大型多模态模型(LMMs)中严重的可扩展性不足和世界知识损失问题。

🚀 新闻

2024年2月27日:CapsFusion被CVPR 2024接收!🎉🍻2024年1月9日:发布CapsFusion 120M描述数据。2023年11月29日:发布CapsFus-LLaMA模型和分布式推理代码。

数据

我们发布了CapsFusion-120M数据集,这是一个用于大规模多模态预训练的高质量资源。本次发布包括来自LAION-2B和LAION-COCO数据集的相应描述,以便进行比较分析和对图像-文本数据质量进行进一步深入研究。

该数据集可以从🤗Huggingface下载。每个数据条目有四个字段:

- 图像URL

- LAION-2B描述(来自网络的原始alt文本)

- LAION-COCO描述(由BLIP合成)

- CapsFusion描述(我们的)

我们提供了一段代码片段来说明从给定的parquet文件中提取描述数据的过程,该代码打印前三个条目的url、laion_2b、laion_coco和capsfusion描述:

import pandas as pd data = pd.read_parquet("capsfusion_1.parquet") for idx, item in d.iterrows(): print(f"{item['image_url']=}") print(f"{item['laion_2b']=}") print(f"{item['laion_coco']=}") print(f"{item['capsfusion']=}") print('\n') if idx == 2: break

请注意,由于我们无法将所有描述与其对应的图像URL配对,发布的描述总数为1.13亿。但我们预计,使用此数据集训练所达到的性能将与使用全部1.2亿描述训练的性能相当。

模型使用

我们在下面提供了使用CapsFus-LLaMA模型生成CapsFusion描述的说明,给定LAION-2B的原始描述和LAION-COCO的合成描述。

安装

pip install -r requirements.txt

数据格式

我们在./data/example_data.json中提供了10,000个样本。您可以以类似的结构组织自己的数据。每个样本具有以下结构,包含来自LAION-2B和LAION-COCO的描述:

{ "laion_2b": ..., "laion_coco": ..., }

我们还在./data/example_data.json中为每个样本附加了一个capsfusion_official项,这是由CapsFus-LLaMA生成的CapsFusion描述。

推理

torchrun --nnodes 1 --nproc_per_node 8 capsfusion_inference.py

使用8张A100-40G GPU,大约需要20分钟来优化10,000个样本。您可以根据可用的GPU更改nnodes和nproc_per_node的值。

CapsFus-LLaMA模型将自动从huggingface下载。您也可以从这个huggingface模型仓库手动下载模型,并将config.yaml中的model_name更改为您的本地模型目录路径。

结果文件将保存在./data中。

示例

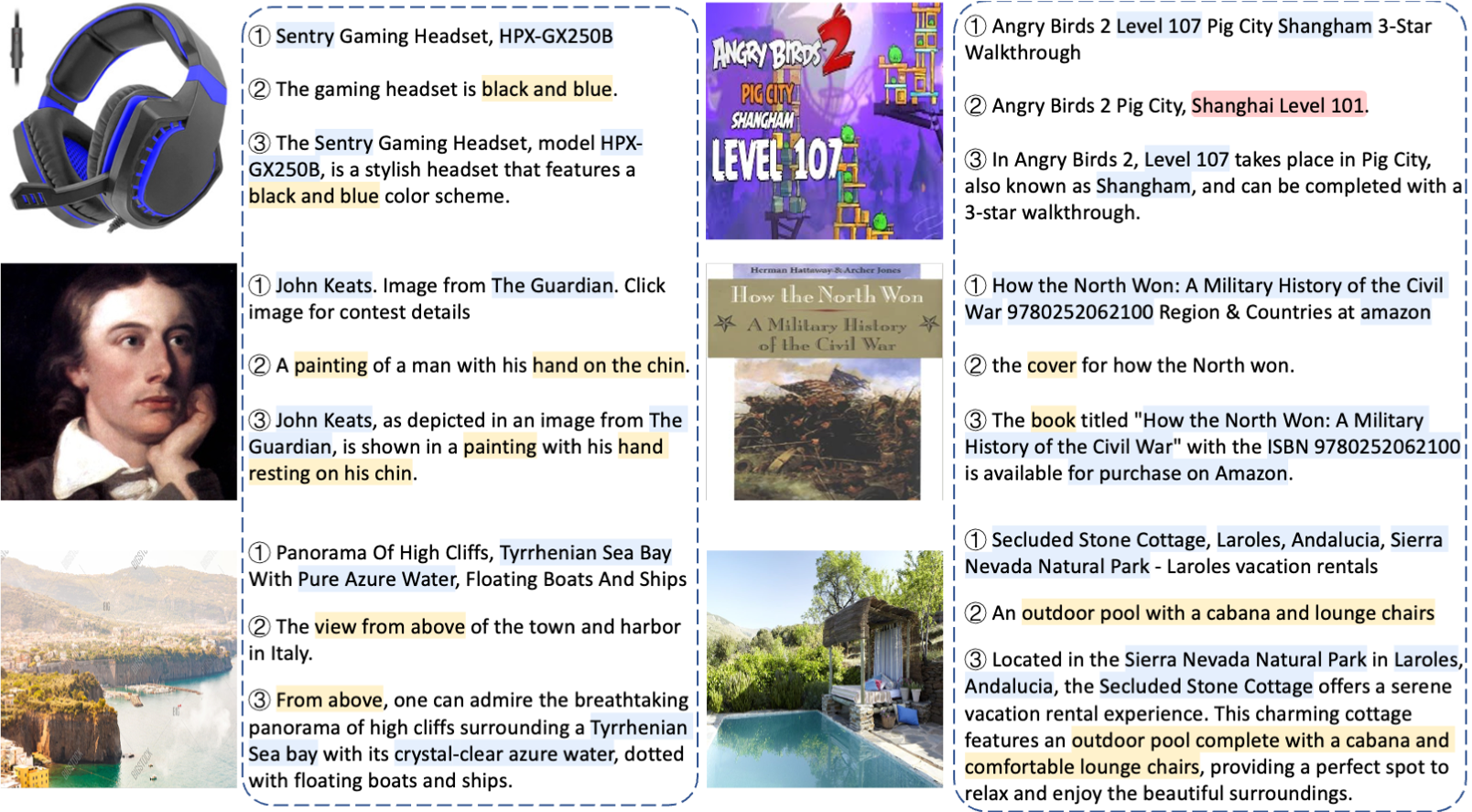

以下是CapsFusion生成的示例:➀ 真实的基于网络的描述(来自LAION-2B,包含噪声),➁ 合成描述(来自LAION-COCO,由BLIP生成,在语法和语义上较为简单),以及它们对应的 ③ CapsFusion描述。

来自原始描述的知识(蓝色)和来自合成描述的信息(黄色)被有机地融合到完整的CapsFusion描述中。更多描述和详细分析可以在我们的论文中找到。

在CapsFusion描述上训练的模型展现了丰富的真实世界知识(如下图所示),同时在基准评估中优于真实和合成描述(详细信息可在论文中找到)。

计划

请继续关注即将发布的内容。感谢您的理解。

-

CapsFus-LLaMA模型及分布式推理代码

-

CapsFusion-10M子集:包含原始(来自LAION-2B)、合成(来自LAION-COCO)和CapsFusion描述的图像

-

CapsFusion-120M完整集:带有CapsFusion描述的图像URL

参考文献

CapsFusion: Rethinking Image-Text Pairs at Scale -- https://arxiv.org/abs/2310.20550

@article{yu2023capsfusion,

title={CapsFusion: Rethinking Image-Text Data at Scale},

author={Yu, Qiying and Sun, Quan and Zhang, Xiaosong and Cui, Yufeng and Zhang, Fan and Cao, Yue and Wang, Xinlong and Liu, Jingjing},

journal={arXiv preprint arXiv:2310.20550},

year={2023}

}

致谢

编辑推荐精选

Trae

字节跳动发布的AI编程神器IDE

Trae是一种自适应的集成开发环境(IDE),通过自动化和多元协作改变开发流程。利用Trae,团队能够更快速、精确地编写和部署代码,从而提高编程效率和项目交付速度。Trae具备上下文感知和代码自动完成功能,是提升开发效率的理想工具。

OmniParser

帮助AI理解电脑屏幕 纯视觉GUI元素的自动化解析方案

开源工具通过计算机视觉技术实现图形界面元素的智能识别与结构化处理,支持自动化测试脚本生成和辅助功能开发。项目采用模块化设计,提供API接口与多种输出格式,适用于跨平台应用场景。核心算法优化了元素定位精度,在动态界面和复杂布局场景下保持稳定解析能力。

Grok3

埃隆·马斯克旗下的人工智能公司 xAI 推出的第三代大规模语言模型

Grok3 是由埃隆·马斯克旗下的人工智能公司 xAI 推出的第三代大规模语言模型,常被马斯克称为“地球上最聪明的 AI”。它不仅是在前代产品 Grok 1 和 Grok 2 基础上的一次飞跃,还在多个关键技术上实现了创新突破。

腾�讯元宝

腾讯自研的混元大模型AI助手

腾讯元宝是腾讯基于自研的混元大模型推出的一款多功能AI应用,旨在通过人工智能技术提升用户在写作、绘画、翻译、编程、搜索、阅读总结等多个领域的工作与生活效率。

Windsurf Wave 3

Windsurf Editor推出第三次重大更新Wave 3

新增模型上下文协议支持与智能编辑功能。本次更新包含五项核心改进:支持接入MCP协议扩展工具生态,Tab键智能跳转提升编码效率,Turbo模式实现自动化终端操作,图片拖拽功能优化多模态交互,以及面向付费用户的个性化图标定制。系统同步集成DeepSeek、Gemini等新模型,并通过信用点数机制实现差异化的资源调配。

Cursor

增强编程效率的AI代码编辑器

Cursor作为AI驱动的代码编辑工具,助力开发者效率大幅度提升。�该工具简化了扩展、主题和键位配置的导入,可靠的隐私保护措施保证代码安全,深受全球开发者信赖。此外,Cursor持续推出更新,不断优化功能和用户体验。

Manus

全面超越基准的 AI Agent助手

Manus 是一款通用人工智能代理平台,能够将您的创意和想法迅速转化为实际成果。无论是定制旅行规划、深入的数据分析,还是教育支持与商业决策,Manus 都能高效整合信息,提供精准解决方案。它以直观的交互体验和领先的技术,为用户开启了一个智慧驱动、轻松高效的新时代,让每个灵感都能得到完美落地。

飞书知识问答

飞书官方推出的AI知识库 上传word pdf即可部署AI私有知识库

基于DeepSeek R1大模型构建的知识管理系统,支持PDF、Word、PPT等常见文档格式解析,实现云端与本地数据的双向同步。系统具备实时网络检索能力,可自动关联外部信息源,通过语义理解技术处理结构化与非结构化数据。免费版本提供基础知识库搭建功能,适用于企业文档管理和个人学习资料整理场景。

酷表ChatExcel

大模型驱动的Excel数据处理工具

基于大模型交互的表格处理系统,允许用户通过对话方式完成数据整理和可视化分析。系统采用机器学习算法解析用户指令,自动执行排序、公式计算和数据透视等操作,支持多种文件格式导入导出。数据处理响应速度保持在0.8秒以内,支持超过100万行数据的即时分析。

DeepEP

DeepSeek开源的专家并行通信优化框架

DeepEP是一个专为大规模分布式计算设计的通信库,重点解决专家并行模式中的通信瓶颈问题。其核心架构采用分层拓扑感知技术,能够自动识别节点间物理连接关系,优化数据传输路径。通过实现动态路由选择与负载均衡机制,系统在千卡级计算集群中维持稳定的低延迟特性,同时兼容主流深度学习框架的通信接口。

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号