AutoStudio

提升多轮交互图像生成的主体一致性

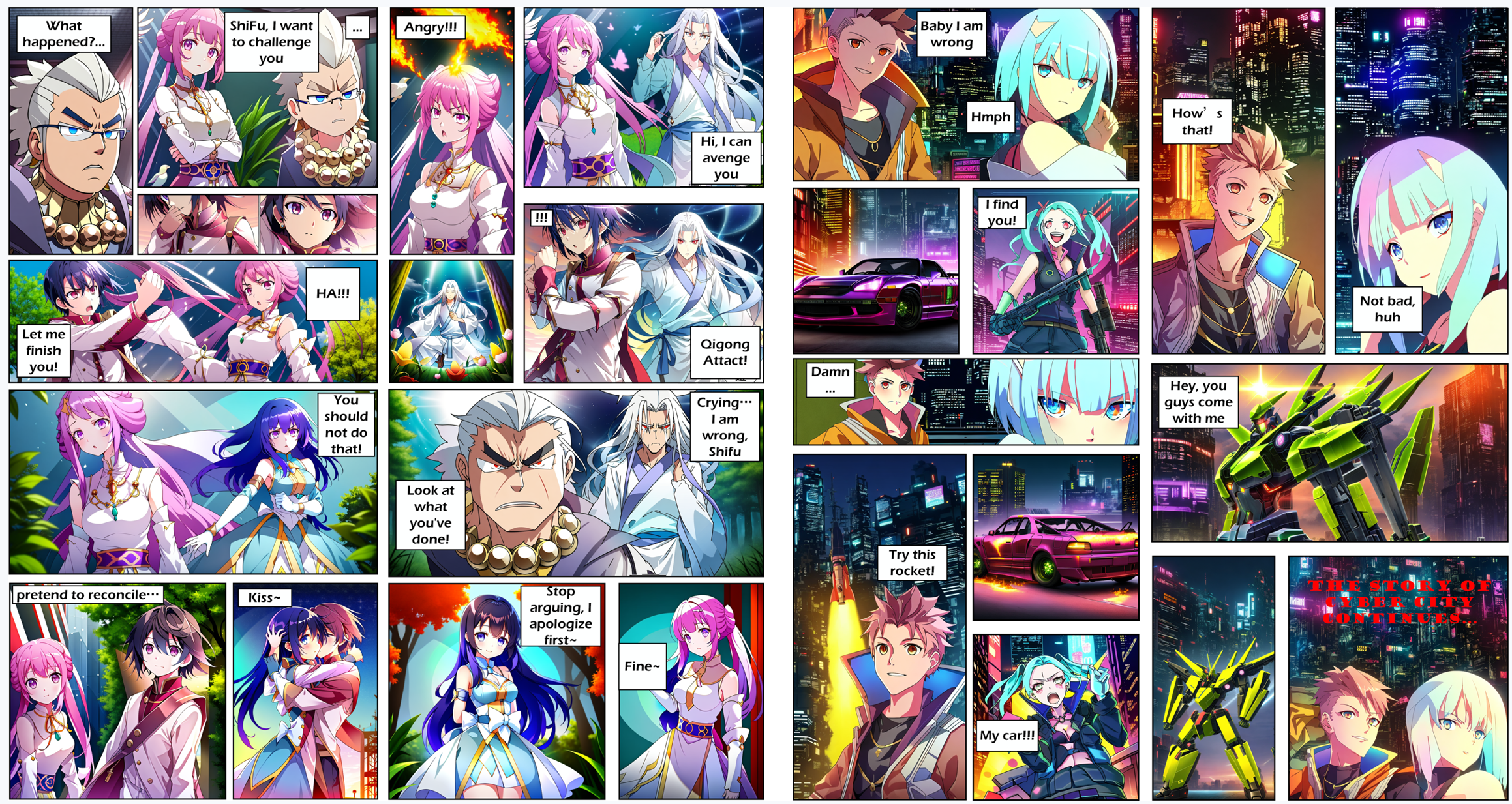

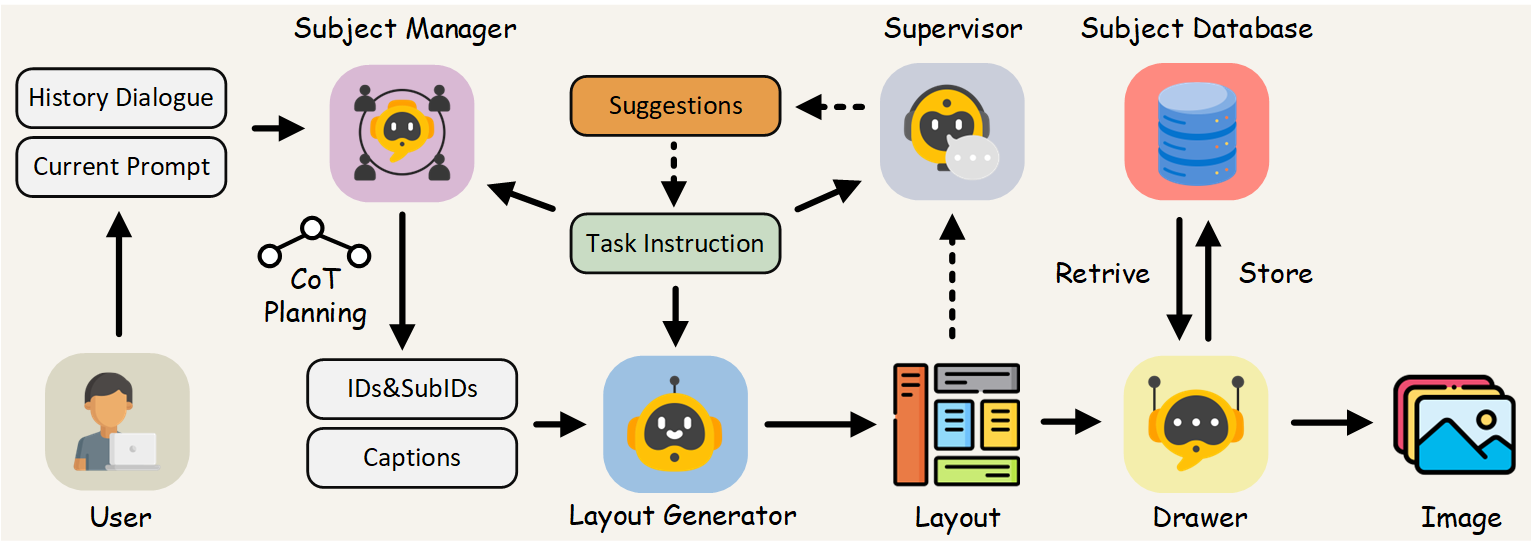

AutoStudio是一个创新的多代理框架,专注于解决多轮交互式图像生成中的主体一致性问题。该框架包含主体管理器、布局生成器、监督器和绘图器四个核心组件。通过引入并行U-Net和主体初始化生成方法,AutoStudio实现了连贯多主体图像序列的生成。在CMIGBench基准测试中,该框架在平均Fréchet Inception Distance和平均字符-字符相似度方面分别提升了13.65%和2.83%,展示了其在多轮交互中保持多主体一致性的优异表现。

AutoStudio:在多轮交互式图像生成中塑造一致的主体

</div>模型架构

摘要

随着最先进的文本到图像(T2I)生成模型已经能够出色地生成单幅图像,一项更具挑战性的任务——多轮交互式图像生成开始吸引相关研究社区的关注。这项任务要求模型与用户进行多轮交互,生成一系列连贯的图像。然而,由于用户可能频繁切换主体,现有的方法在生成多样化图像的同时难以保持主体一致性。为解决这一问题,我们提出了一个免训练的多代理框架,名为AutoStudio。AutoStudio采用基于大型语言模型(LLMs)的三个代理来处理交互,以及一个基于稳定扩散(SD)的代理来生成高质量图像。具体而言,AutoStudio包括:(i)一个主体管理器,用于解释交互对话并管理每个主体的上下文;(ii)一个布局生成器,用于生成精细的边界框来控制主体位置;(iii)一个监督器,用于提供布局优化建议;以及(iv)一个绘图器,用于完成图像生成。此外,我们引入了一个并行UNet来替代绘图器中的原始UNet,它使用两个并行的交叉注意力模块来利用主体感知特征。我们还引入了一种主体初始化生成方法,以更好地保留小主体。我们的AutoStudio因此能够以交互和一致的方式生成一系列多主体图像。在公开的CMIGBench基准测试和人工评估中的大量实验表明,AutoStudio在多轮中很好地保持了��多主体一致性,并且在平均Fréchet Inception Distance上将最先进的性能提高了13.65%,在平均角色-角色相似度上提高了2.83%。

前期工作:TheaterGen

待办事项

- 发布Hugging Face演示

- 发布SDXL版本代码

- 发布SDv1.5版本代码

:fire: 新闻

- [2024.06.26] AutoStudio获得200颗星!

- [2024.06.22] 修复了bug,发布SDXL版本

- [2024.06.11] 我们发布了SDv1.5代码

- [2024.06.06] 我们发布了代码仓库

🚀 运行

- 准备SD的所有预训练检查点(强烈推荐

dreamlike-art/dreamlike-anime-1.0)和IP-Adapter - 准备

/DETECT_SAMefficient_sam_s_gpu.jit和/DETECT_SAM/Grounding-DINO/groundingdino_swint_ogc.pth用于groundingdino和efficientSAM - 创建环境并运行以下代码:

python run.py

👀 联系我们

如果您有任何问题,请随时发送电子邮件至howe4884@outlook.com。 🌟🌟🌟(我是一名本科生,正在积极寻找25年秋季博士项目的机会。)🌟🌟🌟

引用

如果您觉得这段代码有帮助,请考虑引用:

@article{cheng2024autostudio,

title={AutoStudio: Crafting Consistent Subjects in Multi-turn Interactive Image Generation},

author={Cheng, Junhao and Lu, Xi and Li, Hanhui and Zai, Khun Loun and Yin, Baiqiao and Cheng, Yuhao and Yan, Yiqiang and Liang, Xiaodan},

journal={arXiv preprint arXiv:2406.01388},

year={2024}

}

编辑推荐精选

讯飞智文

一键生成PPT和Word,让学习生活更轻松

讯飞智文是一个利用 AI 技术的项目,能够帮助用户生成 PPT 以及各类文档。无论是商业领域的市场分析报告、年度目标制定,还是学生群体的职业生涯规划、实习避坑指南,亦或是活动策划、旅游攻略等内容,它都能提供支持,帮助用户精准表达,轻松呈现各种信息。

讯飞星火

深度推理能力全新升级,全面对标OpenAI o1

科大讯飞的星火大模型,支持语言理解、知识问答和文本创作等多功能,适用于多种文件和业务场景,提升办公和日常生活的效率。讯飞星火是一个提供丰富智能服务的平台,涵盖科技资讯、图像创作、写作辅助、编程解答、科研文献解读等功能,能为不同需求的用户提供便捷高效的帮助,助力用户轻松获取信息、解决问题,满足多样化使用场景。

Spark-TTS

一种基于大语言模型的高效单流解耦语音令牌文本到语音合成模型

Spark-TTS 是一个基于 PyTorch 的开源文本到语音合成项目,由多个知名机构联合参与。该项目提供了高效的 LLM(大语言模型)驱动的语音合成方案,支持语音克隆和语音创建功能,可通过命令行界面(CLI)和 Web UI 两种方式使用。用户可以根据需求调整语音的性别、音高、速度等参数,生成高质量的语音。该项目适用于多种场景,如有声读物制作、智能语音助手开发等。

Trae

字节跳动发布的AI编程神器IDE

Trae是一种自适应的集成开发环境(IDE),通过自动化和多元协作改变开发流程。利用Trae,团队能够更快速、精确地编写和部署代码,从而提高编程效率和项目交付速度。Trae具备上下文感知和代码自动完成功能,是提升开发效率的理想工具。

咔片PPT

AI助力,做PPT更简单!

咔片是一款轻量化在线演示设计工具,借助 AI 技术,实现从内容生成到智能设计的一站式 PPT 制作服务。支持多种文档格式导入生成 PPT,提供海量模板、智能美化、素材替换等功能,适用于销售、教师、学生等各类人群,能高效制作出高品质 PPT,满足不同场景演示需求。

讯飞绘文

选题、配图、成文,一站式创作,让内容运营更高效

讯飞绘文,一个AI集成平台,支��持写作、选题、配图、排版和发布。高效生成适用于各类媒体的定制内容,加速品牌传播,提升内容营销效果。

材料星

专业的AI公文写作平台,公文写作神器

AI 材料星,专业的 AI 公文写作辅助平台,为体制内工作人员提供高效的公文写作解决方案。拥有海量公文文库、9 大核心 AI 功能,支持 30 + 文稿类型生成,助力快速完成领导讲话、工作总结、述职报告等材料,提升办公效率,是体制打工人的得力写作神器。

openai-agents-python

OpenAI Agents SDK,助力开发者便捷使用 OpenAI 相关功能。

openai-agents-python 是 OpenAI 推出的一款强大 Python SDK,它为开发者提供了与 OpenAI 模型交互的高效工具,支持工具调用、结果处理、追踪等功能,涵盖多种应用场景,如研究助手、财务研究等,能显著提升开发效率,让开发者更轻松地利用 OpenAI 的技术优��势。

Hunyuan3D-2

高分辨率纹理 3D 资产生成

Hunyuan3D-2 是腾讯开发的用于 3D 资产生成的强大工具,支持从文本描述、单张图片或多视角图片生成 3D 模型,具备快速形状生成能力,可生成带纹理的高质量 3D 模型,适用于多个领域,为 3D 创作提供了高效解决方案。

3FS

一个具备存储、管理和客户端操作等多种功能的分布式文件系统相关项目。

3FS 是一个功能强大的分布式文件系统项目,涵盖了存储引擎、元数据管理、客户端工具等多个模块。它支持多种文件操作,如创建文件和目录、设置布局等,同时具备高效的事件循环、节点选择和协程池管理等特性。适用于需要大规模数据存储和管理的场景,能够提高系统的性能和可靠性,是分布式存储领域的优质解决方案。

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号