EasyPortrait - 面部解析和人像分割数据集

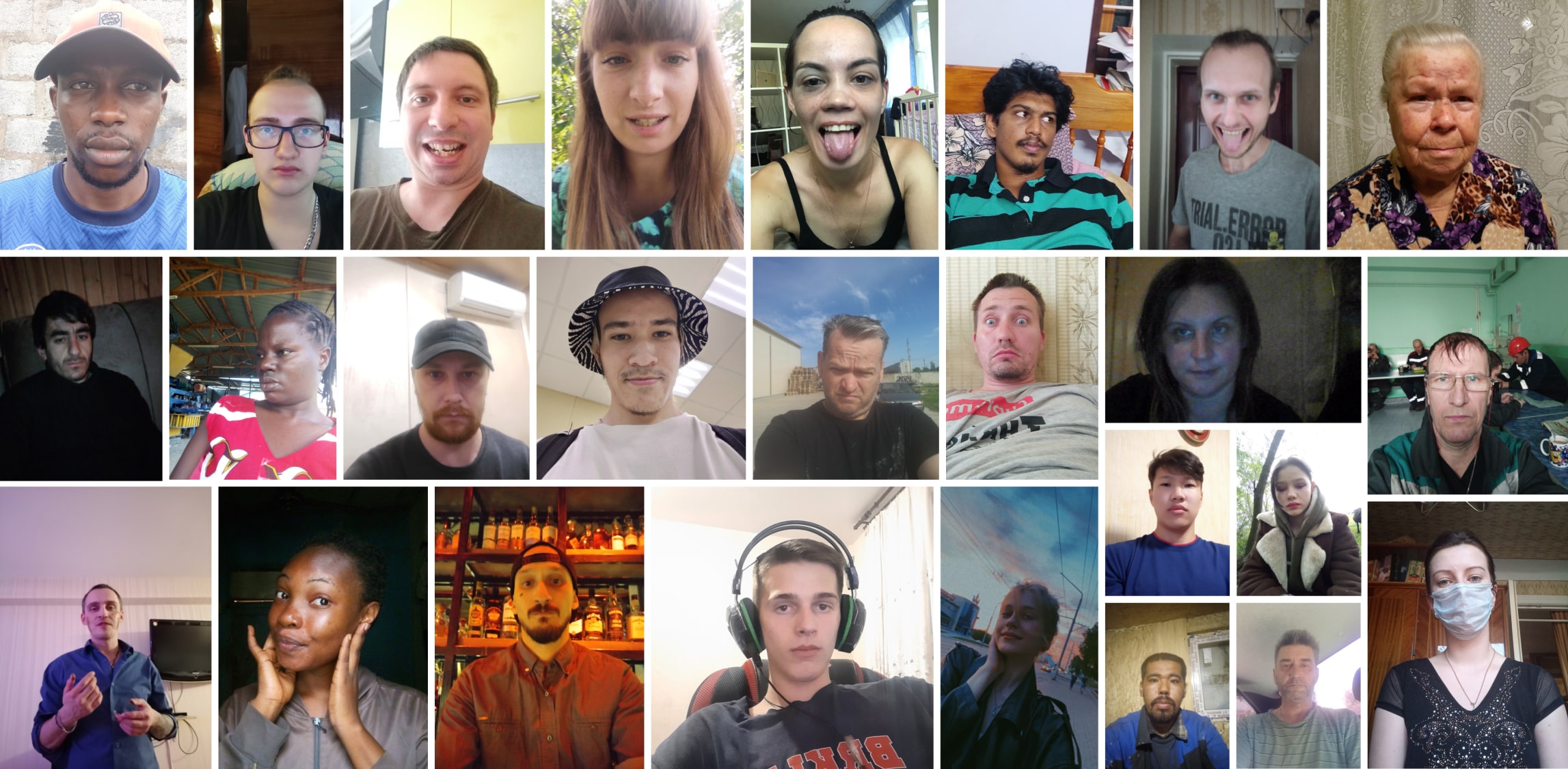

我们推出了一个大规模图像数据集EasyPortrait,用于人像分割和面部解析。该数据集可用于多项任务,如会议应用中的背景去除、牙齿美白、面部皮肤增强、红眼去除或眼睛着色等。

EasyPortrait数据集大小约为91.78GB,包含40,000张RGB图像(约38.3K全高清图像),带有高质量的标注掩码。该数据集按照user_id主题分为训练集、验证集和测试集。训练集包含30,000张图像,验证集包含4,000张图像,测试集包含6,000张图像。

更多信息请参阅我们的论文EasyPortrait – 面部解析和人像分割数据集。

🔥 更新日志

2023/11/13: 我们发布了EasyPortrait 2.0版本。✌️- 40,000张RGB图像(约38.3K全高清图像)

- 增加了地区、种族、人类情绪和光照条件的多样性

- 数据进行了进一步清理并添加了新内容

- 训练/验证/测试集划分:(30,000)75% /(4,000)10% /(6,000)15%,按照

user_id主题划分 - 多GPU训练和测试

- 为面部解析和人像分割添加了新模型

- 数据集大小为91.78GB

- 13,705个独特个体

2023/02/23: EasyPortrait(初始数据集)💪- 数据集大小为26GB

- 20,000张RGB图像(约17.5K全高清图像),标注了9个类别

- 训练/验证/测试集划分:(14,000)70% /(2,000)10% /�(4,000)20%,按照

user_id主题划分 - 8,377个独特个体

旧版EasyPortrait数据集也可在EasyPortrait_v1分支中获取!

下载

| 链接 | 大小 |

|---|---|

images | 91.8 GB |

annotations | 657.1 MB |

meta | 1.9 MB |

训练集 | 68.3 GB |

验证集 | 10.7 GB |

测试集 | 12.8 GB |

此外,您还可以从Kaggle下载EasyPortrait数据集。

结构

.

├── images.zip

│ ├── train/ # 训练集:30k

│ ├── val/ # 验证集:4k

│ ├── test/ # 测试集:6k

├── annotations.zip

│ ├── train/

│ ├── val/

│ ├── test/

├── meta.zip # 元信息(宽度、高度、亮度、imhash、user_id)

...

模型

我们提供了一些预训练模型作为人像分割和面部解析的基准。我们使用平均交并比(mIoU)作为主要评估指标。

人像分割:

| 模型名称 | 参数量(百万) | 输入尺寸 | 平均交并比 |

|---|---|---|---|

| BiSeNet-V2 | 56.5 | 384 x 384 | 97.95 |

| DANet | 190.2 | 384 x 384 | 98.63 |

| DeepLabv3 | 260 | 384 x 384 | 98.63 |

| ExtremeC3Net | 0.15 | 384 x 384 | 96.54 |

| Fast SCNN | 6.13 | 384 x 384 | 97.64 |

| FCN + MobileNetv2 | 31.17 | 384 x 384 | 98.19 |

| FPN + ResNet50 | 108.91 | 1024 × 1024 | 98.54 |

| FPN + ResNet50 | 108.91 | 512 × 512 | 98.64 |

| FPN + ResNet50 | 108.91 | 384 x 384 | 98.64 |

| FPN + ResNet50 | 108.91 | 224 × 224 | 98.31 |

| SegFormer-B0 | 14.9 | 1024 × 1024 | 98.74 |

| SegFormer-B0 | 14.9 | 512 × 512 | 98.66 |

| SegFormer-B0 | 14.9 | 384 x 384 | 98.61 |

| SegFormer-B0 | 14.9 | 224 × 224 | 98.17 |

| SINet | 0.13 | 384 x 384 | 93.32 |

人脸解析:

| 模型名称 | 参数量 (百万) | 输入尺寸 | 平均交并比 |

|---|---|---|---|

| BiSeNet-V2 | 56.5 | 384 x 384 | 76.72 |

| DANet | 190.2 | 384 x 384 | 79.3 |

| DeepLabv3 | 260 | 384 x 384 | 79.11 |

| EHANet | 44.81 | 384 x 384 | 72.56 |

| Fast SCNN | 6.13 | 384 x 384 | 67.56 |

| FCN + MobileNetv2 | 31.17 | 384 x 384 | 75.23 |

| FPN + ResNet50 | 108.91 | 1024 × 1024 | 85.37 |

| FPN + ResNet50 | 108.91 | 512 × 512 | 83.33 |

| FPN + ResNet50 | 108.91 | 384 x 384 | 81.83 |

| FPN + ResNet50 | 108.91 | 224 × 224 | 75.6 |

| SegFormer-B0 | 14.9 | 1024 × 1024 | 85.42 |

| SegFormer-B0 | 14.9 | 512 × 512 | 83.19 |

| SegFormer-B0 | 14.9 | 384 x 384 | 81.38 |

| SegFormer-B0 | 14.9 | 224 × 224 | 74.83 |

标注

标注以2D数组��的形式呈现,图像以 *.png 格式存储,包含多个类别:

| 索引 | 类别 |

|---|---|

| 0 | 背景 |

| 1 | 人物 |

| 2 | 皮肤 |

| 3 | 左眉 |

| 4 | 右眉 |

| 5 | 左眼 |

| 6 | 右眼 |

| 7 | 嘴唇 |

| 8 | 牙齿 |

此外,我们在 annotations/meta.zip 文件中提供了一些额外的数据集元信息:

| 图像名称 | 用户ID | 高度 | 宽度 | 集合 | 亮度 | |

|---|---|---|---|---|---|---|

| 0 | a753e021-... | 56... | 720 | 960 | 训练集 | 126 |

| 1 | 4ff04492-... | ba... | 1920 | 1440 | 测试集 | 173 |

| 2 | e8934c99-... | 1d... | 1920 | 1440 | 验证集 | 187 |

其中:

image_name- 不带扩展名的图像文件名user_id- 唯一的匿名用户IDheight- 图像高度width- 图像宽度brightness- 图像亮度set- "train"、"test" 或 "val" 分别表示训练集、测试集或验证集

图像

在EasyPortrait上进行训练、评估和测试

代码基于 MMSegmentation 0.30.0版本。

模型在8个NVIDIA V100 GPU上使用CUDA 11.2进行训练和评估。

安装过程请按照这里的说明进行,并使用我们仓库中的 requirements.txt 文件。

<details> <summary>训练</summary>单GPU模式:

python ./pipelines/tools/train.py ./pipelines/local_configs/easy_portrait_experiments/<model_dir>/<config_file>.py --gpu-id <GPU_ID>

分布式训练模式:

</details> <details> <summary>评估</summary>./pipelines/tools/dist_train.sh ./pipelines/local_configs/easy_portrait_experiments/<model_dir>/<config_file>.py <NUM_GPUS>

单GPU模式:

python ./pipelines/tools/test.py <PATH_TO_MODEL_CONFIG> <PATH_TO_CHECKPOINT> --gpu-id <GPU_ID> --eval mIoU

分布式评估模式:

</details> <details> <summary>运行演示</summary> ```console python ./pipelines/demo/image_demo.py <图片路径> <模型配置路径> <检查点路径> --palette=easy_portrait --out-file=<输出文件路径> ``` </details>./pipelines/tools/dist_test.sh <PATH_TO_MODEL_CONFIG> <PATH_TO_CHECKPOINT> <NUM_GPUS> --eval mIoU

作者与贡献者

相关链接

引用

您可以使用以下BibTeX条目引用本论文:

@article{EasyPortrait,

title={EasyPortrait - Face Parsing and Portrait Segmentation Dataset},

author={Kapitanov, Alexander and Kvanchiani, Karina and Kirillova Sofia},

journal={arXiv preprint arXiv:2304.13509},

year={2023}

}

许可证

<a rel="license" href="http://creativecommons.org/licenses/by-sa/4.0/"><img alt="知识共享许可协议" style="border-width:0" src="https://yellow-cdn.veclightyear.com/0a4dffa0/0ba9e5ef-5434-4c2c-a827-bf313e9940c7.png" /></a><br />本作品采用<a rel="license" href="http://creativecommons.org/licenses/by-sa/4.0/">知识共享署名-相同方式共享 4.0 国际许可协议</a>的一个变�种进行许可。

请查看具体的许可证。

编辑推荐精选

AEE

AI Excel全自动制表工具

AEE 在线 AI 全自动 Excel 编辑器,提供智能录入、自动公式、数据整理、图表生成等功能,高效处理 Excel 任务,提升办公效率。支持自动高亮数据、批量计算、不规则数据录入,适用于企业、教育、金融等多场景。

UI-TARS-desktop

基于 UI-TARS 视觉语言模型的桌面应用,可通过自然语言控制计算机进行多模态操作。

UI-TARS-desktop 是一款功能强大的桌面应用,基于 UI-TARS(视觉语言模型)构建。它具备自然语言控制、截图与视觉识别、精确的鼠标键盘控制等功能,支持跨平台使用(Windows/MacOS),能提供实时反馈和状态显示,且数据完全本地处理,保障隐私安全。该应用集成了多种大语言模型和搜索方式,还可进行文件系统操作。适用于需要智能交互和自动化任务的场景,如信息检索、文件管理等。其提供了详细的文档,包括快速启动、部署、贡献指南和 SDK 使用说明等,方便开发者使用和扩展。

Wan2.1

开源且先进的大规模视频生成模型项目

Wan2.1 是一个开源且先进的大规模视频生成模型项目,支持文本到图像、文本到视频、图像到视频等多种生成任务。它具备丰富的配置选项,可调整分辨率、扩散步数等参数,还能对提示词进行增强。使用了多种先进技术和工具,在视频和图像生成领域具有广泛应用前景,适合研究人员和开发者使用。

爱图表

全流程 AI 驱动的数据可视化工具,助力用户轻松创作高颜值图表

爱图表(aitubiao.com)就是AI图表,是由镝数科技推出的一款创新型智能数据可视化平台,专注于为用户提供便捷的图表生成、数据分析和报告撰写服务。爱图表是中国首个在图表场景接入DeepSeek的产品。通过接入前沿的DeepSeek系列AI模型,爱图表结合强大的数据处理能力与智能化功能,致力于帮助职场人士高效处理和表达数据,提升工作效率和报告质量。

Qwen2.5-VL

一款强大的视觉语言模型,支持图像和视频输入

Qwen2.5-VL 是一款强大的视觉语言模型,支持图像和视频输入,可用于多种场景,如商品特点总结、图像文字识别等。项目提供了 OpenAI API 服务、Web UI 示例等部署方式,还包含了视觉处理工具,有助于开发者快速集成和使用,提升工作效率。

HunyuanVideo

HunyuanVideo 是一个可基于文本生成高质量图像和视频的项目。

HunyuanVideo 是一个专注于文本到图像及视频生成的项目。它具备强大的视频生成能力,支持多种分辨率和视频长度选择,能根据用户输入的文本生成逼真的图像和视频。使用先进的技术架构和算法,可灵活调整生成参数,满足不同场景的需求,是文本生成图像视频领域的优质工具。

WebUI for Browser Use

一个基于 Gradio 构建的 WebUI,支持与浏览器智能体进行便捷交互。

WebUI for Browser Use 是一个强大的项目,它集成了多种大型语言模型,支持自定义浏览器使用,具备持久化浏览器会话等功能。用户可以通过简洁友好的界面轻松控制浏览器智能体完成各类任务,无论是数据提取、网页导航还是表单填写等操作都能高效实现,有利于提高工作效率和获取信息的便捷性。该项目适合开发者、研究人员以及需要自动化浏览器操作的人群使用,在 SEO 优化方面,其关键词涵盖浏览器使用、WebUI、大型语言模型集成等,有助于提高网页在搜索引擎中的曝光度。

xiaozhi-esp32

基于 ESP32 的小智 AI 开发项目,支持多种网络连接与协议,实现语音交互等功能。

xiaozhi-esp32 是一个极具创新性的基于 ESP32 的开发项目,专注于人工智能语音交互领域。项目涵盖了丰富的功能,如网络连接、OTA 升级、设备激活等,同时支持多种语言。无论是开发爱好者还是专业开发者,都能借助该项目快速搭建起高效的 AI 语音交互系统,为智能设备开发提供强大助力。

olmocr

一个用于 OCR 的项目,支持多种模型和服务器进行 PDF 到 Markdown 的转换,并提供测试和报告功能。

olmocr 是一个专注于光学字符识别(OCR)的 Python 项目,由 Allen Institute for Artificial Intelligence 开发。它支持多种模型和服务器,如 vllm、sglang、OpenAI 等,可将 PDF 文件的页面转换为 Markdown 格式。项目还提供了测试框架和 HTML 报告生成功能,方便用户对 OCR 结果进行评估和分析。适用于科研、文档处理等领域,有助于提高工作效率和准确性。

飞书多维表格

飞书多维表格 ×DeepSeek R1 满血版

飞书多维表格联合 DeepSeek R1 模型,提供 AI 自动化解决方案,支持批量写作、数据分析、跨模态处理等功能,适用于电商、短视频、影视创作等场景,提升企业生产力与创作效率。关键词:飞书多维表格、DeepSeek R1、AI 自动化、批量处理、企业协同工具。

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号