电影般的意识景观:从大脑活动中高质量重建视频

<p align="center"> <img src=assets/first_fig.png /> </p>MinD-Video

MinD-Video是一个从大脑记录中高质量重建视频的框架。<br/>

电影般的意识景观:从大脑活动中高质量重建视频.<br/> 陈子娇*, 卿佳欣*, 周海伦<br/> * 共同第一作者 <br/>

新闻

- 2023年9月22日:被NeurIPS 2023接收为口头报告。

- 2023年5月20日:预印本发布。

摘要

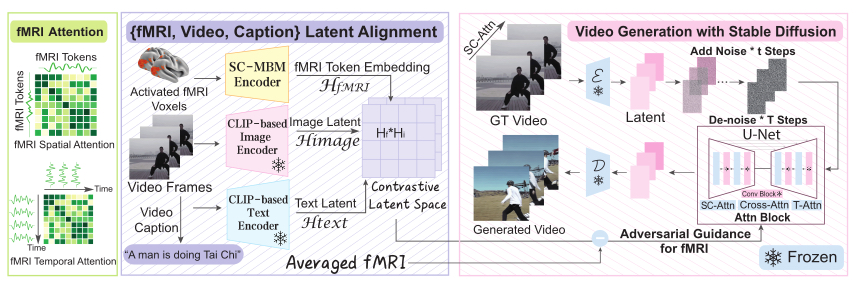

从大脑活动中重建人类视觉一直是一项引人入胜的任务,有助于我们理解认知过程。尽管近期研究在从非侵入性脑记录中重建静态图像方面取得了巨大成功,但在以视频形式恢复连续视觉体验方面的工作仍然有限。 在本研究中,我们提出了MinD-Video,它通过掩码大脑建模、使用时空注意力的多模态对比学习,以及与增强型Stable Diffusion模型(融合了网络时间膨胀)的共同训练,从大脑皮层的连续fMRI数据中逐步学习时空信息。 我们展示了使用对抗性引导,MinD-Video可以重建任意帧率的高质量视频。重建的视频通过各种语义和像素级指标进行了评估。我们在语义分类任务中达到了85%的平均准确率,结构相似性指数(SSIM)达到0.19,比之前的最先进水平提高了45%。我们还表明,我们的模型在生物学上是合理的,且具有可解释性,反映了已建立的生理过程。

概述

样本展示

- 以下展示了一些样本。我们的方法可以重建各种物体、动物、动作和场景。重建的视频质量高,且与地面真实情况一致。更多样本请参阅我们的网站或通过谷歌云盘下载。

- 以下样本目前是在一块RTX3090上生成的。由于GPU内存限制,下面展示的样本当前是2秒长、3帧每秒、256 x 256分辨率的视频。但如果有更多GPU内存可用,我们的方法可以处理更长的大脑记录并重建更长、全帧率(30帧每秒)和更高分辨率的视频。

环境配置

使用我们的env.yaml创建并激活名为mind-video的conda环境

conda env create -f env.yaml conda activate mind-video

下载数据和检查点

大规模预训练数据集从HCP下载。有关大规模预训练脚本,请参考这个仓库。 我们的目标数据集Wen (2018)可以从这里下载。

从这里下载预训练检查点和预处理的测试数据。相应地更改配置文件中的路径。

复现我们的结果

方法1:使用预训练检查点运行生成

python scripts/eval_all.py --config configs/eval_all_sub1.yaml

将half_precision设置为True,num_inference_steps设置为50以加快推理速度。

方法2:下载生成的视频并运行指标评估

从谷歌云盘下载生成的视频。

python scripts/run_metrics.py /path/to/generated/videos

致谢

我们感谢Tune-A-Video的作者开源他们的代码。我们还要感谢普渡大学综合脑成像实验室公开他们的数据。

BibTeX

@article{chen2023cinematic,

title={Cinematic Mindscapes: High-quality Video Reconstruction from Brain Activity},

author={Chen, Zijiao and Qing, Jiaxin and Zhou, Juan Helen},

journal={NeurIPS},

year={2023}

}

编辑推荐精选

讯飞智文

一键生成PPT和Word,让学习生活更轻松

讯飞智文是一个利用 AI 技术的项目,能够帮助用户生成 PPT 以及各类文档。无论是商业领域的市场分析报告、年度目标制定,还是学生群体的职业生涯规划、实习避坑指南,亦或是活动策划、旅游攻略等内容,它都能提供支持,帮助用户精准表达,轻松呈现各种信息。

讯飞星火

深度推理能力全新升级,全面对标OpenAI o1

科大讯飞的星火大模型,支持语言理解、知识问答和文本创作等多功能,适用于多种文件和业务场景,提升办公和日常生活的效率。讯飞星火是一个提供丰富智能服务的平台,涵盖科技资讯、图像创作、写作辅助、编程解答、科研文献解读等功能,能为不同需求的用户提供便捷高效的帮助,助力用户轻松获取信息、解决问题,满足多样化使用场景。

Spark-TTS

一种基于大语言模型的高效单流解耦语音令牌文本到语音合成模型

Spark-TTS 是一个基于 PyTorch 的开源文本到语音合成项目,由多个知名机构联合参与。该项目提供了高效的 LLM(大语言模型)驱动的语音合成方案,支持语音克隆和语音创建功能,可通过命令行界面(CLI)和 Web UI 两种方式使用。用户可以根据需求调整语音的性别、音高、速度等参数,生成高质量的语音。该项目适用于多种场景,如有声读物制作、智能语音助手开发等。

Trae

字节跳动发布的AI编程神器IDE

Trae是一种自适应的集成开发环境(IDE),通过自动化和多元协作改变开发流程。利用Trae,团队能够更快速、精确地编写和部署代码,从而提高编程效率和项目交付速度。Trae具备上下文感知和代码自动完成功能,是提升开发效率的理想工具。

咔片PPT

AI助力,做PPT更简单!

咔片是一款轻量化在线演示设计工具,借助 AI 技术,实现从内容生成到智能设计的一站式 PPT 制作服务。支持多种文档格式导入生成 PPT,提供海量模板、智能美化、素材替换等功能,适用于销售、教师、学生等各类人群,能高效制作出高品质 PPT,满足不同场景演示需求。

讯飞绘文

选题、配图、成文,一站式创作,让内容运营更高效

讯飞绘文,一个AI集成平台,支持写作、选题、配图、排版和发布。高效生成适用于各类媒体的定制内容,加速品牌传播,提升内容营销效果。

材料星

专业的AI公文写作平台,公文写作神器

AI 材料星,专业的 AI 公文写作辅助平台,为体制内工作人员提供高效的公文写作解决方案。拥有海量公文文库、9 大核心 AI 功能,支持 30 + 文稿类型生成,助力快速完成领导讲话、工作总结、述职报告等材料,提升办公效率,是体制打工人的得力写作神器。

openai-agents-python

OpenAI Agents SDK,助力开发者便捷使用 OpenAI 相关功能��。

openai-agents-python 是 OpenAI 推出的一款强大 Python SDK,它为开发者提供了与 OpenAI 模型交互的高效工具,支持工具调用、结果处理、追踪等功能,涵盖多种应用场景,如研究助手、财务研究等,能显著提升开发效率,让开发者更轻松地利用 OpenAI 的技术优势。

Hunyuan3D-2

高分辨率纹理 3D 资产生成

Hunyuan3D-2 是腾讯开发的用于 3D 资产生成的强大工具,支持从文本描述、单张图片或多视角图片生成 3D 模型,具备快速形状生成能力,可生成带纹理的高质量 3D 模型,适用于多个领域,为 3D 创作提供了高效解决方案。

3FS

一个具备存储、管理和客户端操作等多种功能的分布式文件系统相关项目。

3FS 是一个功能强大的分布式文件系统项目,涵盖了存储引擎、元数据管理、客户端工具等多个模块。它支持多种文件操作,如创建文件和目录、设置布局等,同时具备高效的事件循环、节点选择和协程池管理等特性。适用于需要大规模数据存储和管理的场景,能够提高系统的性能和可靠性,是分布式存储领域的优质解决方案。

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号