超越自注意力:用于医学图像分割的可变形大核注意力 <br> <span style="float: right"><sub><sup>WACV 2024</sub></sup></span>

我们提出了一种名为**可变形大核注意力(D-LKA Attention)**的新方法来改进医学图像分割。该方法使用大型卷积核高效捕获体积上下文,避免了过高的计算需求。D-LKA Attention还借助可变形卷积来适应不同的数据模式。我们创建了2D和3D两个版本,其中3D版本在跨深度数据理解方面表现出色。这构成了我们新的分层Vision Transformer架构D-LKA Net的基础,该架构在常用医学分割数据集(Synapse、NIH胰腺和皮肤病变)上的表现优于现有方法。

<br> <p align="center"> <img src="https://github.com/xmindflow/deformableLKA/assets/61879630/734ce92c-aadd-4e5b-8e82-83af707605ed" width="900"> </p>Reza Azad, Leon Niggemeier, Michael Hüttemann, Amirhossein Kazerouni, Ehsan Khodapanah Aghdam, Yury Velichko, Ulas Bagci 和 Dorit Merhof

💥 新闻 💥

-

2023年10月24日| 被WACV 2024接收! 🥳 -

2023年10月16日| 发布2D、3D Synapse权重和3D胰腺权重。

结果

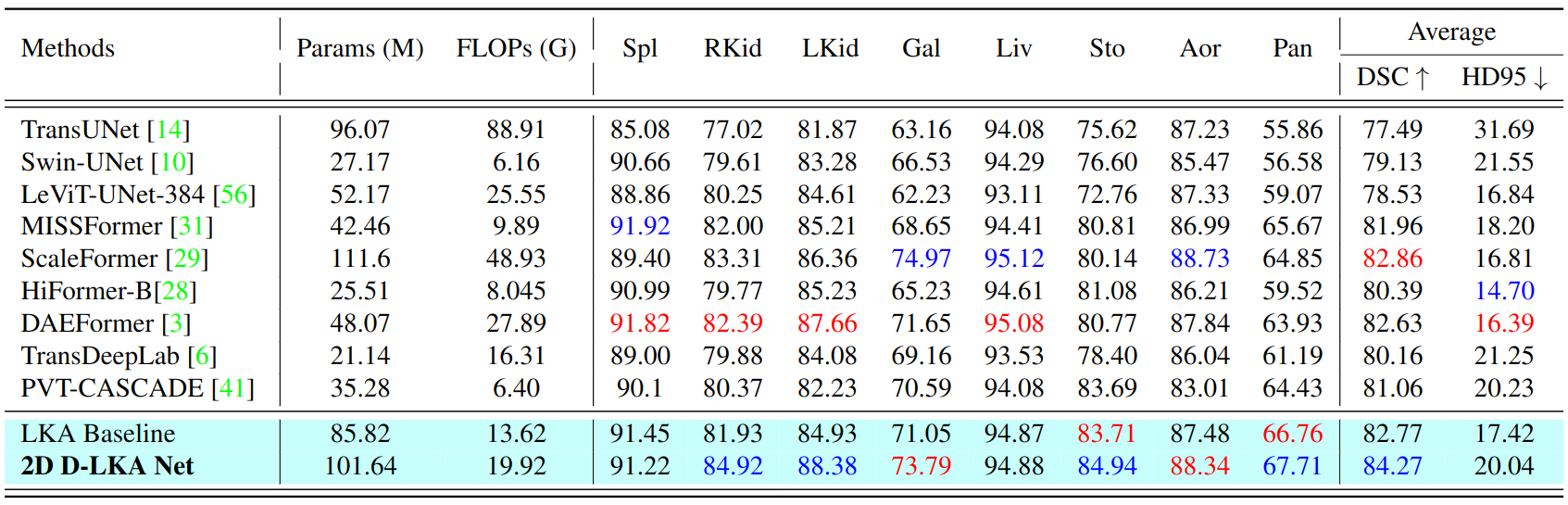

2D Synapse数据集

在腹部多器官Synapse数据集上与2D方法的最新技术对比。显示了所有模型的复杂度和性能(DSC, HD95)。所提出的2D D-LKA Net达到了优越的分割性能。缩写代表:Spl: 脾脏, RKid: 右肾, LKid: 左肾, Gal: 胆囊, Liv: 肝脏, Sto: 胃, Aor: 主动脉, Pan: 胰腺。最佳结果用<h style="color:blue;">蓝色</h>显示,第二好的用<h style="color:red;">红色</h>显示。

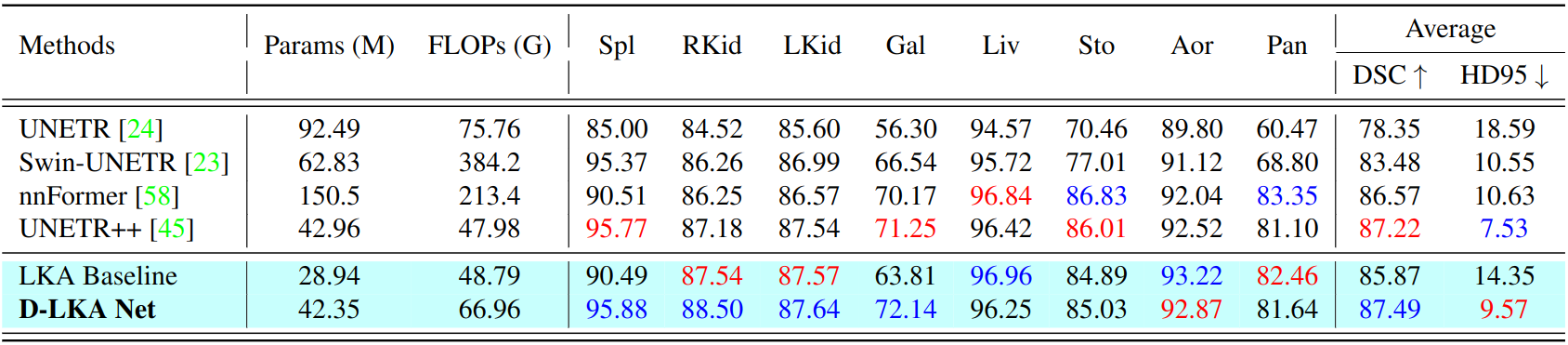

3D Synapse数据集

在腹部多器官Synapse数据集上与3D方法的最新技术对比。显示了所有模型的复杂度和性能(DSC, HD95)。所提出的3D D-LKA Net达到了优越的分割性能。我们的模型也相当小,参数数量最少。缩写代表:Spl: 脾脏, RKid: 右肾, LKid: 左肾, Gal: 胆囊, Liv: 肝脏, Sto: 胃, Aor: 主动脉, Pan: 胰腺。最佳结果用<h style="color:blue;">蓝色</h>显示,第二好的用<h style="color:red;">红色</h>显示。

定性结果

虽然2D版本与其他2D模型相比取得了很好的分割结果,但主要局限性在于缺乏切片间的连接。在这里,3D模型实现了更好的分割效果。

<p align="center"> <img src="https://yellow-cdn.veclightyear.com/0a4dffa0/3edb9abd-7225-4ef0-899e-d099241bad9d.png" width="750"> </p>2D说明

有关2D方法的详细说明,请参阅2D文件夹中的Readme。

3D说明

有关3D方法的详细说明,请参阅3D文件夹中的Readme。

致谢

该存储库基于nnFormer、UNETR++、transnorm、MCF、D3D构建。我们感谢这些作者提供的代码库。

查询

所有实现均由Leon Niggemeier完成。如有任何疑问,请联系我们以获取更多信息。

leon.niggemeier@rwth-aachen.de

引用

@article{azad2023beyond, title={Beyond Self-Attention: Deformable Large Kernel Attention for Medical Image Segmentation}, author={Azad, Reza and Niggemeier, Leon and Huttemann, Michael and Kazerouni, Amirhossein and Aghdam, Ehsan Khodapanah and Velichko, Yury and Bagci, Ulas and Merhof, Dorit}, journal={arXiv preprint arXiv:2309.00121}, year={2023} }

编辑推荐精选

AEE

AI Excel全自动制表工具

AEE 在线 AI 全自动 Excel 编辑器,提供智能录入、自动公式、数据整理、图表生成等功能,高效处理 Excel 任务,提升办公效率。支持自动高亮数据、批量计算、不规则数据录入,适用于企业、教育、金融等多场景。

UI-TARS-desktop

基于 UI-TARS 视觉语言模型的桌面应用,可通过自然语言控制计算机进行多模态操作。

UI-TARS-desktop 是一款功能强大的桌面应用,基于 UI-TARS(视觉语言模型)构建。它具备自然语言控制、截图与视觉识别、精确的鼠标键盘控制等功能,支持跨平台使用(Windows/MacOS),能提供实时反馈和状态显示,且数据完全本地处理,保障隐私安全。该应用集成了多种大语言模型和搜索方式,还可进行文件系统操作。适用于需要智能交互和自动化任务的场景,如信息检索、文件管理等。其提供了详细的文档,包括快速启动、部署、贡献指南和 SDK 使用说明等,方便开发者使用和扩展。

Wan2.1

开源且先进的大规模视频生成模型项目

Wan2.1 是一个开源且先进的大规模视频生成模型项目,支持文本到图像、文本到视频、图像到视频等多种生成任务。它具备丰富的配置选项,可调整分辨率、扩散步数等参数,还能对提示词进行增强。使用了多种先进技术和工具,在视频和图像生成领域具有广泛应用前景,适合研究人员和开发者使用。

爱图表

全流程 AI 驱动的数据可视化工具,助力用户轻松创作高颜值图表

爱图表(aitubiao.com)就是AI图表,是由镝数科技推出的一款创新型智能数据可视化平台,专注于为用户提供便捷的图表生成、数据分析和报告撰写服务。爱图表是中国首个在图表场景接入DeepSeek的产品。通过接入前沿的DeepSeek系列AI模型,爱图表结合强大的数据处理能力与智能化功能,致力于帮助职场人士高效处理和表达数据,提升工作效率和报告质量。

Qwen2.5-VL

一款强大的视觉语言模型,支持图像和视频输入

Qwen2.5-VL 是一款强大的视觉语言模型,支持图像和视频输入,可用于多种场景,如商品特点总结、图像文字识别等。项目提供了 OpenAI API 服务、Web UI 示例等部署方式,还包含了视觉处理工具,有助于开发者快速集成和使用,提升工作效率。

HunyuanVideo

HunyuanVideo 是一个可基于文本生成高质量图像和视频的项目。

HunyuanVideo 是一个专注于文本到图像及视频生成的项目。它具备强大的视频生成能力,支持多种分辨率和视频长度选择,能根据用户输入的文本生成逼真的图像和视频。使用先进的技术架构和算法,可灵活调整生成参数,满足不同场景的需求,是文本生成图像视频领域的优质工具。

WebUI for Browser Use

一个基于 Gradio 构建的 WebUI,支持与浏览器智能体进行便捷交互。

WebUI for Browser Use 是一个强大的项目,它集成了多种大型语言模型,�支持自定义浏览器使用,具备持久化浏览器会话等功能。用户可以通过简洁友好的界面轻松控制浏览器智能体完成各类任务,无论是数据提取、网页导航还是表单填写等操作都能高效实现,有利于提高工作效率和获取信息的便捷性。该项目适合开发者、研究人员以及需要自动化浏览器操作的人群使用,在 SEO 优化方面,其关键词涵盖浏览器使用、WebUI、大型语言模型集成等,有助于提高网页在搜索引擎中的曝光度。

xiaozhi-esp32

基于 ESP32 的小智 AI 开发项目,支持多种网络连接与协议,实现语音交互等功能。

xiaozhi-esp32 是一个极具创新性的基于 ESP32 的开发项目,专注于人工智能语音交互领域。项目涵盖了丰富的功能,如网络连接、OTA 升级、设备激活等,同时支持多种语言。无论是开发爱好者还是专��业开发者,都能借助该项目快速搭建起高效的 AI 语音交互系统,为智能设备开发提供强大助力。

olmocr

一个用于 OCR 的项目,支持多种模型和服务器进行 PDF 到 Markdown 的转换,并提供测试和报告功能。

olmocr 是一个专注于光学字符识别(OCR)的 Python 项目,由 Allen Institute for Artificial Intelligence 开发。它支持多种模型和服务器,如 vllm、sglang、OpenAI 等,可将 PDF 文件的页面转换为 Markdown 格式。项目还提供了测试框架和 HTML 报告生成功能,方便用户对 OCR 结果进行评估和分析。适用于科研、文档处理等领域,有助于提高工作效率和准确性。

飞书多维表格

飞书多维表格 ×DeepSeek R1 满血版

飞书多维表格联合 DeepSeek R1 模型,提供 AI 自动化解决方案,支持批量写作、数据分析、跨模态处理等功能,适用于电商、短视频、影视创作等场景,提升企业生产力与创作效率。关键词:飞书多维表格、DeepSeek R1、AI 自动化、批量处理、企业协同工具。

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号