Seeing-and-Hearing

创新框架实现多任务视听内容生成

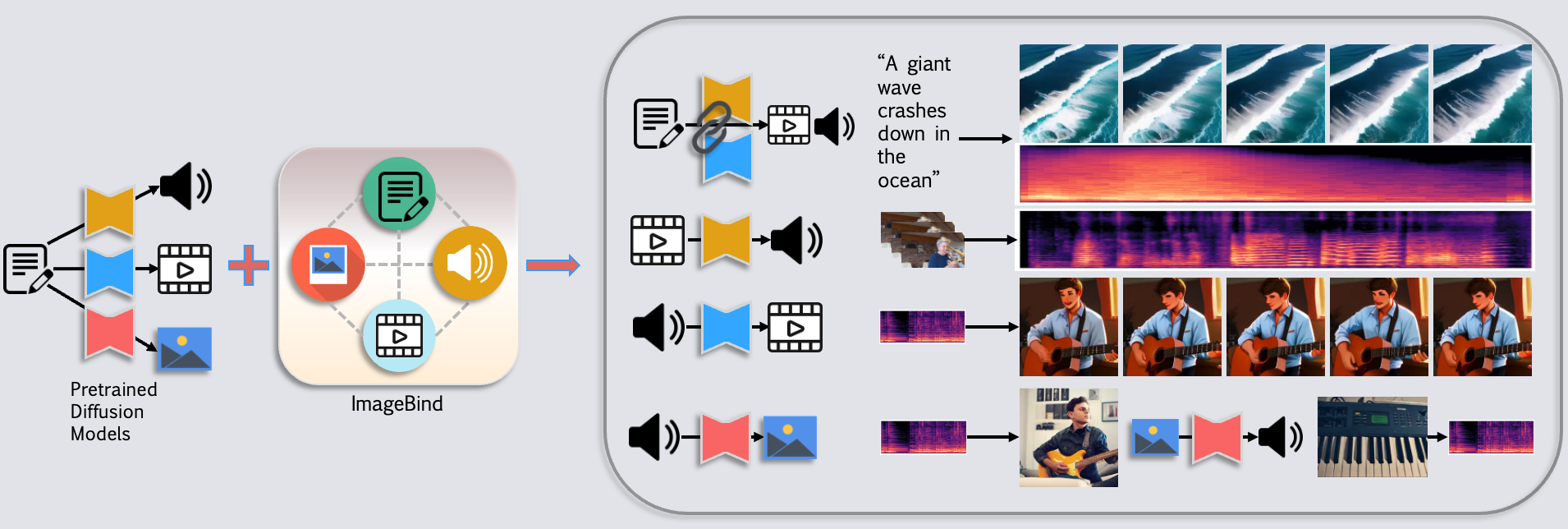

Seeing-and-Hearing项目提出了一种优化框架,用于跨模态和联合视听内容生成。该方法使用预训练的ImageBind模型连接独立的视频和音频生成模型,实现双向条件生成和联合视听生成。这一技术适用于视频到音频、音频到视频、图像到音频等多种任务,为内容创作提供了新的可能。

视听一体

本仓库包含了"视听一体化:基于扩散潜在对齐器的开放域视听生成(CVPR 2024)"的官方代码。

🔮 方法

框架概览。 我们的方法versatile,可以解决四个任务:联合视频音频生成(Joint-VA)、视频到音频(V2A)、音频到视频(A2V)和图像到音频(I2A)。通过利用多模态绑定器(如预训练的ImageBind),我们在设计用于生成单一模态的独立生成模型之间建立了连接。这使我们能够实现双向条件生成和联合视频/音频生成。

框架概览。 我们的方法versatile,可以解决四个任务:联合视频音频生成(Joint-VA)、视频到音频(V2A)、音频到视频(A2V)和图像到音频(I2A)。通过利用多模态绑定器(如预训练的ImageBind),我们在设计用于生成单一模态的独立生成模型之间建立了连接。这使我们能够实现双向条件生成和联合视频/音频生成。

🔆 摘要

视频和音频内容创作是电影行业和专业用户的核心技术。近期,现有的基于扩散的方法分别处理视频和音频生成,这阻碍了该技术从学术界向产业界的转化。在本研究中,我们旨在填补这一空白,通过精心设计的基于优化的框架实现跨视听和联合视听生成。我们观察到现成的视频或音频生成模型具有强大的生成能力。因此,我们不是从头开始训练庞大的模型,而是提出通过共享的潜在表示空间来连接现有的强大模型。

具体而言,我们提出了一个基于预训练ImageBind模型的多模态潜在对齐器。我们的潜在对齐器与在推理时指导扩散去噪过程的分类器引导有相似的核心。通过精心设计的优化策略和损失函数,我们展示了我们的方法在联合视频音频生成、视觉引导的音频生成和音频引导的视觉生成任务上的卓越性能。项目网站可在https://yzxing87.github.io/Seeing-and-Hearing/找到。

视听一体化:基于扩散潜在对齐器的开放域视听生成 <br> 邢亚洲<sup>* 1</sup>,何颖晴<sup>* 1</sup>,田泽越<sup>* 1</sup>,王鑫涛<sup>2</sup>,陈启峰<sup>1</sup> (*表示贡献相同)<br> <sup>1</sup>香港科技大学, <sup>2</sup>腾讯PCG ARC实验室 <br>

待办事项

- 开源v2a代码

- 开源评估代码

- 开源joint-va、a2v和i2v代码

⚙️ 代码

安装

请按以下说明操作:

git clone https://github.com/yzxing87/Seeing-and-Hearing.git

cd Seeing-and-Hearing/v2a

conda create -n seeing python=3.10

conda activate seeing

pip install -r pip_env3.txt

pip install git+https://github.com/yzxing87/transformers

pip install "git+https://github.com/facebookresearch/pytorchvideo.git"

pip install transformers_stream_generator

V2A生成

-

下载必要的检查点

(1) 从huggingface仓库下载audioldm检查点。将检查点放到

ckpt/。mkdir ckpt; cd ckpt git clone https://huggingface.co/cvssp/audioldm-m-full cd ..(2) 从官方仓库下载imagebind检查点

imagebind_huge.pth。将检查点放到imagebind/.checkpoints/。mkdir imagebind/.checkpoints; cd imagebind/.checkpoints wget https://dl.fbaipublicfiles.com/imagebind/imagebind_huge.pth cd ../..(3) 从huggingface仓库下载qwen检查点。将检查点放到

qwen_ckpt/。mkdir qwen_ckpt; cd qwen_ckpt git clone https://huggingface.co/Qwen/Qwen-VL-Chat cd .. -

按照

pipeline.sh操作

🤗 引用

@inproceedings{xing24seeing,

title = {Seeing and Hearing: Open-domain Visual-Audio Generation with Diffusion Latent Aligners},

author = {Xing, Yazhou and He, Yingqing and Tian, Zeyue and Wang, Xintao and Chen, Qifeng},

booktitle = {CVPR},

year = {2024}

}

📭 联系

许可证

请遵循CC-BY-NC。

编辑推荐精选

讯飞智文

一键生成PPT和Word,让学习生活更轻松

讯飞智文是一个利用 AI 技术的项目,能够帮助用户生成 PPT 以及各类文档。无论是商业领域的市场分析报告、年度目标制定,还是学生群体的职业生涯规划、实习避坑指南,亦或是活动策划、旅游攻略等内容,它都能提供支持,帮助用户精准表达,轻松呈现各种信息。

讯飞星火

深度推理能力全新升级,全面对标OpenAI o1

科大讯飞的星火大模型,支持语言理解、知识问答和文本创作等多功能,适用于多种文件和业务场景,提升办公和日常生活的效率。讯飞星火是一个提供丰富智能服务的平台,涵盖科技资讯、图像创作、写作辅助、编程解答、科研文献解读等功能,能为不同需求的用户提供便捷高效的帮助,助力用户轻松获取信息、解决问题,满足多样化使用场景。

Spark-TTS

一种基于大语言模型的高效单流解耦语音令牌文本到语音合成模型

Spark-TTS 是一个基于 PyTorch 的开源文本到语音合成项目,由多个知名机构联合参与。该项目提供了高效的 LLM(大语言模型)驱动的语音合成方案,支持语音克隆和语音创建功能,可通过命令行界面(CLI)和 Web UI 两种方式使用。用户可以根据需求调整语音的性别、音高、速度等参数,生成高质量的语音。该项目适用于多种场景,如有声读物制作、智能语音助手开发等。

Trae

字节跳动发布的AI编程神器IDE

Trae是一种自适应的集成开发环境(IDE),通过自动化和多元协作改变开发流程。利用Trae,团队能够更快速、精确地编写和部署代码,从而提高编程效率和项目交付速度。Trae具备上下文感知和代码自动完成功能,是提升开发效率的理想工具。

咔片PPT

AI助力,做PPT更简单!

咔片是一款轻量化在线演示设计工具,借助 AI 技术,实现从内容生成到智能设计的一站式 PPT 制作服务。支持多种文档格式导入生成 PPT,提供海量模板、智能美化、素材替换等功能,适用于销售、教师、学生等各类人群,能高效制作出高品质 PPT,满足不同场景演示需求。

讯飞绘文

选题、配图、成文,一站式创作,让内容运营更高效

讯飞绘文,一个AI集成平台,支持写作、选题、配图、排版和发布。高效生成适用于各类媒体的定制内容,加速品牌传播,提升内容营销效果。

材料星

专业的AI公文写作平台,公文写作神器

AI 材料星,专业的 AI 公文写作辅助平台,为体制内工作人员提供高效的公文写作解决方案。拥有海量公文文库、9 大核心 AI 功能,支持 30 + 文稿类型生成,助力快速完成领导讲话、工作总结、述职报告等材料,提升办公效率,是体制打工人的得力写作神器。

openai-agents-python

OpenAI Agents SDK,助力开发者便捷使用 OpenAI 相关功能。

openai-agents-python 是 OpenAI 推出的一款强大 Python SDK,它为开发者提供了与 OpenAI 模型交互的高效工具,支持工具调用、结果处理、追踪等功能,涵盖多种应用场景,如研究助手、财务研究等,能显著提升开发效率,让开发者更轻松地利用 OpenAI 的技术优势。

Hunyuan3D-2

��高分辨率纹理 3D 资产生成

Hunyuan3D-2 是腾讯开发的用于 3D 资产生成的强大工具,支持从文本描述、单张图片或多视角图片生成 3D 模型,具备快速形状生成能力,可生成带纹理的高质量 3D 模型,适用于多个领域,为 3D 创作提供了高效解决方案。

3FS

一个具备存储、管理和客户端操作等多种功能的分布式文件系统相关项目。

3FS 是一个功能强大的分布式文件系统项目,涵盖了存储引擎、元数据管理、客户端工具等多个模块。它支持多种文件操作,如创建文件和目录、设置布局等,同时具备高效的事件循环、节点选择和协程池管理等特性。适用于需要大规模数据存储和管理的场景,能够提高系统的性能和可靠性,是分布式存储领域的优质解决方案。

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号