azure-openai-proxy项目介绍

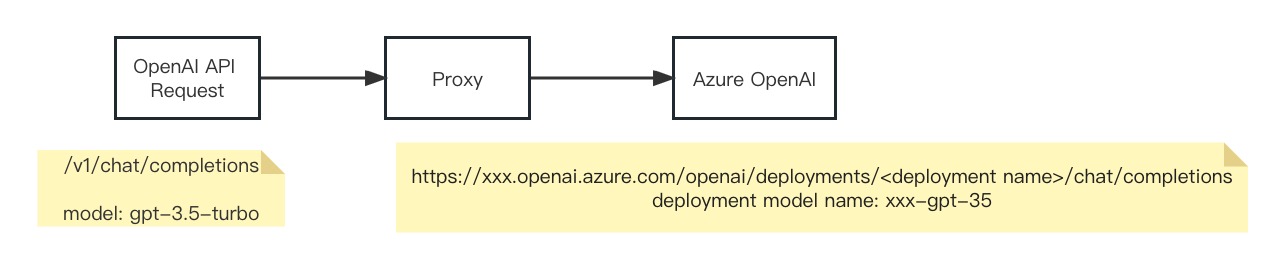

azure-openai-proxy是一个Azure OpenAI Service代理工具,可以将OpenAI官方API请求转换为Azure OpenAI API请求,支持所有模型,包括GPT-4和Embeddings。它的主要作用是消除OpenAI和Azure OpenAI之间的差异,作为连接两者的桥梁,让OpenAI生态系统能够零成本访问Azure OpenAI。

主要功能

- 将OpenAI官方API请求转换为Azure OpenAI API请求

- 支持所有OpenAI模型,包括GPT-4、GPT-3.5、Embeddings等

- 支持多个Azure区域的负载均衡

- 支持HTTP和Socks5代理

- 支持Docker部署

- 支持配置文件方式配置不同模型的端点和API密钥

快速开始

- 获取Azure OpenAI的密钥和端点信息

- 配置环境变量:

- AZURE_OPENAI_ENDPOINT: Azure OpenAI API端点

- AZURE_OPENAI_API_VER: API版本,默认2024-02-01

- AZURE_OPENAI_MODEL_MAPPER: 模型映射关系

- 使用Docker运行:

docker run -d -p 8080:8080 --name=azure-openai-proxy \

--env AZURE_OPENAI_ENDPOINT=your_azure_endpoint \

--env AZURE_OPENAI_API_VER=your_azure_api_ver \

--env AZURE_OPENAI_MODEL_MAPPER=your_azure_deploy_mapper \

stulzq/azure-openai-proxy:latest

- 调用API:

curl --location --request POST 'localhost:8080/v1/chat/completions' \

-H 'Authorization: Bearer <Azure OpenAI Key>' \

-H 'Content-Type: application/json' \

-d '{

"max_tokens": 1000,

"model": "gpt-3.5-turbo",

"temperature": 0.8,

"top_p": 1,

"presence_penalty": 1,

"messages": [

{

"role": "user",

"content": "Hello"

}

],

"stream": true

}'

进阶使用

- 支持ChatGPT-Next-Web和ChatGPT-Web等项目

- 支持使用配置文件配置多个模型的不同端点和API密钥

- 支持HTTP和Socks5代理

相关资源

azure-openai-proxy为开发者提供了一种简便的方式来使用Azure OpenAI服务,同时保持与OpenAI API的兼容性。通过学习和使用该工具,可以更好地利用Azure OpenAI的资源和功能。