Chat LangChain: 打造智能问答系统的全面指南

在人工智能和自然语言处理技术快速发展的今天,智能问答系统已经成为提升用户体验和工作效率的重要工具。本文将为您详细介绍 Chat LangChain 项目,这是一个专门针对 LangChain 文档进行问答的聊天机器人系统。我们将深入探讨其技术架构、实现过程,以及如何部署和使用这个强大的工具。

项目概述

Chat LangChain 是一个开源项目,旨在创建一个能够智能回答 LangChain 文档相关问题的聊天机器人。该项目利用了 LangChain、LangGraph 和 Next.js 等先进技术,实现了实时流式处理和异步 API,为多用户提供流畅的问答体验。

技术栈及核心功能

- LangChain: 用于构建基于大型语言模型的应用程序

- LangGraph: 提供流式处理和异步 API 支持

- Next.js: 用于构建前端界面

Chat LangChain 的核心功能包括:

- 智能文档问答

- 实时流式回答生成

- 支持多用户同时使用

- 提供答案来源引用

实现过程

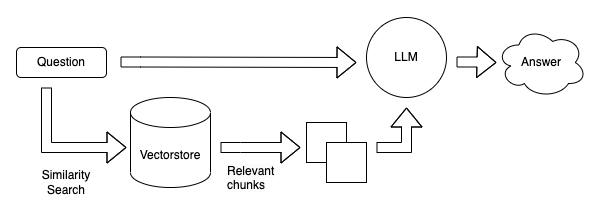

Chat LangChain 的实现主要分为两个阶段:数据摄入和问答处理。

数据摄入

- 从 LangChain 文档网站和 GitHub 代码库抓取 HTML 内容

- 使用 LangChain 的 RecursiveURLLoader 和 SitemapLoader 加载 HTML

- 使用 RecursiveCharacterTextSplitter 将文档分割成小块

- 利用 Weaviate 向量存储包装器创建嵌入向量存储

问答处理

- 根据聊天历史和用户输入,使用语言模型生成独立问题

- 从向量存储中检索相关文档

- 将独立问题和相关文档传递给模型,生成并流式传输最终答案

- 生成当前聊天会话的追踪 URL 和收集反馈的端点

部署和使用

Chat LangChain 目前使用 LangGraph Cloud 进行部署,这意味着无法在本地运行(除非拥有 LangGraph Cloud 账户)。如果您想在没有 LangGraph Cloud 的情况下运行,可以使用 langserve 分支的代码和文档。

要使用 Chat LangChain,只需访问 chat.langchain.com 即可开始与机器人对话,询问有关 LangChain 的任何问题。

项目优势与特色

- 专注性: 专门针对 LangChain 文档进行优化,提供精准答案

- 实时性: 利用流式处理技术,实现快速响应

- 可扩展性: 支持多用户同时使用,适合大规模部署

- 开源透明: 代码完全开源,方便社区贡献和改进

未来展望

Chat LangChain 项目仍在不断发展中,未来可能会有以下改进:

- 支持更多语言和文档类型

- 增强上下文理解能力

- 引入个性化推荐功能

- 提供更多自定义选项

结语

Chat LangChain 展示了如何利用先进的自然语言处理技术构建专业的问答系统。无论您是 LangChain 的用户、开发者,还是对智能问答系统感兴趣的研究者,都可以从这个项目中获得启发和洞见。我们期待看到更多基于 Chat LangChain 的创新应用,共同推动智能问答技术的发展。

如果您对 Chat LangChain 项目感兴趣,欢迎访问 GitHub 仓库 了解更多详情,或直接体验 在线演示。让我们一起探索 AI 驱动的智能问答的无限可能!