什么是动态规划?

动态规划(Dynamic Programming,简称DP)是计算机科学和数学优化中的一种重要方法。它通过将复杂问题分解成更简单的子问题,并存储子问题的解以避免重复计算,从而提高算法的效率。理查德·贝尔曼(Richard Bellman)在1950年代首次提出了这一概念,此后动态规划在各个领域得到了广泛应用。

动态规划的核心思想是:

- 将原问题分解为若干个子问题

- 求解子问题并存储结果

- 利用子问题的解构建原问题的解

通过这种方式,动态规划避免了重复计算,大大提高了算法效率。

动态规划的工作原理

动态规划的工作原理可以概括为以下几个步骤:

- 定义子问题

- 写出子问题的递推关系

- 以自底向上或自顶向下的方式求解问题

其中,最关键的是找出子问题间的递推关系。一旦建立了正确的递推关系,问题就已经解决了一半。

动态规划通常有两种实现方式:

- 自顶向下的备忘录法(Top-down with Memoization)

- 自底向上的表格法(Bottom-up with Tabulation)

备忘录法从原问题开始,递归地解决子问题,并将子问题的解存储在备忘录中。表格法则从最小的子问题开始,逐步构建更大问题的解,直到解决原问题。

动态规划的应用场景

动态规划适用于具有以下特征的问题:

- 最优子结构:问题的最优解包含子问题的最优解

- 重叠子问题:子问题会重复出现

一些典型的动态规划应用包括:

- 斐波那契数列

- 最长公共子序列

- 背包问题

- 最短路径问题

- 矩阵链乘法

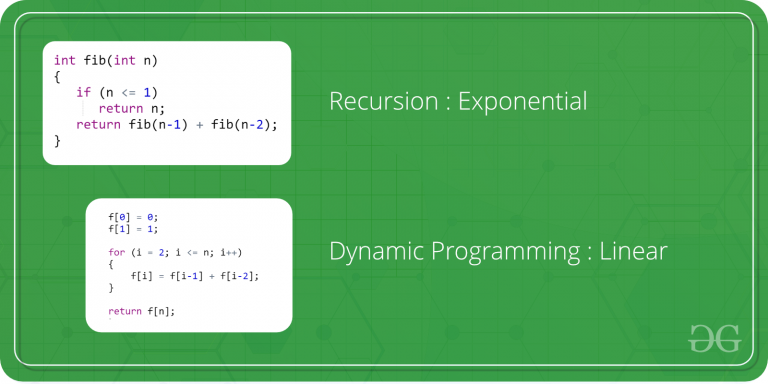

让我们以斐波那契数列为例,来看看动态规划是如何优化算法的。

斐波那契数列的动态规划实现

斐波那契数列是一个经典的动态规划问题。传统的递归实现效率较低:

def fib(n):

if n <= 1:

return n

return fib(n-1) + fib(n-2)

这种方法的时间复杂度是O(2^n),对于大的n值计算非常慢。

使用动态规划,我们可以将时间复杂度降低到O(n):

def fib_dp(n):

if n <= 1:

return n

dp = [0] * (n+1)

dp[1] = 1

for i in range(2, n+1):

dp[i] = dp[i-1] + dp[i-2]

return dp[n]

这个实现使用了自底向上的表格法,避免了重复计算,大大提高了效率。

动态规划与其他算法策略的比较

动态规划与分治法、贪心算法等其他算法策略有一些相似之处,但也有明显区别:

-

分治法:将问题分解为互不重叠的子问题,分别解决后合并。而动态规划处理的子问题往往是重叠的。

-

贪心算法:每一步都做出当前最优选择,但不能保证全局最优。动态规划则通过考虑所有可能的解来找到全局最优解。

-

暴力搜索:尝试所有可能的解,时间复杂度通常很高。动态规划通过存储中间结果避免重复计算,提高效率。

动态规划的优缺点

优点:

- 可以显著提高算法效率,特别是对于具有重叠子问题的问题

- 适用于求解最优化问题

- 为复杂问题提供了一种系统的解决方法

缺点:

- 需要额外的存储空间来保存中间结果

- 有时难以找到正确的状态转移方程

- 不是所有问题都适合用动态规划解决

结语

动态规划是一种强大的算法设计技术,在计算机科学和数学优化中有广泛应用。通过将复杂问题分解为更简单的子问题,并重用这些子问题的解,动态规划可以大大提高算法的效率。虽然掌握动态规划需要一定的练习和直觉,但一旦掌握,它将成为解决复杂问题的有力工具。

对于程序员和算法工程师来说,深入理解动态规划不仅能帮助我们设计更高效的算法,还能培养我们解决问题的思维方式。在实际工作中,我们可能会遇到各种各样的优化问题,而动态规划的思想将帮助我们以更系统、更高效的方式来解决这些问题。

随着人工智能和机器学习的不断发展,动态规划在这些领域也找到了新的应用。例如,在强化学习中,动态规划是许多算法的基础。因此,掌握动态规划不仅对传统的算法设计有帮助,对于想要在AI和ML领域发展的程序员来说也是非常重要的。

总之,动态规划是一个值得每个程序员深入学习和掌握的重要算法技术。通过不断的练习和应用,我们可以培养出解决复杂问题的直觉,提高编程效率,为成为更优秀的程序员打下坚实的基础。