Latent Consistency Models: 图像生成的革命性突破

在人工智能和计算机视觉领域,生成高质量图像一直是一个具有挑战性的任务。近年来,扩散模型(Diffusion Models)在这一领域取得了重大突破,但其计算密集型的迭代采样过程导致生成速度较慢。为了解决这一问题,来自清华大学交叉信息研究院的研究团队提出了一种创新的方法 - Latent Consistency Models (LCMs),旨在实现快速、高质量的图像生成。

LCM的核心思想

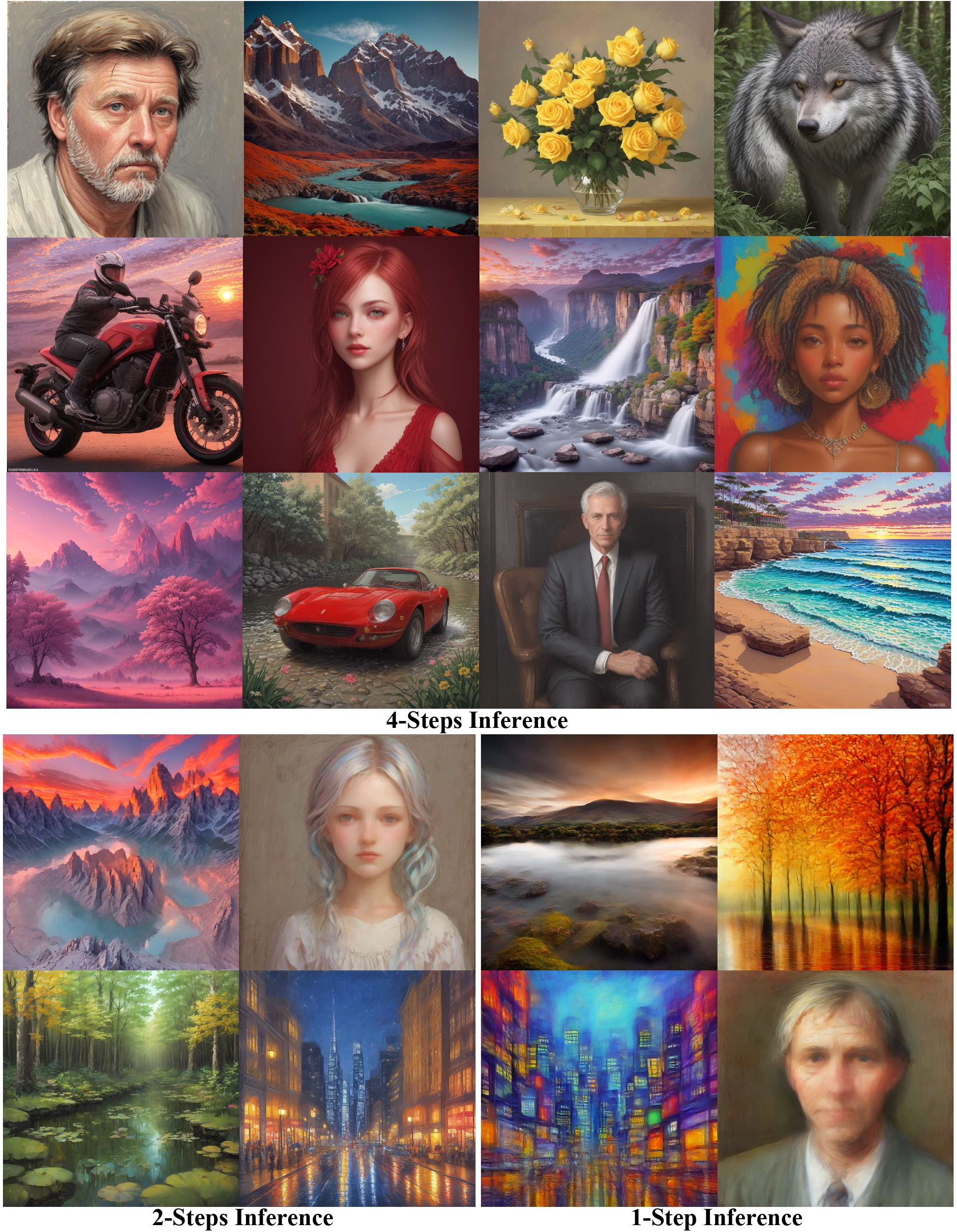

Latent Consistency Models的核心思想是在潜在空间中直接预测概率流常微分方程(PF-ODE)的解,从而绕过了传统扩散模型中繁琐的迭代过程。这种方法允许模型在极少的步骤内(通常为2-4步)生成高质量图像,大大提高了推理速度。

LCM的工作原理可以概括为以下几个步骤:

- 输入编码: 将输入图像编码到较小维度的潜在空间中。

- 直接预测: 在潜在空间中直接预测去噪过程的最终结果,而不是逐步迭代。

- 快速解码: 将预测结果解码回图像空间,得到最终的高分辨率图像。

这种方法的优势在于,它能够在保持图像质量的同时,显著减少生成所需的计算时间和资源。

LCM的突破性成果

LCM在图像生成领域取得了令人瞩目的成果:

-

超快速推理: LCM能够在仅需2-4步的情况下生成高质量的768x768分辨率图像,这比传统的扩散模型快数十倍。

-

高质量输出: 尽管推理步骤大幅减少,LCM生成的图像质量仍然可以与使用数十甚至上百步推理的传统模型相媲美。

-

高效训练: 一个高质量的768x768 LCM模型仅需32个A100 GPU小时(8个节点仅需4小时)即可完成训练,大大降低了模型开发和部署的成本。

-

广泛适用性: LCM可以应用于任何预训练的潜在扩散模型(LDMs),包括广受欢迎的Stable Diffusion,这意味着它可以轻松集成到现有的图像生成管线中。

LCM的技术细节

LCM的成功依赖于几个关键的技术创新:

-

增强概率流ODE: LCM将引导反向扩散过程视为求解增强概率流ODE的问题,这为快速推理提供了理论基础。

-

潜在空间预测: 通过在潜在空间中直接预测ODE的解,LCM避免了在高维图像空间中进行繁重计算的需要。

-

一致性蒸馏: LCM使用一种称为"一致性蒸馏"的技术从预训练的分类器引导扩散模型中提取知识,这使得模型能够在极少的步骤内生成高质量图像。

-

classifier-free guidance: LCM集成了无分类器引导技术,进一步提高了生成图像的质量和多样性。

LCM的应用示例

LCM的快速推理能力为多种应用场景打开了新的可能性:

-

实时图像生成: LCM的速度使得实时图像生成成为可能,这对于交互式应用和实时内容创作至关重要。

-

文本到图像转换: LCM可以快速将文本描述转换为高质量图像,为创意工作者和内容创作者提供强大工具。

-

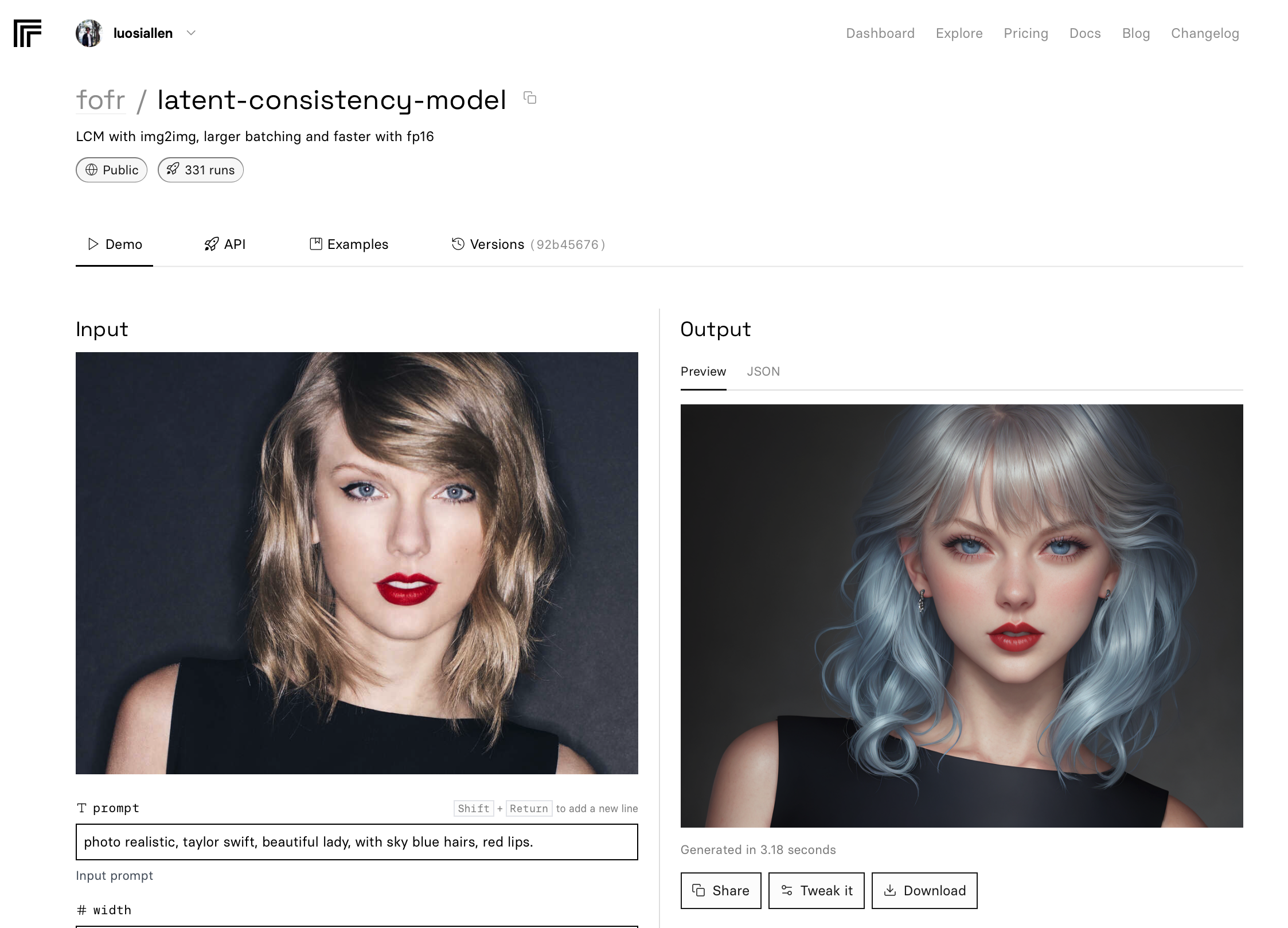

图像到图像转换: LCM支持高效的图像编辑和风格转换,为图像处理领域带来新的可能性。

LCM的未来发展

尽管LCM已经展现出impressive的性能,但研究团队并未止步于此。他们正在探索以下方向:

-

进一步提升速度和质量: 通过优化模型架构和训练策略,有望进一步缩短推理时间并提高图像质量。

-

扩展到其他领域: 将LCM的原理应用到视频生成、3D模型生成等更复杂的任务中。

-

提高模型可解释性: 深入研究LCM的工作原理,提高模型的可解释性和可控性。

-

结合其他先进技术: 探索将LCM与其他前沿AI技术(如大型语言模型)结合,创造出更强大的多模态生成系统。

如何使用LCM

对于希望尝试LCM的研究者和开发者,该团队提供了完整的代码实现和预训练模型。以下是使用LCM的基本步骤:

- 安装必要的库:

pip install --upgrade diffusers

pip install transformers accelerate

- 加载模型并生成图像:

from diffusers import DiffusionPipeline

import torch

pipe = DiffusionPipeline.from_pretrained("SimianLuo/LCM_Dreamshaper_v7")

pipe.to(torch_device="cuda", torch_dtype=torch.float32)

prompt = "Self-portrait oil painting, a beautiful cyborg with golden hair, 8k"

num_inference_steps = 4 # 可设置为1~50步,LCM支持4步及以下的快速推理

images = pipe(prompt=prompt, num_inference_steps=num_inference_steps, guidance_scale=8.0, lcm_origin_steps=50, output_type="pil").images

这段代码展示了如何使用LCM生成一张高质量的768x768图像,整个过程仅需4步推理。

LCM的社区贡献

LCM项目得到了开源社区的广泛支持和贡献。研究团队鼓励开发者参与到项目中来,共同推动技术的发展。以下是一些值得关注的社区贡献:

- 支持在Windows/Linux CPU上运行LCM

- 为LCM开发了Google Colab支持

- 集成LCM到SD-Webui和ComfyUI等流行的图像生成界面中

- 开发了实时LCM demo,展示了模型的快速推理能力

这些贡献大大扩展了LCM的应用范围,使得更多人能够便捷地使用这项技术。

结论

Latent Consistency Models代表了AI图像生成领域的一个重要里程碑。通过创新的理论框架和高效的实现,LCM成功地将高质量图像生成的速度提升到了一个新的水平。这不仅为研究人员提供了一个强大的工具,也为实际应用打开了新的可能性。

随着LCM技术的不断发展和完善,我们有理由相信,它将在未来的AI创意工具、内容生成系统、以及各种需要快速、高质量图像生成的场景中发挥越来越重要的作用。LCM的成功也为AI领域的其他任务提供了宝贵的启示,展示了如何通过创新的方法来突破现有技术的限制。

对于那些对AI图像生成感兴趣的研究者、开发者和创意工作者来说,现在正是深入了解和尝试LCM的最佳时机。随着更多的应用和优化被开发出来,LCM有望成为推动下一代AI创意工具和内容生成系统的核心技术之一。