本地LLM用户指南:从理论到实践的全面解析

随着人工智能技术的快速发展,大型语言模型(LLM)已成为当前最热门的研究领域之一。然而,使用在线LLM服务存在一些问题,如隐私安全、成本高昂等。在这种背景下,本地部署开源LLM成为了一个极具吸引力的选择。本文将全面介绍本地LLM的相关知识,从理论基础到实际应用,为用户提供一份详尽的指南。

1. 背景介绍

1.1 什么是LLM?

大型语言模型(Large Language Model, LLM)是基于人工智能和机器学习技术构建的高级模型,用于理解和生成自然语言文本。这些模型通过分析和学习海量文本数据,掌握了语言的复杂特性,如结构、语法、语义和上下文。LLM的能力包括但不限于文本生成、问答、文本摘要、翻译和情感分析等。

常见的LLM如GPT、LLama、Mistral系列等,通过深度学习的技术架构(如Transformer),使这些模型能够捕捉文本之间更深层的关联和含义。模型首先在广泛的数据集上进行预训练,学习语言的一般特征和模式,然后可以针对特定任务或领域进行微调,以提高其在特定应用中的表现。

预训练阶段为LLM提供了大量的语言和世界知识,而微调阶段则使模型能够在特定任务上取得更高的性能。这种训练方法赋予了LLM处理广泛语言任务的灵活性和适应性,使其能够为用户提供准确而多样的信息和服务。

1.2 LLM与应用程序的区别

在开放性、准确性、可预测性和可用性等方面,LLM与传统应用程序存在显著差异:

-

开放性: LLM通过深度学习预训练和微调,获得了从海量互联网文本中学到的广泛知识,能够理解和生成包括文本、图像、音频、视频和3D材料在内的各种内容类型。这使得LLM在处理多样化信息时展现出优越的能力。相比之下,应用程序通常围绕特定功能设计,信息和服务范围更为有限。

-

准确性: LLM能够生成关于广泛主题和任务的文本,但其准确性取决于训练数据的质量和模型架构。在处理专业或最新信息时,LLM可能产生未经证实的内容。应用程序的信息准确性高度依赖于内容的策划和管理,通常由专业人员或团队提供经过验证的信息。

-

可预测性: LLM的回答可能因训练数据的多样性和模型理解的复杂性而变化,用户可能在没有明确指示的情况下收到多个可能的答案或意外的回应。应用程序通常提供更高度的可预测性,因为它们是为满足特定需求和目的而设计的。

-

可用性: LLM目前面临一些可用性问题,如回答错误问题、响应时间长、处理能力受限和自我更新限制等。应用程序通过长期的软件开发和设计积累,大多已实现高度的用户友好性和稳定性。

1.3 开源LLM的优缺点

开源LLM具有以下优点:

- 灵活性和适应性强

- 减少对特定供应商的依赖

- 保护隐私

- 可定制性高

- 社区支持丰富

- 透明度高

然而,开源LLM也存在一些缺点:

- 底层模型和数据集的限制

- 资源和技术门槛高

- 缺乏统一标准

- 稳定性问题

- 处理速度慢

- 输出质量波动和内容生成可控性差

1.4 在线LLM与本地LLM的区别

在可用性、成本、隐私、依赖性和控制、透明度以及离线使用等方面,在线LLM和本地LLM存在明显差异:

-

可用性: 在线LLM提供即时访问和高可用性,而本地LLM需要用户具备一定的技术知识来安装、配置和优化模型。

-

成本: 对于个人用户,在线LLM服务的按需计费模式灵活性高,入门门槛低。本地LLM则需要一次性投资高性能计算硬件,但长期使用成本较低。

-

隐私: 使用在线LLM时,用户数据需要传输到云服务器进行处理,引发隐私和安全考虑。本地部署的LLM在隐私保护方面提供了更高级别的安全性。

-

依赖性和控制: 在线服务用户依赖服务提供商确保服务的可用性和性能,而本地部署模型允许用户享有更高级别的控制。

-

透明度: 在线LLM服务由第三方提供,可能引发一些用户对模型工作方式和数据处理的透明度担忧。本地部署的LLM提供了更高程度的透明度。

-

离线使用: 在线LLM无法离线使用,而本地LLM可以。

2. 适合使用开源LLM的理论场景

虽然目前开源LLM还存在一些实际问题,但随着技术的发展,这些问题将逐步得到解决。以下是一些理论上适合使用开源LLM的场景:

-

高量高频数据请求场景: 如果您的业务场景需要每天分析和处理大量文档,本地LLM可以帮助您节省大量的API调用成本。

-

多信息处理或多任务场景: 在涉及复杂操作和处理逻辑的多任务和多信息处理领域,本地LLM可以提供更个性化和差异化的服务。

-

涉及个人隐私或敏感数据的场景: 在目标设定、日记写作、财务管理、情感交流等个性化领域,本地开源LLM的应用变得特别重要和必要。

-

需要低防护栏的大模型场景: 在需要高度自由度的应用场景中,如角色扮演、创意写作等,本地部署的LLM可以提供更灵活的内容过滤标准。

3. 开箱即用的本地LLM

感谢Meta、Mistral等开发者提供的开源LLM以及Llama.cpp等开源项目,我们现在可以以非常低的成本使用开源LLM。以下是一些推荐的开箱即用的后端和客户端,帮助您开始本地LLM之旅。

3.1 推荐下载的本地LLM模型

-

Qwen1.5-32B: 阿里云开发的通义千问大模型系列的32B参数规模模型。

- 模型大小: 32B

- 相关语言: 英语、中文

- 上下文长度: 32K

- 适用于: 24GB VRAM以上的NVIDIA显卡电脑,32GB RAM以上的M1/M2/M3 Mac

-

Qwen1.5-14B: 阿里云开发的通义千问大模型系列的14B参数规模模型。

- 模型大小: 14B

- 相关语言: 英语、中文

- 上下文长度: 32K

- 适用于: 12GB VRAM以上的NVIDIA显卡电脑,16GB RAM以上的M1/M2/M3 Mac

-

Qwen1.5-7B: 阿里云开发的通义千问大模型系列的7B参数规模模型。

- 模型大小: 7B

- 相关语言: 英语、中文

- 上下文长度: 32K

- 适用于: 大多数电脑

-

Mixtral-8x7B-Instruct-v0.1: Mistral AI开发的高质量稀疏专家混合模型。

- 模型大小: 8x7B

- 相关语言: 多语言

- 上下文长度: 32K

- 适用于: 24GB VRAM以上的NVIDIA显卡电脑,32GB RAM以上的M1/M2/M3 Mac

-

OpenChat 3.5 0106: OpenChat的2024年1月发布版本,在推理和中英双语问答方面表现更好。

- 模型大小: 7B

- 相关语言: 中文、英语

- 上下文长度: 8K

- 适用于: 大多数电脑

此外还有OpenChat 3.5-16k、llava 1.6、Gemma-7b-it和Gemma-2b-it等模型可供选择。

3.2 如何使用本地LLM

-

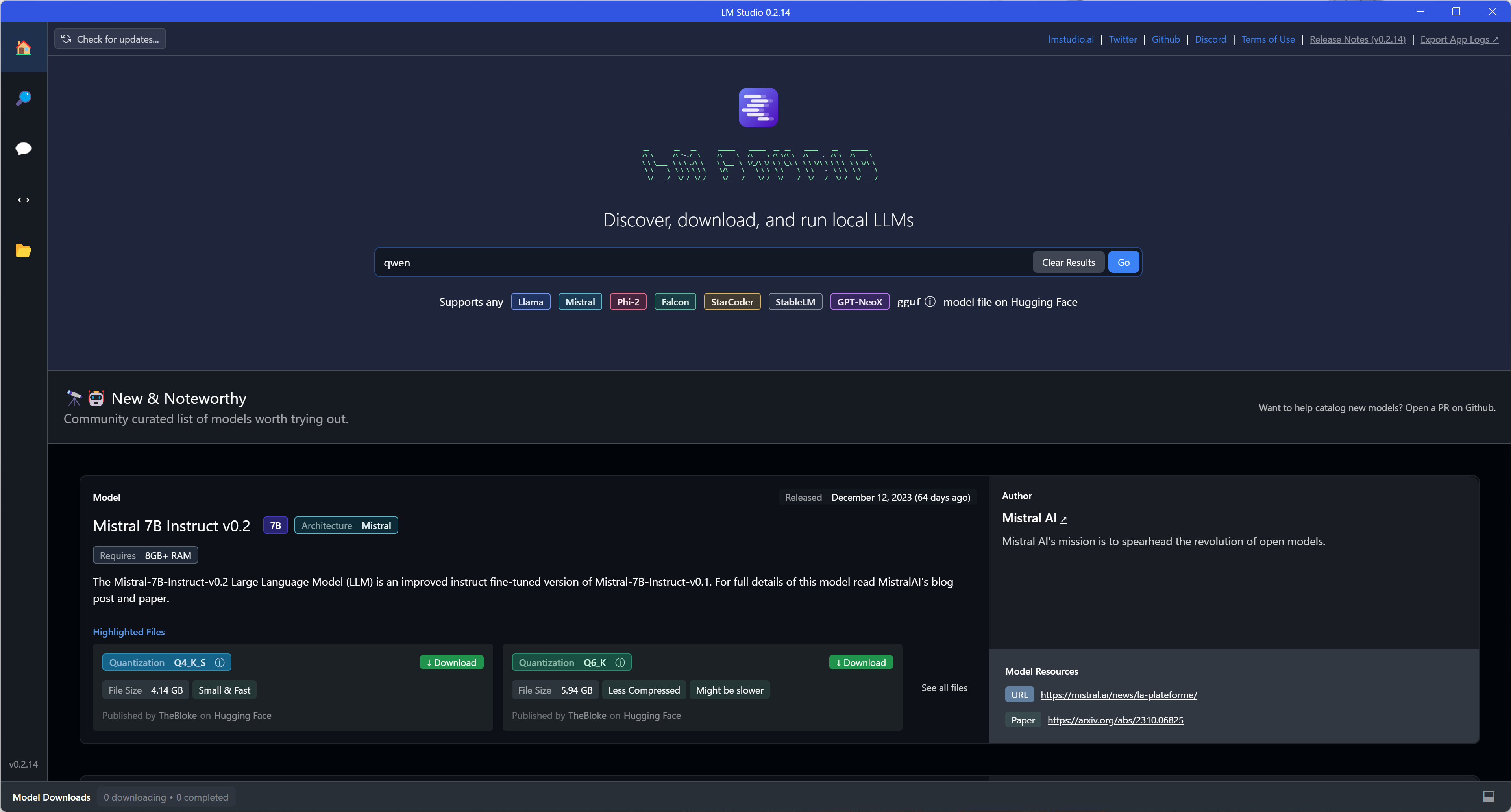

LM Studio: 基于LLama.cpp开发的一套友好的用户界面,支持在Windows、Mac和Linux系统上安装使用。

使用步骤:

- 下载并安装软件

- 在应用中下载模型或手动导入模型

- 选择模型并设置参数

- 开始对话或启动服务器模式

优点:

- 对普通用户友好

- 可轻松切换模型

- 可轻松选择CPU和GPU混合程度

- 可轻松切换预设

- 兼容多模态模型

-

llamafile: 一种将LLM模型打包成单个可执行文件的工具,使用简单,跨平台兼容性强。

使用步骤:

- 下载llamafile可执行文件和模型文件

- 运行llamafile,自动启动本地服务器

- 通过浏览器访问本地服务器进行交互

优点:

- 使用简单,无需复杂配置

- 跨平台兼容性强

- 可将模型和运行环境打包成单个文件

通过这些工具,用户可以轻松地在本地运行LLM模型,实现个性化和安全的AI应用。随着开源LLM技术的不断发展,我们可以期待更多创新应用的出现,为用户提供更丰富、更智能的服务。

4. 结语

本地LLM的应用为我们提供了一种新的AI交互方式,它在保护隐私、降低成本和提高灵活性等方面具有显著优势。尽管目前还存在一些技术挑战,但随着开源社区的不断努力和技术的进步,这些问题将逐步得到解决。我们鼓励更多用户尝试使用本地LLM,探索其潜力,并为这一领域的发展贡献自己的力量。

未来,随着硬件性能的提升和模型优化技术的进步,本地LLM的应用场景将会更加广泛。我们可以期待看到更多创新的应用出现,如个性化的AI助手、本地化的知识管理系统、隐私保护的健康监测等。这些应用将为我们的日常生活和工作带来更多便利和智能化体验。

同时,我们也应该关注本地LLM使用中的伦理和安全问题。虽然本地部署在一定程度上解决了数据隐私问题,但用户仍然需要注意模型输出的准确性和可靠性。此外,如何确保模型不会被滥用,如何处理可能产生的有害内容,都是需要我们共同思考和解决的问题。

总之,本地LLM的发展为AI技术的民主化和个性化应用开辟了新的道路。通过不断学习和实践,我们每个人都可以成为这一技术革命的参与者和受益者。让我们共同期待一个更智能、更安全、更个性化的AI未来!