mlc-MiniCPM:让大语言模型在手机上飞起来 🚀

在人工智能技术蓬勃发展的今天,大语言模型(LLM)已经成为了AI领域的焦点。然而,由于大语言模型通常需要强大的计算资源,将其部署到移动设备上一直是一个挑战。mlc-MiniCPM项目应运而生,它致力于将轻量级但功能强大的大语言模型带到我们的口袋里。

项目背景与目标

mlc-MiniCPM是由OpenBMB团队开发的一个开源项目,它基于MLC-LLM框架,旨在将MiniCPM和MiniCPM-V这两个模型成功部署到Android设备上。这个项目的主要目标是:

- 将先进的AI技术带到移动端,让用户随时随地都能享受到大语言模型的强大功能。

- 探索大语言模型在移动设备上的优化和部署方法,为未来更多AI应用的移动化铺平道路。

- 为开发者和研究者提供一个开放的平台,促进移动AI领域的创新和发展。

MiniCPM与MiniCPM-V简介

在深入了解mlc-MiniCPM项目之前,我们先来简单认识一下MiniCPM和MiniCPM-V这两个模型:

- MiniCPM: 这是一个轻量级的纯文本大语言模型,具有1.2B参数。尽管体积小,但它在各种NLP任务中表现出色。

- MiniCPM-V: 这是MiniCPM的多模态版本,除了处理文本外,还可以理解和分析图像。它有2.0B参数,支持图文混合输入。

这两个模型都由OpenBMB团队开发,是为移动设备优化的大语言模型的代表作。

mlc-MiniCPM的主要特性

- 轻量级设计: 通过模型压缩和量化技术,使大语言模型能够在资源受限的移动设备上运行。

- 多模态支持: 不仅支持文本处理,还可以进行图像理解,为用户提供更丰富的交互体验。

- 离线运行: 模型完全在设备本地运行,无需网络连接,保护用户隐私。

- 开源项目: 代码完全开源,方便开发者学习、使用和贡献。

在Android设备上使用mlc-MiniCPM

现在,让我们一步步了解如何在Android设备上体验mlc-MiniCPM的强大功能:

-

安装APK: 首先,下载并安装最新版本的MiniCPM APK。这个APK包含了MiniCPM 1.2B和MiniCPM-V 2.0两个模型。

-

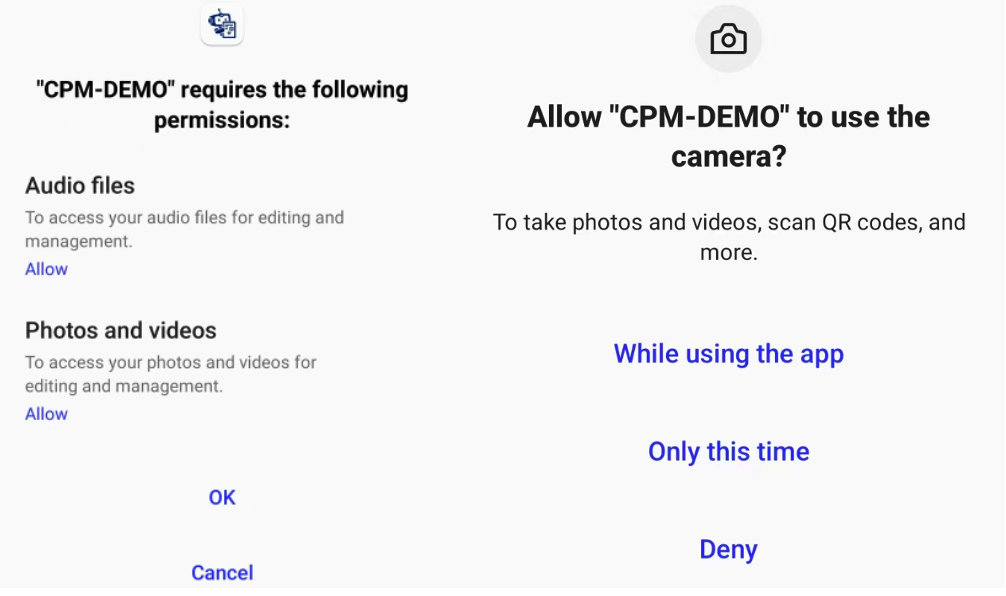

授予权限: 安装后,请允许应用访问相机和照片权限。这些权限是MiniCPM-V处理图像输入所必需的。

-

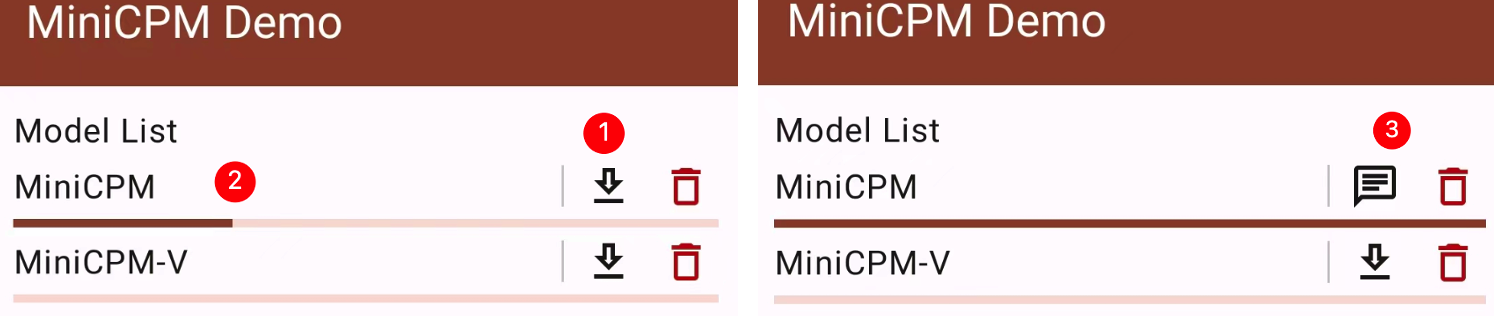

下载模型: 打开应用后,点击下载按钮开始下载模型。等待进度条填满,模型就准备就绪了。

⚠️ 注意: 目前由于下载机制的bug,两个模型无法同时下载,需要分开下载。

-

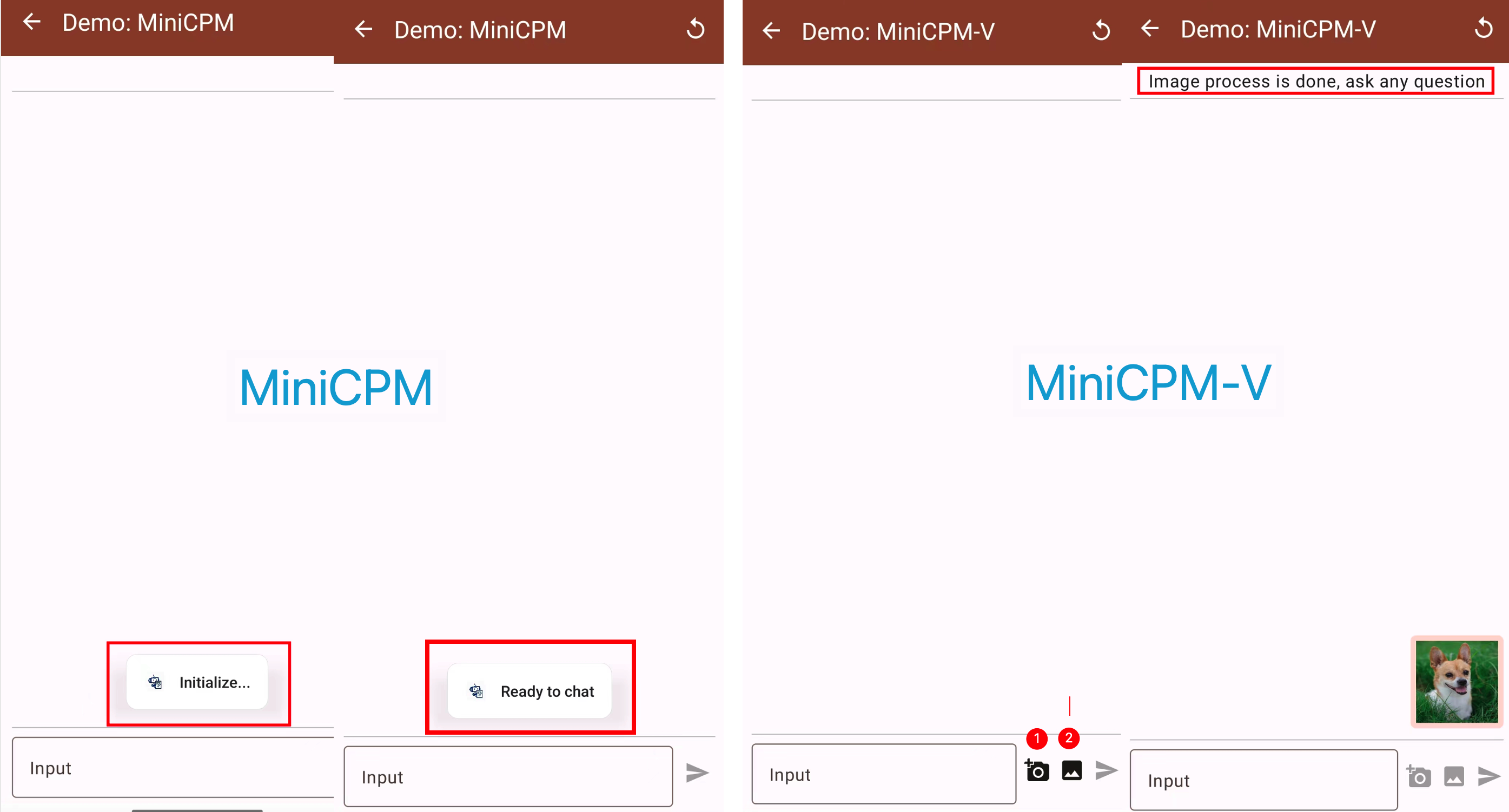

开始对话:

- 对于MiniCPM:等待模型初始化完成,出现"Ready to chat"提示后,即可开始输入问题进行对话。

- 对于MiniCPM-V:除了等待初始化外,还需要上传一张图片。等待"process image done"提示出现后,就可以围绕图片内容提问了。

技术实现与优化

mlc-MiniCPM能够在移动设备上流畅运行,离不开一系列的技术优化:

-

模型量化: 为了减小模型体积并提高推理速度,mlc-MiniCPM对模型进行了4位量化。虽然这可能会导致一定的性能损失,但大大提高了模型在移动设备上的可用性。

-

滑动窗口机制: 在编译模型时,通过设置

--sliding-window-size参数来限制内存使用。这个参数可以根据设备性能进行调整,以在性能和内存占用之间取得平衡。 -

MLC-LLM框架: mlc-MiniCPM基于MLC-LLM框架开发,这个框架专门为移动设备上的大语言模型部署而设计,提供了许多优化策略。

-

自定义编译流程: 项目提供了详细的编译指南,包括如何转换权重、生成配置文件以及编译为Android可用的库文件。这为开发者提供了极大的灵活性。

开发者指南

对于想要深入了解或贡献代码的开发者,mlc-MiniCPM提供了完整的开发环境搭建和模型编译指南:

-

环境准备: 按照MLC-LLM的Android部署文档设置开发环境。

-

安装修改版mlc_chat:

mkdir -p build && cd build python3 ../cmake/gen_cmake_config.py && cd .. cd build && cmake .. && cmake --build . --parallel $(nproc) && cd .. cd python && pip install -e . && cd .. -

编译模型: 项目提供了详细的MiniCPM和MiniCPM-V编译脚本,包括权重转换、配置生成和Android库文件编译等步骤。

-

构建Android应用: 使用Android Studio打开

android/目录,按照MLC-LLM的文档指引构建应用。

未来展望

mlc-MiniCPM项目为大语言模型在移动设备上的应用开辟了新的可能性。随着技术的不断进步,我们可以期待:

- 更强大的模型:在保持轻量级的同时,提升模型的理解和生成能力。

- 更多的多模态支持:除了图像,未来可能会支持语音、视频等更多输入形式。

- 更深度的设备集成:与手机的各种传感器和功能进行更紧密的结合,提供更智能的服务。

- 更广泛的应用场景:从个人助手到专业领域应用,大语言模型将在移动端找到更多应用场景。

结语

mlc-MiniCPM项目展示了将先进AI技术带到普通用户日常生活中的巨大潜力。它不仅是技术创新的典范,更是AI民主化的重要一步。随着这样的项目不断发展,我们离"人人都能拥有自己的AI助手"的未来越来越近了。

无论你是普通用户、开发者还是AI研究者,mlc-MiniCPM都值得你关注和尝试。让我们一起期待更多令人兴奋的移动AI应用吧!

🔗 项目链接: mlc-MiniCPM GitHub仓库