Normal-Depth Diffusion: 开创文本到3D生成的新纪元

在人工智能和计算机图形学的交叉领域,一项名为Normal-Depth Diffusion的创新技术正在引起广泛关注。这项由ModelScope团队开发的技术,为文本到3D内容生成带来了革命性的突破。本文将深入探讨Normal-Depth Diffusion的原理、特点及其潜在应用。

技术原理:扩散模型的创新应用

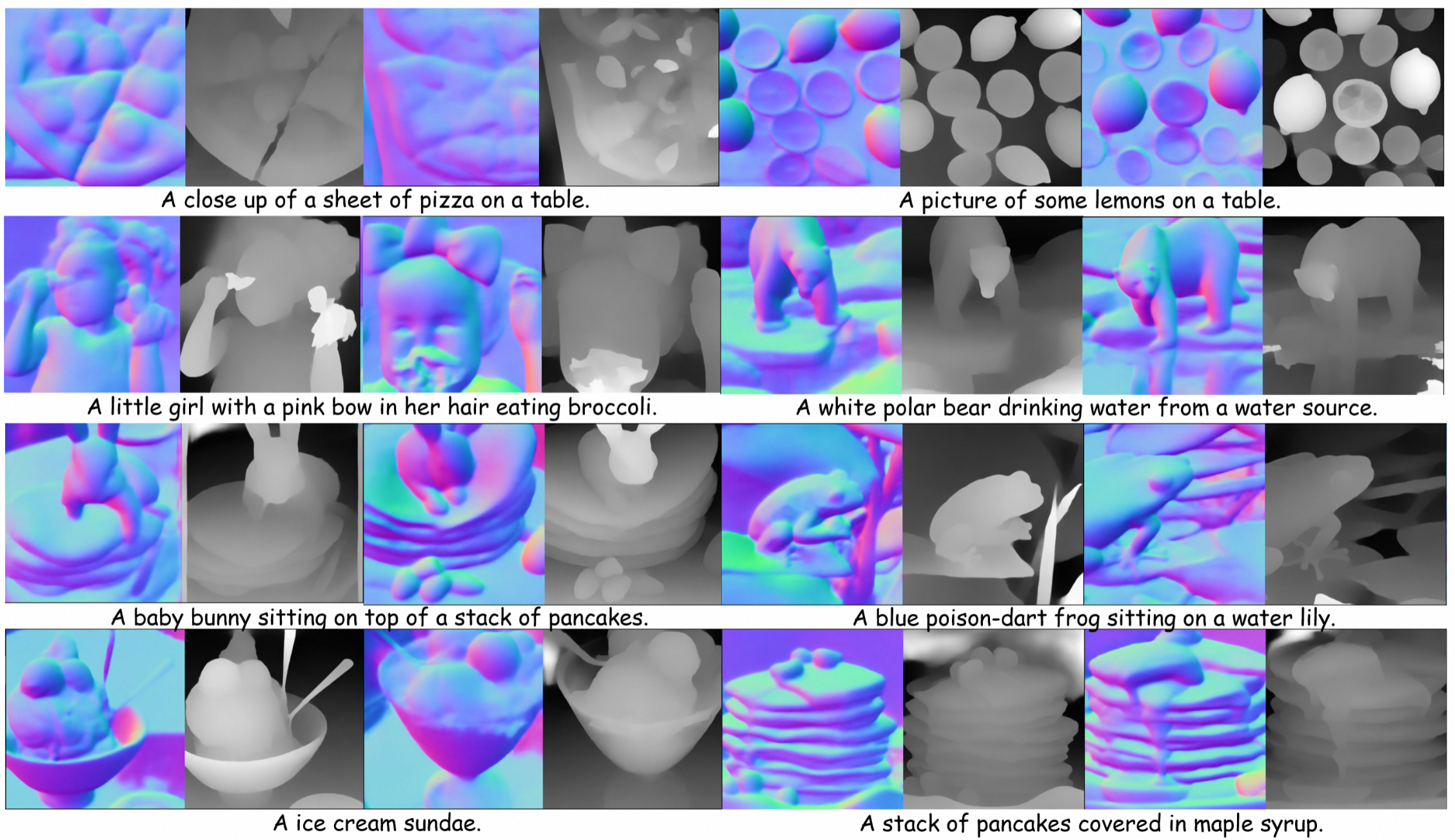

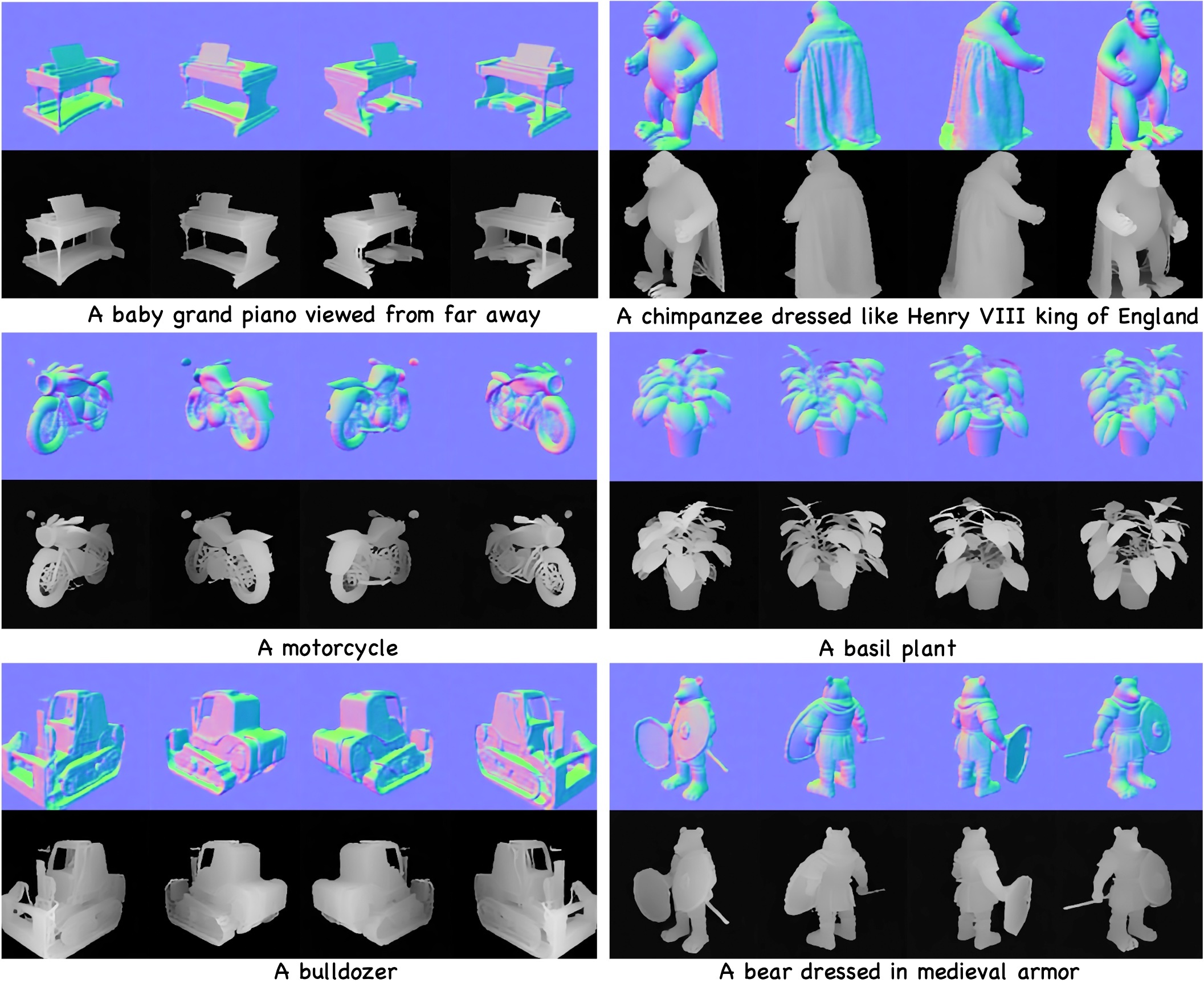

Normal-Depth Diffusion的核心是一种基于扩散模型的生成方法。与传统的3D生成方法不同,它首先生成法向图(Normal Map)和深度图(Depth Map),这两种2D表示形式包含了丰富的3D信息。

-

法向图生成:法向图记录了物体表面每个点的法线方向,能够精确地表现物体的表面细节和纹理。

-

深度图生成:深度图则记录了场景中每个点到相机的距离,提供了物体的空间位置信息。

通过同时生成这两种图,Normal-Depth Diffusion能够捕捉到物体的几何结构和表面细节,为后续的3D重建奠定基础。

多视角生成:增强3D一致性

Normal-Depth Diffusion的一个重要特性是其多视角生成能力。系统能够从不同角度生成一致的法向图和深度图,这极大地提高了生成3D模型的质量和准确性。

-

视角一致性:通过同时生成多个视角的法向图和深度图,系统确保了生成内容在不同角度下的连贯性。

-

细节丰富度:多视角生成使得系统能够捕捉到从单一角度难以观察到的细节,大大提高了生成3D模型的完整性。

训练过程:大规模数据集的力量

Normal-Depth Diffusion的强大性能源于其在大规模数据集上的训练。研究团队使用了如下数据集:

-

Laion-2B数据集:包含超过20亿张图像-文本对,为模型提供了丰富的视觉-语言知识。

-

Objaverse数据集:这是一个大规模的3D物体数据集,为多视角生成提供了关键的训练数据。

通过在这些大规模数据集上进行训练,Normal-Depth Diffusion能够学习到丰富的视觉-语言对应关系和3D几何知识,从而能够准确地将文本描述转化为高质量的法向图和深度图。

技术创新点

-

端到端生成:Normal-Depth Diffusion实现了从文本直接到法向图和深度图的端到端生成,简化了3D内容创作的流程。

-

高质量输出:通过生成高质量的法向图和深度图,该技术为后续的3D重建和渲染提供了优质的输入。

-

多模态融合:模型成功地融合了文本理解和3D几何生成,展现了AI在跨模态任务中的潜力。

-

可控性强:用户可以通过调整文本描述来精确控制生成的3D内容,提供了高度的创作自由度。

潜在应用场景

Normal-Depth Diffusion的出现为多个领域带来了新的可能性:

-

游戏开发:快速生成游戏场景和角色模型,大大提高开发效率。

-

建筑设计:根据文字描述生成建筑外观和内部结构的预览。

-

电影特效:为视觉特效艺术家提供快速创建复杂3D场景的工具。

-

虚拟现实:轻松创建沉浸式VR环境,增强用户体验。

-

产品设计:通过文字描述快速生成产品3D模型,加速设计迭代过程。

未来展望

尽管Normal-Depth Diffusion已经展现出了巨大的潜力,但它仍处于快速发展的阶段。未来的研究方向可能包括:

-

提高生成质量:进一步提高法向图和深度图的精度和细节丰富度。

-

扩展应用范围:探索在更多领域中的应用,如医学成像、地理信息系统等。

-

提升用户交互:开发更直观的用户界面,使非专业用户也能轻松使用。

-

结合其他AI技术:与自然语言处理、计算机视觉等其他AI技术深度融合,创造更智能的创作工具。

Normal-Depth Diffusion的出现无疑为3D内容创作开辟了一条崭新的道路。它不仅简化了创作流程,也大大降低了创作门槛,使得更多人能够参与到3D内容的创作中来。随着技术的不断进步,我们有理由相信,在不久的将来,通过简单的文字描述就能创造出令人惊叹的3D世界将成为现实。

这项技术的发展也为人工智能在创意领域的应用树立了新的里程碑,展示了AI不仅能辅助人类工作,还能成为创意过程中的得力伙伴。Normal-Depth Diffusion的成功,预示着人工智能与人类创造力的深度融合,必将为数字内容创作带来更多令人兴奋的可能性。

对于有兴趣深入了解或尝试使用Normal-Depth Diffusion的读者,可以访问项目的GitHub页面获取更多技术细节和使用指南。让我们共同期待这项技术带来的更多惊喜和创新!