Open X-Embodiment: 通用机器人学习的新篇章

在人工智能领域,语言模型和视觉模型通过在大规模数据集上预训练,已经在多种下游任务中展现出惊人的性能。然而,机器人学习领域长期以来一直受限于特定任务、特定机器人或特定环境的学习方法。为了打破这一局限,来自全球21个顶尖研究机构的科学家们联手打造了Open X-Embodiment项目,旨在为机器人学习领域带来类似于语言和视觉模型的突破。

项目概述

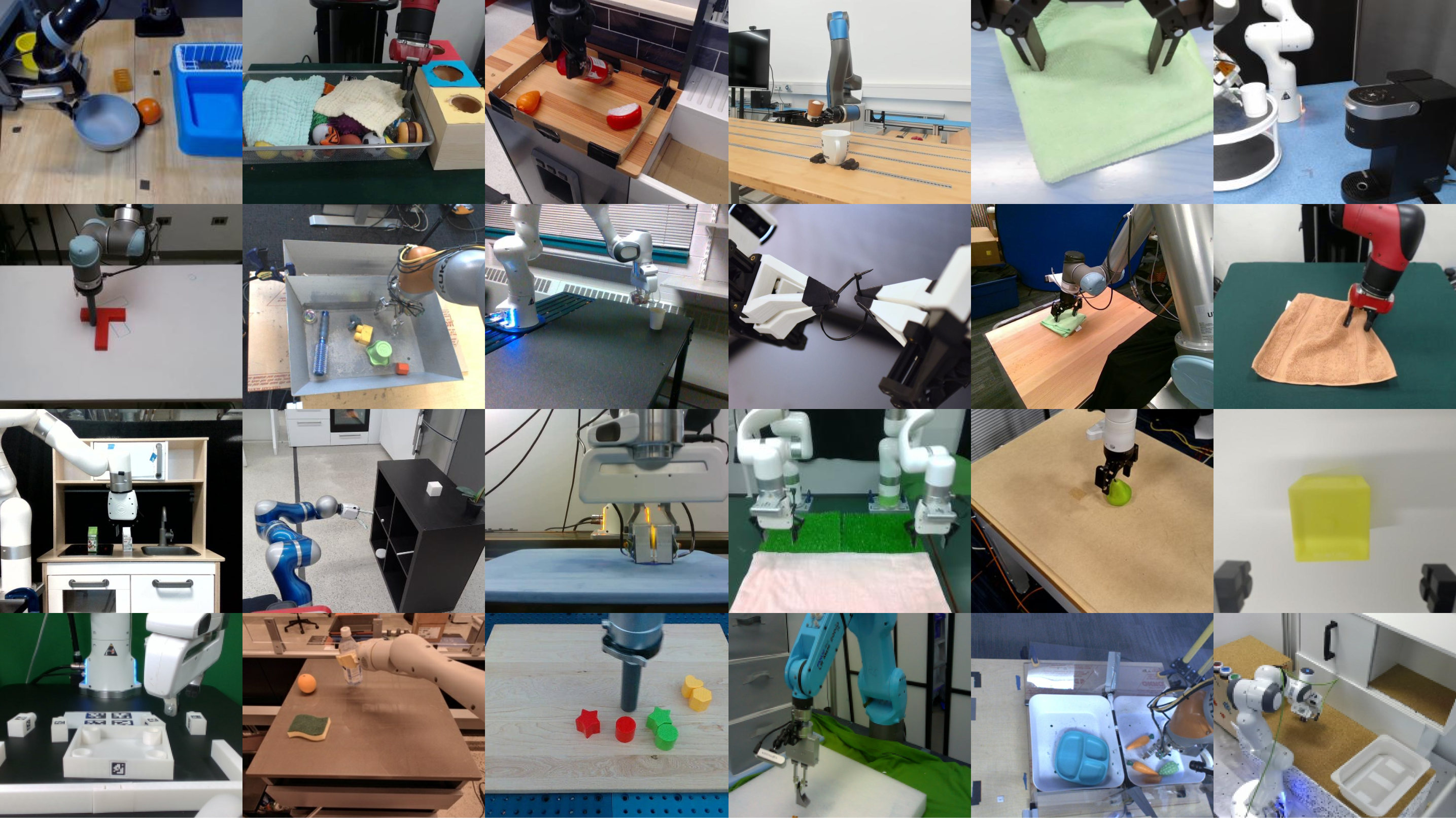

Open X-Embodiment项目整合了来自21个机构的22个不同机器人的数据,创建了一个包含527种技能和160,266个任务的大规模数据集。这个数据集涵盖了广泛的机器人操作场景,为训练通用机器人模型提供了丰富的基础。

项目的主要目标包括:

- 验证使用多机器人、多环境的综合数据集训练的模型,是否能够优于仅在单一数据集上训练的模型。

- 构建一个可用于未来大规模机器人训练的基准数据集。

RT-X模型: 跨机器人学习的新范式

基于Open X-Embodiment数据集,研究人员开发了RT-X (Robotics Transformer X)模型。RT-X采用Transformer架构,能够将在一个机器人上学到的知识迁移到其他机器人上。本研究重点关注了两个版本的RT-X模型:

- RT-1-X: 在RT-1 (Robotics Transformer 1)基础上,使用Open X-Embodiment数据集进行进一步训练。

- RT-2-X: 在RT-2 (Robotics Transformer 2)基础上,同样使用Open X-Embodiment数据集进行训练。RT-2是一个视觉-语言-动作(VLA)模型,通过同时使用网络数据和机器人数据进行微调。

实验结果: 通用性与泛化能力的飞跃

研究团队在6种不同的机器人上进行了3600次评估测试,以观察各模型的性能差异。实验结果令人振奋:

小规模数据集上的性能

在小规模数据集上,RT-1-X在5个数据集中的4个上都优于仅在各自数据集上训练的方法。更值得注意的是,RT-1-X的平均成功率比RT-1和其他模型高出50%。这一结果表明,即使对于小规模数据集,使用Open X-Embodiment数据进行联合训练也能带来显著的性能提升。

大规模数据集上的性能

在大规模数据集上,虽然RT-1-X在准确性上没有超过RT-1,但规模更大的RT-2-X模型却表现出色,不仅超越了在各自数据集上训练的模型,还超过了RT-1。这一结果表明,当有足够的数据用于训练时,更大的模型架构能够带来性能的提升。

对未见任务的响应能力

研究还评估了使用Open X-Embodiment数据集训练的模型如何应对数据集中未出现的设置和更复杂的指令。结果显示:

- RT-2-X在处理从未学习过的任务时,表现比RT-2提高了约3倍。

- RT-2-X能够识别指令中细微的介词差异,如"on"和"near"的区别,而RT-2无法做到这一点。

这些发现表明,通过整合来自多个机器人的数据进行训练,RT-2-X获得了处理更广泛任务的能力。

技术细节: RT-X模型的工作原理

RT-X模型的输入包括:

- 机器人工作空间相机捕捉的RGB图像

- 描述机器人需要执行任务的文本指令

模型通过任务字符串来理解需要执行的任务,通过图像来了解当前世界状态。模型以3Hz的频率运行,每333毫秒接收一次最新的RGB图像,并输出下一步动作。

RT-X模型的动作空间包括7个变量,用于控制机器人夹持器的移动:

- x, y, z: 位置坐标

- roll, pitch, yaw: 旋转角度

- 夹持器开合程度

每个变量可以表示绝对值、相对变化量或变化速度。

开源与合作: 推动机器人学习的开放生态

Open X-Embodiment项目不仅公开了数据集,还开源了模型checkpoints和推理代码,以促进整个研究社区的发展。研究者可以通过以下方式获取资源:

-

数据集访问:通过自包含的Colab notebook可以可视化每个数据集的部分样本,并创建用于训练和推理的数据批次。

-

RT-1-X模型checkpoint:提供了推理Colab,演示如何加载模型checkpoint,在离线样本上运行推理,并将预测动作与真实动作进行对比。

-

RT-1-X JAX checkpoint:可通过以下命令下载:

gsutil -m cp -r gs://gdm-robotics-open-x-embodiment/open_x_embodiment_and_rt_x_oss/rt_1_x_jax .

未来展望: 通用机器人智能的曙光

Open X-Embodiment项目及其RT-X模型展示了机器人学习领域向通用智能迈进的巨大潜力。通过整合来自多个机构、多种机器人的数据,研究人员成功训练出了具有强大泛化能力的模型,能够适应不同的机器人平台和任务场景。

然而,这仅仅是开始。未来的研究方向可能包括:

- 进一步扩大数据集规模和多样性,包括更多类型的机器人和任务。

- 改进模型架构,以更好地处理不同传感器和执行器配置的机器人。

- 探索将语言模型和机器人控制更紧密结合的方法,实现更自然的人机交互。

- 研究如何将模型从模拟环境更好地迁移到实际物理环境中。

Open X-Embodiment项目为机器人学习领域开辟了一条通往通用智能的新道路。随着更多研究者加入这一开放生态系统,我们有理由期待在不久的将来,能够看到真正的通用机器人智能的诞生。这不仅将彻底改变制造业、医疗保健、家庭服务等领域,还可能为我们理解和创造人工通用智能提供宝贵的见解。

🤖💡 Open X-Embodiment项目的成功,标志着机器人学习领域正在经历一场范式转变。从特定任务的学习,到跨任务、跨平台的通用学习,这一进展无疑将加速机器人技术的发展和应用。让我们共同期待,在不久的将来,能够看到更多智能、灵活且易于使用的机器人,为人类社会带来更多便利和可能性。