OpenLIT:重塑AI可观测性的未来

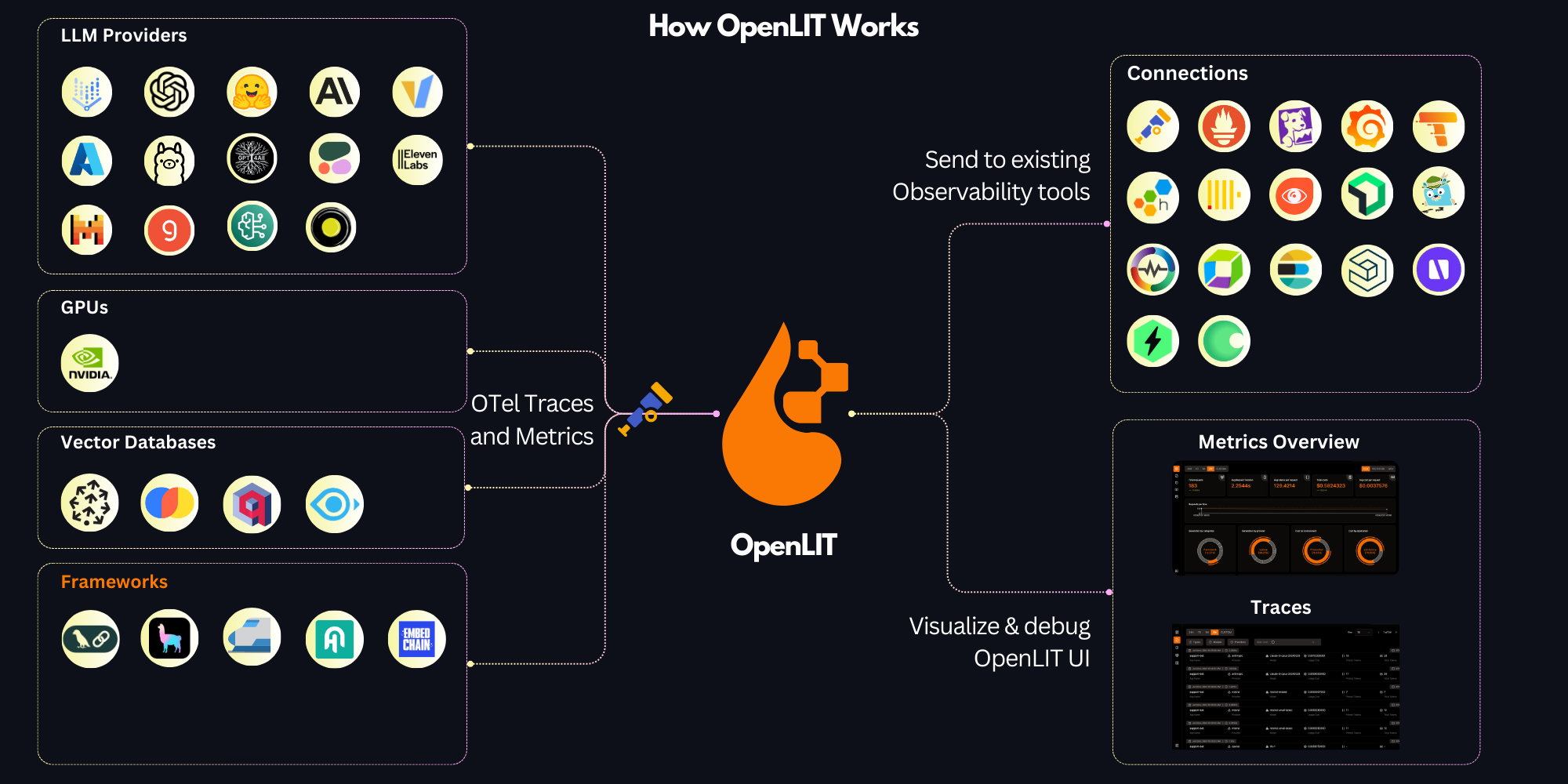

在人工智能和机器学习快速发展的今天,开发者们正面临着一个巨大的挑战:如何有效地监控和优化他们的LLM(大型语言模型)应用。为了应对这一挑战,OpenLIT应运而生,它是一款革命性的开源工具,旨在为整个生成式AI技术栈提供全面的可观测性和评估能力。

OpenLIT简介

OpenLIT是一个OpenTelemetry原生的工具,专为帮助开发者洞察其LLM应用在生产环境中的性能而设计。它的名字"LIT"代表学习和推理工具(Learning and Inference Tool),这一概念最初由谷歌引入,用于理解AI模型和可视化数据。

OpenLIT的核心优势在于它能自动收集LLM输入和输出的元数据,并为自托管的LLM监控GPU性能。更令人兴奋的是,OpenLIT使得将可观测性集成到GenAI项目中变得异常简单,只需一行代码即可实现。无论你是使用流行的LLM提供商如OpenAI和HuggingFace,还是利用向量数据库如ChromaDB,OpenLIT都能确保你的应用得到无缝监控,提供关键洞察,包括自托管LLM的GPU性能统计,以提高性能和可靠性。

OpenLIT的核心特性

-

先进的LLM和VectorDB性能监控: OpenLIT提供自动化的仪表功能,生成追踪和指标,深入洞察LLM和VectorDB使用的性能和成本。这使得开发者能够分析应用在不同环境(如生产环境)中的表现,从而优化资源使用并高效扩展。

-

自定义和微调模型的成本追踪: OpenLIT允许开发者通过使用自定义JSON文件来定制特定模型的成本追踪。这一功能使得精确预算成为可能,确保成本估算完美符合项目需求。

-

OpenTelemetry原生和厂商中立的SDK: OpenLIT构建时就原生支持OpenTelemetry,使其能与项目无缝融合。这种厂商中立的方法降低了集成障碍,使OpenLIT成为软件栈中直观的一部分,而非额外的复杂性。

快速上手OpenLIT

OpenLIT的安装和使用过程简单直接,以下是快速入门的步骤:

-

部署OpenLIT堆栈: 首先,克隆OpenLIT仓库并启动Docker Compose。

-

安装OpenLIT SDK: 在命令行或终端中运行安装命令。

-

在应用中初始化OpenLIT: 只需添加两行代码即可开始监控你的LLM应用:

import openlit openlit.init() -

可视化和优化: 一旦LLM可观测性数据被收集并发送到OpenLIT,你就可以通过OpenLIT UI(地址:

127.0.0.1:3000)开始探索。使用默认凭据登录后,你可以深入分析LLM应用的性能、行为,并识别需要改进的领域。

社区贡献与支持

OpenLIT欢迎各种形式的贡献,无论大小。如果你对参与项目感兴趣,可以查看贡献指南开始。此外,OpenLIT社区提供多种方式让你参与进来:

- 加入Slack或Discord社区,讨论想法,分享反馈。

- 在GitHub Issues上报告bug,帮助改进OpenLIT。

- 关注X(原Twitter)获取最新更新和新闻。

结语

OpenLIT正在重塑AI可观测性的未来。它不仅仅是一个工具,更是一个充满活力的社区驱动的创新平台。通过提供全面的LLM和GPU性能监控,精确的成本追踪,以及与OpenTelemetry的无缝集成,OpenLIT为开发者提供了前所未有的洞察力,使他们能够构建更高效、更可靠的AI应用。

无论你是刚开始探索LLM应用开发,还是正在寻求优化现有系统,OpenLIT都为你提供了必要的工具和见解。加入OpenLIT社区,分享你的想法,提出新功能建议,探索贡献的机会。让我们一起在GitHub上参与OpenLIT的社区驱动创新,共同塑造AI可观测性的未来!