UniMatch: 革新半监督语义分割的弱到强一致性方法

在计算机视觉领域,语义分割一直是一个具有挑战性的任务。近年来,半监督学习方法在这一领域展现出了巨大的潜力,其中UniMatch作为一种新颖的方法脱颖而出。本文将深入探讨UniMatch的核心思想、创新点以及其在多个场景中的应用成果。

UniMatch的核心思想

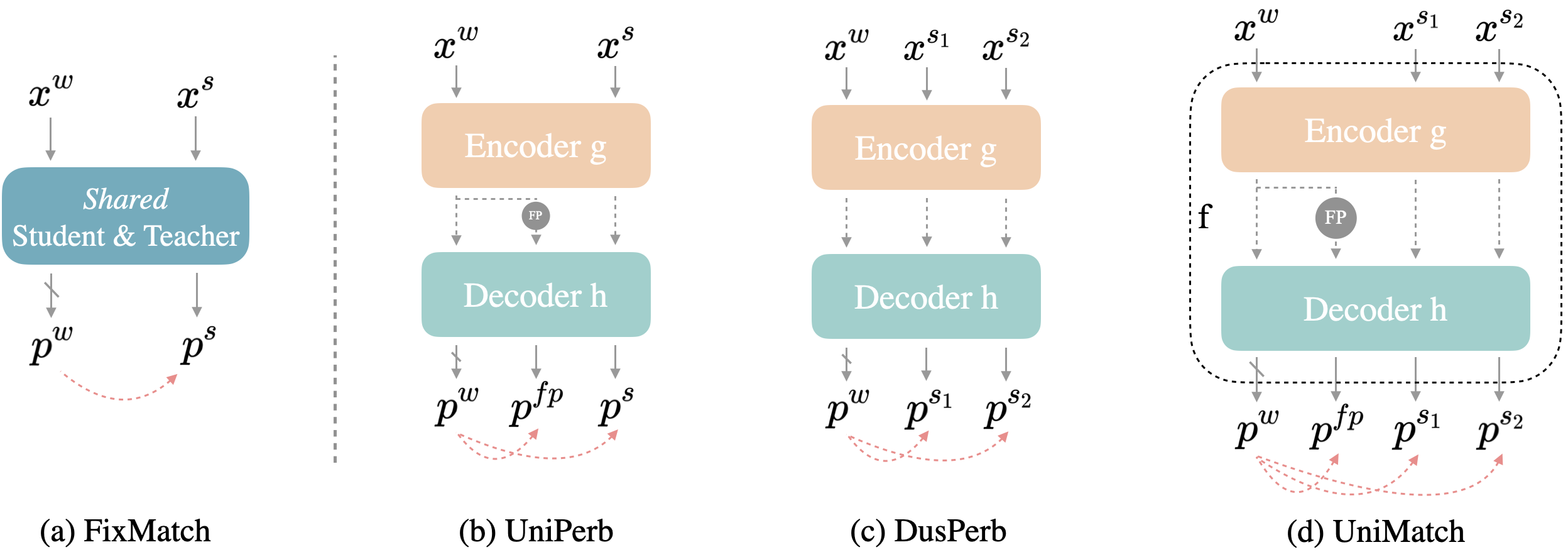

UniMatch的核心在于重新审视了半监督语义分割中的弱到强一致性原则。传统的方法通常依赖于使用弱增强和强增强的图像对来训练模型,而UniMatch则提出了一种更为有效的策略。

如上图所示,UniMatch的框架包含了几个关键组成部分:

- 特征提取器:用于从输入图像中提取高级语义特征。

- 参数无关的匹配层:实现了跨任务的统一模型架构。

- 自注意力层:用于将高质量的预测传播到未匹配的区域。

这种设计使得UniMatch能够在流、立体视觉和深度估计等多个任务中共享相同的模型架构和参数,从而实现了跨任务的知识迁移。

UniMatch的创新点

- 统一的密集对应匹配公式

UniMatch提出了一种统一的密集对应匹配公式,这使得模型能够同时处理光流、立体视觉和深度估计三个任务。这种统一的方法不仅简化了模型设计,还促进了不同任务之间的知识共享。

- 跨任务迁移

得益于统一的模型架构,UniMatch自然而然地实现了跨任务迁移。例如,在光流任务上预训练的模型可以直接用于立体视觉或深度估计任务,只需少量的微调即可达到优秀的性能。

- 高效的参数无关匹配层

UniMatch采用了参数无关的匹配层,这不仅提高了模型的效率,还增强了其泛化能力。这种设计使得模型能够更好地适应不同的数据分布和任务要求。

- 自注意力机制的应用

通过引入自注意力层,UniMatch能够有效地将高质量的预测结果传播到难以匹配的区域,从而提高整体的分割精度。

UniMatch在多个基准数据集上的表现

UniMatch在多个权威的语义分割基准数据集上进行了广泛的实验,并取得了令人瞩目的成绩。

Pascal VOC 2012数据集

在Pascal VOC 2012数据集上,UniMatch展现出了卓越的性能:

| 标注图像比例 | 1/16 (92) | 1/8 (183) | 1/4 (366) | 1/2 (732) | Full (1464) |

|---|---|---|---|---|---|

| UniMatch | 75.2 | 77.2 | 78.8 | 79.9 | 81.2 |

这些结果显著优于之前的最佳方法,如U2PL、ST++和PS-MT等。

Cityscapes数据集

在Cityscapes数据集上,UniMatch同样展现出了强大的性能:

| ResNet-50 | 1/16 | 1/8 | 1/4 | 1/2 |

|---|---|---|---|---|

| UniMatch | 75.0 | 76.8 | 77.5 | 78.6 |

| ResNet-101 | 1/16 | 1/8 | 1/4 | 1/2 |

|---|---|---|---|---|

| UniMatch | 76.6 | 77.9 | 79.2 | 79.5 |

这些结果不仅超越了监督基线,还大幅领先于其他半监督方法。

COCO数据集

在更具挑战性的COCO数据集上,UniMatch同样表现出色:

| 标注图像数量 | 1/512 (232) | 1/256 (463) | 1/128 (925) | 1/64 (1849) | 1/32 (3697) |

|---|---|---|---|---|---|

| UniMatch | 31.9 | 38.9 | 44.4 | 48.2 | 49.8 |

这些结果再次证明了UniMatch在处理复杂场景和大规模数据集时的优越性。

UniMatch在其他场景中的应用

除了自然图像分割,UniMatch还成功应用于其他重要的计算机视觉任务:

- 遥感变化检测

在遥感领域,UniMatch被应用于变化检测任务,并取得了显著的性能提升。这表明UniMatch的方法在处理高分辨率卫星图像和复杂地理信息时同样有效。

- 医学图像分割

在医学图像分割这一关键的医疗AI应用中,UniMatch也展现出了强大的潜力。它能够有效地处理各种医学影像数据,如CT、MRI等,为精准医疗提供了有力的技术支持。

UniMatch的实现与使用

UniMatch的作者们慷慨地开源了完整的代码实现,这为研究人员和开发者提供了宝贵的资源。以下是使用UniMatch的基本步骤:

- 环境配置

首先,需要配置适当的Python环境:

conda create -n unimatch python=3.10.4

conda activate unimatch

pip install -r requirements.txt

pip install torch==1.12.1+cu113 torchvision==0.13.1+cu113 -f https://download.pytorch.org/whl/torch_stable.html

- 预训练模型

UniMatch提供了多个预训练的骨干网络,包括ResNet-50、ResNet-101和Xception-65。这些预训练模型可以直接用于初始化UniMatch模型。

- 数据准备

UniMatch支持多个常用的语义分割数据集,如Pascal VOC、Cityscapes和COCO。作者们还提供了预处理好的标注数据,方便用户直接使用。

- 模型训练

通过运行提供的训练脚本,可以轻松开始UniMatch的训练过程:

sh scripts/train.sh <num_gpu> <port>

- 结果评估

训练完成后,可以使用评估脚本来测试模型的性能:

sh scripts/evaluate.sh

UniMatch的未来展望

尽管UniMatch已经在多个任务和数据集上取得了显著的成果,但其潜力远未被完全挖掘。以下是一些可能的未来研究方向:

- 跨域适应:探索UniMatch在更多不同领域之间的迁移学习能力。

- 模型压缩:研究如何在保持高性能的同时,减小模型大小,使其更适合部署在资源受限的设备上。

- 实时性能优化:进一步提高UniMatch的推理速度,使其能够应用于实时系统。

- 与其他先进技术的结合:探索将UniMatch与其他前沿技术(如自监督学习、元学习等)结合的可能性。

结论

UniMatch作为一种创新的半监督语义分割方法,通过重新思考弱到强一致性原则,成功地在多个基准数据集上取得了最先进的性能。其统一的模型架构不仅简化了设计,还实现了有效的跨任务知识迁移。UniMatch在自然图像、遥感和医学图像等多个领域的成功应用,进一步证明了其方法的普适性和潜力。

随着计算机视觉技术的不断发展,我们有理由相信,像UniMatch这样的创新方法将继续推动半监督学习和语义分割领域的进步,为更多实际应用场景带来突破性的解决方案。研究人员和开发者可以基于UniMatch的开源实现,进一步探索和改进这一强大的方法,为计算机视觉的未来贡献力量。

UniMatch不仅在学术界引起了广泛关注,其在实际应用中的潜力也正在被逐步挖掘。随着更多研究者和开发者加入到这一领域,我们期待看到UniMatch在更多领域中的创新应用,以及由此带来的技术突破和社会价值。让我们共同期待UniMatch和半监督语义分割技术的美好未来!🚀🌟