CharacterBERT简介

CharacterBERT是一种新型的BERT变体模型,由Hicham El Boukkouri等人在2020年COLING会议上提出。该模型旨在解决传统BERT模型在处理专业领域文本和未知词时存在的局限性,通过直接处理输入token的字符来生成词级别的上下文表示。

模型架构

CharacterBERT的核心创新在于其字符级处理机制。不同于标准BERT使用预定义的wordpiece词表,CharacterBERT采用了一个类似ELMo的CharacterCNN模块来处理输入token的字符序列。这种方法使得模型能够为任意输入token生成表示,而不受预定义词表的限制。

如上图所示,对于"Apple"这样的未知token,BERT会将其拆分为"Ap"和"##ple"两个wordpiece并分别编码,而CharacterBERT则直接处理整个token的字符序列,生成一个统一的token嵌入。

主要优势

CharacterBERT相比传统BERT模型具有以下几个显著优势:

-

领域适应性强: 无需为不同专业领域重新训练wordpiece词表,可以直接应用于新领域。

-

处理未知词能力强: 能够为任意未知词生成合理的表示,不受预定义词表限制。

-

词级表示: 直接生成词级别的表示,避免了subword处理带来的复杂性。

-

鲁棒性: 对拼写错误和变体更加鲁棒,能够处理各种形式的输入。

-

灵活性: 可以根据需要多次重新适应不同领域,无需担心wordpiece词表的适用性。

模型应用

CharacterBERT可以应用于各种自然语言处理任务,特别适合处理专业领域文本和包含大量未知词的场景。以下是一些典型应用:

1. 词嵌入生成

CharacterBERT可以直接生成词级别的嵌入表示,无需处理subword。这在处理专业术语或罕见词时特别有优势。

from transformers import BertTokenizer

from modeling.character_bert import CharacterBertModel

from utils.character_cnn import CharacterIndexer

# 加载预训练的CharacterBERT模型

model = CharacterBertModel.from_pretrained('./pretrained-models/medical_character_bert/')

# 处理输入文本

text = "CharacterBERT handles rare medical terms efficiently"

tokenizer = BertTokenizer.from_pretrained('bert-base-uncased')

tokens = tokenizer.basic_tokenizer.tokenize(text)

# 生成字符索引

indexer = CharacterIndexer()

input_tensor = indexer.as_padded_tensor([tokens])

# 获取词嵌入

embeddings, _ = model(input_tensor)

2. 文本分类

CharacterBERT可以很容易地应用于文本分类任务,特别是在处理包含大量专业术语或未知词的文本时表现出色。

from transformers import BertForSequenceClassification, BertConfig

from modeling.character_bert import CharacterBertModel

# 初始化分类模型

config = BertConfig.from_pretrained('bert-base-uncased', num_labels=2)

model = BertForSequenceClassification(config=config)

# 替换BERT层为CharacterBERT

character_bert_model = CharacterBertModel.from_pretrained('./pretrained-models/medical_character_bert/')

model.bert = character_bert_model

# 准备输入文本并进行推理

# ... (省略文本处理步骤)

output = model(input_tensor, return_dict=False)[0]

3. 命名实体识别

在处理专业领域的命名实体识别任务时,CharacterBERT的字符级处理能力可以帮助更好地识别未知实体和变体形式。

4. 文本相似度计算

CharacterBERT生成的词级表示可以直接用于计算文本相似度,特别适合处理包含拼写变体或专业术语的文本比较任务。

模型训练与使用

环境配置

使用CharacterBERT需要配置适当的Python环境。推荐使用conda创建虚拟环境:

conda create python=3.10 --name=character-bert

conda activate character-bert

conda install pytorch cudatoolkit=11.8 -c pytorch

pip install transformers==4.34.0 scikit-learn==1.3.1 gdown==4.7.1

预训练模型

CharacterBERT提供了多个预训练模型,包括通用领域和医学领域的版本:

- general_character_bert: 在英语维基百科和OpenWebText上从头预训练的通用领域CharacterBERT。

- medical_character_bert: 在general_character_bert基础上,使用MIMIC-III临床笔记和PMC OA生物医学论文摘要进一步预训练的医学领域CharacterBERT。

可以使用以下命令下载预训练模型:

python download.py --model='medical_character_bert'

GPU加速

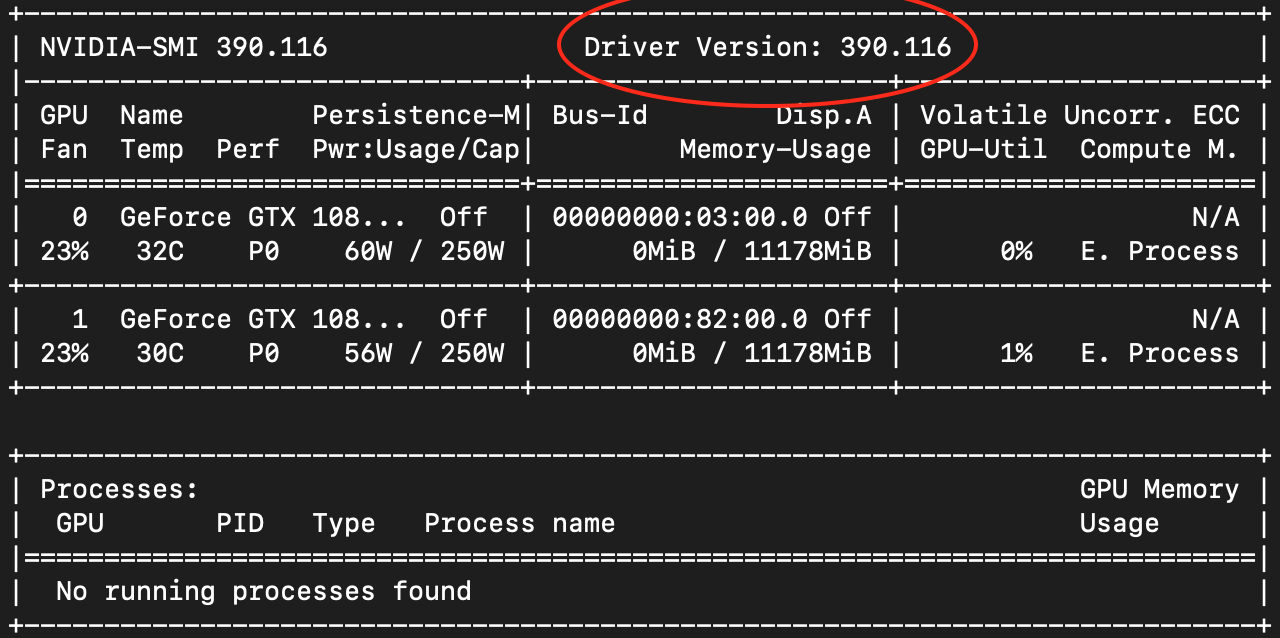

为了充分利用GPU加速训练和推理,需要确保PyTorch版本与CUDA版本匹配。可以通过以下步骤检查:

-

设置CUDA可见设备:

export CUDA_VISIBLE_DEVICES=0 -

检查PyTorch是否检测到GPU:

import torch print(torch.cuda.is_available()) -

如果返回False,可能需要重新安装匹配的PyTorch版本:

conda install pytorch cudatoolkit=9.0 -c pytorch

结论

CharacterBERT作为一种创新的BERT变体,通过字符级处理机制成功解决了传统BERT模型在处理专业领域文本和未知词时的局限性。它不仅提高了模型的领域适应性和鲁棒性,还简化了词级表示的生成过程。这种方法在各种自然语言处理任务中都展现出了优秀的性能,特别是在处理包含大量专业术语、罕见词或拼写变体的文本时。

随着自然语言处理技术的不断发展,CharacterBERT为处理多样化和专业化文本提供了一种有效的解决方案。它的出现不仅推动了模型在各个专业领域的应用,也为未来更加灵活和通用的语言模型设计提供了新的思路。研究人员和开发者可以基于CharacterBERT的开源实现,进一步探索和优化字符级语言模型在各种复杂场景下的应用潜力。

🔬 如果您在研究中使用了CharacterBERT,请引用以下论文:

@inproceedings{el-boukkouri-etal-2020-characterbert,

title = "{C}haracter{BERT}: Reconciling {ELM}o and {BERT} for Word-Level Open-Vocabulary Representations From Characters",

author = "El Boukkouri, Hicham and

Ferret, Olivier and

Lavergne, Thomas and

Noji, Hiroshi and

Zweigenbaum, Pierre and

Tsujii, Jun{'}ichi",

booktitle = "Proceedings of the 28th International Conference on Computational Linguistics",

year = "2020",

pages = "6903--6915",

}

随着自然语言处理技术的不断进步,我们期待看到CharacterBERT及其衍生模型在更多领域发挥重要作用,为解决复杂的语言理解问题提供新的可能性。