项目简介

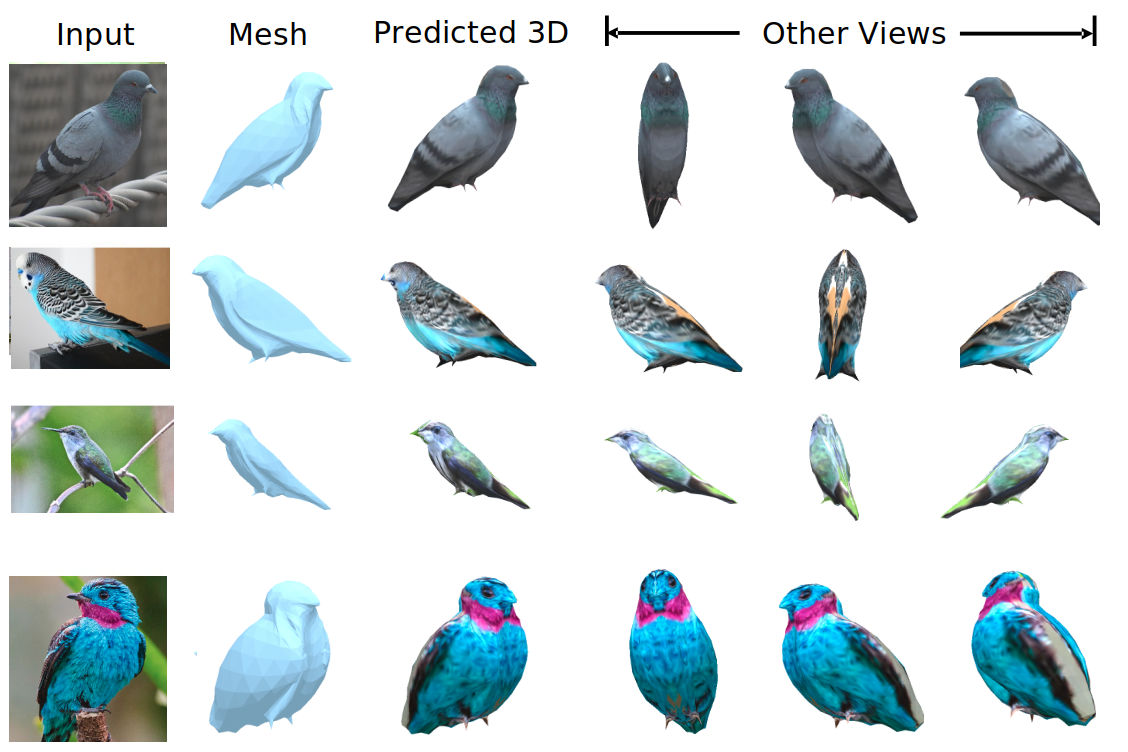

2dimageto3dmodel 是一个开源项目,旨在解决从单张 2D 图像重建 3D 模型这一具有挑战性的计算机视觉任务。该项目由诺维萨德大学的 Nikola Zubić 和剑桥大学的 Pietro Lio 共同开发,提出了一种创新的损失函数,可以在不依赖渲染过程的情况下,直接从 2D 图像生成高质量的 3D 模型。

核心技术

该项目的核心在于其独特的损失函数设计。传统方法通常需要复杂的渲染过程来生成 3D 模型,而这一过程往往计算成本高昂且容易引入额外误差。相比之下,2dimageto3dmodel 采用了一种直接的方法:

- 设计了一个专门的损失函数,可以直接从 2D 图像特征推断 3D 结构。

- 利用点云和网格表示相结合的方式,既保留了点云的灵活性,又具备了网格的结构化优势。

- 引入了伪真实数据(Pseudo-ground-truth)生成机制,解决了 3D 监督数据不足的问题。

这种方法不仅大大提高了计算效率,还在多个基准数据集上取得了优异的表现。

实验结果

研究团队在多个主流数据集上对该方法进行了全面评估:

- ShapeNet: 一个大规模的 3D 物体数据集

- CUB-200-2011: 包含 200 种鸟类的细粒度图像数据集

- Pascal3D+: 涵盖多种日常物体的 3D 姿态标注数据集

实验结果表明,2dimageto3dmodel 在以下几个方面均优于现有方法:

- 重建精度: 生成的 3D 模型更加接近真实物体形状。

- 计算效率: 训练和推理时间显著缩短。

- 泛化能力: 在未见过的物体类别上也能取得良好效果。

技术细节

项目的技术实现主要基于 PyTorch 深度学习框架,并使用了 NVIDIA 的 Kaolin 库来处理 3D 数据。主要的技术组件包括:

- 网格生成器: 负责从 2D 图像特征生成初始的 3D 网格结构。

- 点云优化: 通过迭代优化来细化 3D 形状。

- Poisson 表面重建: 将优化后的点云转换为最终的 3D 网格模型。

- GAN 纹理映射: 利用生成对抗网络为 3D 模型添加逼真的纹理。

应用前景

这项技术的潜在应用十分广泛,包括但不限于:

- 计算机辅助设计(CAD): 快速从草图或照片生成 3D 模型原型。

- 增强现实(AR): 实时将现实世界物体转换为 3D 虚拟模型。

- 机器人视觉: 帮助机器人更好地理解和交互环境中的 3D 物体。

- 文化遗产保护: 从历史照片重建已消失的建筑或文物的 3D 模型。

使用指南

要使用 2dimageto3dmodel,您需要按照以下步骤进行:

- 克隆项目仓库:

git clone https://github.com/NikolaZubic/2dimageto3dmodel.git

- 安装依赖项:

conda install pytorch torchvision torchaudio cudatoolkit=11.0 -c pytorch

- 安装 Kaolin 库(请注意使用特定的 commit):

cd kaolin

git checkout e7e513173b

python setup.py install

- 运行预训练模型:

python main.py --dataset cub --batch_size 16 --weights pretrained_weights_cub --save_results

详细的安装和使用说明可以在项目的 GitHub 页面 找到。

未来展望

尽管 2dimageto3dmodel 已经取得了显著的成果,但研究团队认为仍有进一步改进的空间:

- 提高对复杂场景和遮挡物体的处理能力。

- 探索更高效的网络架构,以实现实时 3D 重建。

- 结合大规模预训练模型,提升对稀有物体类别的泛化能力。

- 开发更直观的用户界面,使技术更易于非专业人士使用。

结语

2dimageto3dmodel 项目展示了深度学习在 3D 视觉领域的巨大潜力。通过创新的损失函数设计和有效的训练策略,该方法成功地将复杂的 3D 重建任务简化为一个高效且准确的过程。随着技术的不断发展和完善,我们可以期待看到更多令人兴奋的应用场景,从而进一步推动计算机视觉和图形学领域的进步。

如果您对这个项目感兴趣,欢迎访问 GitHub 仓库 了解更多详情,或者尝试使用这一技术来解决您自己的 3D 重建问题。研究团队也欢迎社区贡献,共同推动这一领域的发展。